每周跟踪AI热点新闻动向和震撼发展 想要探索生成式人工智能的前沿进展吗?订阅我们的简报,深入解析最新的技术突破、实际应用案例和未来的趋势。与全球数同行一同,从行业内部的深度分析和实用指南中受益。不要错过这个机会,成为AI领域的领跑者。点击订阅,与未来同行! 订阅:https://rengongzhineng.io/

无论是希望在好莱坞闯出一片天的电影制作人,还是乐于为观众制作视频的创作者,每个人都应该有机会使用可以提升创意的工具。今天,Meta推出了全新的AI生成技术——Movie Gen。这项突破性的生成式AI技术涵盖图像、视频和音频等多种媒介。通过简单的文本输入,就能生成自定义视频和声音,编辑现有视频,甚至将个人形象转化为独特的视频。在多项任务中,Movie Gen的表现超越了行业内的同类模型。

Meta一向致力于与社区分享基础的AI研究,这次也不例外。早期的生成AI研究从Make-A-Scene系列模型开始,能够生成图像、音频、视频和3D动画。接着,随着扩散模型的引入,Meta开发了Llama Image基础模型,大幅提升了图像和视频的生成质量以及图像编辑能力。而Movie Gen则代表了第三波创新,融合了多种媒介,为用户提供了前所未有的精细化控制。这类模型有望加速创意产品的开发,带来更多新奇的应用。

虽然这些模型用途广泛,但也需要明确,生成AI并非要取代艺术家和动画师的工作。Meta希望通过分享这项技术,帮助更多人表达创意,尤其是那些可能缺乏相关机会的人。未来或许每个人都能通过Movie Gen,将他们的艺术愿景转化为高清视频和音频作品。

探秘Movie Gen

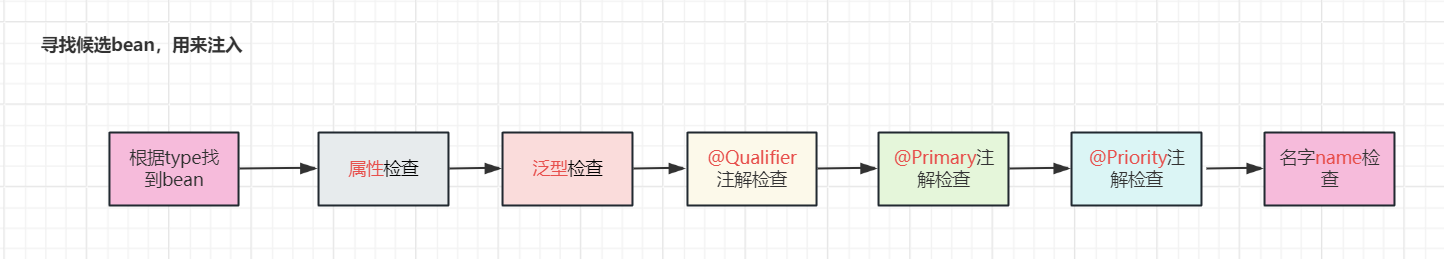

作为最先进的沉浸式叙事模型套件,Movie Gen具备四大核心能力:视频生成、个性化视频生成、精准视频编辑和音频生成。这些模型使用的是经过授权和公开数据集进行训练的。虽然技术细节将在研究论文中详细说明,但这篇文章将概述这些功能的实际表现。

视频生成

通过简单的文本提示,Movie Gen能够生成高质量、高分辨率的图像和视频。这款拥有300亿参数的模型,能够以每秒16帧的速度生成最长16秒的视频,且在物体运动、物体互动以及镜头运动等方面有出色表现。它可以学习多种概念的合理运动方式,堪称同类中的顶尖模型。

个性化视频生成

在基础模型的基础上,Meta还扩展了个性化视频生成功能。只需输入一个人的图像,结合文本提示,便可生成包含该人物并具有丰富视觉细节的视频。该模型在保持人类身份和动作的真实性方面表现优异。

精准视频编辑

该模型的编辑版本结合了视频生成和高级图像编辑功能,能够根据视频和文本提示,进行局部调整或全局变化。Movie Gen可以实现传统工具难以做到的精确编辑,例如添加、删除或替换元素,或者修改背景和风格,并且在保持原有内容的基础上,只改变相关像素。

音频生成

Meta还训练了一个拥有130亿参数的音频生成模型,能够为视频生成高质量的环境声、音效和背景音乐,且与视频内容完美同步。此外,Movie Gen引入了一种音频扩展技术,能够为任意时长的视频生成连贯的音频,无论是音质还是音画同步效果都处于业界领先水平。

成果展示

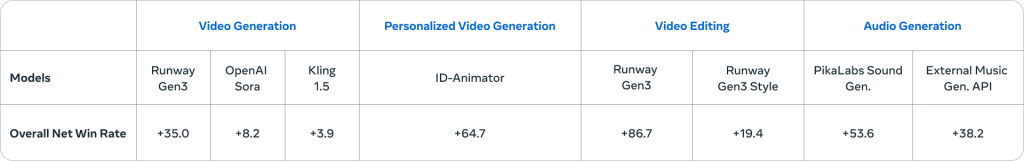

为了实现这些功能,Meta在模型架构、训练目标、数据处理、评估标准和推理优化方面进行了多项技术创新。Meta的A/B对比测试显示,在人类评价中,Movie Gen在四大功能上都有显著优势。

未来展望

虽然Movie Gen展示了未来应用的巨大潜力,但Meta也意识到当前的模型还有一些局限性。未来,Meta将继续优化模型,减少推理时间,提升生成质量。通过与电影制作人和创作者的密切合作,Meta希望能够不断改进这些工具,帮助人们以全新的方式释放创意。想象一下,通过文本提示创建并编辑一个“日常生活”短片分享到Reels,或者制作个性化的生日祝福动画发送给朋友,未来的创意表达机会将是无限的。