文章目录

- 一、算法概念

- 二、算法原理

- (一) FM表达式

- (二)时间复杂度

- (三)回归和分类

- 三、算法优缺点

- (一)优点

- (二)缺点

- 四、FM分类任务实现对比

- (一)数据加载和样本分区

- 1、Python代码

- 2、Sentosa_DSML社区版

- (二)模型训练

- 1、Python代码

- 2、Sentosa_DSML社区版

- (三)模型评估和模型可视化

- 1、Python代码

- 2、Sentosa_DSML社区版

- 五、FM回归任务实现对比

- (一)数据加载和样本分区

- 1、Python代码

- 2、Sentosa_DSML社区版

- (二)模型训练

- 1、Python代码

- 2、Sentosa_DSML社区版

- (三)模型评估和模型可视化

- 1、Python代码

- 2、Sentosa_DSML社区版

- 六、总结

一、算法概念

因子分解机(Factorization Machines, FM)是一种基于矩阵分解的机器学习算法,主要解决高维稀疏数据下的特征交互和参数估计问题。FM 通过引入特征组合和隐向量的矩阵分解来提升模型表现,特别适合处理推荐系统等场景中的数据稀疏性和特征交互复杂性。

FM 可以用于分类和回归任务,是线性模型的扩展,能够高效地捕捉特征之间的交互作用。FM 的核心是通过低维向量的内积表示特征交互,使得其参数数量随维度线性增长,从而降低计算复杂度。

FM 的主要特点:

∙

\bullet

∙有监督学习模型,适用于回归和分类任务。

∙

\bullet

∙通过低维向量的内积表示特征交互,模型结构保持线性。

∙

\bullet

∙常用训练方法:随机梯度下降(SGD)、交替最小二乘法(ALS)和马尔可夫链蒙特卡洛(MCMC)。

FM 模型通过矩阵分解对特征交互建模,并且在处理稀疏数据时有显著优势,常用于推荐系统。

二、算法原理

(一) FM表达式

为了使系统能够进行预测,它依赖于由用户事件记录生成的可用数据。这些数据是表示兴趣和意图的交易记录,例如:下载、购买、评分。

对于一个电影评论系统来说,交易数据记录了用户

u

∈

U

u \in U

u∈U 在某一时间

t

∈

R

t \in R

t∈R 对电影(物品)

i

∈

I

i \in I

i∈I 给出的评分

r

∈

{

1

,

2

,

3

,

4

,

5

}

r \in\{1, 2, 3, 4, 5 \}

r∈{1,2,3,4,5} ,由此产生的数据集可以表示如下:

用于预测的数据表示为一个矩阵

X

∈

R

m

×

n

X \in\mathbb{R}^{m \times n}

X∈Rm×n ,其中包含总共

m

m

m 个观测值,每个观测值由一个实值特征向量

x

∈

R

n

x \in\mathbb{R}^{n}

x∈Rn 组成。来自上述数据集的特征向量可以表示为:

其中,

n

=

∣

U

∣

+

∣

I

∣

+

∣

T

∣

n=| U |+| I |+| T |

n=∣U∣+∣I∣+∣T∣ ,即

x

∈

R

n

x \in\mathbb{R}^{n}

x∈Rn 也可以表示为

x

∈

R

∣

U

∣

+

∣

I

∣

+

∣

T

∣

x \in\mathbb{R}^{| U |+| I |+| T |}

x∈R∣U∣+∣I∣+∣T∣ ,其中训练数据集的表达式为

D

=

{

(

x

(

1

)

,

y

(

1

)

)

,

(

x

(

2

)

,

y

(

2

)

)

,

…

,

(

x

(

m

)

,

y

(

m

)

)

}

D=\{( x^{( 1 )}, y^{( 1 )} ), ( x^{( 2 )}, y^{( 2 )} ), \ldots, ( x^{( m )}, y^{( m )} ) \}

D={(x(1),y(1)),(x(2),y(2)),…,(x(m),y(m))} 。训练目标是估计一个函数

y

^

(

x

)

:

R

n

→

R

\hat{y} ( x ) : \mathbb{R}^{n} \to\mathbb{R}

y^(x):Rn→R ,当提供第

i

i

i 行

x

i

∈

R

n

x_{i} \in\mathbb{R}^{n}

xi∈Rn 作为输入时,能够正确预测对应的目标值

y

i

∈

R

y_{i} \in\mathbb{R}

yi∈R 。

FM模型的计算表达式如下所示:

<

v

i

,

v

j

>

< {\mathbf{v}}_{i}, {\mathbf{v}}_{j} >

<vi,vj> 是交叉特征的参数,可以由一组参数定义:

<

v

i

,

v

j

>

=

w

^

i

,

j

=

∑

f

=

1

k

v

i

,

f

×

v

j

,

f

< {\mathbf{v}}_{i}, {\mathbf{v}}_{j} >=\hat{w}_{i, j}=\sum_{f=1}^{k} v_{i, f} \times v_{j, f}

<vi,vj>=w^i,j=f=1∑kvi,f×vj,f

当

k

k

k 足够大时,对于任意对称正定的实矩阵

W

^

∈

R

n

×

n

\widehat{W} \in\mathbb{R}^{n \times n}

W

∈Rn×n ,均存在实矩阵

V

∈

R

n

×

k

V \, \in\, \mathbb{R}^{n \times k}

V∈Rn×k ,使得

W

^

=

V

V

⊤

\widehat{W}=V V^{\top}

W

=VV⊤成立:

W

^

=

[

w

^

1

,

1

w

^

1

,

2

⋯

w

^

1

,

n

w

^

2

,

1

w

^

2

,

2

⋯

w

^

2

,

n

⋮

⋮

⋱

⋮

w

^

n

,

1

w

^

n

,

2

⋯

w

^

n

,

n

]

=

V

T

V

=

[

v

1

T

v

2

T

⋮

v

n

T

]

[

v

1

v

2

⋯

v

n

]

\hat{\mathbf{W}} = \begin{bmatrix} \hat{w}_{1,1} & \hat{w}_{1,2} & \cdots & \hat{w}_{1,n} \\ \hat{w}_{2,1} & \hat{w}_{2,2} & \cdots & \hat{w}_{2,n} \\ \vdots & \vdots & \ddots & \vdots \\ \hat{w}_{n,1} & \hat{w}_{n,2} & \cdots & \hat{w}_{n,n} \end{bmatrix} = \mathbf{V}^{T} \mathbf{V} = \begin{bmatrix} {\mathbf{v}}_1^{T} \\ {\mathbf{v}}_2^{T} \\ \vdots \\ {\mathbf{v}}_n^{T} \end{bmatrix} \begin{bmatrix} {\mathbf{v}}_1 &{\mathbf{v}}_2 & \cdots & {\mathbf{v}}_n \end{bmatrix}

W^=

w^1,1w^2,1⋮w^n,1w^1,2w^2,2⋮w^n,2⋯⋯⋱⋯w^1,nw^2,n⋮w^n,n

=VTV=

v1Tv2T⋮vnT

[v1v2⋯vn]

其中,模型待求解的参数为:

w

0

∈

R

,

w

∈

R

n

,

V

∈

R

n

×

k

w_{0} \in\mathbb{R}, \quad\mathbf{w} \in\mathbb{R}^{n}, \quad\mathbf{V} \in\mathbb{R}^{n \times k}

w0∈R,w∈Rn,V∈Rn×k

其中:

∙

\bullet

∙

w

0

w_{0}

w0 表示全局偏差。

∙

\bullet

∙

w

i

w_{i}

wi 用于捕捉第

i

i

i 个特征和目标之间的关系。

∙

\bullet

∙

w

^

i

,

j

\hat{w}_{i, j}

w^i,j 用于捕捉

(

i

,

j

)

( i, j )

(i,j) 二路交叉特征和目标之间的关系。

∙

\bullet

∙

v

i

{\mathbf{v}}_{i}

vi 代表特征

i

i

i 的表示向量,它是

V

\mathbf{V}

V 的第

i

i

i 列。

(二)时间复杂度

根据FM模型计算表达式,可以得到模型的计算复杂度如下:

{

n

+

(

n

−

1

)

}

+

{

n

(

n

−

1

)

2

[

k

+

(

k

−

1

)

+

2

]

+

n

(

n

−

1

)

2

−

1

}

+

2

=

O

(

k

n

2

)

,

\{n+( n-1 ) \}+\left\{\frac{n ( n-1 )} {2} [ k+( k-1 )+2 ]+\frac{n ( n-1 )} {2}-1 \right\}+2={ O} ( k n^{2} ),

{n+(n−1)}+{2n(n−1)[k+(k−1)+2]+2n(n−1)−1}+2=O(kn2),

通过对交叉项的分解和计算,可以降低时间复杂度为

O

(

k

n

)

{ O} ( k n )

O(kn),计算过程如下所示:

对于交叉特征,它们的交叉矩阵是一个对称矩阵,这里通过对一个 3x3 对称矩阵的详细分析,展示如何通过减少自交互项和利用对称性来优化计算。最终的结果是简化方程,并且将计算复杂度从二次方降低为线性级别,使模型能够更加高效地处理稀疏数据场景。

首先,使用一个 3x3 的对称矩阵,图中表达式为计算目标:

对目标表达式进行展开,展开后对内积进行计算,左式表示 3x3 对称矩阵的一半(对称矩阵的上三角部分)

右式表示需要从左式中减去的部分,右式为对称矩阵中自交互的部分,即对角线部分的计算。

最终推导,得到:

y

^

(

x

)

=

w

0

+

∑

i

=

1

n

w

i

×

x

i

+

1

2

∑

f

=

1

k

(

(

∑

i

=

1

n

v

i

,

f

×

x

i

)

2

−

∑

i

=

1

n

v

i

,

f

2

×

x

i

2

)

\hat{y} ( {\bf x} )=w_{0}+\sum_{i=1}^{n} w_{i} \times x_{i}+\frac{1} {2} \sum_{f=1}^{k} \left( \left( \sum_{i=1}^{n} v_{i, f} \times x_{i} \right)^{2}-\sum_{i=1}^{n} v_{i, f}^{2} \times x_{i}^{2} \right)

y^(x)=w0+i=1∑nwi×xi+21f=1∑k

(i=1∑nvi,f×xi)2−i=1∑nvi,f2×xi2

其计算复杂度为

O

(

k

n

)

{ O} ( k n )

O(kn):

k

{

[

n

+

(

n

−

1

)

+

1

]

+

[

3

n

+

(

n

−

1

)

]

+

1

}

+

(

k

−

1

)

+

1

=

O

(

k

n

)

k \{[ n+( n-1 )+1 ]+[ 3 n+( n-1 ) ]+1 \}+( k-1 )+1={\cal O} ( k n )

k{[n+(n−1)+1]+[3n+(n−1)]+1}+(k−1)+1=O(kn)

(三)回归和分类

FM 模型可以用于求解分类问题,也可以用于求解回归问题。在回归任务中,FM 的输出

y

^

(

x

)

\hat{y} ( {\bf x} )

y^(x)可以直接作为连续型预测变量。目标是优化回归损失函数,

最小二乘误差(MSE):最小化预测值与实际值之间的均方误差。损失函数表达式如下所示:

l

(

y

^

(

x

)

,

y

)

=

(

y

^

(

x

)

−

y

)

2

l(\hat{y}(x), y) = (\hat{y}(x) - y)^2

l(y^(x),y)=(y^(x)−y)2

对于二分类问题,使用的是Logit或Hinge损失函数:

l

(

y

^

(

x

)

,

y

)

=

−

ln

σ

(

y

^

(

x

)

y

)

l(\hat{y}(x), y) = -\ln \sigma(\hat{y}(x) y)

l(y^(x),y)=−lnσ(y^(x)y)

其中,σ 是Sigmoid(逻辑函数),𝑦∈{−1,1}。在二分类任务中,模型输出的是类别的概率,Sigmoid函数将其转换为0到1之间的概率值,而损失函数则度量预测值与真实分类之间的偏差。FMs 容易出现过拟合问题,因此应用 L2 正则化来防止过拟合。正则化有助于减少模型的复杂性,防止模型在训练数据上过度拟合,从而提升模型在新数据上的泛化能力。

模型训练好后,就可以利用

y

^

(

x

)

\widehat{y} ( \mathbf{x} )

y

(x) 的正负符号来预测

x

\mathbf{x}

x 的分类了。

最后,FM 模型方程的梯度可以表示如下:

∂

∂

θ

y

^

(

x

)

=

{

1

,

如果

θ

是

w

0

x

i

,

如果

θ

是

w

i

x

i

∑

j

=

1

n

v

j

f

x

j

−

v

i

f

x

i

2

,

如果

θ

是

v

i

,

f

\frac{\partial}{\partial \theta} \hat{y}(x) = \begin{cases} 1, & \text{如果} \, \theta \, \text{是} \, w_0 \\ x_i, & \text{如果} \, \theta \, \text{是} \, w_i \\ x_i \sum_{j=1}^{n} v_j^f x_j - v_i^f x_i^2, & \text{如果} \, \theta \, \text{是} \, v_{i,f} \end{cases}

∂θ∂y^(x)=⎩

⎨

⎧1,xi,xi∑j=1nvjfxj−vifxi2,如果θ是w0如果θ是wi如果θ是vi,f

其中,

∙

\bullet

∙ 当参数是

w

0

w_{0}

w0 时,梯度为常数1。

∙

\bullet

∙ 当参数是

w

i

w_{i}

wi 时,梯度为

x

i

x_{i}

xi ,即特征

i

i

i 的值。

∙

\bullet

∙ 当参数是

v

i

,

f

v_{i, f}

vi,f 时,梯度更复杂,包含一个交互项

x

i

∑

j

=

1

n

v

j

f

x

j

x_{i} \sum_{j=1}^{n} v_{j}^{f} x_{j}

xi∑j=1nvjfxj 减去一个二次项

v

i

f

x

i

2

v_{i}^{f} x_{i}^{2}

vifxi2 。这里

v

j

f

v_{j}^{f}

vjf 是对应特征

j

j

j 的因子向量的第

f

f

f 个元素。

求和项

∑

j

=

1

n

v

j

f

x

j

\sum_{j=1}^{n} v_{j}^{f} x_{j}

∑j=1nvjfxj 与

i

i

i 无关,因此可以提前计算。这样,每个梯度都可以在常数时间

O

(

1

)

O ( 1 )

O(1) 内计算出来,而所有参数的更新可以在

O

(

k

n

)

O(kn)

O(kn) 或稀疏条件下的

O

(

k

N

z

(

x

)

)

O(kN_z(x))

O(kNz(x))内完成,其中

k

k

k是因子维度,

n

n

n是特征数量,

N

z

(

x

)

N_z(x)

Nz(x)是非零特征的数量。

三、算法优缺点

(一)优点

1、解决了特征稀疏的问题,能够在非常系数数据的情况下进行预估

2、解决了特征组合的问题

3、FM是一个通用模型,适用于大部分场景

4、线性复杂度,训练速度快

(二)缺点

虽然考虑了特征的交互,但是表达能力仍然有限,不及深度模型;通过矩阵结构来建模特征之间的二阶交互交互作用,假设所有特征的权重都可以通过隐式支持来串联,但实际上某些特征交互可能比其他特征交互更重要,这种统一的串联有时无法捕捉复杂的交互关系。

四、FM分类任务实现对比

使用 PySpark 的 FMClassifier 进行分类任务

(一)数据加载和样本分区

1、Python代码

# 创建 Spark 会话

spark = SparkSession.builder \

.appName("FMClassifierExample") \

.getOrCreate()

# 加载 Iris 数据集

from sklearn.datasets import load_iris

iris = load_iris()

X = iris.data

y = iris.target

# 将数据转换为 DataFrame

df = pd.DataFrame(X, columns=iris.feature_names)

df['label'] = y

# 将 pandas DataFrame 转换为 Spark DataFrame

spark_df = spark.createDataFrame(df)

# 将特征列组合成一个单独的特征列

assembler = VectorAssembler(inputCols=iris.feature_names, outputCol="features")

spark_df = assembler.transform(spark_df).select(col("label"), col("features"))

# 划分训练集和测试集

train_df, test_df = spark_df.randomSplit([0.8, 0.2], seed=42)

2、Sentosa_DSML社区版

首先通过数据读入算子读取数据,中间可以接任意个数据处理算子(例,行处理,列处理等),

然后,连接行处理中的样本分区算子对数据进行训练集和测试集的划分,比例为8:2,

再接类型算子,设置Feature列和Label列。

(二)模型训练

1、Python代码

from pyspark.sql import SparkSession

from pyspark.ml.classification import FMClassifier

# 创建 FMClassifier 模型

fm = FMClassifier(

featuresCol="features",

labelCol="label",

predictionCol="prediction",

probabilityCol="probability",

rawPredictionCol="rawPrediction",

factorSize=8,

fitIntercept=True,

fitLinear=True,

regParam=0.01,

miniBatchFraction=1.0,

initStd=0.01,

maxIter=100,

stepSize=0.01,

tol=1e-06,

solver="adamW",

thresholds=[0.5], # 设置分类阈值

seed=42

)

# 训练模型

fm_model = fm.fit(train_df)

# 进行预测

predictions = fm_model.transform(test_df)

# 显示预测结果

predictions.select("features", "label", "prediction", "probability").show()

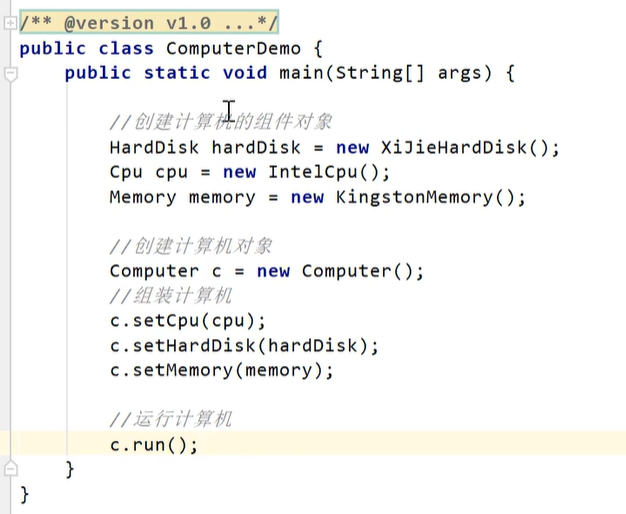

2、Sentosa_DSML社区版

连接因子分解机分类算子,右侧设置模型参数等信息,点击应用后,右击算子并执行,得到因子分解机分类模型。如下图所示,

(三)模型评估和模型可视化

1、Python代码

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score, confusion_matrix

import matplotlib.pyplot as plt

import seaborn as sns

# 从 PySpark DataFrame 提取预测结果

predictions_df = predictions.select("label", "prediction").toPandas()

y_test_sklearn = predictions_df['label'].values

y_pred_sklearn = predictions_df['prediction'].values

# 评估模型

accuracy = accuracy_score(y_test_sklearn, y_pred_sklearn)

precision = precision_score(y_test_sklearn, y_pred_sklearn, average='weighted')

recall = recall_score(y_test_sklearn, y_pred_sklearn, average='weighted')

f1 = f1_score(y_test_sklearn, y_pred_sklearn, average='weighted')

# 打印评估结果

print(f"FM 模型的准确率: {accuracy:.2f}")

print(f"加权精度 (Weighted Precision): {precision:.2f}")

print(f"加权召回率 (Weighted Recall): {recall:.2f}")

print(f"F1 值 (Weighted F1 Score): {f1:.2f}")

# 计算混淆矩阵

cm = confusion_matrix(y_test_sklearn, y_pred_sklearn)

2、Sentosa_DSML社区版

模型后可接任意个数据处理算子,比如图表分析算子或数据写出算子,形成算子流执行,也可接评估算子,对模型的分类结果进行评估。如下图所示:

得到训练集和测试集的评估结果如下:

右击模型,可以查看模型的模型信息,模型信息如下图所示:

五、FM回归任务实现对比

利用python代码,结合 PySpark 和 pandas 处理数据,主要应用了 Spark 的 FMRegressor 进行回归分析。

(一)数据加载和样本分区

1、Python代码

# 读取 winequality 数据集

df = pd.read_csv("D:/sentosa_ML/Sentosa_DSML/mlServer/TestData/winequality.csv")

df = df.dropna() # 处理缺失值

# 将 pandas DataFrame 转换为 Spark DataFrame

spark_df = spark.createDataFrame(df)

# 将特征列组合成一个单独的特征列

feature_columns = df.columns.tolist()

feature_columns.remove('quality')

assembler = VectorAssembler(inputCols=feature_columns, outputCol="features")

spark_df = assembler.transform(spark_df).select("features", "quality")

# 划分训练集和测试集

train_df, test_df = spark_df.randomSplit([0.8, 0.2], seed=42)

2、Sentosa_DSML社区版

先读取需要数据集,

然后连接样本分区算子对数据集进行训练集和测试集的划分,划分比例为8:2,

再接类型算子设置Feature列和Label列(Label列需满足:能转换为Double类型或者就是Double类型)

(二)模型训练

1、Python代码

# 创建 FMRegressor 模型

fm_regressor = FMRegressor(

featuresCol="features",

labelCol="quality",

predictionCol="prediction",

factorSize=8,

fitIntercept=True,

fitLinear=True,

regParam=0.01,

miniBatchFraction=1.0,

initStd=0.01,

maxIter=100,

stepSize=0.01,

tol=1e-06,

solver="adamW",

seed=42

)

# 训练模型

fm_model = fm_regressor.fit(train_df)

# 对测试集进行预测

predictions = fm_model.transform(test_df)

2、Sentosa_DSML社区版

连接因子分解机回归算子,

右击算子,点击运行,得到因子分解机回归模型。如下图所示:

(三)模型评估和模型可视化

1、Python代码

# 评估模型

evaluator = RegressionEvaluator(

predictionCol="prediction",

labelCol="quality",

metricName="r2"

)

r2 = evaluator.evaluate(predictions)

evaluator_mae = RegressionEvaluator(predictionCol="prediction", labelCol="quality", metricName="mae")

mae = evaluator_mae.evaluate(predictions)

evaluator_mse = RegressionEvaluator(predictionCol="prediction", labelCol="quality", metricName="mse")

mse = evaluator_mse.evaluate(predictions)

rmse = np.sqrt(mse)

# 打印评估结果

print(f"R²: {r2:.4f}")

print(f"MAE: {mae:.4f}")

print(f"MSE: {mse:.4f}")

print(f"RMSE: {rmse:.4f}")

# 将预测值转换为 Pandas DataFrame 以便绘图

predictions_pd = predictions.select("quality", "prediction").toPandas()

y_test = predictions_pd["quality"]

y_pred = predictions_pd["prediction"]

# 绘制实际值与预测值的对比图

plt.figure(figsize=(8, 6))

plt.scatter(y_test, y_pred, color="blue", alpha=0.6)

plt.plot([min(y_test), max(y_test)], [min(y_test), max(y_test)], 'r--')

plt.xlabel('Actual Quality')

plt.ylabel('Predicted Quality')

plt.title('Actual vs Predicted Wine Quality')

plt.show()

# 计算残差

residuals = y_test - y_pred

# 使用 Seaborn 绘制带核密度估计的残差直方图

plt.figure(figsize=(8, 6))

sns.histplot(residuals, kde=True, bins=20)

plt.title('Residuals Histogram with KDE')

plt.xlabel('Residuals')

plt.ylabel('Frequency')

plt.grid(True)

plt.show()

2、Sentosa_DSML社区版

模型后接评估算子,对模型结果进行评估。算子流如下图所示:

训练集和测试集的评估结果如下:

右击模型,查看模型的模型信息:

六、总结

相比传统代码方式,利用Sentosa_DSML社区版完成机器学习算法的流程更加高效和自动化,传统方式需要手动编写大量代码来处理数据清洗、特征工程、模型训练与评估,而在Sentosa_DSML社区版中,这些步骤可以通过可视化界面、预构建模块和自动化流程来简化,有效的降低了技术门槛,非专业开发者也能通过拖拽和配置的方式开发应用,减少了对专业开发人员的依赖。

Sentosa_DSML社区版提供了易于配置的算子流,减少了编写和调试代码的时间,并提升了模型开发和部署的效率,由于应用的结构更清晰,维护和更新变得更加容易,且平台通常会提供版本控制和更新功能,使得应用的持续改进更为便捷。

为了非商业用途的科研学者、研究人员及开发者提供学习、交流及实践机器学习技术,推出了一款轻量化且完全免费的Sentosa_DSML社区版。以轻量化一键安装、平台免费使用、视频教学和社区论坛服务为主要特点,能够与其他数据科学家和机器学习爱好者交流心得,分享经验和解决问题。文章最后附上官网链接,感兴趣工具的可以直接下载使用

https://sentosa.znv.com/

![[Python学习日记-31] Python 中的函数](https://i-blog.csdnimg.cn/direct/162340e3427b45ecb1fe5cf328876971.png)

![[c++高阶]模版进阶](https://i-blog.csdnimg.cn/direct/87ecf570e70540928d871200d70ec21d.png)