Neurips 24

推荐指数: #paper/⭐⭐⭐

领域:可扩展图,大图加速

整个文章的理论部分比较多,尽量尽我所能避开一些额外公式。详细文章,见链接

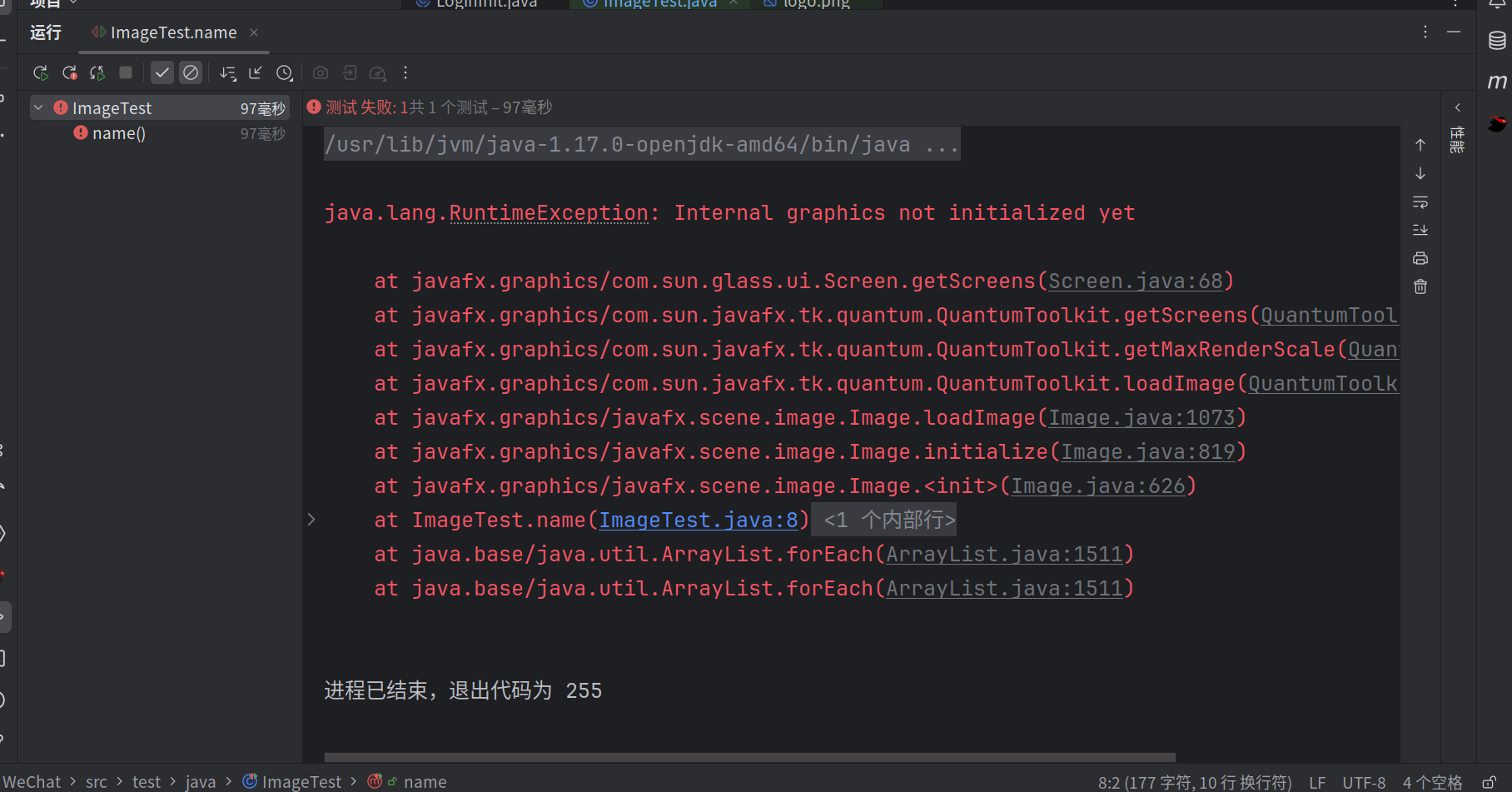

模型架构

如图,整个模型分为与计算和训练两部分。本文的精华在于预训练

LD2–一个解耦的异配图gnn

为了更好的加速,我们使用了多通道结果去增加灵活性。输入的数据是一系列的嵌入矩阵

[

P

1

,

P

2

,

…

,

P

C

]

[P_{1},P_{2},\dots ,P_{C}]

[P1,P2,…,PC]

预计算

P

A

,

P

X

=

A

2

P

r

o

p

(

A

,

X

)

\boldsymbol{P}_A,\boldsymbol{P}_X=\mathrm{A}^2\mathrm{Prop}(\boldsymbol{A},\boldsymbol{X})

PA,PX=A2Prop(A,X)

转换得嵌入

H

(

L

)

=

M

L

P

(

P

A

W

A

∥

P

X

W

X

)

.

\boldsymbol{H}^{(L)}=\mathrm{MLP}(\boldsymbol{P}_A\boldsymbol{W}_A\|\boldsymbol{P}_X\boldsymbol{W}_X).

H(L)=MLP(PAWA∥PXWX).

低纬邻接矩阵嵌入

由于二阶邻居信息很少受到同配异配信息的影响,因此我们对二跳邻接矩阵进行建模

P

A

=

arg

min

P

∈

R

n

×

F

∥

A

2

−

P

P

T

∥

F

2

.

\boldsymbol{P}_A=\arg\min_{\boldsymbol{P}\in\mathbb{R}^{n\times F}}\|\boldsymbol{A}^2-\boldsymbol{P}\boldsymbol{P}^T\|_F^2.

PA=argP∈Rn×Fmin∥A2−PPT∥F2.

通过优化F范数,我们可以得到

P

A

∈

R

n

×

F

P_{A} \in \mathbb{R}^{n \times F}

PA∈Rn×F.

(谱分析视角见论文原文)

长距离特征嵌入

用

P

X

=

∑

l

=

1

L

P

θ

l

T

l

X

P_X=\sum_{l=1}^{L_P}\theta_l\boldsymbol{T}^l\boldsymbol{X}

PX=∑l=1LPθlTlX 来计算特征,可能不太好(因为数据有高通低通中通)。按照低通高通中通,我们分别定义为

P

X

,

L

2

,

P

H

,

P

X

,

0

P_{X,L2},P_{H},P_{X,0}

PX,L2,PH,PX,0。

那么,

P

X

,

H

=

1

L

P

,

H

∑

l

=

1

L

P

,

H

(

I

+

L

~

)

l

X

,

(

θ

l

=

1

,

T

=

I

+

L

~

)

\boldsymbol{P}_{X,H}=\frac1{L_{P,H}}\sum_{l=1}^{L_{P,H}}(\boldsymbol{I}+\tilde{\boldsymbol{L}})^l\boldsymbol{X}, (\theta_l=1, \boldsymbol{T}=\boldsymbol{I}+\tilde{\boldsymbol{L}})

PX,H=LP,H1l=1∑LP,H(I+L~)lX,(θl=1,T=I+L~)

P

X

,

L

2

=

1

L

P

,

L

2

∑

l

=

1

L

P

,

L

2

A

ˉ

2

l

X

,

(

θ

l

=

1

,

T

=

A

ˉ

2

)

\boldsymbol{P}_{X,L2}=\frac1{L_{\boldsymbol{P},\boldsymbol{L}2}}\sum_{l=1}^{L_{P,L2}}\bar{\boldsymbol{A}}^{2l}\boldsymbol{X}, (\theta_{l}=1,\boldsymbol{T}=\bar{\boldsymbol{A}}^{2})

PX,L2=LP,L21l=1∑LP,L2Aˉ2lX,(θl=1,T=Aˉ2)

P

X

,

0

=

X

\boldsymbol{P}_{X,0}=\boldsymbol{X}

PX,0=X

其中,

L

~

=

I

−

A

~

,

A

‾

\tilde{L}=I-\tilde{A},\overline{A}

L~=I−A~,A是没有自环的邻接矩阵。

(谱分析视角见原文)

拉普拉斯矩阵显然是高通过滤器,A是低通过滤器。这样,我们就可以构造高阶或者低阶如上长距离特征嵌入

近似邻接矩阵传播预计算

近似特征嵌入计算

P

X

=

∑

l

=

0

L

P

θ

l

T

l

X

\boldsymbol{P}_X=\sum_{l=0}^{L_P}\theta_l\boldsymbol{T}^l\boldsymbol{X}

PX=l=0∑LPθlTlX

首先,初始值是:

R

(

0

)

=

X

.

\boldsymbol{R}^{(0)}=\boldsymbol{X}.

R(0)=X.传播矩阵是T。拉普拉斯传播T=I+L.嵌入可以表示为迭代形式:

R

(

l

+

1

)

(

u

)

=

2

R

(

l

)

(

u

)

−

∑

v

∈

N

(

u

)

R

(

l

)

(

v

)

/

d

a

(

u

)

d

b

(

v

)

=

∑

v

∈

N

(

u

)

∪

{

u

}

α

L

(

u

,

v

)

d

a

(

u

)

d

b

(

v

)

⋅

R

(

l

)

(

v

)

\boldsymbol{R}^{(l+1)}(u)=2\boldsymbol{R}^{(l)}(u)-\sum_{v\in\mathcal{N}(u)}\boldsymbol{R}^{(l)}(v)/d^a(u)d^b(v)=\sum_{v\in\mathcal{N}(u)\cup\{u\}}\frac{\alpha_L(u,v)}{d^a(u)d^b(v)}\cdot\boldsymbol{R}^{(l)}(v)

R(l+1)(u)=2R(l)(u)−v∈N(u)∑R(l)(v)/da(u)db(v)=v∈N(u)∪{u}∑da(u)db(v)αL(u,v)⋅R(l)(v)

α

T

(

u

,

v

)

\alpha_T(u,v)

αT(u,v)对于T,

α

L

(

u

,

u

)

=

2

d

a

+

b

(

u

)

,

α

L

(

u

,

v

)

=

−

1

,

v

∈

N

(

u

)

\begin{aligned}\alpha_L(u,u)=2d^{\boldsymbol{a+b}}(u),\alpha_L(u,v)=-1,v\in\mathcal{N}(u)\end{aligned}

αL(u,u)=2da+b(u),αL(u,v)=−1,v∈N(u)。对于

A

~

,

A

ˉ

\tilde{A},\bar{A}

A~,Aˉ,分别是

α

A

(

u

,

v

)

=

1

and

α

A

(

u

,

u

)

=

1

,

0

\alpha_{A}(u,v)=1\text{ and }\alpha_{A}(u,u)=1,0

αA(u,v)=1 and αA(u,u)=1,0

近似邻接矩阵嵌入的计算

R

(

0

)

=

N

(

0

,

1

)

\boldsymbol{R}^{(0)}=N(0,1)

R(0)=N(0,1)

A

2

a

s

R

(

l

+

1

)

=

A

2

R

(

l

)

\boldsymbol{A}^2\mathrm{~as~}\boldsymbol{R}^{(l+1)}=\boldsymbol{A}^2\boldsymbol{R}^{(l)}

A2 as R(l+1)=A2R(l)

之后,执行column-wise normalization

orthonormalize

(

R

(

l

+

1

)

)

\texttt{orthonormalize}(\boldsymbol{R}^{(l+1)})

orthonormalize(R(l+1))

这样,矩阵就满足:

A

2

R

(

L

P

)

=

R

(

L

P

)

Λ

\boldsymbol{A}^2\boldsymbol{R}^{(L_P)}=\boldsymbol{R}^{(L_P)}\boldsymbol{\Lambda}

A2R(LP)=R(LP)Λ

最后,结果是:

U

^

=

R

(

L

P

)

,

P

^

A

=

U

^

∣

Λ

^

∣

1

/

2

\hat{\boldsymbol{U}}=\boldsymbol{R}^{(L_P)},\hat{\boldsymbol{P}}_A=\hat{\boldsymbol{U}}|\hat{\boldsymbol{\Lambda}}|^{1/2}

U^=R(LP),P^A=U^∣Λ^∣1/2

实验结果:

时间开销: