4、(PCT)Point Cloud Transformer

论文链接:PCT论文链接

本篇论文介绍Transformer在3D点云领域的应用,Transformer在NLP领域和图像处理领域都得到了广泛的应用,特别是近年来在图像领域的应用,本篇论文主要介绍,如何将Transformer运用到3D点云领域。

PCT的出发点

PCT(Point Cloud Transformer)的设计灵感来自于Transformer在处理序列数据(如自然语言处理)中的成功应用。PCT的出发点包括:

- 点云数据的特性:

- 稀疏性和不规则性:点云数据通常是不规则且稀疏的,传统的卷积网络难以直接处理这些特性。Transformer的自注意力机制通过全局建模和自适应加权,有助于有效处理这些数据特性。

- 增强局部和全局特征:

- 偏移注意力(Offset Attention):PCT引入了偏移注意力机制,用于增强点云的局部特征建模。通过计算自注意力特征与输入特征之间的偏移,PCT能够更好地捕捉点云中的细节和局部几何结构。

- 提高点云处理能力:

- 改进的特征聚合:PCT利用Transformer的自注意力机制对点云进行特征聚合,从而提高模型在点云分类、分割等任务上的表现。通过全局特征建模,PCT能够更准确地理解点云的整体结构。

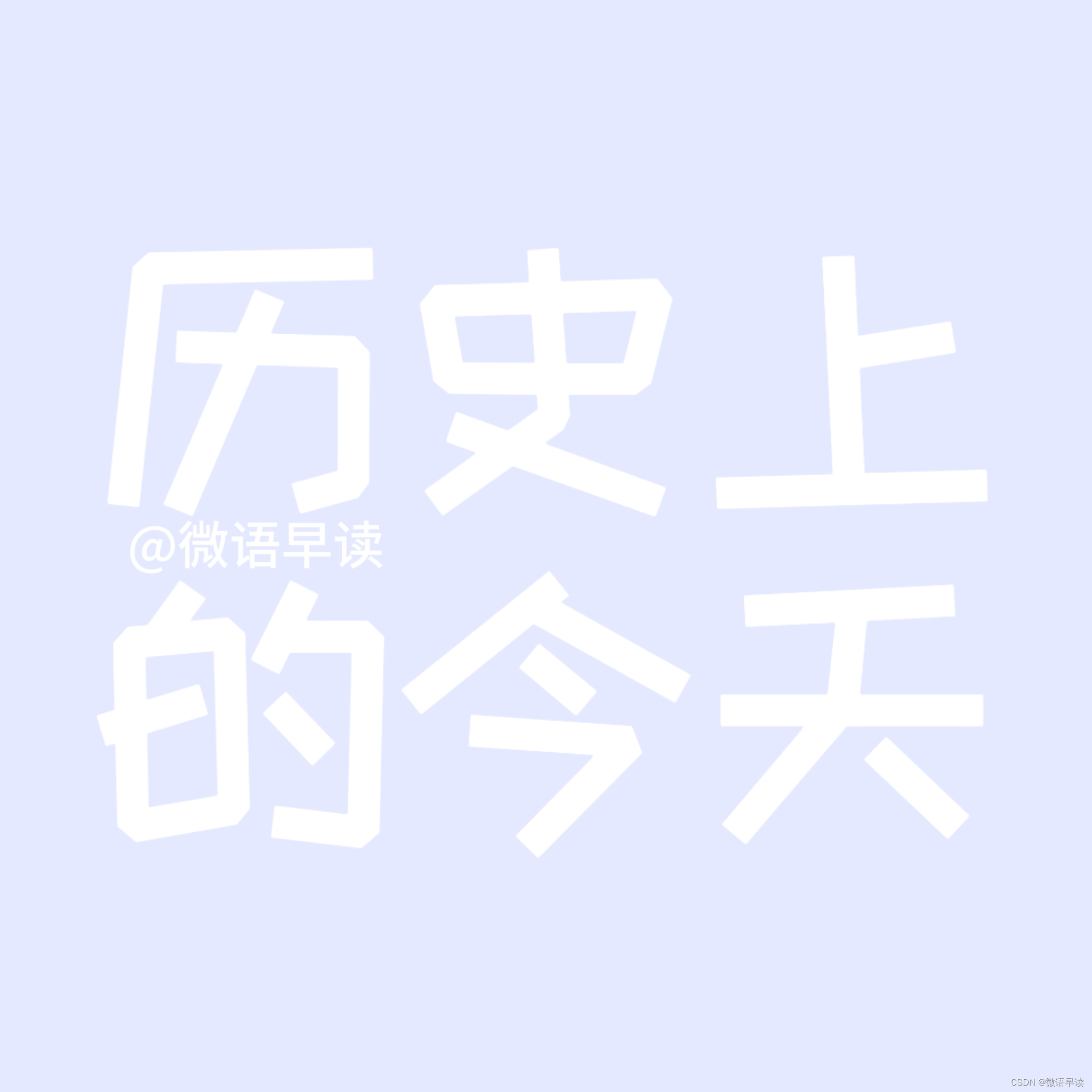

模型架构

模型的主体架构,左边是编码器,Transformer对点云特征进行提取,编码器中的每一个Attention,

引入了偏移量机制,学习偏移量使提取的特征更加准确,

邻居嵌入机制使用,在点云采样期间使用欧几里得距离分组的 k-NN 搜索对每个点的局部邻居的特征进行聚合。使得模型可以聚合局部邻居之间的特征。

右边分别是分类和分割任务,属于下游任务,和PointNet模型分类和分割方法一致。

Transformer模块细节

自注意力机制的细节,和普通的Transformer的计算方法完全一致,只是应用于图像时,每个特征是序列,这里是先对点的特征进行升维,使得每个点的特征变成一个序列,通用计算的到的q、k、v,让每个q和k进行相似度计算,最后将权重应用于v得计算后的特征,得到特征之后,这里会使用偏移注意力机制,来修正特征提取,最后连接残差连接得到最终的特征。

偏移注意力机制原理

邻居嵌入机制使用

实际上就在输出到Attention层之前,对特征数据点进行数据增强,采用最远点采样,采集能够代表全局特征的点,例如1024个,然后1024个点在全局的点云中使用K-NN计算离采样点最近的K个点,并计算这些点特征,最后再将特征聚合到采样点上,作为最终的输入特征点,这样使得采样点具有邻居的特征,使得点云特征更加丰富。

以上就是PCT的大致思想,主要在于两点:

在于输入数据的增强,采用邻居嵌入,使得输入数据具有邻居点之间的特征信息。

在于偏移注意力机制的加入,对于特征提取准确度的修正,使得特征提取更加的精准。

![docker-compose 部署 flink [支持pyflink]](https://i-blog.csdnimg.cn/direct/58b7391345c44429aa26b96ffaabe61c.png)