这里写目录标题

- 第一步 ollama安装

- 常见报错

- 第二步 下载启动模型

- 下载

- 启动模型

- 常见问题

- 第三步配置codegeex

- 安装插件

- 本地配置

- 其他

如果可以联网,vscode装个codegeex插件即可,本次搭建的本地编程助手,解决因安全问题完全无网络的情况下的编程助手搭建问题。

第一步 ollama安装

官网下载

常见报错

官网经常下载不下来,可以看之前写的从github下载:ollama安装

第二步 下载启动模型

下载

https://ollama.com/library 可以查看ollama支持哪些模型

此处我们搜索下codegeex,我由于笔记本配置问题,选择了小一点的量化版本,右边可以复制命令:

安装成功后,windows下显示了这个小图标

启动模型

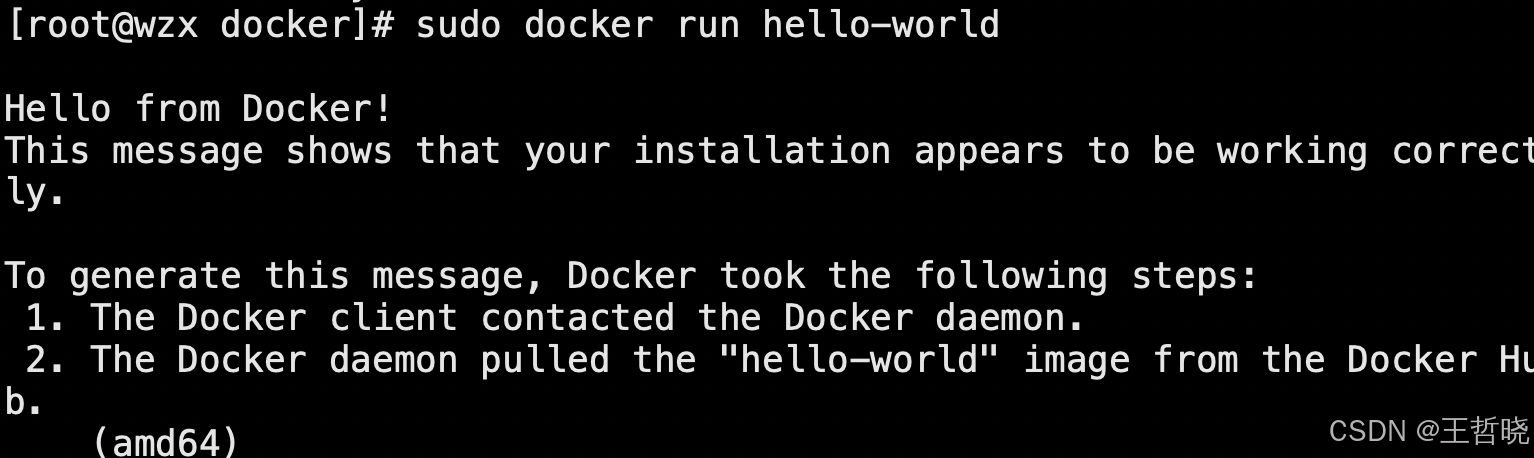

- 开一个powershell,ollama 作为服务启动:

ollama serve

- 加载模型

再打开一个命令行

ollama run codegeex4:9b-all-q2_K

此时已经可以进行对话了

常见问题

- 如果报错:Error: listen tcp 127.0.0.1:11434: bind: Only one usage of each socket address (protocol/network address/port) is normally permitted.

说明端口被占用,可以用下面的方式修改端口:

windows下改变监听端口

环境变量 增加变量名:OLLAMA_HOST 变量值

(端口)::11436

- 跨域访问增加下面一个环境变量

export OLLAMA_ORIGINS=“*”

修改完环境变量后,重启ollama,也重启下命令行端口

第三步配置codegeex

安装插件

联网的话,直接在插件中心用 vscode 安装好codegeex插件,不连网可以在marketplace下载:

https://codegeex.cn/zh-CN/downloadGuide

本地配置

安装完成后,vscode左侧插件栏选择codegeex,打开“…”选择“本地模式”

打开本地模式后,点下面这个本地模式,在vscode弹出来的对话框中选择config如下:

或者切换到模型选项卡,配置上ollama 启动的地址以及模型名称:

http://localhost:11434/v1/chat/completions

其他

ollama 搭建到彻底离线的内网的时候,跟上面配置是一样的,只是需要把有网络的情况下,Ollama下载好的模型拷贝到内网环境,默认情况下ollama的下载模型地址:

Windows系统:C:\Users<用户名>.ollama\models

Linux系统:/usr/share/ollama/.ollama/models

可以通过添加环境变量OLLAMA_MODELS 修改ollama下载和加载模型的地址