一、Qwen2简介

Qwen2 是由阿里云通义千问团队研发的新一代大型语言模型系列,它在多个方面实现了技术的飞跃和性能的显著提升。以下是对 Qwen2 的详细介绍:

GitHub - QwenLM/Qwen2: Qwen2 is the large language model series developed by Qwen team, Alibaba Cloud.

1. 模型概述

- 名称 :Qwen2

- 研发团队 :阿里云通义千问团队

- 类型 :大型语言模型

- 特点 :多版本、多规模,满足不同计算需求;全面支持 PAI 平台;整体性能代际飞跃

2.模型版本与规模

Qwen2 系列提供了多个不同规模的模型,以满足不同场景和计算资源的需求。具体包括:

- Qwen2-0.5B

- Qwen2-1.5B

- Qwen2-7B:Qwen2-7B-Instruct · 模型库 (modelscope.cn)

- Qwen2-57B-A14B(混合专家模型,MoE)

- Qwen2-72B

这些模型在参数数量上从数亿到数百亿不等,为用户提供了丰富的选择。

3.技术特点与优势

- 性能提升 :相比前代模型 Qwen1.5,Qwen2 在代码、数学、推理、指令遵循、多语言理解等多个方面实现了性能的显著提升。

- 多语言支持 :在原有的中文和英文基础上,Qwen2 新增了 27 种语言的高质量数据,使得模型在多语言处理上更加出色。

- 超长上下文处理 :特别是 Qwen2-72B-Instruct 模型,支持处理长达 128K tokens 的上下文,这在大型文档理解和复杂对话处理中尤为重要。

- GQA 机制 :所有尺寸的 Qwen2 模型都使用了 GQA(分组查询注意力)机制,以降低计算复杂度、提高计算效率,并带来推理加速和显存占用降低的优势。

- 技术架构 :Qwen2 采用了 Transformer 架构,并引入了 SwiGLU 激活函数、QKV bias、Mixture of SWA and Full Attention 等技术改进点,以提升模型的性能。

4. 应用场景

Qwen2 系列模型可以广泛应用于自然语言处理的多个领域,包括但不限于:

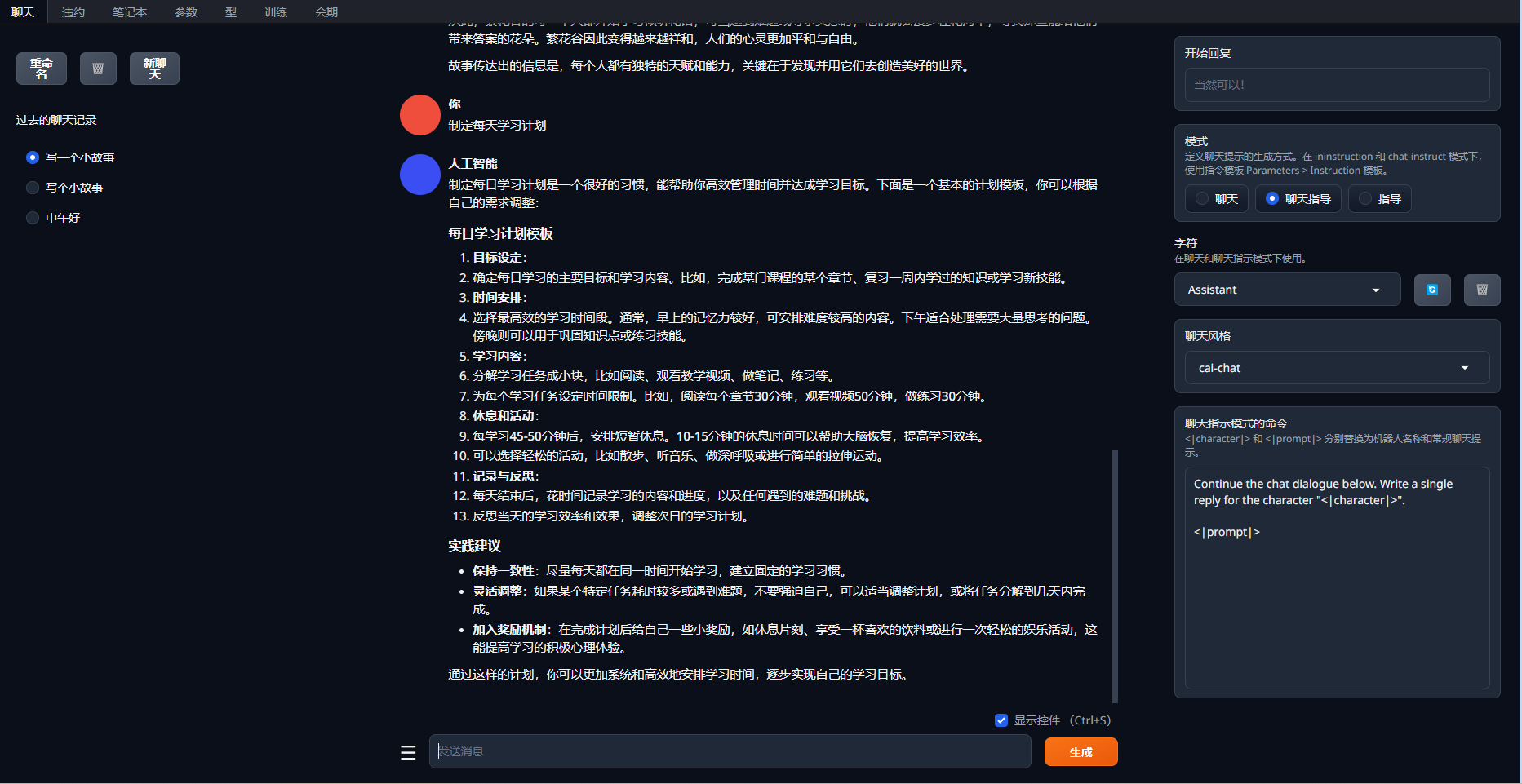

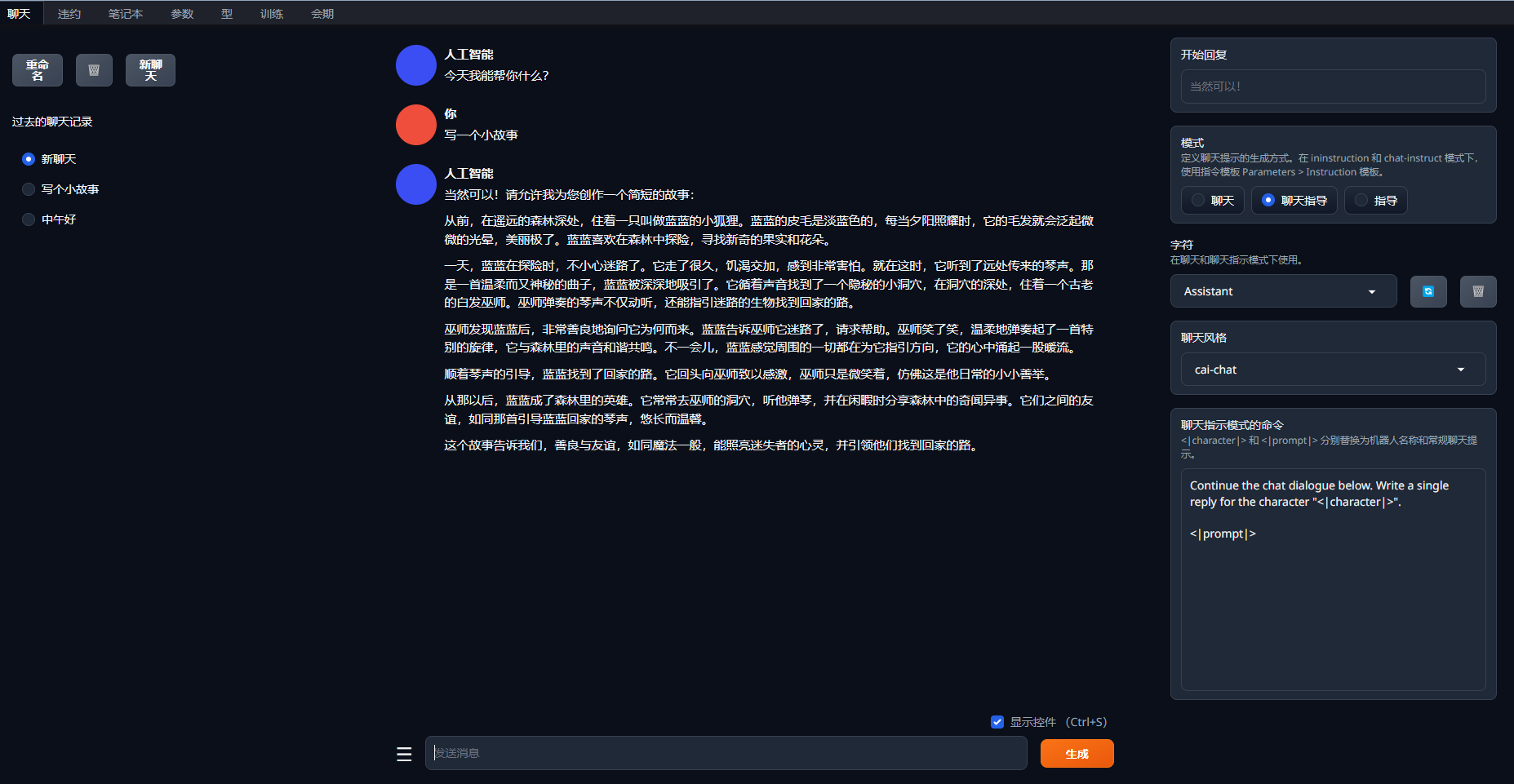

- 文本生成:如文章创作、摘要生成等。

- 问答系统:回答用户提出的各种问题。

- 对话系统:构建智能聊天机器人,与用户进行自然流畅的对话。

- 代码理解与编写:辅助程序员编写代码、理解代码逻辑等。

- 数学推理与问题解决:在数学、物理等领域提供解题思路和答案。

二、模型搭建流程

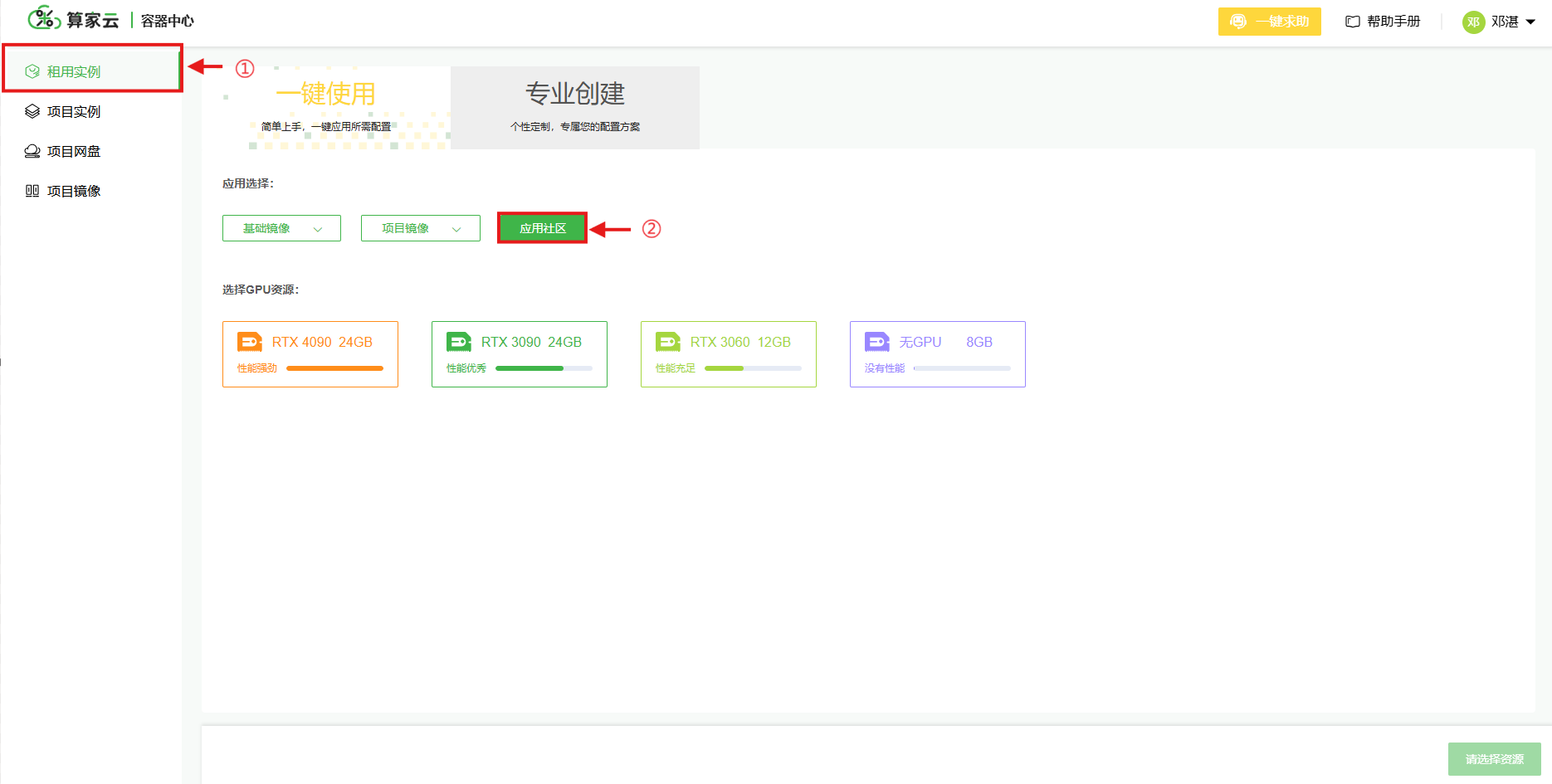

1. 选择主机和镜像

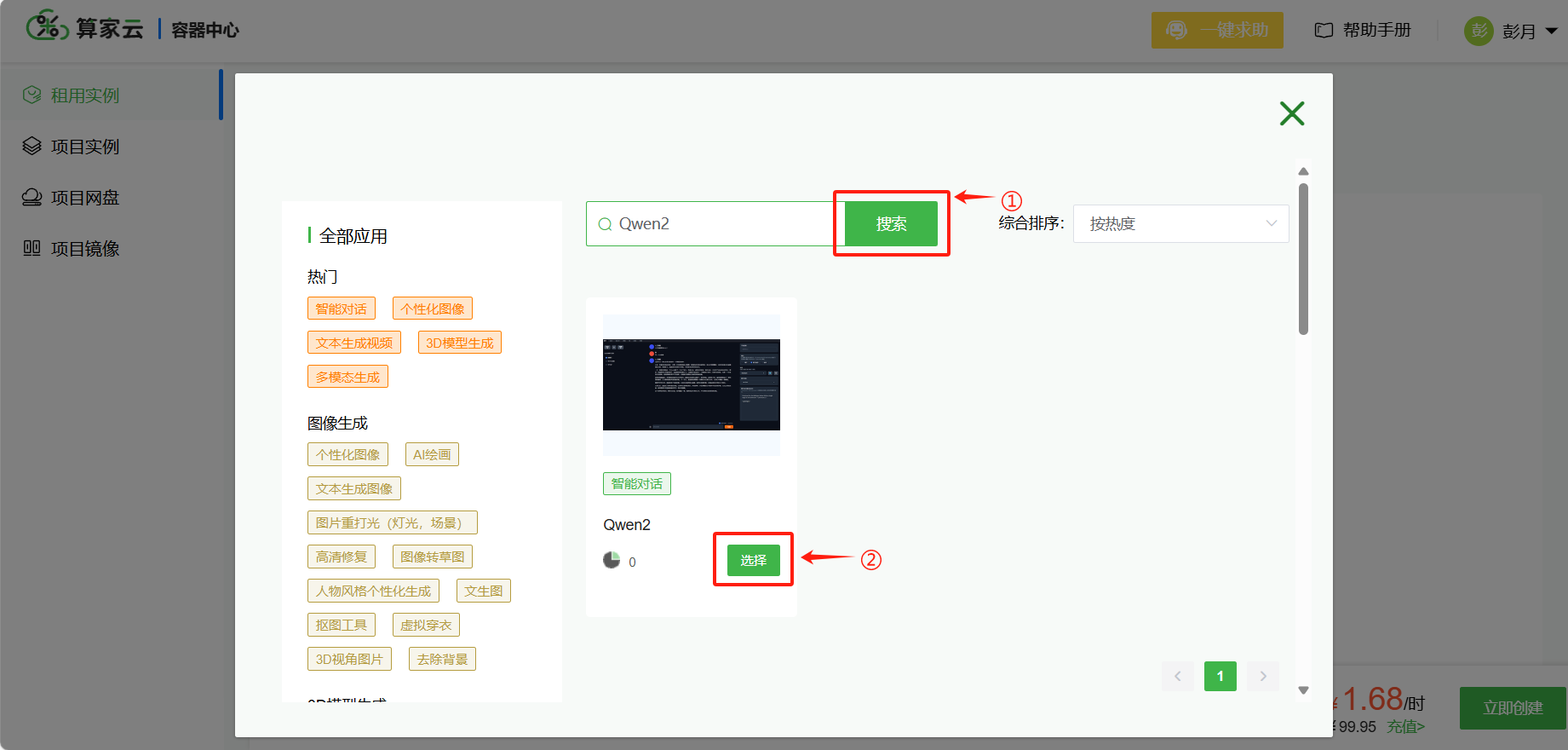

(1)在“租用实例”页面点击进入应用社区,搜索并选择Qwen2

(2)点击进入之后会自动选择模型,选择3090卡,点击“立即创建”即可创建实例

2.进入创建的实例

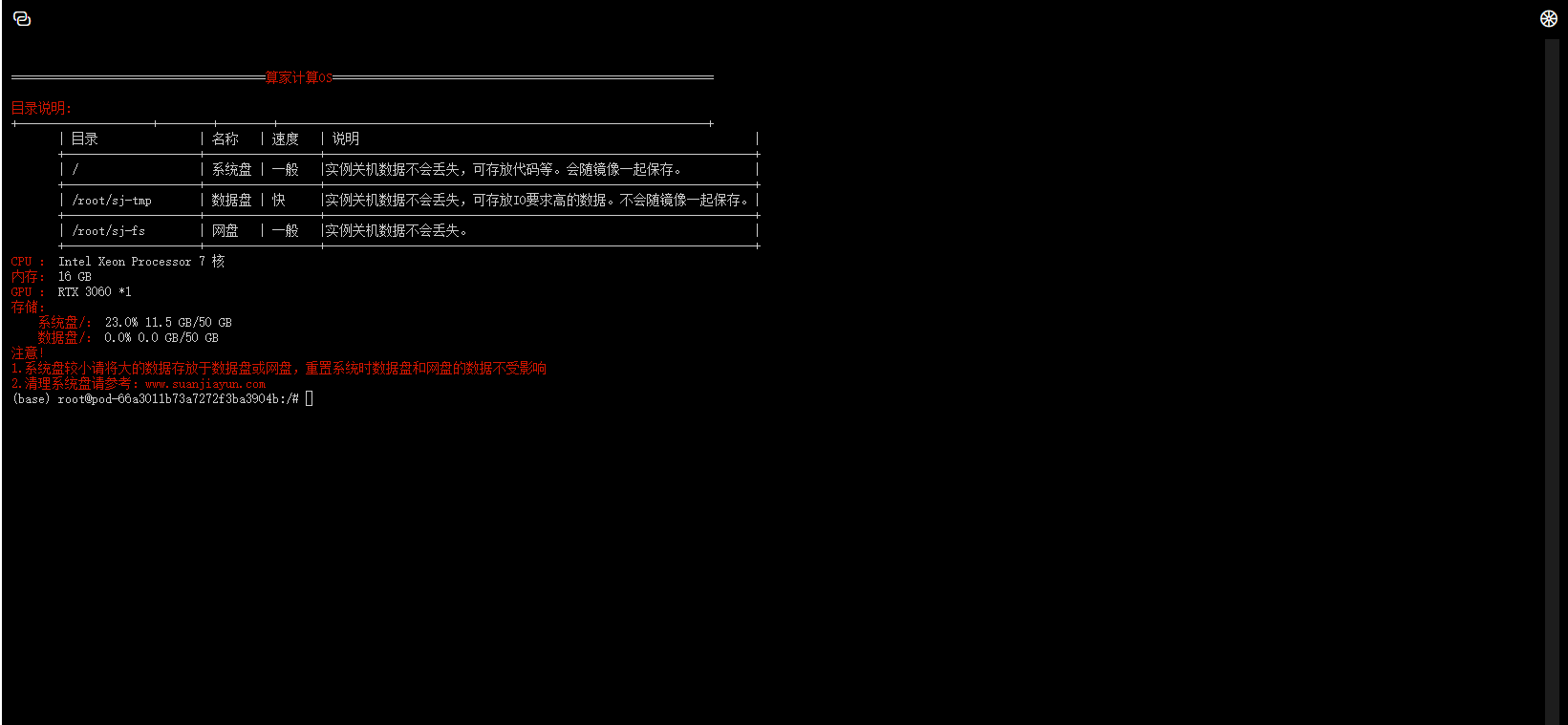

在“项目实例”页面点击对应实例的“Web SSH”操作,开启终端

以下命令均在该页面进行:

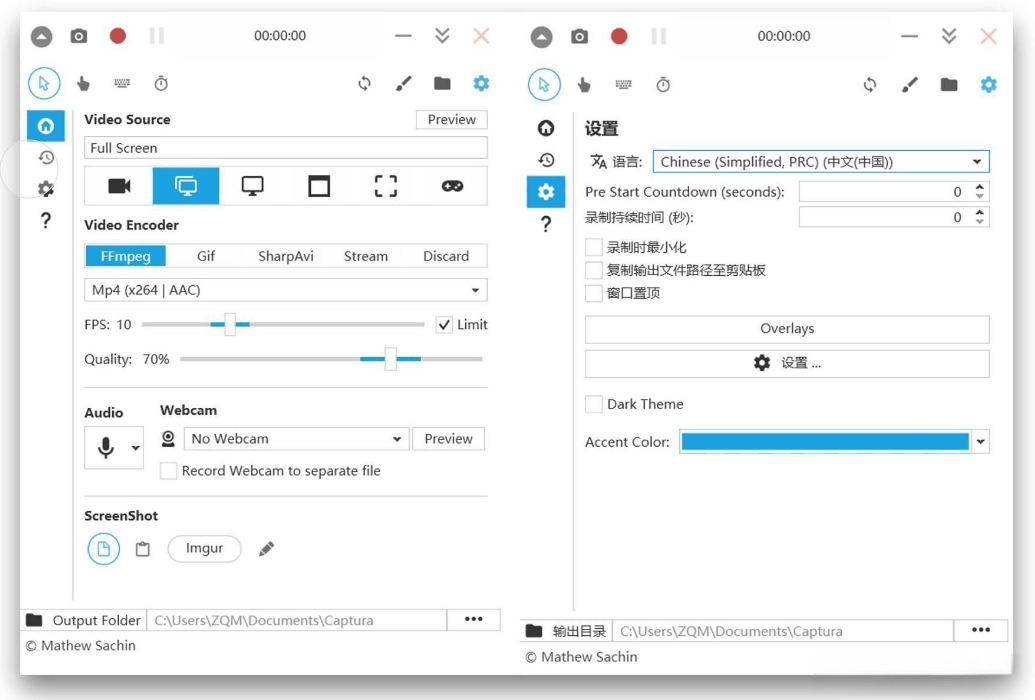

(1)项目配置

首先打开文件夹,激活虚拟环境:

cd text-generation-webui

conda activate Qwen2

指定端口,运行 server.py 文件:

python server.py --model Qwen2-7B-Instruct --listen --listen-port 8080

使用 RTX3060+12g 显卡出现显存不够情况

使用 RTX3090+24g 显卡,运行出现以下界面代表成功运行

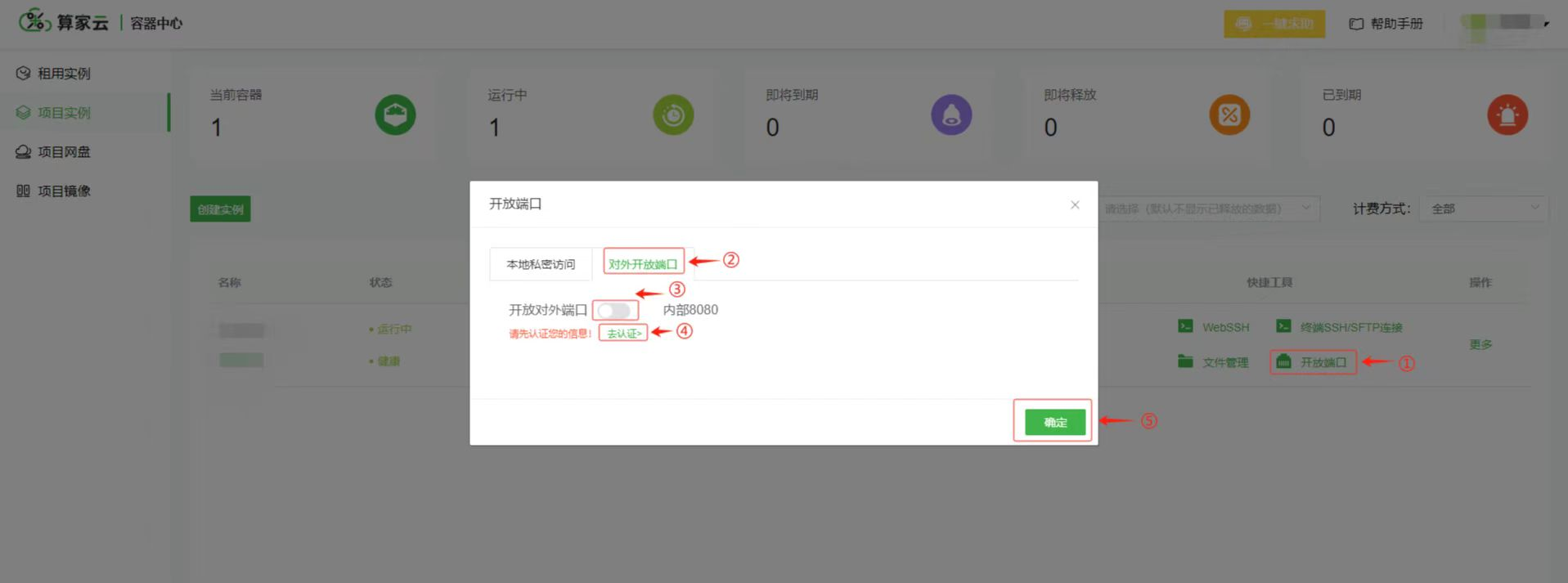

3.开启外部访问获取访问链接

返回“项目实例”列表,选择并点击对应实例的“开放端口”,然后按下图操作:

将复制的访问网址复制到新网页即可开始 ui 界面的使用

以上就是在算家云搭建Qwen2的流程,具体使用方式可进入算家云应用社区查看该模型的使用说明。

复制下方网址,进入算家云,选择模型,一键开启 AI 之旅!

算家云应用社区 www.suanjiayun.com/container/#/mirror

![ElementPlusError: [ElForm] unexpected width NaN 解决方法](https://i-blog.csdnimg.cn/direct/2b204d2337314bda8c15d763ba120482.png)

![python-第三方库-[yarl、yaml]](https://i-blog.csdnimg.cn/direct/4f784bc64bb74db2a7e8d36d19b2de33.png)