在人工智能的浩瀚宇宙中,两颗新星正在引发行业内的轰动。Meta 的 Llama-3.1-70B 和Mistral Large-2-128B,这两大 AI 巨头以其前所未有的计算能力和复杂性,正引领着智能算法的新浪潮。它们不仅仅是技术的集大成者,更是未来可能性的象征。随着我们探索它们的深邃与能力,我们站在了一个全新的起点上,准备揭开智能技术的下一个篇章。本文将带您深入了解这两个模型的细节,比较它们独特的特点和性能,为您展现一个即将到来的 AI 时代的全貌。

简介

在过去几天里,新模型如雨后春笋般涌现。首先是 OpenAI 推出的 GPT-4o mini 模型,然后是 Meta 发布的庞大的 405B 参数模型。现在,法国公司 Mistral 刚刚发布了其名为 Large 2 的新旗舰模型。

Meta 的 Llama 3.1 70B 和 Mistral Large 2 128B 代表了两个突出的大型语言模型,在人工智能领域取得了显著进展。这些模型对于需要高级自然语言理解和生成的任务至关重要,它们的开发标志着人工智能领域的显著进步。Meta 的 Llama 3.1 系列尤其因其开源性而受到广泛认可,使研究人员和开发者可以自由探索和修改这些模型,从而促进了人工智能研究中的创新和可访问性。相比之下,Mistral Large 2 128B 拥有 1280 亿个参数,旨在以高准确性处理复杂的语言任务,反映了人工智能领域向模型扩展以提升性能的更广泛趋势。

Meta 的 Llama 3.1 以其卓越的推理能力和扩展的 128K Token 上下文窗口而著称,非常适合构建能够在长时间交互中保持上下文的多语言会话代理。该模型的架构包括特定于模态的编码器和跨模型注意力模块,这些模块允许对多样数据类型进行连贯和统一的表示,显著提升其对异构数据的理解能力。此外,Meta 的开源倡议旨在民主化获取先进语言技术,促进该领域的协作进展。

另一方面,Mistral Large 2 128B 采用了混合专家模型架构(MoE),这使得处理大规模计算时能够实现可伸缩性和效率。这种架构允许模型动态选择每个输入的一部分专家,使计算更加高效,并减少网络任一部分的整体负载。与其稠密对应物相比,该模型在各种基准测试中表现出优越性能,显示出进一步扩展和提高准确性的潜力。然而,Mistral Large 2 128B 的开发时间表和具体增强措施文献记录较少,然其复杂架构和参数规模突显了其处理复杂任务能力。

这些模型的性能是通过各种基准测试评估的。Meta 的 Llama 3.1 70B 在 MMLU(大规模多任务语言理解)和 AGIEval(通用人工智能评价)基准测试中得分显著高,超过了几个竞争模型,并展示了其强大的语言处理能力。此外,它的多图像推理能力和思维链推理使其成为需要细致理解和生成文本的任务的强有力竞争者。Mistral Large 2 128B 也展示了显著的能力,特别是在使用多样数据集进行监督微调方面,增强了在需要多图像推理和少样本思维链推理的任务中的表现。

尽管它们各有优势,但这两种模型都存在局限性。Meta 的 Llama 3.1 70B 在推理和语言任务方面表现出色,但在需要高精度视觉理解的任务中可能不那么可靠。Mistral Large 2 128B 虽然具有高度可扩展性和效率,但在部署高精度场景中面临挑战,特别是在复杂决策任务中,人类的表现仍然更加优越。这些因素突显了在大型语言模型的开发中持续需要创新和精炼,以解决它们各自的弱点并增强它们的实际应用。

发展历史

Meta 的 Llama 3.1 和 Mistral Large 2 128B 的开发代表了大语言模型领域的重大进展,每个模型都为人工智能领域的景观带来了独特的进步和贡献。

Llama 3.1

Meta 的 Llama 3.1 于 2024 年 7 月 23 日正式推出,被誉为开源人工智能领域的突破性模型。在这次发布中最值得注意的模型之一是 Llama 3.1 405B,它具备了改进的推理能力和广泛的 128K Token 上下文,为语言技术设立了新的基准。该模型的推出标志着一个关键时刻,因为它是开源的,供研究人员和开发者自由探索和修改。这种开放性预计将加速人工智能研究的创新和可访问性。

Llama 3.1 旨在与顶级闭源模型竞争,提供能与专有模型匹敌的功能。这一举措旨在实现对先进语言技术的民主化访问,促进更广泛的社区参与,并推动该领域的协作进展。

Mistral Large 2 128B

尽管 Mistral Large 2 128B 的具体开发时间轴较少有详细记录,但该模型以其庞大的参数规模和复杂的架构而闻名,设计用于处理复杂的语言任务。Mistral Large 2 128B 集成了高达 1280 亿个参数,显著增强了其在各种语境下理解和生成类人文本的能力。Mistral 强调将模型扩展到更高的性能指标,以提升自然语言理解和生成的能力。Mistral Large 2 128B 的开发反映了人工智能研究朝着创建更强大、更多功能、更高精度和效率的模型的广泛趋势。

核心特性

视觉骨干冻结

先进的机器学习模型(例如 MiniGPT-v2)的一个显著特点是,在训练过程中,视觉骨干部分被冻结。这意味着模型的视觉编码器保持不变,并且不会随着模型从数据集中学习而更新,从而使模型能够专注于优化其语言理解能力。

线性投影层

MiniGPT-v2 中的线性投影层在使模型能够高效处理高质量图像方面发挥了关键作用。随着图像分辨率的提高,视觉标记的数量显著增加。处理大量标记可能会消耗大量计算资源。为了解决这个问题,MiniGPT-v2 使用线性投影层在嵌入空间中连接多个相邻的视觉标记,将它们投影为单个实体,进入与大型语言模型相同的特征空间。这种方法在管理计算成本的同时增强了模型的精度和效果。

多模态架构

多模态集成各种类型的数据,如图像、文本和视频,以生成更强大的输出。这些模型包括一个编码器,将来自不同模态的原始数据映射为特征向量,一个融合策略来整合数据模态,以及一个解码器来处理合并的嵌入以生成相关的输出。主流的融合机制包括基于注意力的方法、串联和点积技术。多模态的应用案例包括视觉问答(VQA)、图像到文本和文本到图像搜索、生成式人工智能以及图像分割任务。

Meta-Transformer 框架

在 Meta-Transformer 框架中,任务特定的头部在处理来自统一特征编码器的学习表示时发挥着重要作用。这些任务特定的头部本质上是多层感知器(MLPs),处理特定任务和不同的模态,为各种应用定制模型的输出。在编码器的整个过程中,每个层之前都应用层归一化(LN),并且在每个层之后使用残差连接,这有助于特征编码过程的稳定性和效率。

可访问性和可用性

最新的模型如 Meta Llama 3.1 在可访问性和可用性方面有重大进展。Llama 3.1 支持多种语言和扩展的上下文窗口,非常适合构建能处理复杂互动并在长时间对话中保持上下文的多语言对话代理。Meta 提供的全面生态系统支持各种开发工作流程,从实时推理到监督微调,使开发人员能更轻松地在各种应用中实现 Llama 3.1 的部署。

模型架构

Meta 的 Llama 3.1 70B 和 Mistral Large 2 128B 的架构展示了处理大规模语言模型的独特方法,每个都利用先进技术来增强性能和可扩展性。

Llama 3.1 70B

Meta 的 Llama 3.1 70B 架构集成了多个创新组件,旨在处理多种模态并提高模型效率。Llama 3.1 的核心特性包括模态特定编码器、跨模型注意模块和统一的联合嵌入空间。无论是文本、图像还是其他形式都有专用编码器,通过模态特定的线性投影头将输入数据转换为固定维度的嵌入。

跨模型注意力模块在促进不同模态之间的交互中发挥关键作用。通过使模型能够集中于数据的相关部分,该模块增强了模型生成准确和上下文感知输出的能力。联合嵌入空间将所有模态特定的嵌入集成在一起,实现了多样数据类型的一致和统一表示。这种架构不仅增强了模型对异构数据的理解,还有助于提供更精确的预测和结果。

此外,Meta 的模型包括一个复杂的监督微调(SFT)策略,利用多样的数据集,如指令-响应对和视觉语言数据集。这种微调帮助模型保持多图像推理能力,并增强其在包括 VQAv2 和 ScienceQA 在内的各种基准测试中的性能。

Mistral Large 2 128B

该模型采用两个版本:3B-MoE,包含 64 位专家,以及 7B-MoE,包含 32 位专家,两者均采用顶级 2 门控和路由器 z 损失项以确保训练稳定性。MoE 架构允许模型动态选择每个输入的专家子集,使计算更高效,减少网络任何单一部分的总负载。

MoE 模型在各种基准测试中表现出比它们的密集对应物更优越的性能,显示出进一步扩展和提高准确性的潜力。该架构还通过在预训练模型之上进行监督微调,利用多样化数据集,获益良多。在 Mistral Large 2 128B 中,SFT 过程利用指令-响应对和视觉-语言数据集增强模型的能力,特别是在需要多图推理和少样本思维链推理的任务中。

性能指标和基准

大型语言模型(如 Meta 的 Llama 3.1 70B 和 Mistral Large 2 128B)的评估,主要依赖于设计用来捕捉模型能力各方面特征的性能指标和基准测试,包括事实知识、推理和语言理解。

MMLU 基准测试

MMLU(Massive Multitask Language Understanding)基准评估模型理解和回答各种事实和常识问题的能力。Llama 3.1 70B 展示出卓越的性能,得分为 79.5,超过了发布的 Gemini Pro 1.0(71.8)和测量的 Mistral 8x22B(77.7)模型。这些分数表明 Llama 3.1 能够强大地访问和处理信息,通过搜索引擎结果实现了广泛的训练数据集和现实世界数据的整合。

AGIEval 基准测试

AGIEval 基准测试衡量了在各种英语任务中的表现,包括问答、摘要和情感分析。在 3-shot 设置下,Llama 3.1 70B 的得分为 63.0,高于测得的 Mistral 8x22B 的 61.2,表明 Llama 3.1 具有优越的语言处理能力。

这些结果表明,Llama 3.1 在需要细致理解和生成文本的任务中表现出色。

优势和劣势

优势

Llama 3.1 70B

Meta 的 Llama 3.1 70B 模型在多个关键领域展示了显著的进展,这些进展对于研究和实际应用都具有重要意义。该模型在推理和获取新技能方面的能力可通过其在 ARC 和 DROP 等基准测试上的出色表现得到体现。在评估技能获取能力的 ARC 基准测试中,70B 模型取得了显著的 93.0 分,高于 Mistral 8x22B 模型的 90.7 分。

此外,Meta Llama 3.1 70B 拥有一个大的 128K 标记上下文窗口,特别适用于需要深入上下文理解的应用程序。这种模型的开源性质使研究人员和开发者能够进行实验和创新,可能加速自然语言处理(NLP)和机器翻译的进展。

Mistral Large 2 128B

Mistral Large 2 128B 通过集成强大的数据探索和可视化功能,该模型允许通过交互式嵌入和先进的质量指标更深入地理解数据。该模型的性能进一步增强,因其能够处理不同类型的标签,如边界框、多边形、折线、位掩码和关键点标签,使其在各种计算机视觉项目中具有高度的多功能性。

此外,Mistral Large 2 128B 在模型评估和故障模式检测方面表现出色,确保模型在数据景观演变时仍然保持适应性和准确性。在动态环境中保持高性能,这种适应性至关重要。

劣势

Llama 3.1 70B

一个显著的劣势是在某些任务(如对象检测和准确回答关于图像的问题)的表现。这些限制表明,虽然该模型在推理和语言任务方面表现出色,但在需要高精度视觉理解的任务中可能不太可靠。此外,运行这样一个大型模型所需的复杂性和资源要求可能成为一些组织的障碍,尽管它是开源的,但可能限制了其可访问性。

Mistral Large 2 128B

Mistral Large 2 128B 模型也面临挑战,特别是在需要高精度和关键决策的场景部署方面。虽然显示出在遵循指令和执行各种环境下的动作方面具有潜力,但与人类表现相比仍然不够可靠。这种不一致性在需要高级问题解决和战略规划的任务中尤为突出,带来了重大挑战。此外,由于缺乏直接环境状态访问,评估过程变得复杂,难以确定 AI 是否成功理解并在复杂情境中执行了给定任务。

结语

我们见证了 Meta 的 Llama 和 Mistral 的比较,它们的对决不仅映射出技术的进步,还折射出未来的潜力。在这次深度对比之旅的尾声,我们得以领悟到,无论是在语言理解的深度,或是在模型效率的优化上,每一次的技术迭代都是对人类智慧的挑战和致敬。我们对知识的探索从未结束,正如这两个模型所展现的,未来的路还很长,但每一步都值得期待。让我们拭目以待,因为 AI 的明天,定将比今天更加绚烂多彩。

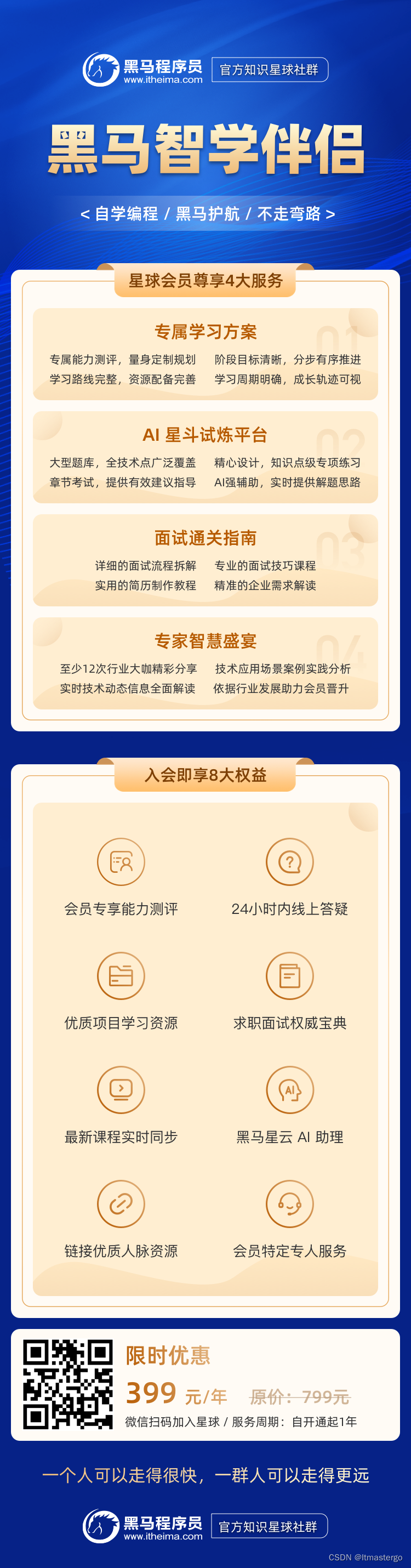

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓