文章目录

- hadoop集成spark(spark on yarn)

- 下载spark软件包

- spark文件设置

- spark-env.sh

- workers

- 环境变量设置

- 发送spark到其余机器

- 启动spark

hadoop集成spark(spark on yarn)

在hadoop搭建完成的前提下,集成spark:hadoop搭建请参考hadoop集群搭建

下载spark软件包

有很多种类spark的包,因为我是要集成到hadoop里面所以我选择spark-3.4.3-bin-hadoop3-scala2.13.tgz (集成hadoop自带scala)

# 在master节点下载

wget https://downloads.apache.org/spark/spark-3.4.3/spark-3.4.3-bin-hadoop3-scala2.13.tgz

# 解压

tar -zxvf spark-3.4.3-bin-hadoop3-scala2.13.tgz

# 重命名 (原始包名太长了)

mv spark-3.4.3-bin-hadoop3-scala2.13 spark

spark文件设置

#spark配置文件的路径

cd /home/ldsx/down_load/spark_data/spark/conf

spark-env.sh

配置spark自用环境变量

可以自己创建也可以copy,因为template就是空的

cp spark-env.sh.template spark-env.sh

vim spark-env.sh

#添加一下内容 换成自己的部署的实际信息即可

export JAVA_HOME=/home/ldsx/down_load/jdk_data_new/jdk1.8.0_411

export SPARK_MASTER_IP=192.168.0.76

export HADOOP_HOME=/home/ldsx/down_load/hadoop_data/hadoop-3.2.4

export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

workers

低版本叫slaves,高版本为workers

配置工作机器

cp workers.template workers

vim workers

# 添加需要作为spark计算的机器

master

hadoop01

环境变量设置

sudo vim /etc/profile.d/my_env.sh

#配置spark路径方便使用

#spark_home

export SPARK_HOME=/home/ldsx/down_load/spark_data/spark

export PATH=$PATH:$SPARK_HOME/bin

source /etc/profile.d/my_env.sh

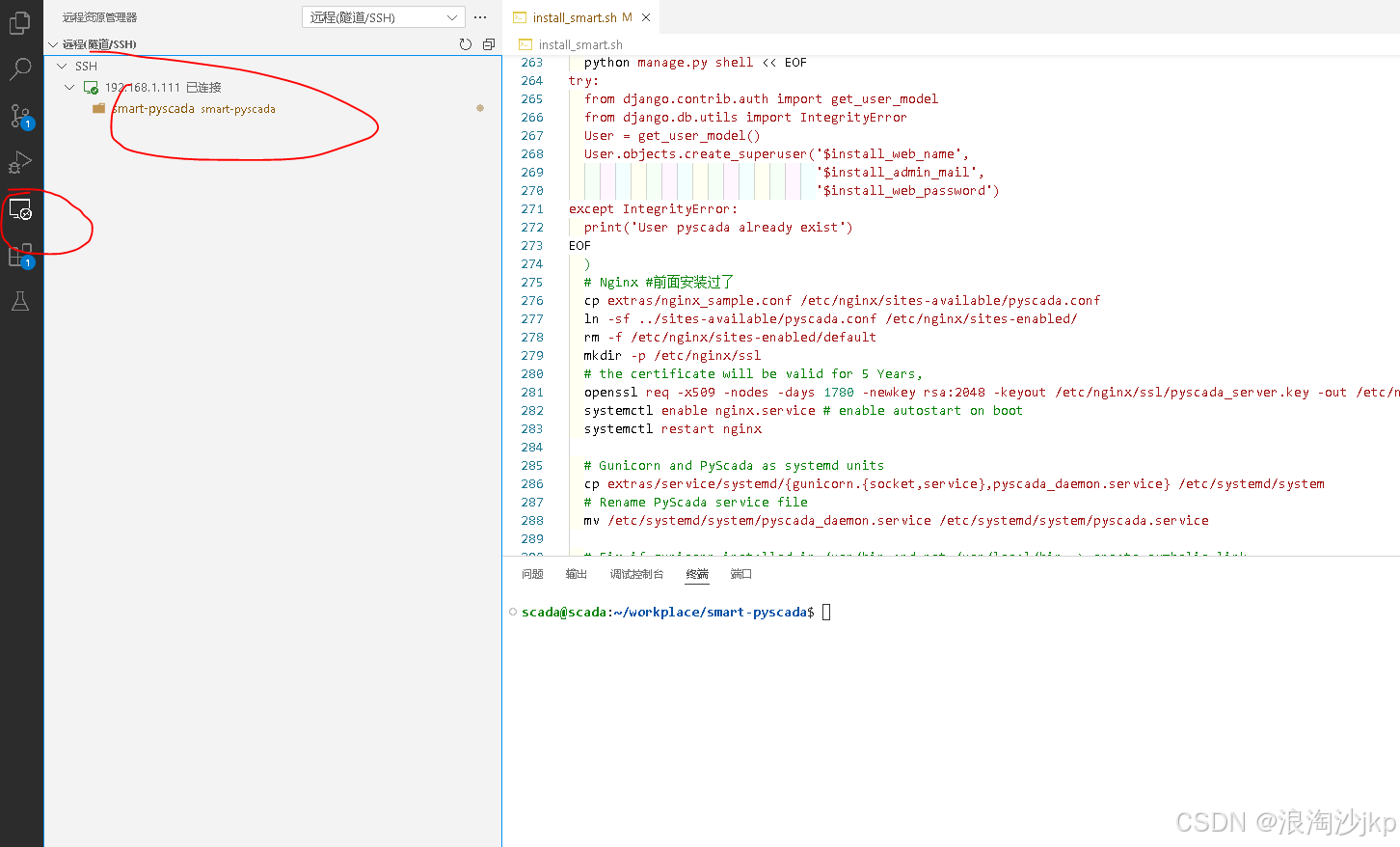

发送spark到其余机器

#因为做了免密直接传送

scp -r spark包 节点机器:相同路径

#我的matser 跟节点的目录结构都是完全一致的

scp -r spark_data hadoop01:/home/ldsx/down_load

启动spark

#因为hadoop里面也有start-all.sh,防止冲突直接进入spark目录下启动

cd /home/ldsx/down_load/spark_data/spark/sbin

./start-all.sh

8080:master默认Web端口

7077:master通信端口

master下进程,因为master配置成了worker机所以会同时存在Master,Worker进程

使用spark-submit启动一个test.py的任务后查看yarn与spark的UI

yarn界面

spark界面