ChatGPT API 按 token 数量收费,那么1个token究竟是多少?

按Openai 的估算,1 token ~= 3/4 words,100个token大约是75个单词。

输入的文本是如何被分解为 token 的呢?在大语言模型处理文本时,分词(Tokenization)是最基础又相对独立的一个环节,在整个流程中非常重要,但又经常容易被忽略。今天我们就一起来梳理分词(Tokenization)相关的知识。

简介

什么是分词(Tokenization)?

分词(Tokenization)是为了将自然语言转换为计算机可以理解的数值形式。分词的过程是将文本分解为更小单元的过程,这些更小的单元通常被称为 token。这些token可以是单词、子词或者字符,具体取决于所选用的分词方法。这些token将会进一步被转换为数字ID,再转换为向量,从而成为计算机可以理解的输入形式。

分词粒度

分词(Tokenization)有三种主要的粒度:

- 词级别(Word-Based Tokenization):这是最自然的语言单元,对于像英文这样的语言,单词之间天然存在空格分隔,因此切分相对容易。但会造成词表过大,也一定会存在超出词汇表的词(OOV),而且还不能学到词根或词缀的关系。

- 字符级别(Character-Based Tokenization):这是最细粒度的tokenize方法,将文本切分为单个字符。这种方法在处理某些语言或任务时可能很有用,尤其是当文本中包含很多未知词或拼写错误时。然而,字符级别的tokenize会丢失一些词或短语级别的语义信息。

- 子词级别(Subword-Based Tokenization):这种方法介于词和字符之间,旨在解决词级别tokenize可能遇到的问题,如超出词汇表的词(OOV)问题和词表过大问题。子词方法可以将一个词进一步切分为更小的有意义的单元,如词缀或词根。这也是目前最主流的分词粒度。

Subword 分词方法

常见的 subword 分词方法大致可分为以下两类:

-

基于规则的分词方法:比如python中的NLTK、spaCy等等,通常是依赖于预定义的规则和模式来识别分词的边界。

>>> from nltk.tokenize import word_tokenize >>> >>> text = "Don't you love eating apples?" >>> word_tokens = word_tokenize(text) >>> print(word_tokens) ['Do', "n't", 'you', 'love', 'eating', 'apples', '?'] >>> -

基于预训练模型的分词方法:比如python中的transformer,可以加载不同的预训练模型,这些模型已经在大量文本上进行了训练,学习了单词的上下文表示。

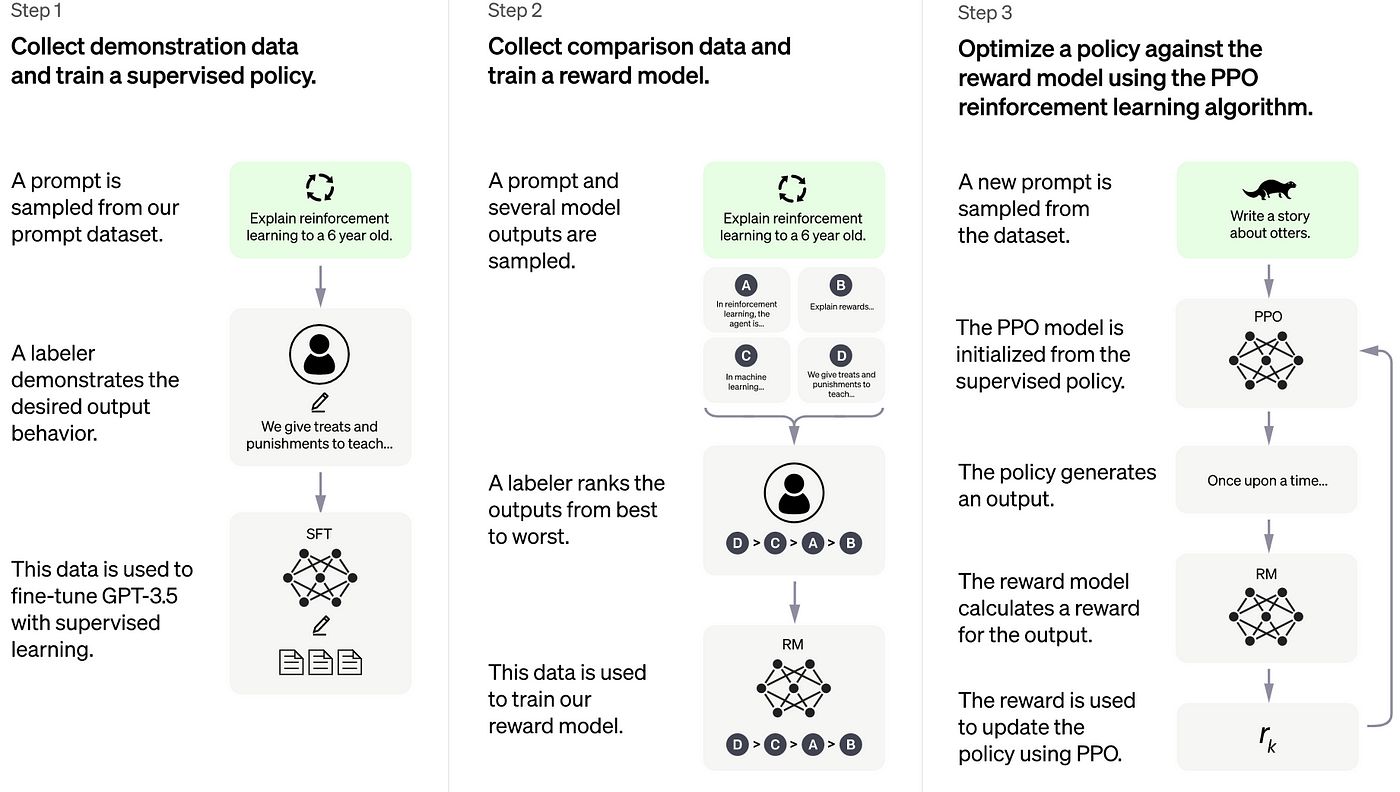

>>> from transformers import AutoTokenizer >>> >>> tokenizer = AutoTokenizer.from_pretrained("lmsys/vicuna-7b-v1.5") >>> >>> text = "Don't you love eating apples?" >>> tokenizer.tokenize(text) ['▁Don', "'", 't', '▁you', '▁love', '▁e', 'ating', '▁app', 'les', '?'] >>>在目前主流的大语言预训练模型中,常见的 subword 分词算法有三种:

- BPE(Byte Pair Encoding):BPE是一种基于频率的子词分词算法,它从字符级别的分词开始,通过不断合并常见的相邻字符来生成新的子词。这个过程持续进行,直到达到预定的词表大小。

- WordPiece:WordPiece也是通过合并子词来构建词表,但WordPiece不是基于频率,而是基于能够最大化语言模型概率的相邻子词对。

- Unigram:Unigram采用一种减量式的分词方法,首先构建一个非常大的初始词表,然后根据评估规则,不断从词表中移除子词,直到满足预定的词表大小。

Transformers AutoTokenizer

分词 tokenize

>>> from transformers import AutoTokenizer

>>>

>>> tokenizer = AutoTokenizer.from_pretrained("lmsys/vicuna-7b-v1.5")

>>>

>>> text = "Don't you love eating apples?"

>>> tokenizer.tokenize(text)

['▁Don', "'", 't', '▁you', '▁love', '▁e', 'ating', '▁app', 'les', '?']

>>>

>>> text = "He is eating an apple."

>>> tokenizer.tokenize(text)

['▁He', '▁is', '▁e', 'ating', '▁an', '▁apple', '.']

>>>

编码 encode

可以使用 tokenizer.encode 直接将文本转换为词表中的token ID列表(带cls 和sep,带truncation,带padding):

>>> text = "Don't you love eating apples?"

>>> tokenizer.encode(text)

[1, 3872, 29915, 29873, 366, 5360, 321, 1218, 623, 793, 29973]

>>>

也可以分两步,tokenize和convert_tokens_to_ids,将文本转换为词表中的token ID列表(不带cls 和 sep):

>>> text = "Don't you love eating apples?"

>>> tokens = tokenizer.tokenize(text)

>>> print(tokens)

['▁Don', "'", 't', '▁you', '▁love', '▁e', 'ating', '▁app', 'les', '?']

>>> ids = tokenizer.convert_tokens_to_ids(tokens)

>>> print(ids)

[3872, 29915, 29873, 366, 5360, 321, 1218, 623, 793, 29973]

>>>

解码 decode

大语言模型在完成推理后,输出的是词表中的token ID,可以使用 decode 将其解码成文本。

>>> text = "Don't you love eating apples?"

>>> tokens = tokenizer.tokenize(text)

>>> print(tokens)

['▁Don', "'", 't', '▁you', '▁love', '▁e', 'ating', '▁app', 'les', '?']

>>> ids = tokenizer.convert_tokens_to_ids(tokens)

>>> print(ids)

[3872, 29915, 29873, 366, 5360, 321, 1218, 623, 793, 29973]

>>> decoded_text = tokenizer.decode(ids)

>>> print(decoded_text)

Don't you love eating apples?

>>>

类似的,也可以用 convert_ids_to_tokens 和 convert_tokens_to_string 两步来实现

>>> text = "Don't you love eating apples?"

>>> tokens = tokenizer.tokenize(text)

>>> print(tokens)

['▁Don', "'", 't', '▁you', '▁love', '▁e', 'ating', '▁app', 'les', '?']

>>> ids = tokenizer.convert_tokens_to_ids(tokens)

>>> print(ids)

[3872, 29915, 29873, 366, 5360, 321, 1218, 623, 793, 29973]

>>> output_tokens = tokenizer.convert_ids_to_tokens(ids)

>>> print(output_tokens)

['▁Don', "'", 't', '▁you', '▁love', '▁e', 'ating', '▁app', 'les', '?']

>>> decoded_text = tokenizer.convert_tokens_to_string(output_tokens)

>>> print(decoded_text)

Don't you love eating apples?

>>>

词表是啥样?

>>> from transformers import AutoTokenizer

>>>

>>> tokenizer = AutoTokenizer.from_pretrained("lmsys/vicuna-7b-v1.5")

>>> list(tokenizer.vocab.items())[:5]

[('▁програм', 20796), ('prüng', 21563), ('▁Level', 21597), ('adu', 13467), ('▁prob', 2070)]

在前文的“编码 encode”步骤中,可以看到 ▁Don 被编码为 3872,t被编码为29873,现在可以在词表中验证一下:

>>> tokenizer.vocab['▁Don']

3872

>>> tokenizer.vocab['t']

29873

>>>

词表有多大?

>>> len(tokenizer.vocab)

32000

>>>

小羊驼(Vicuna)

config.json

小羊驼(Vicuna)的 config.json 如下

{

"_name_or_path": "vicuna-7b-v1.5",

"architectures": [

"LlamaForCausalLM"

],

"bos_token_id": 1,

"eos_token_id": 2,

"hidden_act": "silu",

"hidden_size": 4096,

"initializer_range": 0.02,

"intermediate_size": 11008,

"max_position_embeddings": 4096,

"model_type": "llama",

"num_attention_heads": 32,

"num_hidden_layers": 32,

"num_key_value_heads": 32,

"pad_token_id": 0,

"pretraining_tp": 1,

"rms_norm_eps": 1e-05,

"rope_scaling": null,

"tie_word_embeddings": false,

"torch_dtype": "float16",

"transformers_version": "4.31.0",

"use_cache": true,

"vocab_size": 32000

}

从中也可以印证词汇表的大小是32000。

tokenizer_config.json

小羊驼(Vicuna)的 tokenizer_config.json如下

{

"add_bos_token": true,

"add_eos_token": false,

"bos_token": {

"__type": "AddedToken",

"content": "<s>",

"lstrip": false,

"normalized": false,

"rstrip": false,

"single_word": false

},

"clean_up_tokenization_spaces": false,

"eos_token": {

"__type": "AddedToken",

"content": "</s>",

"lstrip": false,

"normalized": false,

"rstrip": false,

"single_word": false

},

"legacy": false,

"model_max_length": 4096,

"pad_token": null,

"padding_side": "right",

"sp_model_kwargs": {},

"tokenizer_class": "LlamaTokenizer",

"unk_token": {

"__type": "AddedToken",

"content": "<unk>",

"lstrip": false,

"normalized": false,

"rstrip": false,

"single_word": false

}

}

从以上“vicuna-7b-v1.5/tokenizer_config.json”中可以看到,最大支持4096个token,分词类使用的是LlamaTokenizer,开始符定义为“<s>”,结束符定义为“</s>”,超出词汇表的定义为“<unk>”。

在前文的“编码 encode”中使用 tokenizer.encode 时,会添加开始符,就是在最前端添加“<s>”,验证如下:

>>> text = "Don't you love eating apples?"

>>> tokenizer.encode(text)

[1, 3872, 29915, 29873, 366, 5360, 321, 1218, 623, 793, 29973]

>>>

>>> tokenizer.vocab['<s>']

1

>>> tokenizer.vocab['</s>']

2

>>> tokenizer.vocab['<unk>']

0

大模型&AI产品经理如何学习

求大家的点赞和收藏,我花2万买的大模型学习资料免费共享给你们,来看看有哪些东西。

1.学习路线图

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

2.视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己整理的大模型视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

(都打包成一块的了,不能一一展开,总共300多集)

因篇幅有限,仅展示部分资料,需要点击下方图片前往获取

3.技术文档和电子书

这里主要整理了大模型相关PDF书籍、行业报告、文档,有几百本,都是目前行业最新的。

4.LLM面试题和面经合集

这里主要整理了行业目前最新的大模型面试题和各种大厂offer面经合集。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓