简介

Function Calling 是一种让 Chat Completion 模型调用外部函数的能力,可以让模型不仅仅根据自身的数据库知识进行回答,而是可以额外挂载一个函数库,然后根据用户提问去函数库检索,按照实际需求调用外部函数并获取函数运行结果,再基于函数运行结果进行回答,或者是通过函数调用来调用工具。

Qwen 官方给出的 Function Calling 方法是基于 openai 接口的,这篇文章就从如何利用 Qwen 仿 OpenAI 接口开始写起。

OpenAI_API

在 Qwen 官方给出的代码中有一个 openai_api.py 脚本,可以在 _get_args() 函数中对参数进行配置后运行 (主要需要修改模型路径)。

def _get_args():

parser = ArgumentParser()

parser.add_argument(

"-c",

"--checkpoint-path",

type=str,

default="qwen/Qwen-1_8B-Chat",

help="Checkpoint name or path, default to %(default)r",

)

parser.add_argument(

"--api-auth", help="API authentication credentials"

)

parser.add_argument(

"--cpu-only", action="store_true", help="Run demo with CPU only"

)

parser.add_argument(

"--server-port", type=int, default=8000, help="Demo server port."

)

parser.add_argument(

"--server-name",

type=str,

default="0.0.0.0",

help="Demo server name. Default: 127.0.0.1, which is only visible from the local computer."

" If you want other computers to access your server, use 0.0.0.0 instead.",

)

parser.add_argument("--disable-gc", action="store_true",

help="Disable GC after each response generated.")

args = parser.parse_args()

return args

修改完成后运行:

python openai_api.py

接着可以运行以下代码以调用接口进行对话:

import openai

import json

openai.api_base = 'http://localhost:8000/v1'

openai.api_key = 'none'

def call_qwen(messages):

response = openai.ChatCompletion.create(model='Qwen', messages=messages)

response = response.choices[0]['message']

response = json.loads(json.dumps(response, ensure_ascii=False))

print('input:', messages)

print('output:', response)

return response

if __name__ == '__main__':

messages = [{'role': 'user', 'content': '你好'}]

response = call_qwen(messages)

Function Calling

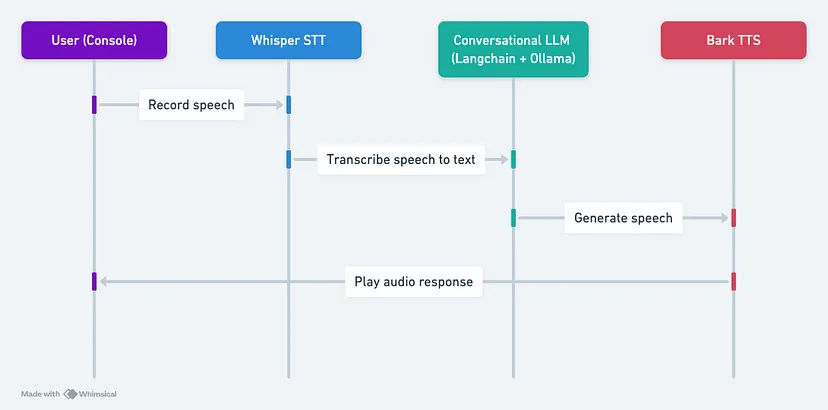

首先介绍一下 Function Calling 的具体流程。

- 使用用户查询和函数参数中定义的一组外部函数库。

- 模型可以选择调用任意外部函数;如果是这样,内容将是符合自定义架构的字符串化 JSON 对象(注意:模型可能会生成无效的 JSON 或幻觉参数)。

- 在代码中将字符串解析为 JSON,并使用提供的参数调用函数(如果存在)。

- 通过将函数响应追加为新消息来再次调用模型,并让模型将结果汇总返回给用户。

外部函数库

首先我们需要定义一个外部函数库,这个函数库是一个列表,可以添加多个函数,列表中每个函数都为 json 格式,每个函数格式固定,以下是一个关于控制开关灯光的函数例子。

functions = [

{

"name_for_human": "灯光控制",

"name_for_model": "contral",

"description_for_model": "灯光控制可以帮助用户开关灯"

+ " Format the arguments as a JSON object.",

"parameters": [

{

"name": "switch",

"description": "用于控制灯的开关,若为True则为开灯,若为false则为关灯",

"required": True,

"schema": {"type": "bool"},

}

],

}

]

# 各参数作用

# "name_for_human":函数名字(对人类)

# "name_for_model":函数名字(对模型)

# "description_for_model":描述函数的作用,让模型能够判断什么时候调用这个函数

# "parameters":返回结果中的参数,该键对应的值为一个列表,可以返回多个参数

# "name":参数的名字

# "description":参数的描述,用于让模型判断这个参数填入什么

# "required":这个参数是否是必要的

# "schema":可以指定这个参数的数据类型

调用函数库方式如下,这里创建了一个 contral 函数假装调用了接口来进行开关灯操作:

import openai

import json

openai.api_base = "http://localhost:8006/v1"

openai.api_key = "none"

def contral(response):

if response.choices[0].message.function_call:

result = eval(response.choices[0].message.function_call.arguments)

switch = "开灯" if result["switch"] else "关灯"

print(switch)

def call_qwen(messages, functions=None):

print(messages)

if functions:

response = openai.ChatCompletion.create(

model="Qwen", messages=messages, functions=functions

)

else:

response = openai.ChatCompletion.create(model="Qwen", messages=messages)

print(response)

result = response.choices[0].message.function_call

if result:

if result.name == "contral":

contral(response)

print(response.choices[0].message.content)

return response

if __name__ == "__main__:

functions = [

{

"name_for_human": "灯光控制",

"name_for_model": "contral",

"description_for_model": "灯光控制可以帮助用户开关灯"

+ " Format the arguments as a JSON object.",

"parameters": [

{

"name": "switch",

"description": "用于控制灯的开关,若为True则为开灯,若为false则为关灯",

"required": True,

"schema": {"type": "bool"},

}

],

}

]

messages = [{"role": "user", "content": "帮我开一下灯"}]

call_qwen(messages, functions)

返回结果如下:

# messages

[{'role': 'user', 'content': '帮我开一下灯'}]

# response

{

"model": "Qwen",

"object": "chat.completion",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"content": "Thought: \u9700\u8981\u4f7f\u7528\u706f\u5149\u63a7\u5236API\u6765\u5b9e\u73b0\u5f00\u706f\u64cd\u4f5c",

"function_call": {

"name": "contral",

"arguments": "{\"switch\": True}"

}

},

"finish_reason": "function_call"

}

],

"created": 1706839240

}

# switch

开灯

# response.choices[0].message.content(json 会导致"content"中的中文会变为Unicode,取出来后就是正常的)

Thought: 需要使用灯光控制API来实现开灯操作

Function Calling 是一种非常有用的功能,可以让Chat Completion模型更加灵活地应对各种场景比如自动发邮件、控制机械臂、上网搜索用户提问中的相关信息后回答,调用其他厂家的 api 接口……通过调用外部函数进行输出格式化,可以让Chat Completion模型更加贴合实际需求,并提供更加优质、高效、个性化的服务。怎么用就取决于大家的想象力了。

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

![[单master节点k8s部署]21.EFK日志收集平台介绍](https://i-blog.csdnimg.cn/direct/89b1f555515e477ab9f62d4efa758fc2.png)