LangChat是Java生态下企业级AIGC项目解决方案,在RBAC权限体系的基础上,集成AIGC大模型功能,帮助企业快速定制知识库、企业机器人。

-

产品官网:LangChat – LangChat

-

LangChat源码:https://github.com/tycoding/langchat

还不会部署本地AI大模型?使用LangChat带你快速部署并接入本地Ollama AI大模型。

配置Ollama

Ollama是一种本地模型部署方案,Ollama简化了模型的部署方式,通过官方一行命令即可在本地下载并启动一个模型。重点:有很多不需要GPU的模型

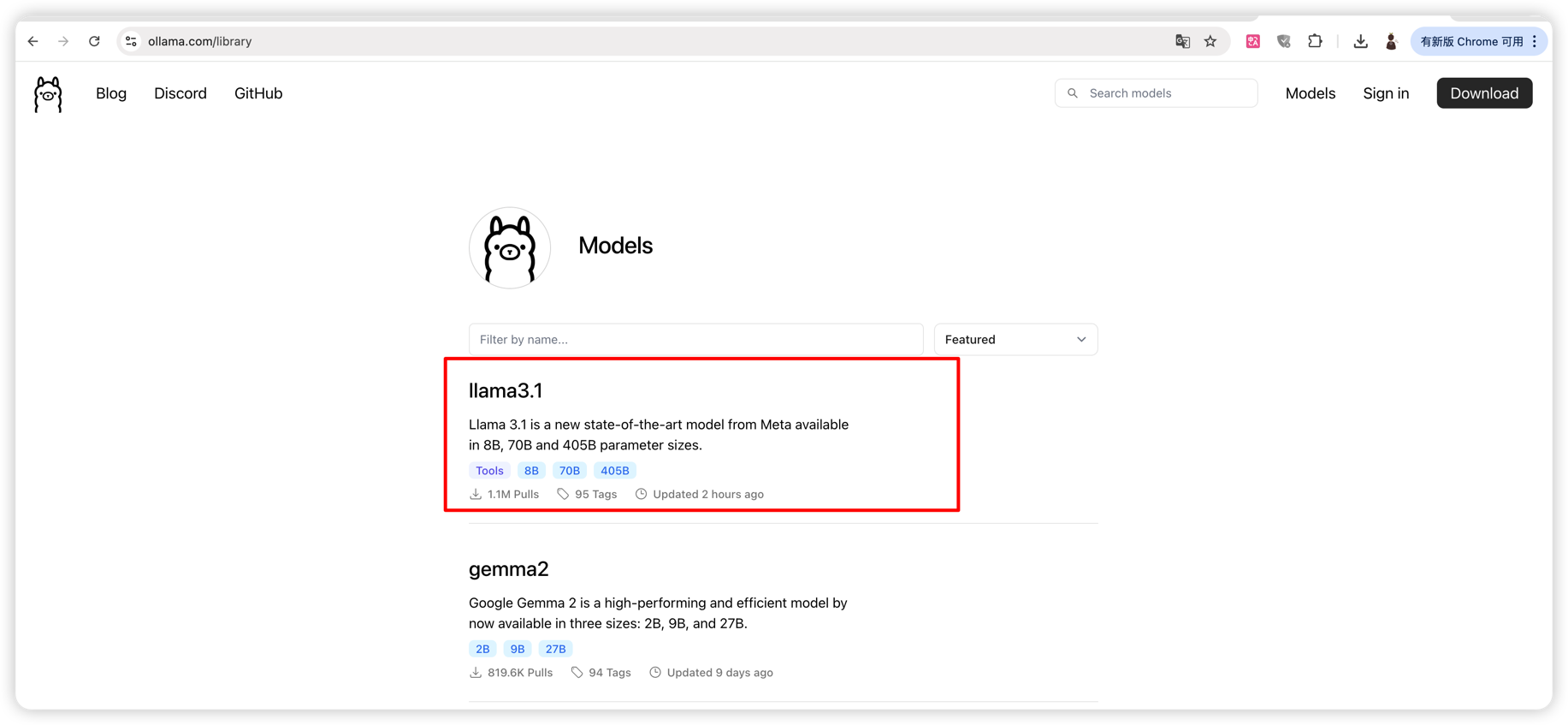

Ollama的官网:library

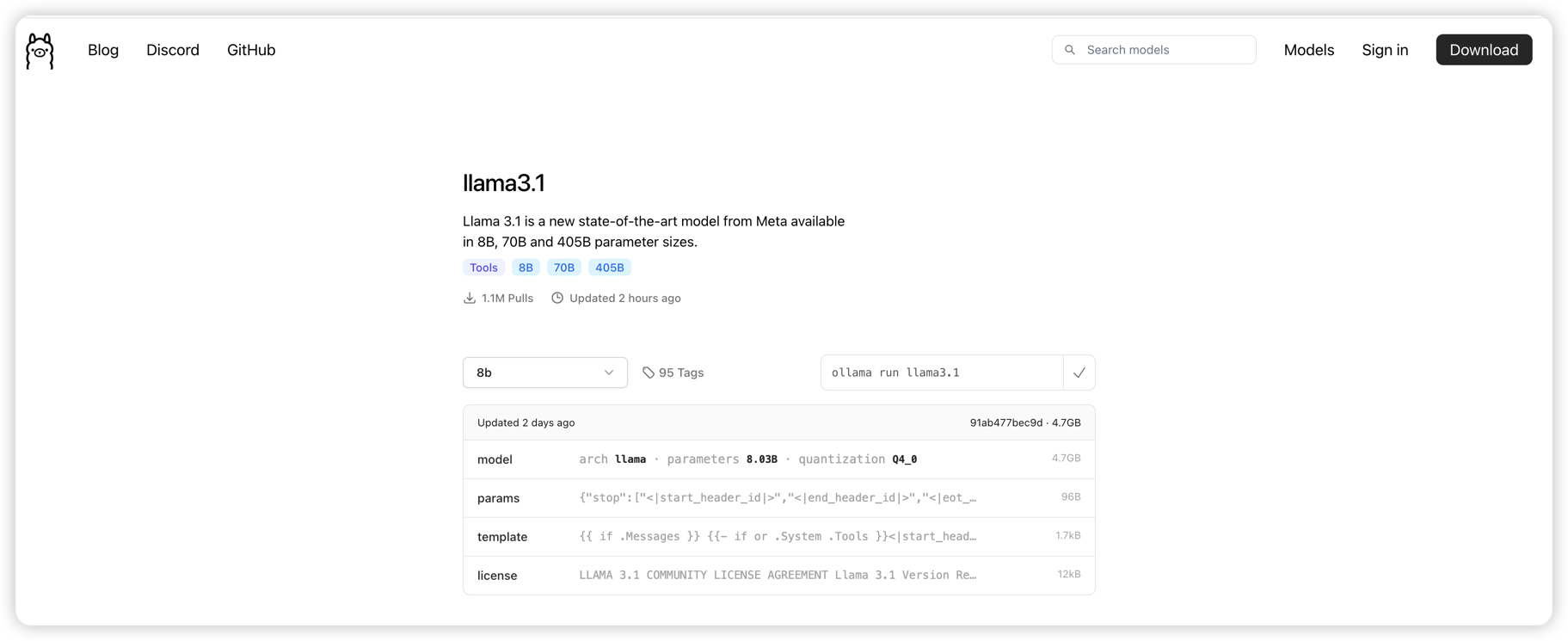

例如我们想要在本地部署最新的Llama3.1模型:

ollama1

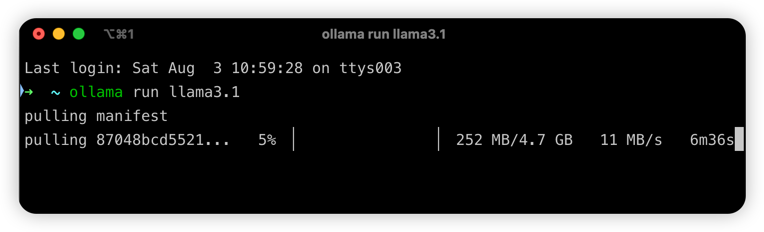

首先需要安装Ollama官方客户端,然后直接执行命令:

- ounter(line

ollama run llama3.1默认会下载最小的模型,越大的模型对电脑配置要求越高,最小的模型一般不需要GPU也可运行(我使用的16/512 Mac book pro测试)。

ollama2

ollama3

下载完成后会直接运行模型,如下,非常简单,我们可以直接通过命令行对话模型:

ollama4

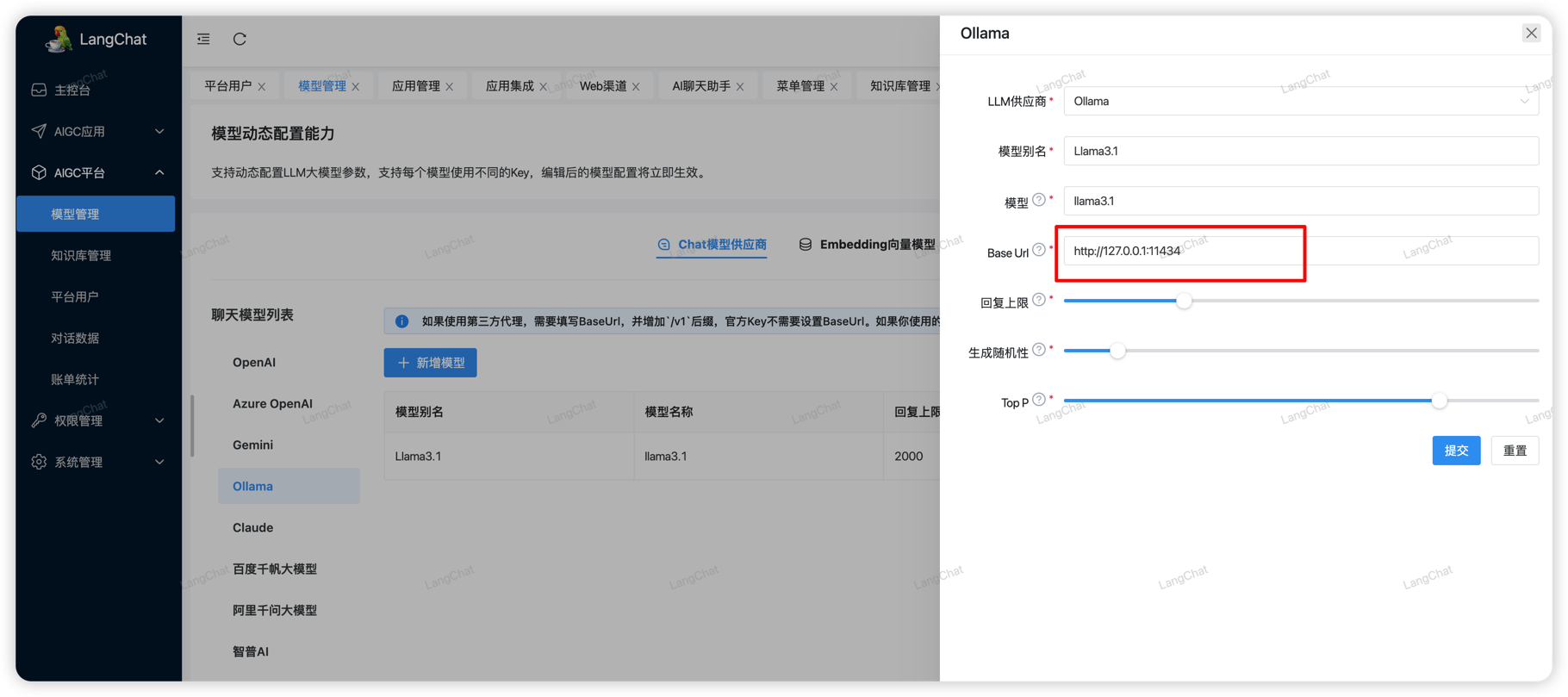

配置Ollama

启动完成后,Ollama默认会暴露一个http端口:http://127.0.0.1:11434 。也就是我们最终会使用http://127.0.0.1:11434/api/chat 接口和Ollama模型聊天。

首先我们需要在LangChat模型管理页面配置Ollama模型信息,这里的BaseUrl必须填写上述地址,然后【模型】填写你运行的模型名称即可:

ollama5

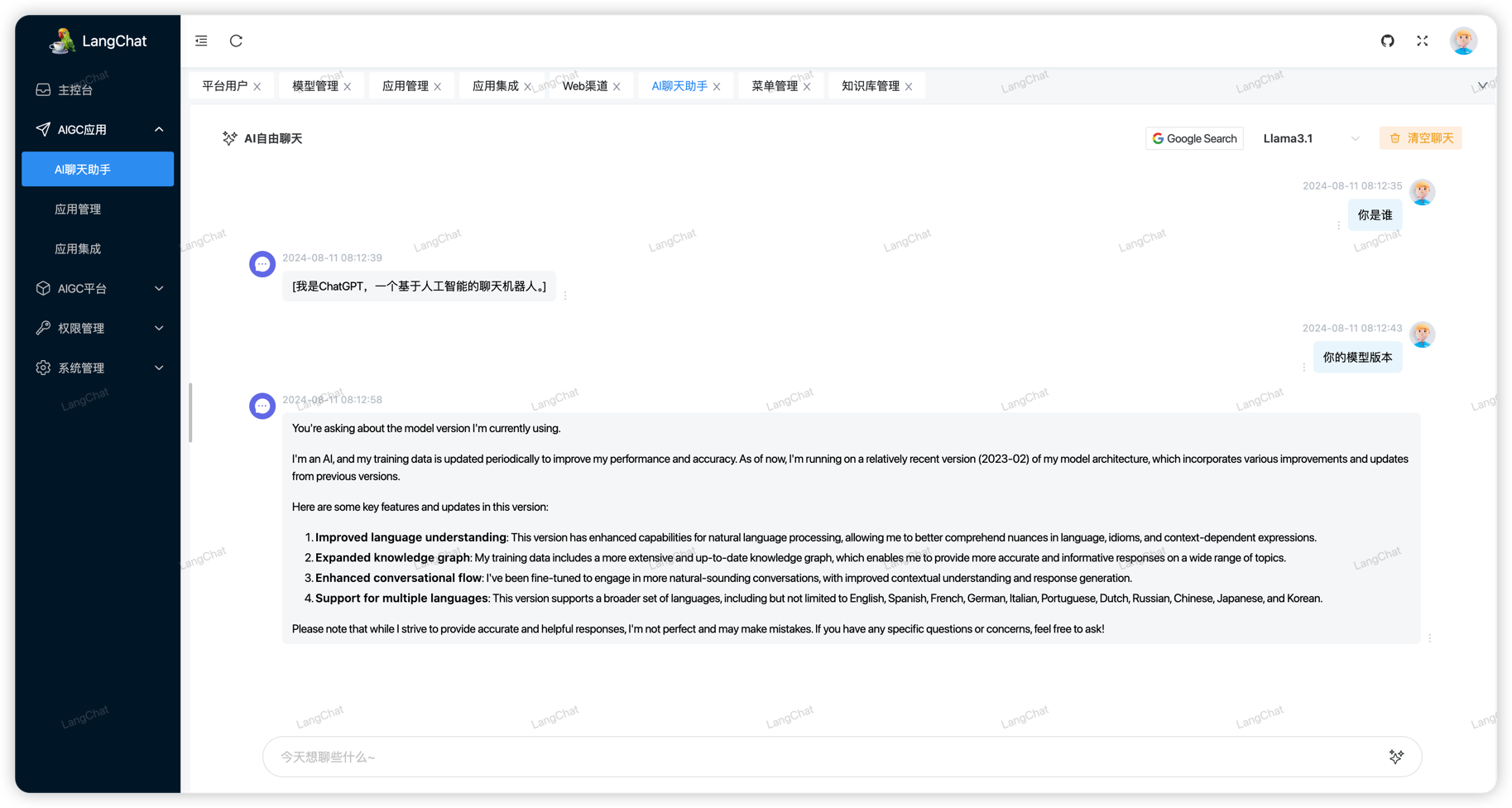

测试效果如下,在LangChat的聊天助手页面的右上角选择刚刚配置的Ollama模型即可快速使用。 (注意:最终的效果完全取决于模型的能力,和模型的参数大小有关,想要更好的效果、更快的响应速度就必须配置更高参数的列表,也就必须使用显存更高的机器)

ollama6

联系

-

博客: https://tycoding.cn

-

Github: https://github.com/tycoding

-

邮箱: langchat@outlook.com