文章目录

- 介绍

- 实验数据

- 实验数据1

- 实验数据2

- 实验数据3

介绍

这篇文章发在CCS2024,CCS是密码学领域的顶会。作者是来自加拿大的University of Waterloo。文章对大语言模型像GPT和LLM等大语言模型实现了零知识可验证执行,但不涉及零知识可验证训练。个人觉得这是一篇值得精读的一篇文章。文章的方案与现存的RISC-ZERO和EZKL或者Halo2的方案(zkML)不同。文中使用完全并行化的 CUDA ,同时对于拥有 130 亿个参数的 LLM,这篇文章的方法能够在 15 分钟内为整个推理过程生成正确性证明。生成的证明大小不到 200 kB。(使用ezkl的方案使用nanoGPT参数大概40w实现零知识可验证执行所需要的时间2小时,而这篇论文的方案有着质的提升)。

实验数据

实验数据1

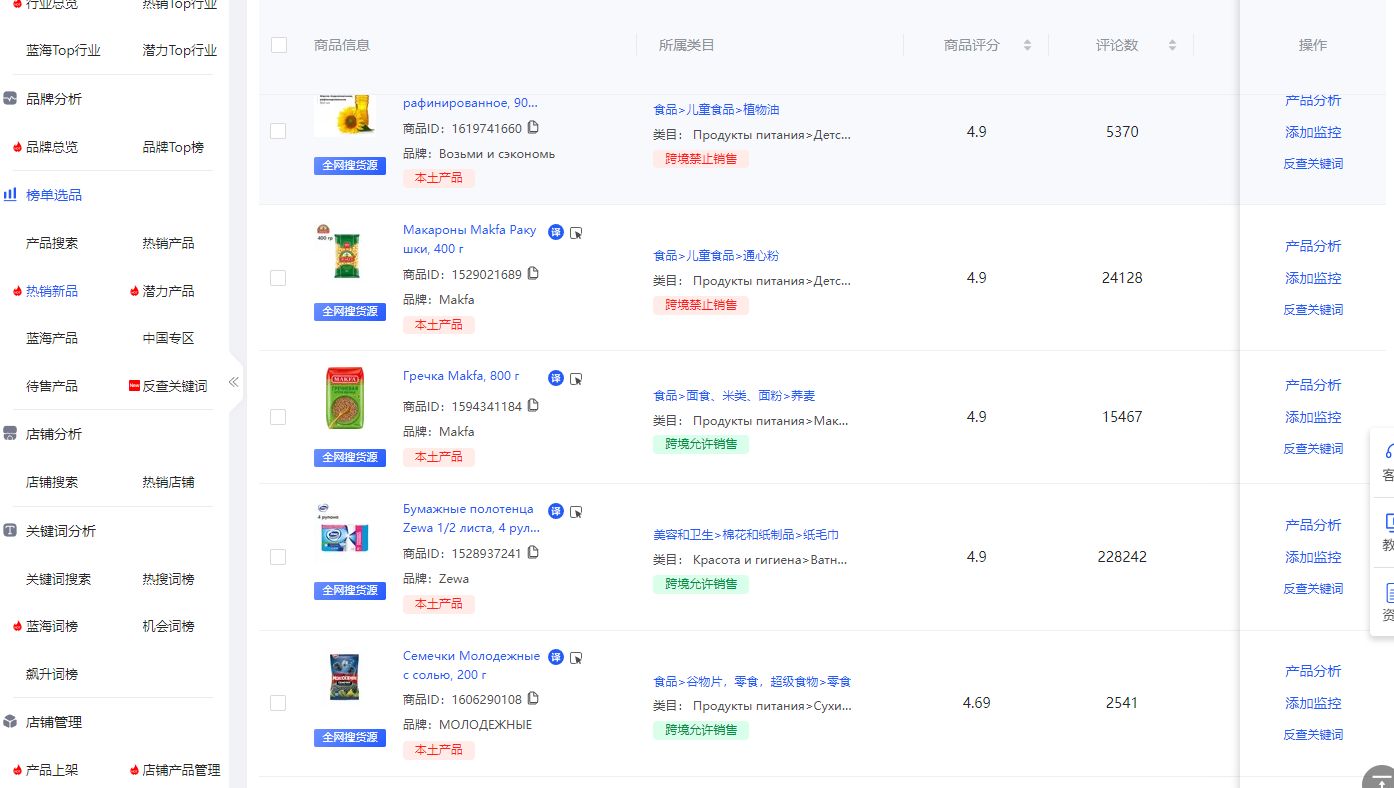

论文中分别对大语言模型进行证明生成的时间,证明大小以及验证时间进行了测量。

实验数据2

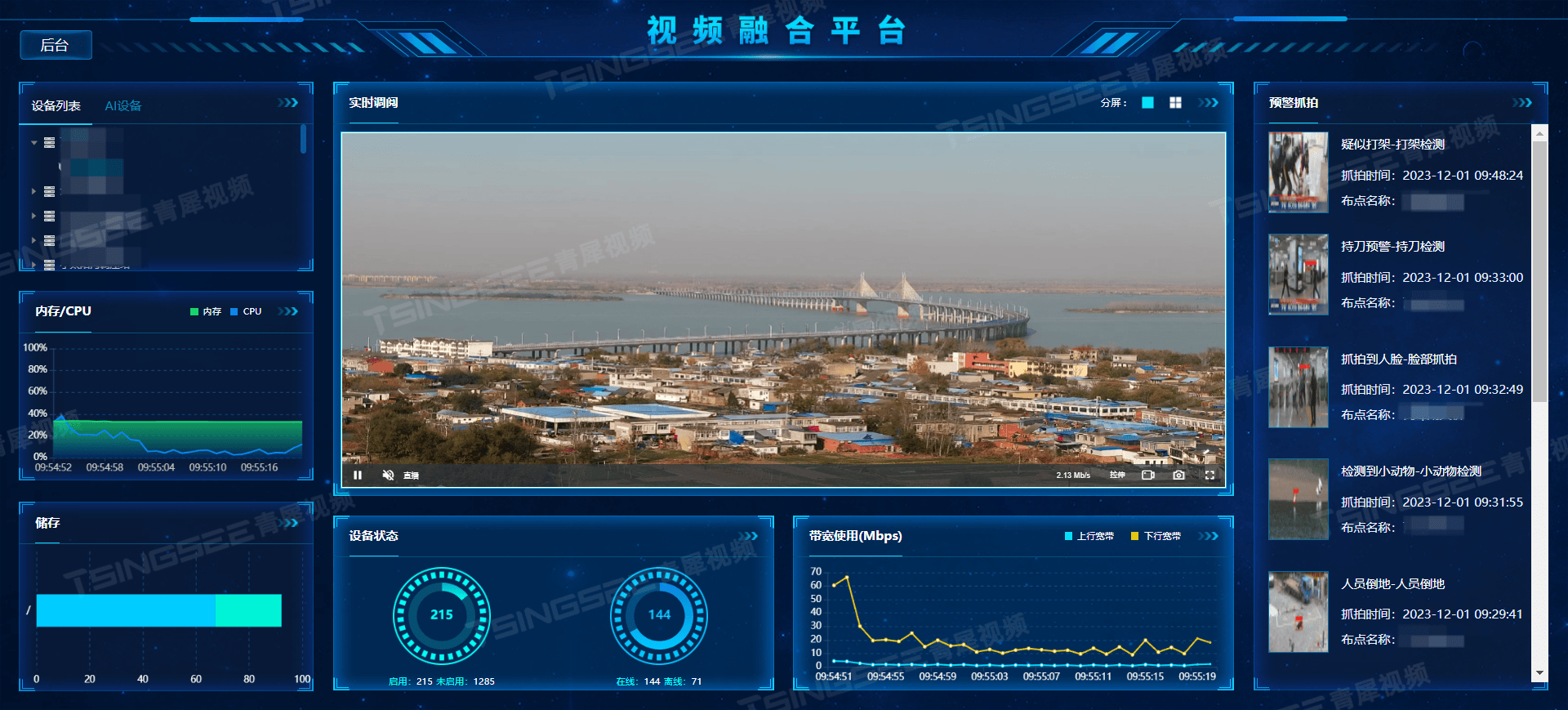

论文中与zkML的生成证明的时间进行了比较,zk LLM方案的生成证明的时间远远低于zkML生成证明的时间。zkML这个方案是基于halo2的方案。

实验数据3

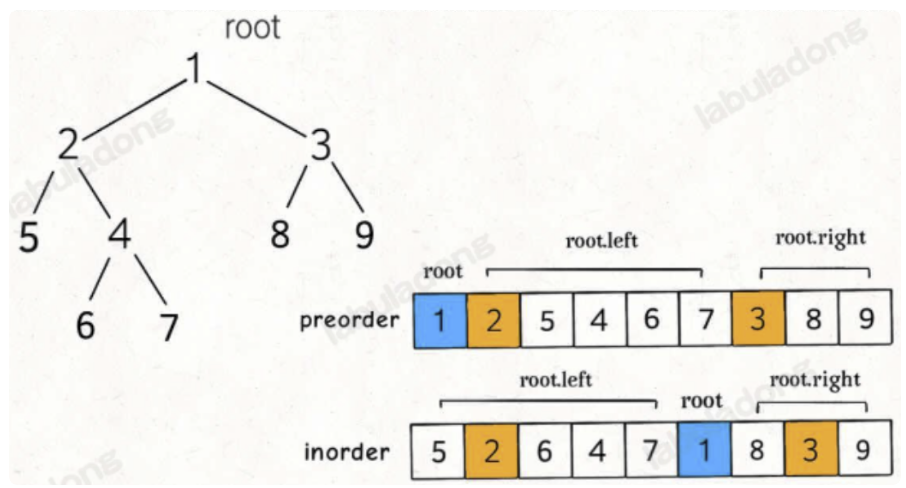

该实验研究了Sequence Length对生成证明的时间,生成证明的大小,以及验证时间的影响。Sequence Length是模型输入文本的长度。