When can Mechine learn?

2.Learn to Answer Yes/No(如何进行学习)

2.1perceptron hypothesis set

2.2Perceptron Learning Algorithm

2.3Guarantee of PLA

2.4Non-Separate Data

Why can Mechine learn?

How can Mechine learn?

How can Mechine learn better?

When can Mechine learn?

2.Learn to Answer Yes/No(如何进行学习)

本节课主要介绍了线性感知机模型,以及解决这类感知机分类问题的简单算法:PLA。我们详细证明了对于线性可分问题,PLA可以停下来并实现完全正确分类。对于不是线性可分的问题,可以使用PLA的修正算法Pocket Algorithm来解决。

2.1perceptron hypothesis set

what H can be use?

对于信用卡的例子,每个 x 有d个特征向量,每个特征赋予不同的权重w,表示该特征对输出的影响有多大。然后对所有特征进行加权和与阈值进行比较,根据阈值进行分类判别。我们的目的就是计算出所有的权值w和阈值threshold。

为了计算方便,通常我们将阈值threshold当做w_0,引入一个x_0=1的量与w_0相乘,这样就把threshold也转变成了权值w_0,简化了计算。h(x)的表达式做如下变换:

W represents a hypothesis h.

so what do perceptron h look like?

为了更清晰地说明感知机模型,假设x向量在一个二维平面上,h(x) 可以由如下公式进行表示,当 h(x) = 0 的时候,是正负的切换点,当 h(x) = 0 ,就是一条直线。

在此图:perceptron <-> linear classifier。感知器线性分类不限定在二维空间中,在3D中,线性分类用平面表示,在更高维度中,线性分类用超平面表示,即只要是形如w^Tx的线性模型就都属于linear(binary) classifiers。

2.2Perceptron Learning Algorithm

H = all possible perceptrons, g = ?

根据上一部分的介绍,我们已经知道了hypothesis set由许多条直线构成。接下来,我们的目的就是如何设计一个演算法A,来选择一个最好的直线,能将平面上所有的正类和负类完全分开,也就是找到最好的g,使。

我们想要:。虽然 f 不知道,但我们可以在数据 D 上使得

,从而找到

。

如何找到这样一条最好的直线使得?我们可以使用逐点修正的思想,首先在平面上随意取一条直线,看看哪些点分类错误。然后开始对第一个错误点就行修正,即变换直线的位置,使这个错误点变成分类正确的点。接着,再对第二个、第三个等所有的错误分类点就行直线纠正,直到所有的点都完全分类正确了,就得到了最好的直线。这种“逐步修正”,就是PLA思想所在。

g0随机选取,然后根据mistakes进行修正,直到这条线能correct所有x。但有可能这个数据 D 并不是线性可分的,因此我们是不能 correct 所有错误的。并且训练完后真的 g ≈ f ?

如何修正:

对于一个错误的判别(这里只有1/-1),如果 y = 1,但是 wx < 0,说明 w 和 x 向量之间的夹角是一个钝角,此时我们需要减少夹角大小。类似的,对于 y = -1,wx > 0,需要增大夹角。因此我们可以使用 来进行更新,如果

是正的,就会减少夹角;反之,增大夹角,如下图所示:

修正过程(w的方向和线是垂直的,是x变化最快的路径):

初始化W=0,找到一个点x1,出现错误,使用进行更新,所以再一次的划线会垂直于这条紫色的线。

因为一次只看一个点,转的角度会变大。

2.3Guarantee of PLA

演算法两个核心:

- 1.找出一个错误的点

- 2.利用错误点更新w

![]() ->

-> ![]()

对于的含义:

如果PLA停下来,在数据集上没有任何错误,我们称 D 是线性可分的。如果不是线性可分的,线性分类器停不下来。

证明线性可分(演算法能停):

如下所示,我们可以知道如果存在一个 可以使得

,那么对于任意一个x都应该存在

。

我们将进行点积,经过变换,如上图所示,

,从推导可以看出,

与

的内积跟

与

的内积相比更大了。似乎说明了

更接近

,但是内积更大,可能是向量长度更大了,不一定是向量间角度更小。所以,下一步,我们还需要证明

与

向量长度的关系:

只会在分类错误的情况下更新,最终得到的

相比

的增量值不超过

。也就是说,

的增长被限制了,

与

向量长度不会差别太大!

(余弦相似度)

(余弦相似度)

证明过程:

其中![]()

2.4Non-Separate Data

综上,我们证明了在线性可分的情况下,PLA是可以停下来并正确分类的。同样可以扩展到d维空间。

- W_f 和 W_t 的内积会快速增长

- W_t 的长度也会缓慢增长

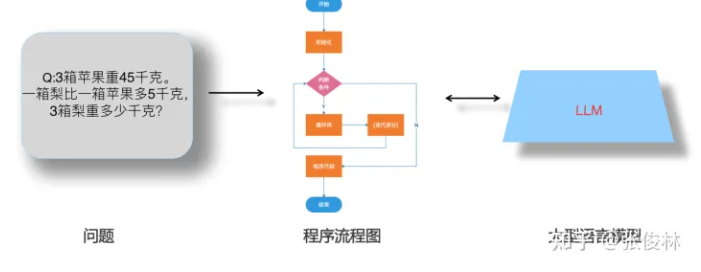

但对于非线性可分的情况,我们可以把它当成是数据集 D 中掺杂了一些 noise,事实上,大多数情况下我们遇到的D,都或多或少地掺杂了noise。这时,机器学习流程是这样的:

在非线性情况下,我们可以把条件放松,即不苛求每个点都分类正确,而是容忍有错误点,取错误点的个数最少时的权重w:

事实证明,上面的解是NP-hard问题,难以求解。然而,我们可以对在线性可分类型中表现很好的PLA做个修改,把它应用到非线性可分类型中,获得近似最好的g。

修改后的PLA称为Packet Algorithm。它的算法流程与PLA基本类似,首先初始化权重w0w_0,计算出在这条初始化的直线中,分类错误点的个数。然后对错误点进行修正,更新w,得到一条新的直线,在计算其对应的分类错误的点的个数,并与之前错误点个数比较,取个数较小的直线作为我们当前选择的分类直线。之后,再经过n次迭代,不断比较当前分类错误点个数与之前最少的错误点个数比较,选择最小的值保存。直到迭代次数完成后,选取个数最少的直线对应的w,即为我们最终想要得到的权重值。(取模型最优的时候)