导读

在企业提效方面,多模态能力同样具有重要意义。在 AICon 北京站活动中,快手「可图」大模型负责人李岩分享了主题为《快手「可图」文生图大模型应用实践》的演讲,以下为李岩演讲内容~期待对你有所启发!

一、基座模型

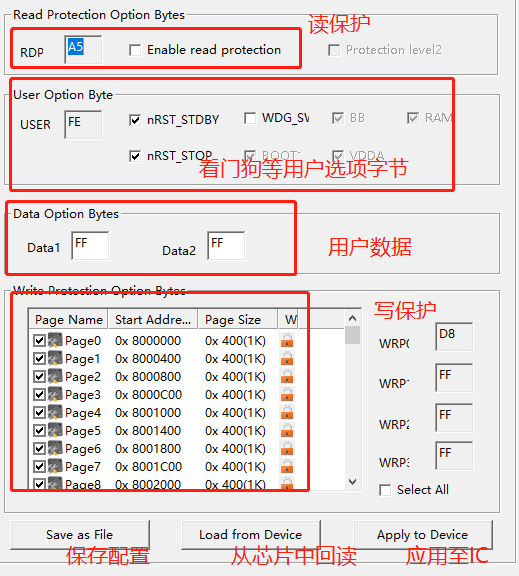

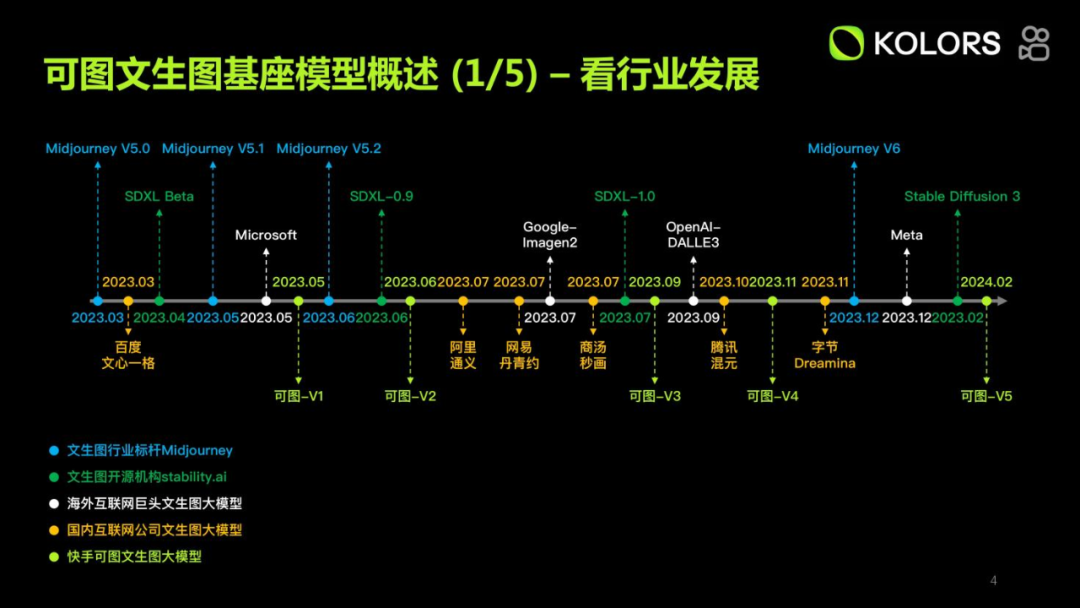

过去的一年对于文生图行业而言无疑是充满活力与突破的一年。在这段时间里,文生图行业经历了多次爆发式的增长。通过梳理从 2023 年 3 月份至今超过一年的时间线,可以观察到多个机构相继推出了自己的文生图产品,显示出该行业目前的热度与活跃度。上图列出了几个行业标杆,包括闭源机构 Midjourney,开源机构 stability.ai,以及国内外的互联网巨头,同时也包括快手可图 Kolors 大模型。

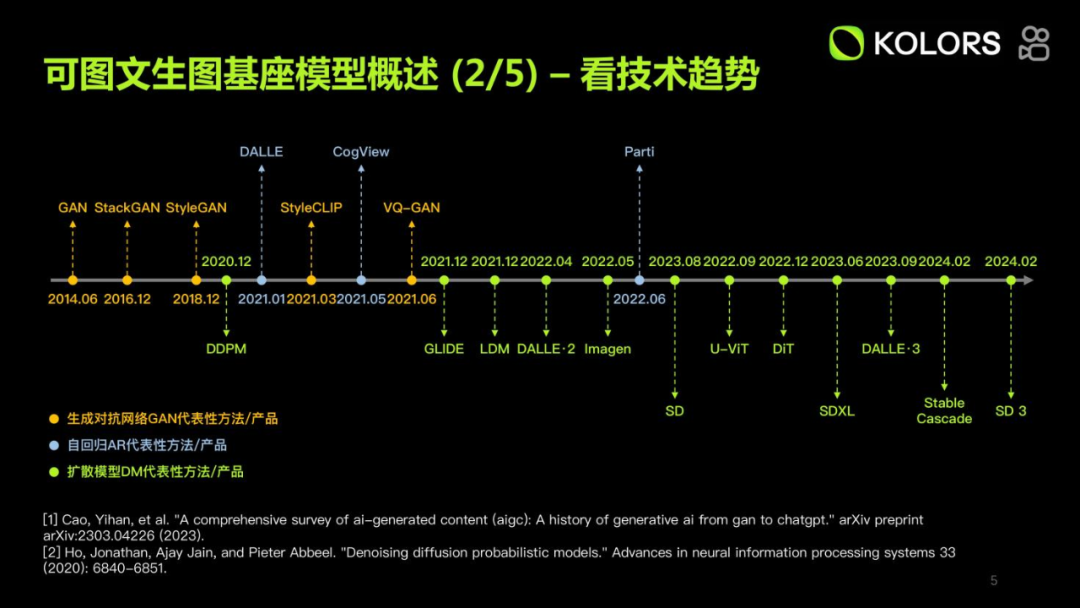

接下来本文将探讨视觉生成技术的发展趋势。为全面了解技术发展,时间轴被追溯至 2014 年。从上图可以很容易地观察到,在过去的十年中,生成式技术框架逐渐从生成对抗网络(GAN)向扩散模型(Diffusion Model)过渡。尽管这期间出现了一些基于自回归(Auto Regressive)的方法,但它们并未成为行业的主流。

接下来,我们从数据侧、模型侧以及效果侧为读者介绍可图文生图基座模型。

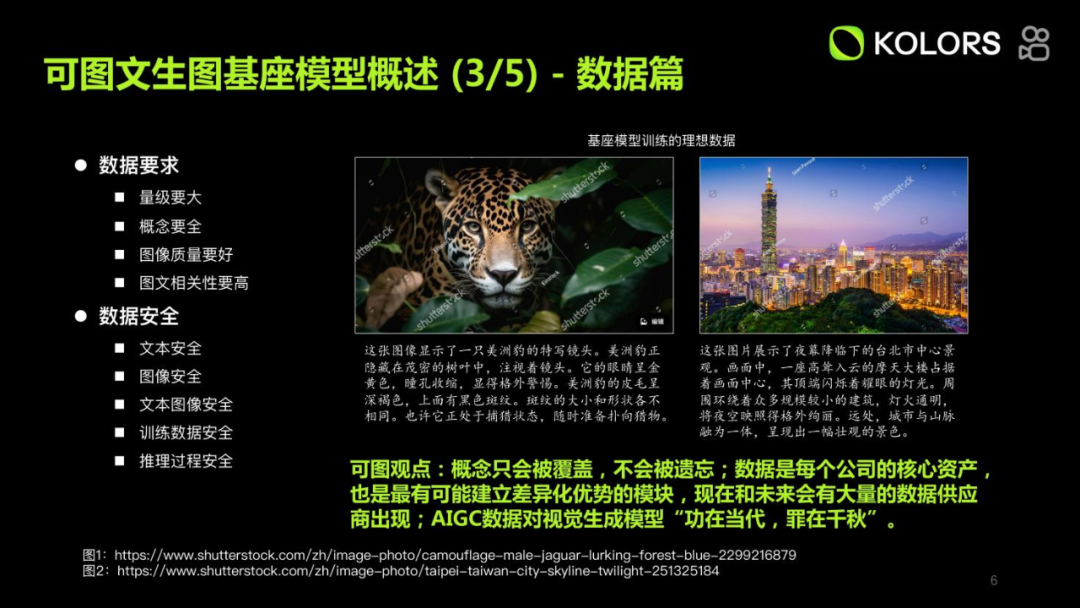

数据侧:数据是构建大模型最关键的因素之一。数据的关键点在于:1. 数据量级要大;2. 数据覆盖概念要全,特别是中文概念;3. 图像质量要好;4. 图文相关性要高。上图这里展示的两张图像,来自行业最优秀的图像供应商 Shutterstock,很多企业包括我们在内都求之不得,而 Shutterstock 与 Google 和 OpenAI 等企业签订了战略合作。

其实这些数据就满足上述标准,包括艺术感、构图以及清晰度,并且在图文相关性方面表现优异,当然这些高质量版权数据的获取成本也相对较高。接着我们讨论数据安全,在文生图的训练过程中,必须同时确保文本和图像的组合安全,在特定情况下即使文本和图像单独看是安全的,组合起来仍会产生不当的关联含义(大家自行脑补)。推理侧更要保证出图的安全,这要感谢快手多年建立起来的行业领先的全场景风控解决方案,从文本到视觉为模型安全保驾护航。在数据的讨论中,一个经常性的问题是:文生图模型训练的过程中是否会遗忘旧概念?这是视觉生成领域许多研究者共同关心的问题。

在这里,本文提出了第一个可图观点:“概念只会被覆盖,不会被遗忘;数据是每个公司的核心资产,也是最有可能建立差异化优势的模块,现在和未来会有大量的数据供应商出现;AIGC 数据对视觉生成模型‘功在当代,罪在千秋’”。下面我们将以一个具体的例子来阐释这点,众所周知,文生图领域有一个被大家广泛使用的开源模型 Stable Diffusion。这个模型是基于西方数据进行训练的,天然具备生成裸体的能力(西方对于色情内容的监管相对宽松)。

可图在很早期的实验版本中,曾经做过这样的认知实验,我们利用安全的训练数据(不包含任何裸体数据)在 Stable Diffusion 模型基础上进行微调续训,经过多轮数据迭代后,发现当你使用“裸体”这样的关键词去触发文生图,模型依然能够成功生成裸体图像,这些旧的概念知识来自于模型的初始化参数。所以,模型原有的概念并未被完全遗忘,他们只会被同概念的新数据分布所覆盖。因此从安全的角度看,国产文生图大模型应该尽量放弃西方开源的模型参数。此外,我们还想强调的是,数据不仅是每个公司的核心资产,也是未来建立差异化优势的关键模块,大模型时代任何人都应该保持对数据的敬畏与投入。

最后一个数据侧的可图观点是“AIGC 数据对视觉生成模型‘功在当代,罪在千秋’”,许多行业从业者都试图尝试利用 Midjourney 这类标杆数据去训练自己的生成模型,其实可图团队在初期也进行了一些类似的认知实验,我们发现这种做法其实是弊大于利的。使用 AIGC 数据训练模型,确实能在短时间内提升模型的出图效果,因为是立竿见影的,所以我们说“功在当代”,但是,长期依赖 AIGC 数据可能会使模型逐渐失去理解和拟合世界物理规律的能力。因此,可图大模型团队已经完全抛弃了 AIGC 的训练数据。

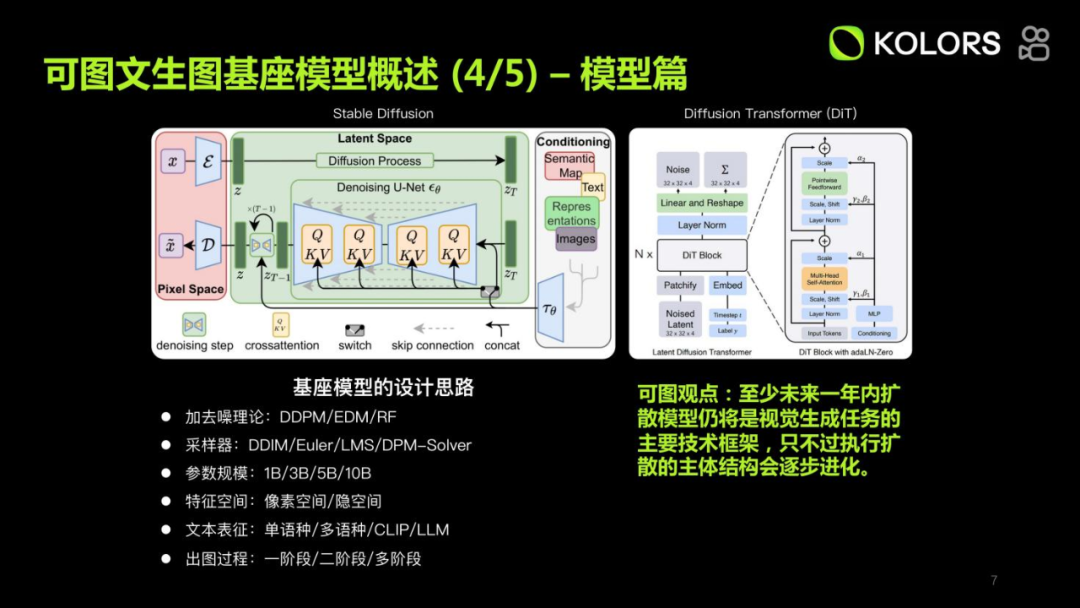

模型侧:这里我们主要探讨当前主流的两种生成式框架。上图左侧是 Stable Diffusion 的框架,其主干模型是 U-Net,而右侧是随着 Sora 的推出,出现在技术舞台中央的 DiT(Diffusion Transformer)框架。这两种框架都是当前文生图以及文生视频领域的主流框架。在这里,我们给出了第二个可图观点:“至少未来一年内扩散模型仍将是视觉生成任务的主要技术框架,只不过执行扩散的主体结构会逐步进化”。

下面列举了一些基座模型的设计要点,包括加去噪理论(如 DDPM、EDM、RF),采样器(如 DDIM、Euler、LMS、DPM-Solver),以及参数规模(1B、3B、5B、10B)。在特征空间的设计上,可以选择像素空间或隐空间。文本表征方面更为复杂,需要考虑是单语种还是多语种,选择合适的文本 Encoder 也是至关重要,即可以是能够刻画图文相关性的 CLIP,也可以是大语言模型 LLM。根据输出图像的策略,模型框架又可以分为一阶段、二阶段或者多阶段出图。过去一年的时间里,可图团队在上述关键技术维度上进行了充分的探索,并且沉淀下来了一套在当前资源下的技术方法论。

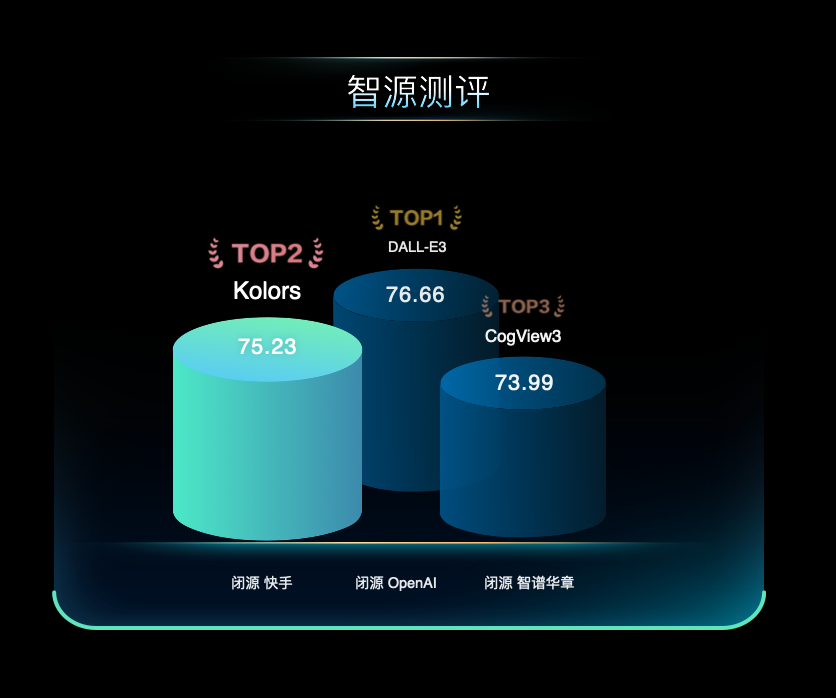

效果侧:我们简要从模型 GSB(图像生成质量评分)和作品墙来展示可图大模型的能力。从 2023 年 5 月发布的第一个版本开始,直到 2024 年 2 月发布的第五个版本,可图大模型在 GSB 评估上已经超过了 Midjourney-V5。目前内部的测试结果显示,最新版本的可图大模型表现已非常接近 Midjourney-V6 的水平。在智源 FlagEval 文生图模型第三方评测榜单中,可图(Kolors)以主观综合评分 75.23 分的成绩,排名全球第二,仅次于闭源的 DALL-E 3。

特别值得一提的是,在主观图像质量方面,可图(Kolors)表现尤为突出,评分排名第一,显著优于其他开源和闭源模型。

二、效果评估

第二部分,文生图模型的效果评估。

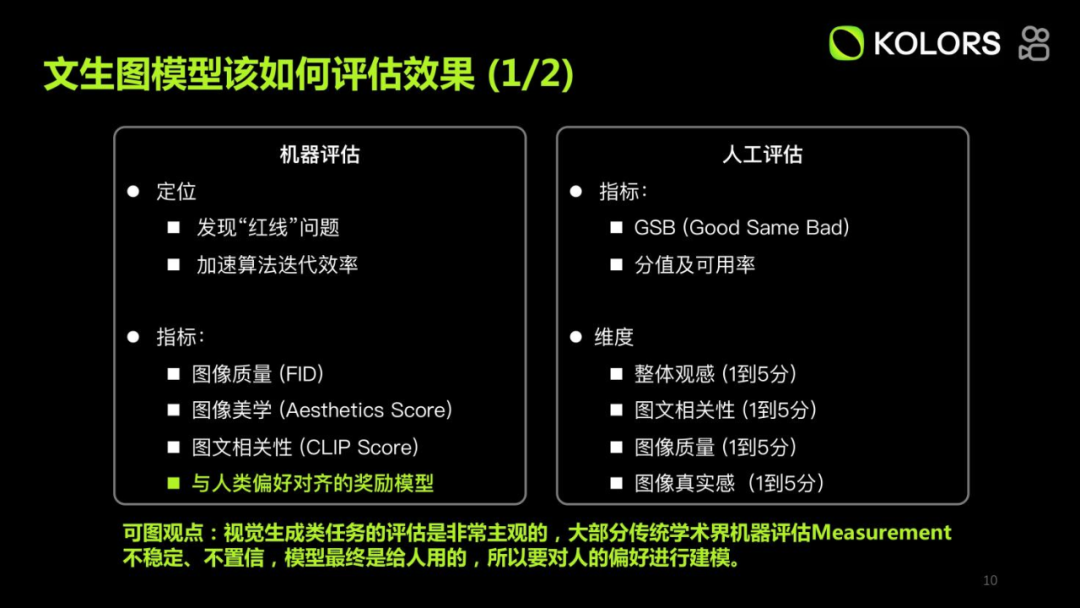

文生图和文生视频的效果评估方法在行业内尚未成熟,这与大语言模型领域的情况略有不同。实际上,大语言模型领域已有多个成熟的评估基准,这些评估基准很多由投资机构设立,以帮助其评估模型的投资价值。相比之下,文生图和文生视频的评估基准则发展缓慢。我们将评估方法分为两类,机器评估与人工评估。人工评估是视觉生成模型非常关键的评估方式,因为最终这些模型还是要服务人类用户。

文生图和文生视频的效果评估方法在行业内尚未成熟,这与大语言模型领域的情况略有不同。实际上,大语言模型领域已有多个成熟的评估基准,这些评估基准很多由投资机构设立,以帮助其评估模型的投资价值。相比之下,文生图和文生视频的评估基准则发展缓慢。我们将评估方法分为两类,机器评估与人工评估。人工评估是视觉生成模型非常关键的评估方式,因为最终这些模型还是要服务人类用户。

在人工评估中,可图团队采用对战场景中的“Good,Same,Bad”(GSB)作为内部评估指标。评估会关注生成图像在整体观感、图文相关性、图像质量以及图像真实感等维度上的表现,并对每个维度进行 1 到 5 分的离散打分。在评估人员接受了充分培训的前提下,人工评估能够非常准确地反映出生成内容与人类体感的一致性。然而,人工评估的主要缺点是耗时耗人力,具体地,可图大模型当前的评测集可能包含数千条 Prompts,进行一轮完整的人工评估就需要两到三天。因此,虽然人工评估在准确性上具有优势,但为了考虑效率,机器评估同样不可或缺。

在机器评估方面,存在一些专门用于衡量生成图像效果的指标,例如使用 CLIP 刻画图文的相关性,使用 FID 刻画图像质量,以及其他一些衡量美学或相关性的指标。可图团队在实验过程中发现,上述学术界使用的传统机器评估指标往往是不稳定的,像 FID 这样依赖参考集的指标,参考集轻微的调整就会导致 FID 大幅度变化。此外每个机器评估指标通常仅能评价图像在某一方面的性能,比如美学、相关性或图像质量。

因此,我们将机器评估的价值定位为“发现红线”,也就是说,在值域的极端(高或低),机器评估是数值敏感的,但是中间段数值则是不敏感的。具体地,在模型训练的过程中,如果 CLIP 图文相关性指标突然出现了大幅下降,这可能意味着模型确实出现了严重问题,此时需要算法同学注意并调整模型,而在中间段数值范围内波动的机器评估指标,我们通常无需过分关注。

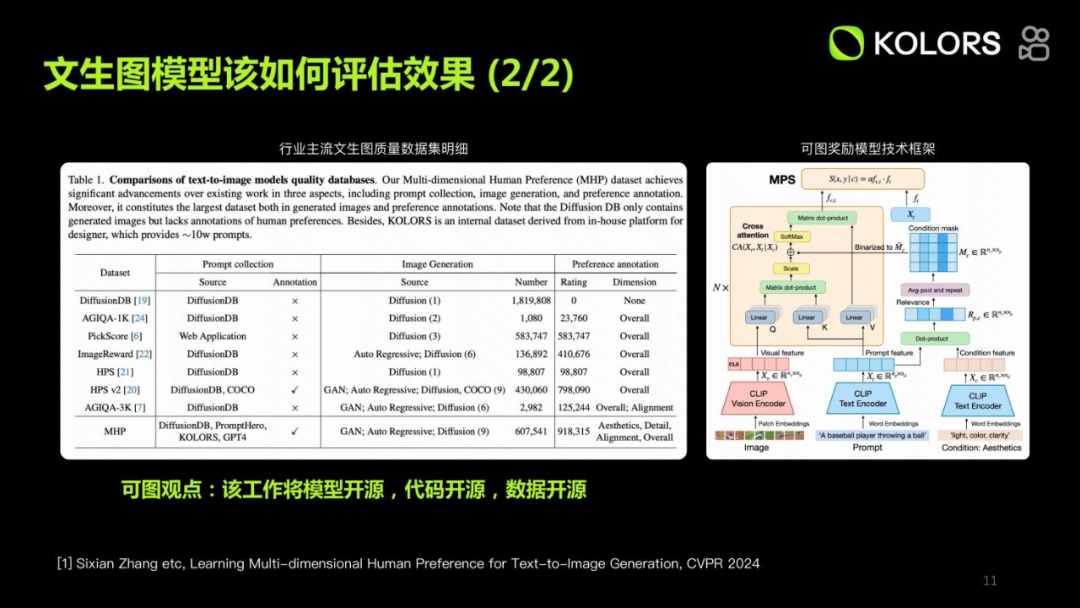

在这里,我们提出了第三个可图观点:“视觉生成类任务的评估是非常主观的,大部分传统学术界机器评估 Measurement 不稳定、不置信,模型最终是给人用的,所以要对人的偏好进行建模”。在 CVPR 2024 上,可图团队发表了一篇论文 Learning Multi-dimensional Human Preference for Text-to-Image Generation(代码开源、数据开源、模型开源),旨在解决这个问题。这篇工作主要传达了一个信息:传统的学术评估指标在衡量真正用于人类的文生图系统时,大多数指标表现出不稳定性和不适用性。为了有效地结合人工评估的精度和机器评估的效率,这篇工作提出了一种基于人类反馈的奖励模型,用机器模型去建模人类偏好。

上图左侧是行业内已经存在的一些文生图评估的开放数据集,这些数据集存在一些局限性,量级不够大且评价维度较为单一。右侧展示的是我们这篇工作中提出的技术框架,其中一路负责描述视觉信息,另一路负责描述文本信息。视觉和文本信息通过两条路径进行交融,拟合人工标准对生成图像的多维度质量打分。

三、衍生能力

在我们讨论可图大模型应用之前,先来介绍三个关键的衍生能力。

第一个衍生能力:提示词润色能力, 这里我们给出三个示例,1)井底之蛙,如果不加任何提示词润色,可以看到可图大模型仅能绘制出青蛙,但如果加上了提示词润色,则可以明显地看到在青蛙的基础上又多了一层坐井观天的文学意境;2)没有青蛙的荷叶,这是个非常典型的衡量一个文生图模型好坏的陷阱示例,即否定词场景,如果不加任何提示词润色,一般会倾向于画上一个青蛙,但是如果使用提示词润色,则会发现只有荷叶被绘制出来;3)A 股 2500 点保卫战,左边是没有提示词润色的结果,画出了一个战争的场景,右边则经过了提示词润色,画出了 A 股市场面临的巨大压力和股民们焦虑的神态。

到这里,我们给出第四个可图观点:“借助大语言模型进行提示词润色,能很好的解决成语、文学概念、否定词、互联网热梗新梗,以及新概念的语义理解与表征问题,同时降低文生图大模型的使用门槛,从‘咒语’到‘人话’”。大家可能都听说过 Midjourney,但真正使用过的人其实相对较少。主要原因有三点:第一,它的使用环境是英文;第二,它的使用方式是命令行;第三,它的使用需要一些特定的“咒语”专业知识,这三点对普通用户其实还是构成了挺大的门槛。可图团队需要解决的正是这些问题,目标是让大家能更方便地使用可图大模型。

第二个衍生能力:文字绘制能力,这是可图在整个行业里做的非常前沿的一个能力。可图的文字绘制能力有两大特点,第一,无 Control 逻辑,现有的一些技术方案在文字绘制时需要先确定字的位置、大小、字体等,然后再绘制文字,而可图无需此类控制逻辑;第二,无特殊提示词激活逻辑,不同于需要特定提示词来激活写字模型的其他方法,可图是一个通用模型,能够在没有特殊提示词的情况下进行文字绘制需求响应。这种全自由度的、开放域的文字符号绘制能力,在市面上比较少见。

在这里,我们给出第五个可图观点:“开放域的文字符号绘制是视觉生成领域的‘上乘武功’,对专项数据的要求极高。行业短时间内,文字绘制还只能用于娱乐场景(例如表情包),严肃场景的文字绘制需要阶段性倚赖结构性线索或约束”。我们判断行业短时间内文字绘制还只能应用于娱乐场景,如表情包制作。可图团队内部已经在广泛使用这样的文字表情包,结合上人像 ID 保持能力,可玩性非常高,增加了团队间的互动乐趣,也促进了团队氛围。尽管文字绘制确实带来了一定的娱乐价值,但也必须认识到,当这种能力用于更严肃的业务场景时(如广告海报或商品主图),可能还是需要一定的结构性线索或约束来确保正确性和美学效果。

第三个衍生能力:交互式视觉生成能力,该能力已在内测中,它允许用户通过自然语言与可图大模型交互,实现更加直观和灵活的图像生成。在这里,我们给出第六个可图观点:“操作台式产品(Pro)面向高阶用户,对话框式产品(Lite)面向初阶用户”。例如,“画三个老太太吵架”这一请求,可以通过用户的反馈(如“吵得不够激烈”)来调整生成的图像内容,使其更加符合用户的预期。有了大语言模型的配合,可图模型能呈现出更加夸张的视觉效果。另外一个交互式功能可以支持一些业务,例如,如果用户对一张模特的图片比较满意,但希望更换背景为沙滩,仅需通过语言指令告知系统即可。用户还可以进一步调整服装颜色,甚至为模特添加太阳镜。总结来说,用户可以用自然语言的方式与智能体进行交互,让“小白”用户也能轻松使用可图大模型,而这也是整个行业的一大趋势。

四、应用实践

这一部分,我们开始介绍可图大模型的应用实践。2023 年,可图团队的重点主要在基座研发,到了 2024 年,团队重点逐步从基座研发转向业务落地。

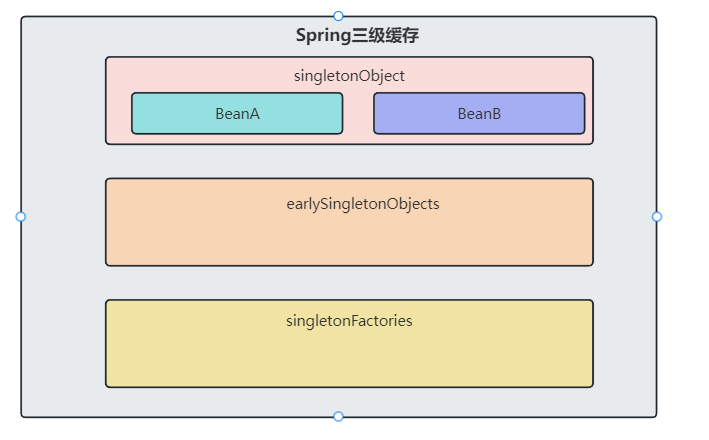

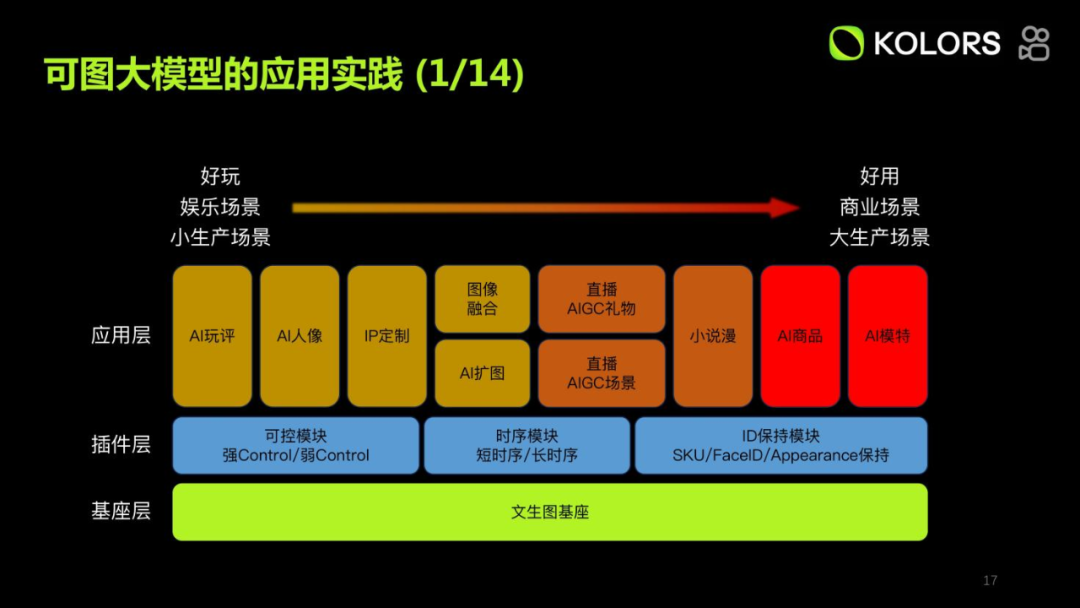

上图最下方是文生图的基座层,其上则是插件层,这些插件对于将基础技术转化为实际应用至关重要。我们将插件大致归纳为三类:1)可控模块,其中强 Control 用于保持图像的空间语义信息,弱 Control 用于维持全局的语义信息;2)时序模块,其中长时序指生成时间较长的视频内容,类似于 Sora;短时序则主要指的是一些 10 秒以内的镜头微动;3)ID 保持模块,这里的 ID 包括 SKU-ID、Face-ID 以及一些其他需要保持的 Appearance-ID。

最上面是应用层,应用层的讨论将从娱乐场景过渡至商业场景,也即从小生产场景过渡至大生产场景。这两端的业务形态存在明显差异:娱乐场景下,模型的主要目标是创造趣味性和娱乐性,模型的表现达到 80 分就已足够,用户通常能够接受小范围的不完美,因为主要目的还是娱乐;商业场景则对模型的效果提出了更高的要求,必须做到近乎完美,达到接近 100% 的好用,其中任何的小错误都可能影响到商业价值。

应用实践一:AI玩评

我们介绍的第一个应用是 AI 玩评,大家在快手的评论区就可以体验到,这也是快手 AIGC 在短视频领域的一次原创尝试,第七个可图观点:“AI 玩评是 AIGC 在短视频领域落地的一次原创尝试,一定程度上促进了用户在评论区进行自我表达的积极性”。上图展示了一些相对有趣的案例,有些 AI 生成的评论甚至获得了上千次甚至上万次的点赞,一定程度上补齐了用户在评论区使用图像表达自己的需求。

应用实践二:AI人像

第二个应用是 AI 人像,相信大家都了解“妙鸭”类产品,它们主要基于 Dreambooth 和 LoRA 的框架来实现人像 ID 的保持。虽然“妙鸭”类产品因其技术曾被广泛讨论,但实际使用过程中会存在一些局限。首先,用户需要支付一些费用(建立数字分身真的需要 GPU 训练);其次,用户需要提供若干张照片(反正程序员的相册里是很难找到自己那么多张照片的);最后,数字分身的建立需要用户分钟级甚至小时级的等待。以上这些因素还是一定程度地限制了功能的便捷性。可图团队倾向更为高效的解决方案,即 Training-Free 的 ID-Adapter 类 ID 保持方法。

我们给出第八个可图观点:“基于 Dreambooth & LoRA 框架的人像 ID 保持方法,在 Training-free 的 ID-Adapter 类方法面前 ROI(Return-on-investment)无优势,特别是对于原始输入人像质量较高的业务场景更是如此”。行业更需要的是一种能够仅通过用户给定的单张图像就能实现 ID 保持的解决方案。在我们上图提供的示例中,最左边的大图像是用户输入的原图,右边则随机展示了使用 Dreambooth 和 LoRA 框架的传统重方案出图和使用 ID-Adapter 类轻方案的出图,可以看到人像 ID 的保持程度都非常高。

接下来,我们还将展示关于人像保持在风格化方面的尝试。上图左边是最近非常流行的 Remini 粘土特效(强 Control),我们给出了静态和动态的效果;右边则是通用垫图的风格化效果(弱 Control),它保持了原图的宏观语义。在这里,我们给出第九个可图观点:“传统基于模板的人像魔表特效研发范式正在被大模型逐步重构,未来的趋势将是统一的视觉生成基座大模型辅以设计师专家级 Prompt 调优”。

传统做法中,设计师会依赖固定模板集合,利用用户上传的人脸进行换脸操作,往往局限于五官的替换,且模板数量有限,用户经常面临与他人“撞模板”的尴尬。相比之下,基于生成式大模型的方案,模型每次生成的结果都是独一无二的,甚至同一用户同一张照片的不同生成实例也会有所不同,这就是生成式大模型所带来的新的价值。

应用实践三:IP定制

第三个应用是 IP 定制,可图团队使用 Dreambooth 方法来支持这一类应用场景。这里,我们给出第十个可图观点:“非真人 IP 形象定制还是需要 Dreambooth 类方法框架,但文字细节还原是技术难点”。虽然在人像保持类的应用中,Dreambooth 的 ROI 可能较低,但在处理 IP 或公仔类的形象时,它显示出较高的实操价值。最近,在快手的司庆活动中,小快和小六的司庆形象均由可图大模型来辅助设计师进行设计。

应用实践四:图像融合

第四个应用是图像融合。图像融合是将文生图的技术从“基于文本生成图像”扩展到“基于图像生成图像”。用户输入是两张图像,生成的过程主要是利用这两张图像作为条件进行图像生成,保持第一张图像的 ID 信息和第二张图像风格信息。这个功能的用户接受度很高,其实特别是在预测类玩法上,用户往往喜欢多次尝试,直到获得满意的结果。

应用实践五:AI 扩图

第五个应用是 AI 扩图。我们在快手的评论区(“AI 小快”和“AI 玩评”)已经上线了扩图功能。上图最右侧展示的是“AI 小快”的评论区互动,有时会生成一些让用户“哭笑不得”的结果。这里,我们给出第十一个可图观点:“AI 扩图的‘翻红’是典型的‘老树长新芽,枯藤开新花’,在此基础上,引入文本条件的 AI 扩图可玩性更高”。

应用实践六:直播+AIGC

第六个应用是直播 +AIGC。可图大模型在直播侧的应用可以分为两个主要场景:“直播 AIGC 礼物”和“直播 AIGC 场景”。在直播中,主播往往期望收到独一无二的定制礼物,而粉丝也希望送出和自己相关的专属礼物,AIGC 刚好提供了这样的能力。直播间的背景素材也可以由可图大模型生成,这些 AIGC 背景与直播内容的和谐程度相对较高,违和感也较少。而且直播背景素材是直播成本中很重要的一部分,特别是在剧情演绎类的直播中,AIGC 背景可以即时地、平滑地辅助场景切换,提升看播体验的同时也降低了成本。虽然我们在直播侧的 AIGC 应用已经有了一些进展,但整体还是相对保守。这是因为直播场景对即时 AIGC 内容的安全性要求极高,直播中生成的任何内容(礼物或背景)都会被主播和所有直播间观众看到,如果生成的内容触发了安全问题,后果将非常严重。保险的做法是所有可能出现在直播中的 AIGC 生成内容,都事先生成并进行严格的人工审查,确保其绝对安全后才能使用。

这里,我们也给出第十二个可图观点:“直播场景对即时 AIGC 内容的安全性要求较高,‘保守的白库策略’与‘积极的即时机审策略’之间的博弈决定了业务价值的空间,直播 +AIGC 的想象空间巨大”。

应用实践七:小说漫

第七个应用是小说漫,小说作为重要的内容消费品类,可图团队正在探索如何利用 AIGC 技术为小说提供配套的视觉素材,从而生成相应的视频内容。小说漫的工作流程包括:1)小说生成,在没有小说正文的情况下,也可以利用大语言模型根据给定主题进行小说的正文生成;2)角色道具解析 + 分镜拆解,通过大语言模型分析小说片段,确定需要哪些角色、道具以及分镜(包括含角色和不含角色的分镜);3)角色与道具的生成,利用可图大模型生成所需的角色和道具;4)分镜场景生成,在生成分镜场景时,如果涉及到角色,需要使用预生成的角色图作为垫图,从而确保生成场景中角色的视觉一致性;5)视频渲染,这个阶段包括字幕合成、转场效果、TTS 以及 BGM,进而生成完整的可播放视频。

应用实践八:AI 商品

第八个应用是 AI 商品,介绍之前,我们先给出第十三个可图观点:“2024 年是 AI 电商爆发的一年,新技术的出现会催化出全新的产品与业务形态,然而电商的本质却是‘低价电商’,素材的美化只能提供增量价值,这其中‘白牌’商品素材生成与美化更为刚需,且累积长尾收益也会更大”。在快手平台,很多卖家往往只能提供质量一般的白底商品图,可图大模型可以帮助他们进行效果增强。这里我们展示了运动鞋和水果(冻梨)两个案例,通过大语言模型或多模态大模型理解商品特性,并为其匹配合适的背景描述,进而可以通过局部重绘的方式来重绘商品背景。

在冻梨的案例中,模型生成与梨花相关的背景,不仅美化了商品图,还增加了视觉上的关联性。上图第三列展示了利用大语言模型生成商品标题、卖点、特性以及宣传语的能力效果,这些生成的文本内容可以用来制作商品的头图或海报,进一步提升商品的表现能力。最后,通过引入时序模块,我们可以使商品图动起来,利用人类对动态内容的敏感度,提高商品在电商平台上的表现力,帮助商品在竞争激烈的电商环境中脱颖而出。

应用实践九:AI 模特

第九个应用是 AI 模特,预计未来在快手平台上会有更多试穿相关的应用场景逐渐出现。这项技术主要为了帮助那些无法负担专业模特费用的小服装或个体经营者。借助这个能力,商家只需提供服装的白底图,可图 AI 模特技术可以生成不同发型、长相、年龄、身材、国籍的模特(这一过程完全通过文本描述来控制,使得定制化模特成为可能)。此外,AI 模特不仅可以进行静态的试穿,展示衣服的外观和搭配效果,同时还可以支持动态试穿效果。

这里,我们给出第十四个可图观点:“从 2024 年开始,开放域的虚拟试穿才呈现出业务落地的技术可行性,B 端(卖家)关注模特版权与商拍级效果,C 端(买家)关注 SKU 保持的同时还关注身份 ID 的保持,千人千面的商品素材生成从此将成为可能”。

其实虚拟试穿概念被定义和讨论已经有很多年了,无论是基于 3D 的方案,还是基于 GAN 的方案,商业级的大规模落地都无法保证用户体验,更多的还是停留在学术 Demo 展示层面。如今,得益于基座视觉生成大模型,我们能够更加精确地处理衣服细节(如品牌商标等),从而使虚拟试穿在商业场景中落地成为可能。此外,随着这种技术的成熟,未来“千人千面”的商品素材生成和推荐也许会成为可能,即使是在浏览同一件服装,不同的消费者看到的模特也可能完全不同。

五、给国内视觉生成同行的几点建议

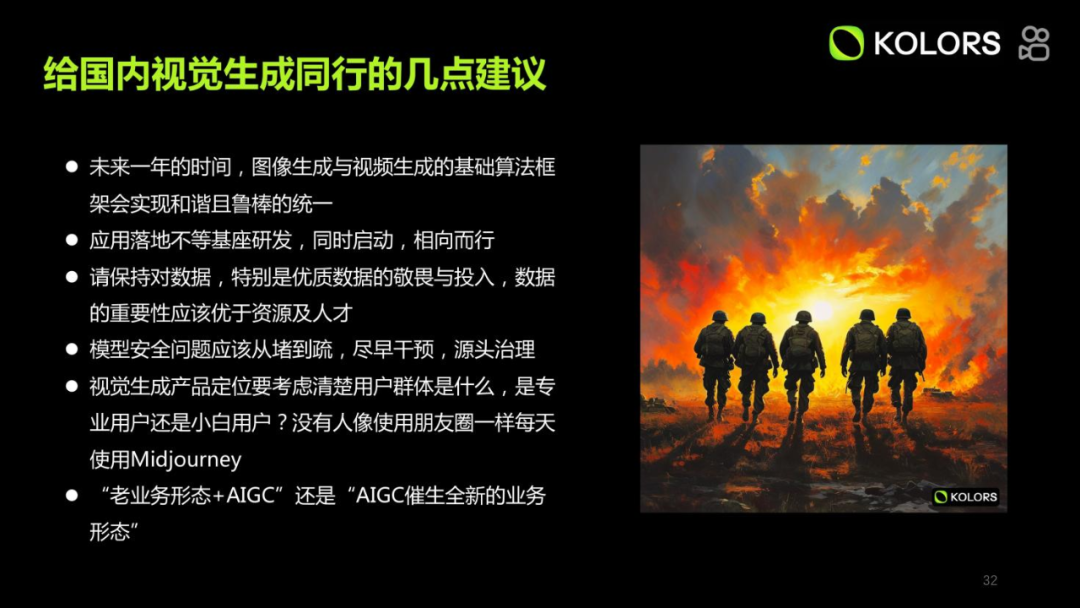

这张“兄弟连”的图像是可图大模型生成的,它象征着可图团队过去一年在逆境中砥砺前行,走过了炮火与硝烟,最终迎来了朝阳和希望,同时这个画面也象征着中国国产大模型过去一年的艰辛,行业的困难,资源的封锁,都挡不住国产大模型向前的决心。我们也希望用这张图把中国大模型赛道里的兄弟企业团结起来,打破封锁,形成我们自己的特色,建立我们自己的优势。最后,我们结合过去一年的从业经历,为国内视觉生成同行贡献六点建议:

-

未来一年,图像生成与视频生成的基础算法框架会实现和谐且鲁棒的统一。目前,尽管 Sora 类技术已经展示出 DiT 在视频生成和图像生成方面的统一能力,但是一个通用模型同时在两个子问题上的生成效果均达到行业 SOTA(图像生成效果超 Midjourney V6,视频生成效果超 Sora)还是有一定技术挑战的。不过,我们有信心行业可以在一年左右的时间内达到这个目标。

-

应用落地不等基座研发,同时启动,相向而行。很多公司目前都在进行基座模型的研发,但是基座模型研发和业务应用落地同等重要,我们给出的建议是两个事情要同时启动,相向而行,应用落地探索不要被动的依赖自家的基座模型,建议初期借助开源模型探索技术方案,随着自研基座模型效果的迭代,逐步完成平滑切换,这样效率会高很多。

-

请保持对数据,特别是优质数据的敬畏与投入,数据的重要性应该优于资源及人才。大模型时代,数据的重要性是大于资源和人才的。资源方面,虽然中美关系给国内的资源获取造成了比较大的困难,但是我们也应该看到国产芯片最近几年的发展趋势,所以长期看资源是乐观的,当然这也非常需要我们这些行业从业者去相信并且支持我们自己的国产芯片,多给他们一些机会。人才方面,中国大陆的 AI 人才在素质上并不逊色于北美,如果非要说有差距,其实这个差距主要还是来源于经验认知,而大模型时代的认知是需要用真金白银(GPU)去建立的,北美的资源确实存在短时优势,人才也就相应地存在一些认知优势,但是这种优势会随着资源问题的解决而慢慢的消失。

-

模型安全问题应该从堵到疏,尽早干预,源头治理。这个比较直观,生成式模型训练的时候不去干预训练数据,而是在使用的时候寄希望于风控能力,这种临时抱佛脚是非常危险的行为。所以我们呼吁安全问题还是要回到源头进行治理。

-

视觉生成产品定位要考虑清楚用户群体是什么,是专业用户还是小白用户?没有人像使用朋友圈一样每天使用 Midjourney。尽管 Midjourney 非常受欢迎,但其用户规模和日活跃用户数量显示,它并没有像微信朋友圈一样成为大众日常频繁使用的工具。所以,从业者要想清楚我们是要做专业的工具工作台去服务专业人群,还是要做简单易用的日常功能去服务大众,这二者将是完全不同的设计思路。

-

“老业务形态 +AIGC”还是“AIGC 催生全新的业务形态”。以电商场景为例,利用 AIGC 技术将普通商品素材转化为优质商品素材(例如,白底图到 AIGC 背景图),它所能带来的业务价值相对有限,因为电商平台的核心竞争力终究是“价格力”,这就叫“老业务形态 +AIGC”,即业务形态还是原来的样子,大差不差,只不过其中某些元素借助 AIGC 进行了升级。另一种模式是“AIGC 催生全新的业务形态”,比如虚拟试穿,这个能力在 2024 年之前是不成熟的,完全不可用于商业场景,但是随着大模型技术的发展,不可能变成了可能,这将影响整个电商行业的游戏规则。试想一下,以前都是衣服卖出去了才能看到“买家秀”;现在衣服一件没卖,“买家秀”却能出来一大堆,这对于现有的买卖逻辑将会形成什么样的冲击,未来内容电商、货架电商的格局会发生什么变化,我们一起拭目以待。

六、写在最后

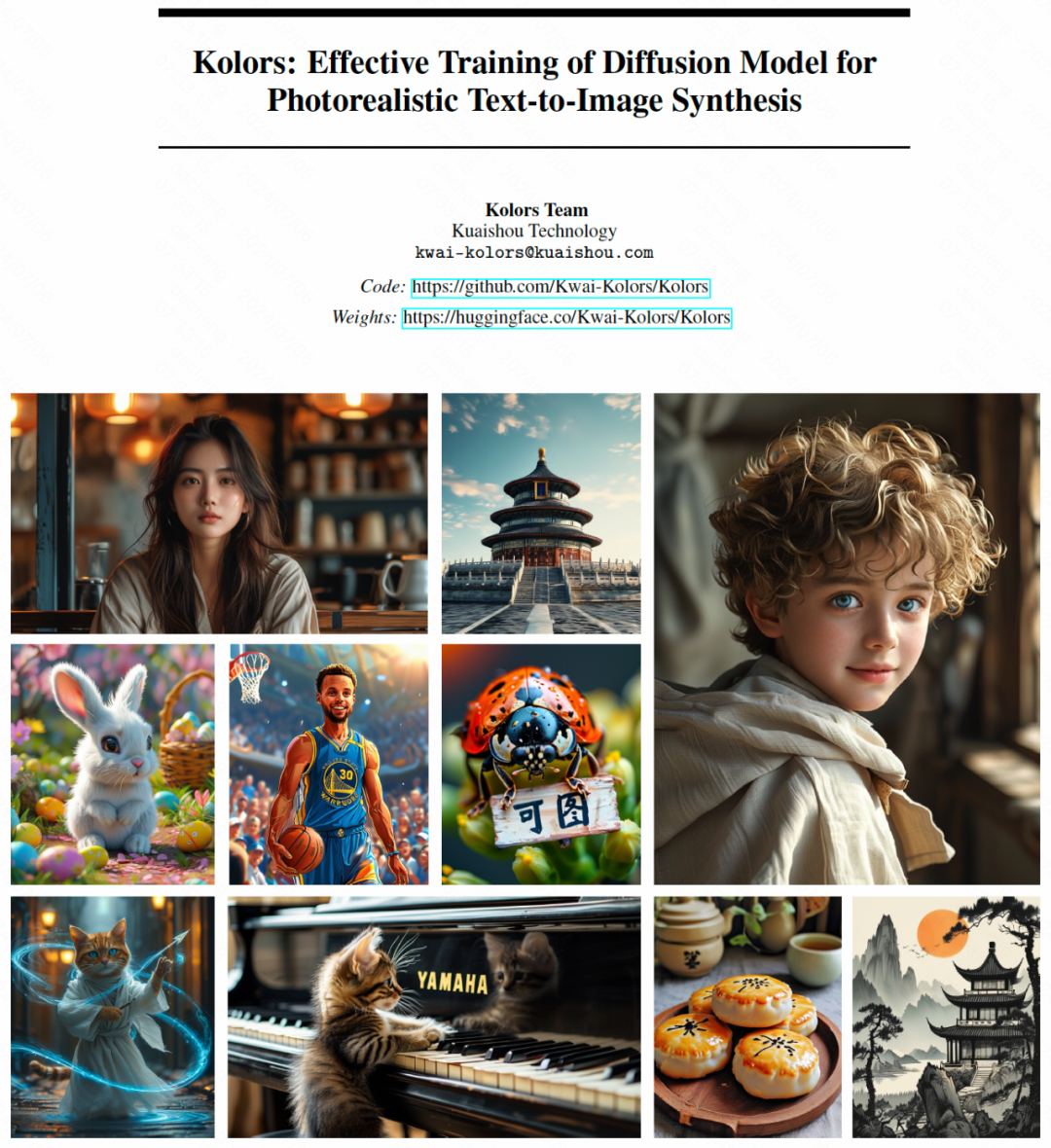

7 月 6 日,快手高级副总裁、主站业务与社区科学负责人盖坤(于越)在世界人工智能大会(WAIC)上宣布,快手旗下的可图 Kolors 大模型将全面开源。Kolors 支持中英文双语,生成效果比肩 Midjourney-v6 水平,支持长达 256 字符的文本输入,具备英文和中文写字能力。目前,Kolors 已在 Hugging Face 平台和 GitHub 上线,包括模型权重和完整代码,供个人开发者免费使用。

-

官网地址:https://kwai-kolors.github.io/

-

Github 项目地址:https://github.com/Kwai-Kolors/Kolors

-

Hugging Face 模型地址:https://huggingface.co/Kwai-Kolors/Kolors

-

技术报告地址:https://github.com/Kwai-Kolors/Kolors/blob/master/imgs/Kolors_paper.pdf

在最近的智源 FlagEval 文生图模型评测榜单中,Kolors 凭借其卓越表现,主观综合评分全球第二,仅次于闭源的 DALL-E 3。尤其在主观图像质量上,Kolors 表现显著优于其他开源和闭源模型,评分排名第一。

Kolors 开源短短几天,在 Github 已收获 2.5k stars,在 Hugging Face 也登上了模型 Trending 榜榜首,截止本文撰稿前已被下载数万次。目前开源社区反响热烈,已经有开发者提供了加速、ComfyUI 等周边能力。这一系列开源动作,将为开发者提供更加全面和多样的工具资源,进一步丰富文生图领域的开源生态,为探索更多的应用场景和技术创新提供便利,共同推动文生图技术的进步和普及。可图,未来可期。