随着大型语言模型(LLMs)的进步,多模态大型语言模型(MLLMs)迅速发展。它们使用预训练的视觉编码器处理图像,并将图像与文本信息一同作为 Token 嵌入输入至 LLMs,从而扩展了模型处理图像输入的对话能力。这种能力的提升为自动驾驶和医疗助手等多种潜在应用领域带来了可能性。

点击访问我的技术博客https://ai.weoknow.com![]() https://ai.weoknow.com

https://ai.weoknow.com

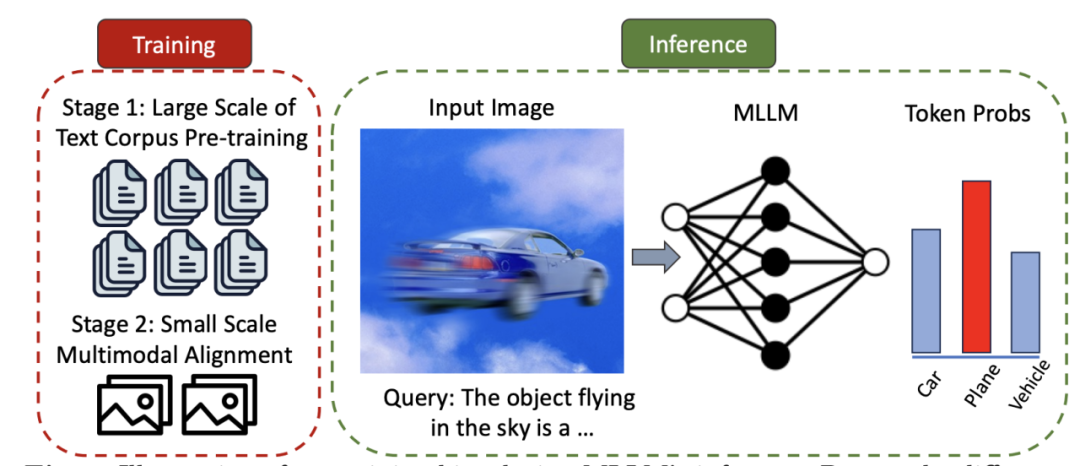

尽管 MLLMs 具有出色的图文理解能力,但它们仍然会出现错误或幻觉,生成与输入图像不相符的相应,例如回答不存在的对象或错误识别属性等。我们认为多模态大模型在不同训练阶段的数据量和训练时间的不平衡是产生这类偏见的主要原因之一。多模态大模型的语言模块往往使用了海量的文本数据进行预训练,而模态对齐阶段则使用更小的数据规模和更短的训练时间。

为了解决上述问题,我们提出了一种偏好对齐方法 --Bootstrapped Preference Optimization(BPO),能在缓解多模态大模型的幻觉现象的同时提升模型的视觉理解能力。

-

论文标题:Strengthening Multimodal Large Language Model with Bootstrapped Preference Optimization

-

论文链接:https://arxiv.org/pdf/2403.08730

-

代码链接:https://github.com/pipilurj/bootstrapped-preference-optimization-BPO-

具体来讲,我们设计了两种方法去自动构建偏好学习的负样本,使得多模态模型对与训练的过度依赖暴露出来。之后,我们用原本的数据标注当作正样本,对多模态模型进行偏好微调。总的来说,我们的主要贡献有:

1. 我们提出了一种新的视角,将多模态对齐问题转化为偏好学习任务,其中预训练偏见和视觉理解能力被视为旧的和新的偏好;

2. 我们介绍了一种自动化构建大规模偏好数据集的方法。通过该方法能构造出大量带有预训练偏见信息的负面样本;

3. 在大量实验上证明了我们的方法能有效地提升多模态大模型对于图像的认知能力,训练后的模型在多个基准测试中性能得到提升。

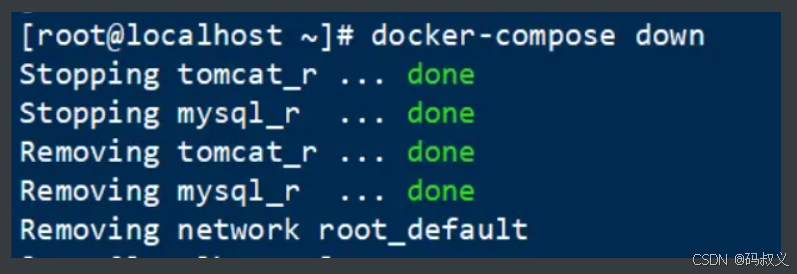

可扩展的偏好数据集构建

对于偏好数据集的正面样本,已经有许多为监督微调而设计的现成数据集,例如通过 LlaVA 和 MiniGPT4 生成的高质量标注问答数据、ShareGPTV 利用强大的 GPT4-V 作为工具为图像生成高质量标题。我们将这些已标注完成的公开数据集作为偏好数据集中的正面响应,在保证高质量数据对的同时避免了昂贵的人工标注。

为了能收集到能反映预训练偏见的负面响应数据,我们提出了两种方法。

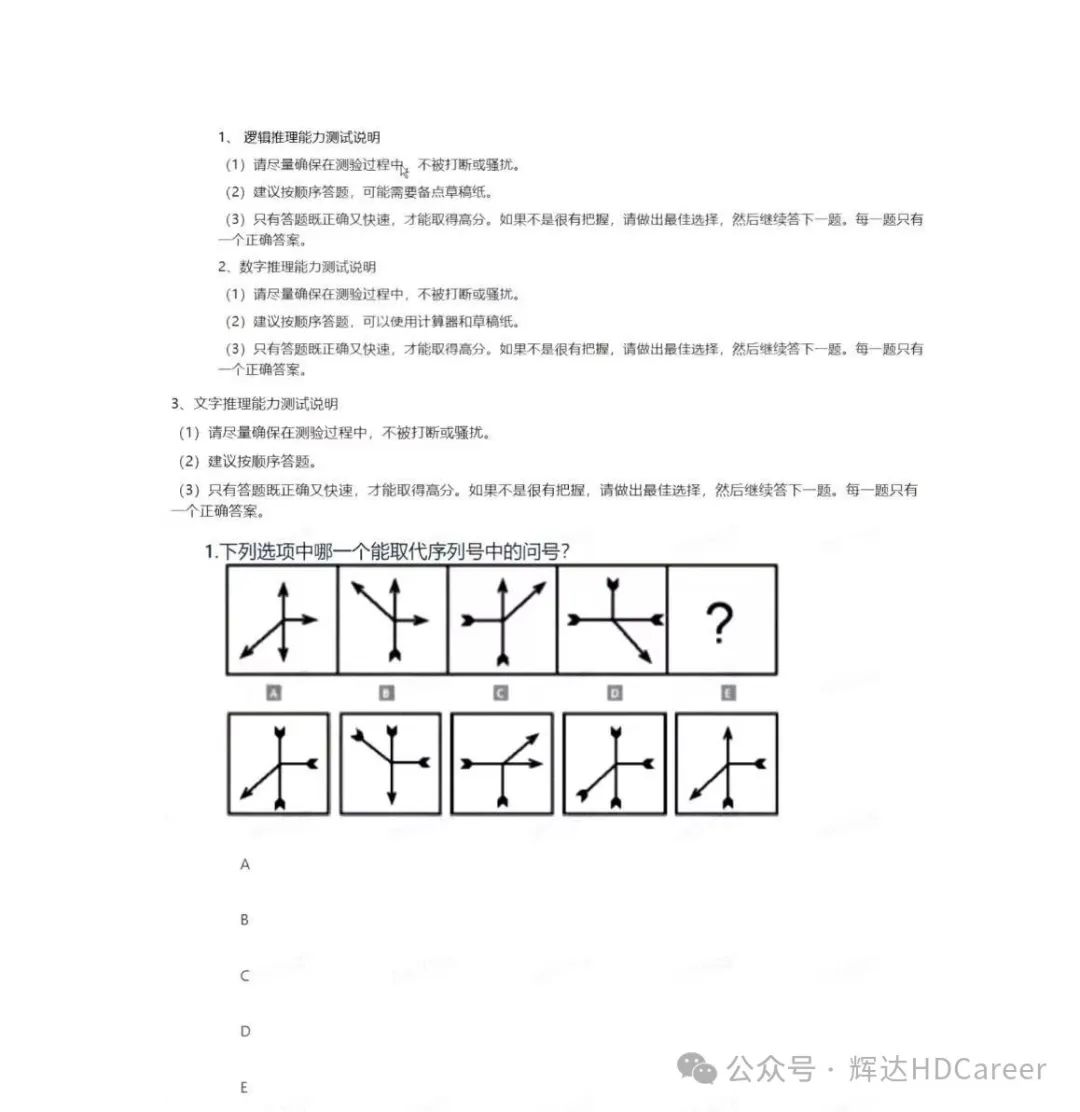

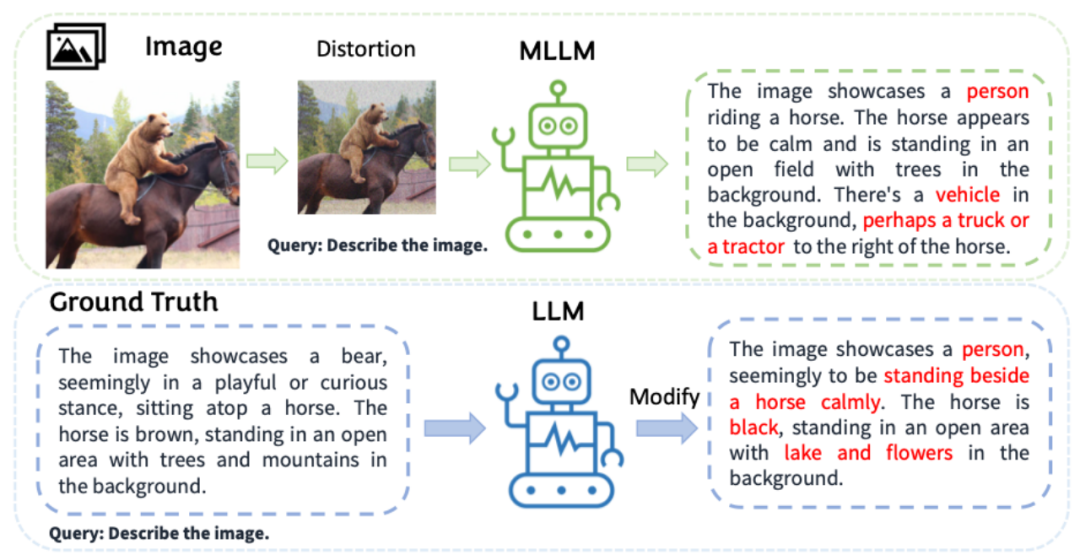

a. 弱化图像提示:我们给偏好数据集中的图片数据加上噪声,以此破坏图像特征,使多模态大模型在回答时更倾向原始的预训练分布,由此产生的错误响应会包含 LLM 模块的固有偏见。从图中可以看到,我们通过像图片中加入不同程度的噪声,正确答案出现的概率就越小,带有预训练偏见的答案出现的概率也就越大。

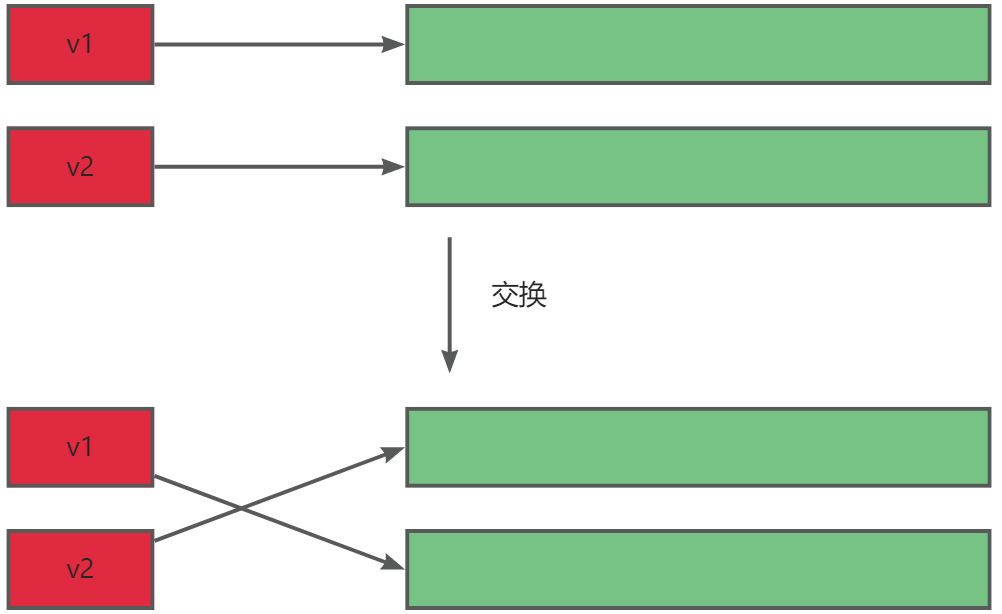

b. 错误注入:我们要求多模态大模型对应的大语言模型直接改写响应,要求模型生成与答案相近但不完全一样的错误回答。

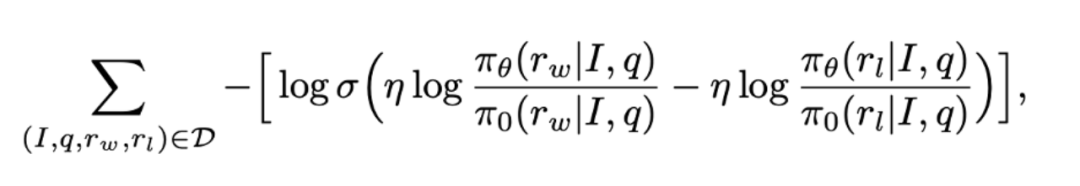

接下来,我们采用直接偏好优化(DPO)对多模态模型进行优化:

实验评估

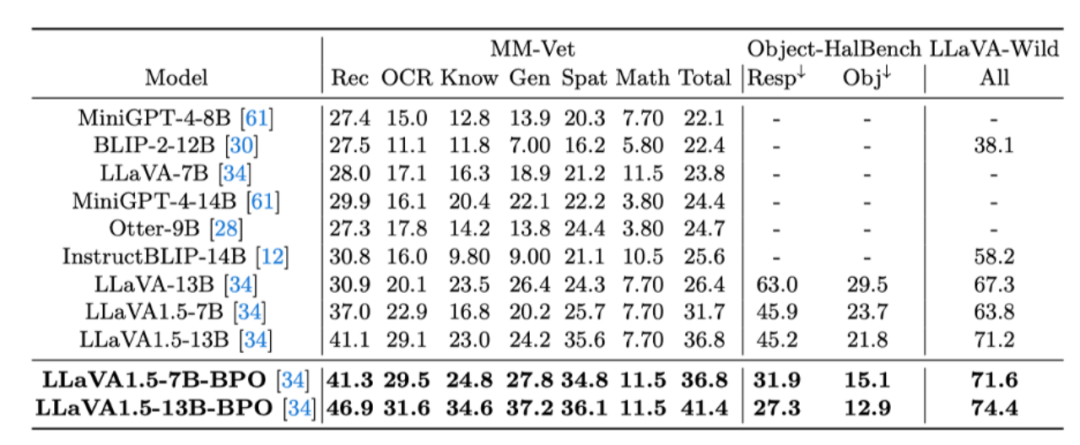

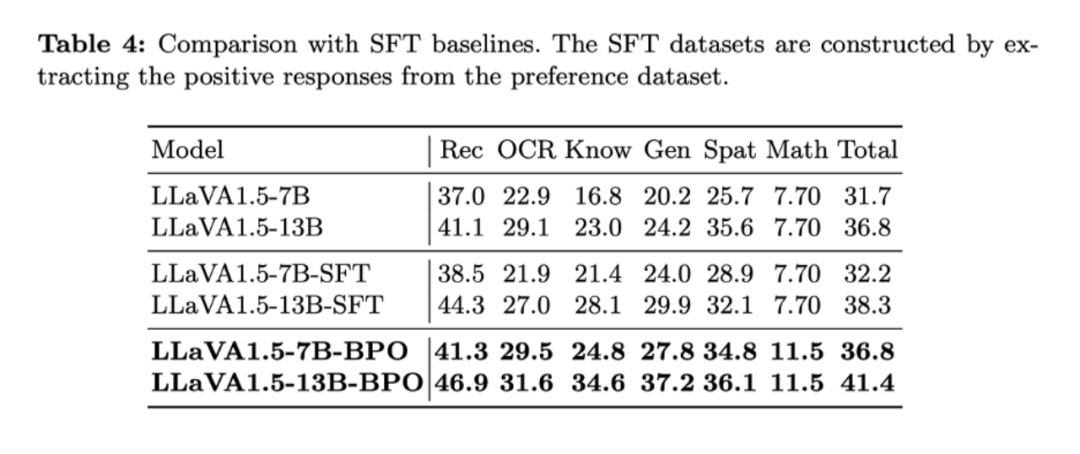

我们采用经过 BPO 微调过后的 LLaVA 模型(LLaVA-7B-BPO 和 LLaVA-13B-BPO)在 MM-Vet,LLaVA-Wild 和 Object HalBench 上测试。MM-Vet 和 LlaVA-Bench 是专门用来衡量模型综合能力的榜单,Object HalBench 则是评估多模态大模型的视觉可信度。

实验结果表明,经过 BPO 微调后的模型在三个基准测试榜单的所有任务中均取得领先。在大多数任务上,LLaVA-7B-BPO 的表现甚至超过了未曾微调的 LLaVa1.5-13B 模型。

我们还将 BPO 与监督微调训练(SFT)进行对比。我们通过直接使用数据集中的正样本作为监督数据对模型进行微调。实验表明经过 BPO 微调过的多模态大模型在不同类别的子任务下的表现均优于 SFT 微调。

在定性结果上,我们对比了 BPO 微调前后多模态大模型的表现。我们发现经过 BPO 微调后的模型能生成更忠诚于图像输入的答案,并且包含更少错误信息。

更多研究细节,可参考原论文。

![无缝融入,即刻智能[2]:MaxKB内置强大工作流引擎,编排AI工作流程,满足多样化业务需求](https://img-blog.csdnimg.cn/img_convert/6d679b21f14952b3a4e13128f7b5c891.jpeg)