Win11安装 langchain-chatchat 0.3.1最新版

1. 虚拟环境安装和python包安装

conda create -n chat310 python=3.10

#这里很重要 需要先安装cuda版本的torch

pip install torch==2.3.1 torchvision==0.18.1 torchaudio==2.3.1 --index-url https://download.pytorch.org/whl/cu121

pip install "xinference[all]"

pip install "langchain-chatchat[xinference]" -U

可能遇到的问题

- No module named ‘Cython’

conda install -c conda-forge pynini=2.1.5

2. 启动xinference

新建一个终端

输入以下命令:

# win11改用用127.0.0.1,官方推荐是0.0.0.0(适合linux)

xinference-local --host 127.0.0.1 --port 9997

#

可能遇到的问题

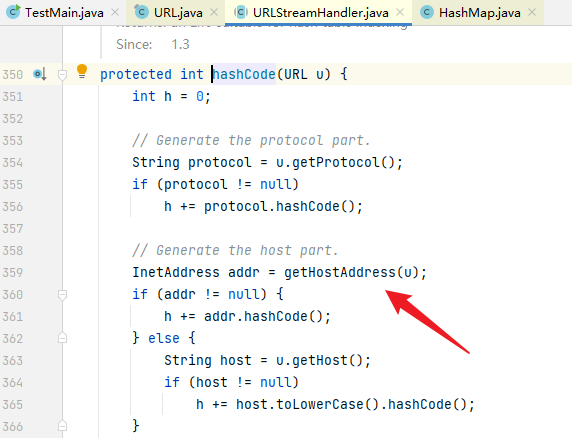

出现:RuntimeError: Cluster is not available after multiple attempts 这个报错

3.再新建一个终端,进行chatchat的一系列初始化:

可以看出默认配置是glm4-chat和bge-m3,这在linux系统是可行的,

但是在windows会出现报错,原因是不支持,所以要修改成下面的,下面也是官方推荐的:

修改 model_settings.yaml

# 默认选用的 LLM 名称 我这里选择了 qwen2-instruct

DEFAULT_LLM_MODEL: qwen1.5-chat

# 默认选用的 Embedding 名称

DEFAULT_EMBEDDING_MODEL: bge-large-zh-v1.5

4. xinference启动模型

如果前面安装了cuda版本的torch,下面N-GPU那里记得选 GPU

-

xinference启动qwen-instruct

启动后会显示:

-

xinference启动bge-base-zh-v1.5

同理显示:

终端显示:

5.初始化数据库

新建一个终端,依次执行下面的命令。环境还是原来的

#初始化数据库,确保xinference已经启动对应的llm和embedding模型 这里如果前面环境没有安装好,初始化会比较慢

chatchat kb -r

# 启动项目

chatchat start -a

# 上面命令执行,浏览器会自动打开 http://127.0.0.1:8501/