💛前情提要💛

本文是传知代码平台中的相关前沿知识与技术的分享~

接下来我们即将进入一个全新的空间,对技术有一个全新的视角~

本文所涉及所有资源均在传知代码平台可获取

以下的内容一定会让你对AI 赋能时代有一个颠覆性的认识哦!!!

以下内容干货满满,跟上步伐吧~

📌导航小助手📌

- 💡本章重点

- 🍞一. 概述

- 🍞二. 研究背景

- 🍞三.模型结构和代码

- 🍞四. 数据集介绍

- 🫓总结

💡本章重点

- 记忆注意力用于多模态情感计算!

🍞一. 概述

近年来,社交媒体的快速扩张推动了用户生成内容的大幅增加,特别是视频。跨不同模态的自动情感分析已成为旨在增强人机交互的关键研究领域。情感分析最初专注于提取和分析通过文本传达的情感。然而,随着计算能力的提高和视听通信的兴起,多模态情感分析(MSA)已经出现。这种方法集成了文本,音频和视觉输入,以加深对人类情感的理解。MSA在教育、客户反馈分析、心理健康监测和个性化广告等多个领域都有应用,显著增强了我们在各种沟通形式中解释和应对情感线索的能力。多模态情感分析(MSA)试图整合来自视觉,听觉和文本来源的情感线索来预测说话者的情感状态或倾向。然而,这些模式的情绪信号可能会有微妙的变化。下图示出了MSA的好处,展示了添加视觉和音频信息可以提高在歧义句和不同上下文中情感极性预测的准确性。

此外,由于现如今大多数的情感计算数据集都是基于英文语言开发的,所以我加入了中文数据集(SIMS, SIMSv2)应用在模型中,以开发适用于国人的情感计算分析模型,在未来,我也计划加入更多小众数据集,以便检测更隐匿的情感,如嫉妒、嘲讽等,使得AI可以更好的服务于社会。

🍞二. 研究背景

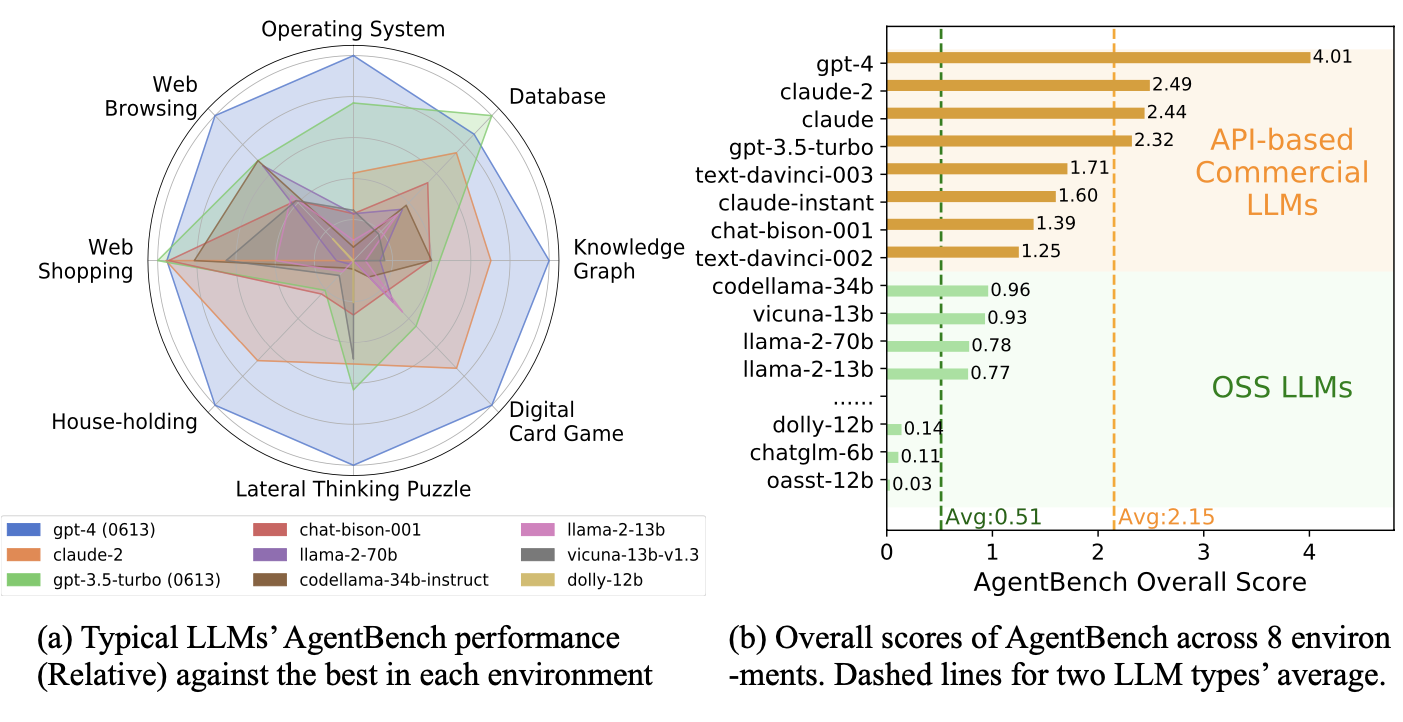

随着多模态数据量的迅速增加,多模态情感分析(MSA)越来越受到关注。该方法通过整合不同数据模态间的信息,提高了情感极性提取的准确性,从而实现了信息的全面融合,提高了情感分析的精度。然而,当前的深度模型往往忽视了全局记忆信息,无法有效地辅助情感分析,因此我将介绍一种新的记忆注意力模块;此外现如今的研究表明,文本模态相对于其他模态拥有更丰富和准确的情感信息,因此,我提出了一个新的文本增强模块。

🍞三.模型结构和代码

1. 记忆注意力模块(EM)

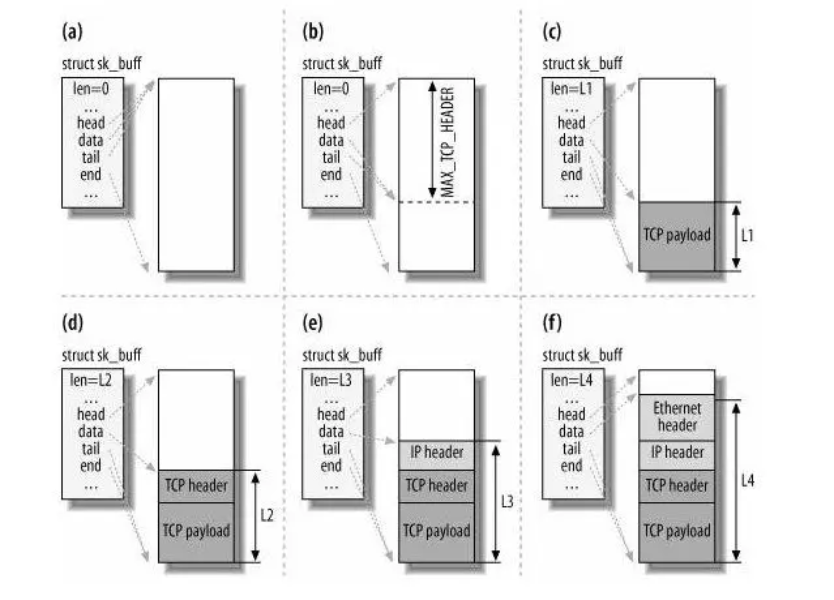

记忆模块在多模态情感计算中起着关键作用,它允许模型通过注意机制根据查询动态地访问和整合记忆中的信息,从而增强特征的表达能力,使模型能够更准确地理解和捕捉复杂的情感内容。此外,EM可以存储和检索多模态数据中的关键信息,帮助模型减少噪声或不完整数据的不确定性,并提高情感分析任务的准确性和效率,并且通过动态更新和学习如何整合不同模态数据之间的关系,还使模型能够在训练后通过推广到以前看不见的数据来表现良好,保持高效和准确。同时,EM模块应用于所有三种模式(文本、视觉和声学)。

在这个阶段,我们拥有包含关键记忆信息的特征,用于后续的特征交互。

代码实现

class ExternalMemory(nn.Module):

def __init__(self, text_dim, mem_size):

super(ExternalMemory, self).__init__()

self.text_dim = text_dim

self.mem_size = mem_size

# 外部记忆矩阵

self.memory = nn.Parameter(torch.randn(mem_size, text_dim))

# Linear transformations

self.query_transform = nn.Linear(text_dim, text_dim)

self.key_transform = nn.Linear(text_dim, text_dim)

self.value_transform = nn.Linear(text_dim, text_dim)

def forward(self, query):

# 将输入的查询向量query进行线性变换,得到变换后的查询向量。这个变换的目的是将查询向量调整到与记忆矩阵相同的维度,以便进行后续的注意力计算。

query = self.query_transform(query) # (batch_size, text_dim)

# 使用self.key_transform(self.memory)和self.value_transform(self.memory)分别对外部记忆矩阵进行键和值的线性变换,

# 得到变换后的键矩阵和值矩阵。这些变换将外部记忆中的每个条目映射到与查询向量相同的空间。

key = self.key_transform(self.memory) # (mem_size, text_dim)

value = self.value_transform(self.memory) # (mem_size, text_dim)

# 通过矩阵乘法torch.matmul(query, key.t())计算查询向量与每个键之间的点积注意力分数。

# 这里使用了缩放点积注意力机制,通过除以math.sqrt(self.text_dim)来缩放注意力分数,其中self.text_dim是查询和键的维度大小

scores = torch.matmul(query, key.t()) / math.sqrt(self.text_dim) # (batch_size, mem_size)

# 对注意力分数应用softmax函数F.softmax(scores, dim=-1),得到注意力权重,表示每个外部记忆条目对查询的重要性。

attention_weights = F.softmax(scores, dim=-1) # (batch_size, mem_size)

# 使用注意力权重对值矩阵进行加权求和,计算加权平均值。weighted_sum表示基于注意力机制加权后的记忆信息.

weighted_sum = torch.matmul(attention_weights.unsqueeze(1), value.unsqueeze(0)) # (batch_size, 1, text_dim)

weighted_sum = weighted_sum.squeeze(1) # (batch_size, text_dim)

return weighted_sum

2. 文本增强模块

模块的核心组件是跨模态嵌入单元。该单元利用跨模态注意力机制捕捉长程非文本情感信息,并生成基于文本的非语言嵌入。嵌入层的参数是可学习的,用于将经过特征转换策略处理后的非文本索引向量映射到高维空间,进而生成文本模态对非文本模态的注意力权重矩阵。换句话说,这一单元通过复杂的神经网络结构,有效地整合了不同模态之间的信息交互,从而提升了情感分析任务的多模态处理能力。

训练开始阶段,由于语言表征和非语言表征处于不同的特征空间,它们之间的相关性通常较低。因此,注意力权重矩阵中的元素可能较小。为了更有效地学习模型参数,研究者在应用 softmax 函数之前使用超参数来缩放这些注意力权重矩阵。

基于注意力权重矩阵,可以生成基于文本的非语言向量。将基于文本的声学嵌入和基于文本的视觉嵌入结合起来,形成非语言增强嵌入。最后,通过整合非语言增强嵌入来更新文本的表示。因此,该模块的提出旨在为文本提供非语言上下文信息,通过增加非语言增强嵌入来调整文本表示,使其在语义上更加准确和丰富。

🍞四. 数据集介绍

-

CMU-MOSI: 它是一个多模态数据集,包括文本、视觉和声学模态。它来自Youtube上的93个电影评论视频。这些视频被剪辑成2199个片段。每个片段都标注了[-3,3]范围内的情感强度。该数据集分为三个部分,训练集(1,284段)、验证集(229段)和测试集(686段)。

-

CMU-MOSEI: 它类似于CMU-MOSI,但规模更大。它包含了来自在线视频网站的23,453个注释视频片段,涵盖了250个不同的主题和1000个不同的演讲者。CMU-MOSEI中的样本被标记为[-3,3]范围内的情感强度和6种基本情绪。因此,CMU-MOSEI可用于情感分析和情感识别任务。

-

SIMS/SIMSV2: CH-SIMS数据集是一个中文多模态情感分析数据集,为每种模态提供了详细的标注。该数据集包括2281个精选视频片段,这些片段来自各种电影、电视剧和综艺节目,每个样本都被赋予了情感分数,范围从-1(极度负面)到1(极度正面)

性能展示

在情感计算任务中,通过对比实验和消融实验,可以看到我们的模块使得模型性能明显提高,证明了其有效性;

1. 对比实验:

2. Case Study:

运行过程

- 训练过程

- 最终结果

🫓总结

综上,我们基本了解了“一项全新的技术啦” 🍭 ~~

恭喜你的内功又双叒叕得到了提高!!!

感谢你们的阅读😆

后续还会继续更新💓,欢迎持续关注📌哟~

💫如果有错误❌,欢迎指正呀💫

✨如果觉得收获满满,可以点点赞👍支持一下哟~✨

【传知科技 – 了解更多新知识】