文章目录

- 往期热门专栏回顾

- 1、前言介绍

-

- 1.1、文生图效果

- 2、LoRA的工作原理

- 3、LoRA的应用场景

- 4、LoRA的优势

- 5、LoRA的挑战

- 6、LoRA的实现

- 7、未来展望

1、前言介绍

在深度学习和自然语言处理领域,大规模预训练模型(如GPT-3、BERT等)已经展示了强大的能力。然而,训练这些模型需要大量的计算资源和数据,这对于许多组织和个人来说并不现实。LoRA(Low-Rank Adaptation)作为一种轻量级的微调方法,提供了一种高效且经济的解决方案。本文将详细介绍LoRA的工作原理、应用场景、以及其在大模型微调中的优势和挑战。

1.1、文生图效果

提示词:

//quality, (masterpiece:1.3), (detailed), ((,best quality,)),//,cute,1girl,//,brown cat ears,animal ear fluff,(light_brown hair:1.3),(red hair: 1.1),(red inner hair: 1.4), (straight bangs: 1.4),(,long_hair,single braid :1.4),(Ahoge),(detailed eyes,blue_eyes:1.4),medium chest,//, (yellow hairpin,crescent-shaped hairpin:1.4),off_shoulders,large red ribbon,(idol costume:1.4),thigh strap,frilled skirt,gloves,//,blush,smiling,upper_teeth,looking_down,//,hand_up,(holding microphone:1.3),(standing on stage),//,indoors,crowd of audience,Glow stick,scenery,colorful light particles,(colorful lights:1.3),(laser light:1.4),glow_in_the_dark,cowboy_shot,dynamic angle

反向提示词:

NSFW,text,(worst quality:1.331), (low quality:1.331), (normal quality:1.331), large head, extra digits, bad eye, extra fingers, fewer fingers, strange fingers, ((bad hands)), Strange eyes, Many hands, (Many arms), EasyNegativeV2, ng_deepnegative_v1_75t, pregnancy, badhandv4, six fingers, fused fingers, unclear eyes,poorly drawn,cloned face,bad face,

在提示词、反向提示词不变的情况下,我们在导入多个LoRA,并且调整参数,来生成我们想要的图片。

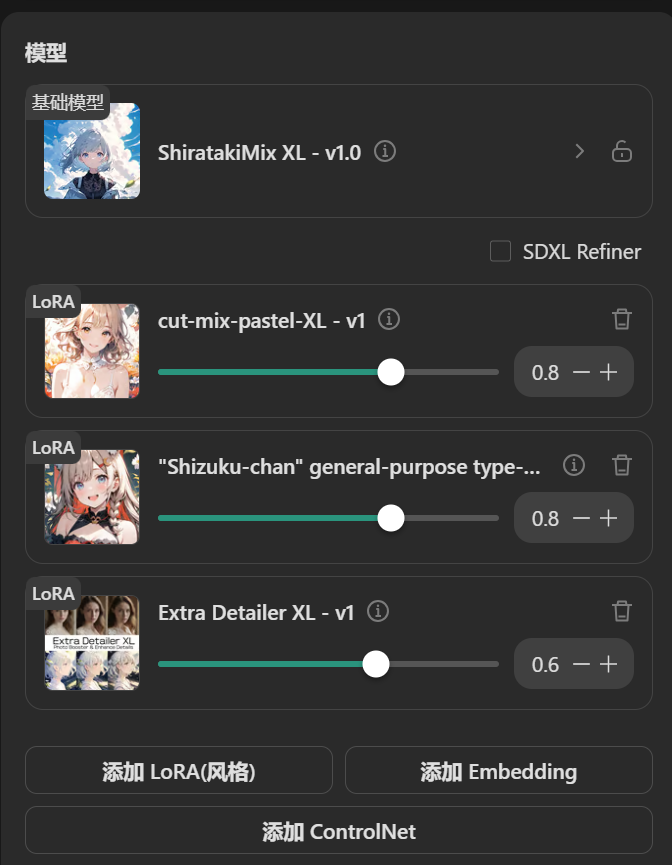

三个LoRA:

调整LoRA值之后的效果:

2、LoRA的工作原理

LoRA通过引入低秩矩阵分解技术来微调大型预训练模型。其核心思想是将预训练模型的权重矩阵分解为两个低秩矩阵的乘积,从而减少需要微调的参数数量。具体而言,LoRA假设原始权重矩阵W可以近似表示为两个低秩矩阵A和B的乘积,即W ≈ AB,其中A和B的秩远小于W的秩。

在微调过程中,LoRA仅优化低秩矩阵A和B,而保持原始模型权重W不变。这种方法不仅降低了计算复杂度,还减少了存储和传输的开销,使得微调过程更加高效。

3、LoRA的应用场景

-

自然语言处理(NLP): LoRA在NLP任务中表现出色,如文本分类、机器翻译、情感分析等。通过微调预训练模型,LoRA可以快速适应不同的语言任务和数据集。

-

计算机视觉: 在图像分类、目标检测和图像生成等任务中,LoRA也展示了强大的适应能力。通过微调预训练的视觉模型,LoRA可以在有限的计算资源下实现高效的图像处理。

-

语音识别: LoRA在语音识别和语音生成任务中同样具有广泛的应用前景。通过微调预训练的语音模型,LoRA可以有效提升语音识别的准确性和生成质量。

4、LoRA的优势

-

高效性: LoRA通过低秩矩阵分解显著减少了需要微调的参数数量,从而降低了计算复杂度和存储开销。这使得微调过程更加高效,尤其适合资源受限的环境。

-

灵活性: LoRA可以应用于各种预训练模型和任务,具有广泛的适应性。无论是NLP、计算机视觉还是语音识别,LoRA都能提供有效的微调方案。

-

经济性: 相对于全量微调(fine-tuning)大模型,LoRA需要的计算资源和时间成本大大降低。这对于小型团队和个人研究者来说尤为重要,使他们能够在有限的资源下实现高效的模型优化。

5、LoRA的挑战

-

低秩近似的局限性: LoRA依赖于低秩矩阵分解来近似表示权重矩阵。然而,在某些情况下,低秩近似可能无法充分捕捉复杂的模型结构和数据特征,导致性能下降。

-

模型选择的复杂性: 在实际应用中,不同任务和数据集对模型的需求各不相同。选择合适的预训练模型和微调策略仍然是一个挑战,需要进行大量的实验和调优。

-

安全性和隐私: 在微调过程中,模型可能会接触到敏感数据。如何在保证数据安全和隐私的前提下进行高效的微调,是LoRA面临的另一个重要挑战。

6、LoRA的实现

为了更好地理解LoRA的实际应用,以下是一个基于PyTorch的LoRA实现示例。

import torch

import torch.nn as nn

class LoRA(nn.Module):

def __init__(self, model, rank=4):

super(LoRA, self).__init__()

self.model = model

self.rank = rank

self.low_rank_modules = nn.ModuleList()

for name, module in model.named_modules():

if isinstance(module, nn.Linear):

in_features, out_features = module.in_features, module.out_features

A = nn.Parameter(torch.randn(out_features, rank))

B = nn.Parameter(torch.randn(rank, in_features))

self.low_rank_modules.append((name, A, B))

def forward(self, x):

for name, A, B in self.low_rank_modules:

module = dict(self.model.named_modules())[name]

W = module.weight

low_rank_weight = A @ B

module.weight = nn.Parameter(W + low_rank_weight)

return self.model(x)

7、未来展望

随着深度学习和大规模预训练模型的发展,LoRA作为一种高效的微调方法,将在更多领域和应用中发挥重要作用。未来,LoRA可能会进一步优化低秩分解技术,提高近似的精度和效率。此外,LoRA还可以与其他优化技术结合,形成更强大的微调框架。

总之,LoRA为大规模预训练模型的高效微调提供了新的思路和方法。通过降低计算复杂度和存储开销,LoRA使得更多人能够利用预训练模型的强大能力,推动人工智能技术的普及和应用。期待未来LoRA在更多领域中的创新和突破,为深度学习的发展注入新的活力。

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

![BUUCTF [安洵杯 2019]easy_serialize_php](https://i-blog.csdnimg.cn/direct/b8216a3fc6cd4259bcac89ac8116559b.png)