引子

之前写过一篇CogVLM的分享,感兴趣的移步CogVLM/CogAgent环境搭建&推理测试-CSDN博客,前一阵子,CogVLMv2横空出世,支持视频理解功能,OK,那就让我们开始吧。

一、模型介绍

CogVLM2 系列模型开源了两款基于 Meta-Llama-3-8B-Instruct 开源模型。与上一代的 CogVLM 开源模型相比,CogVLM2 系列开源模型具有以下改进:

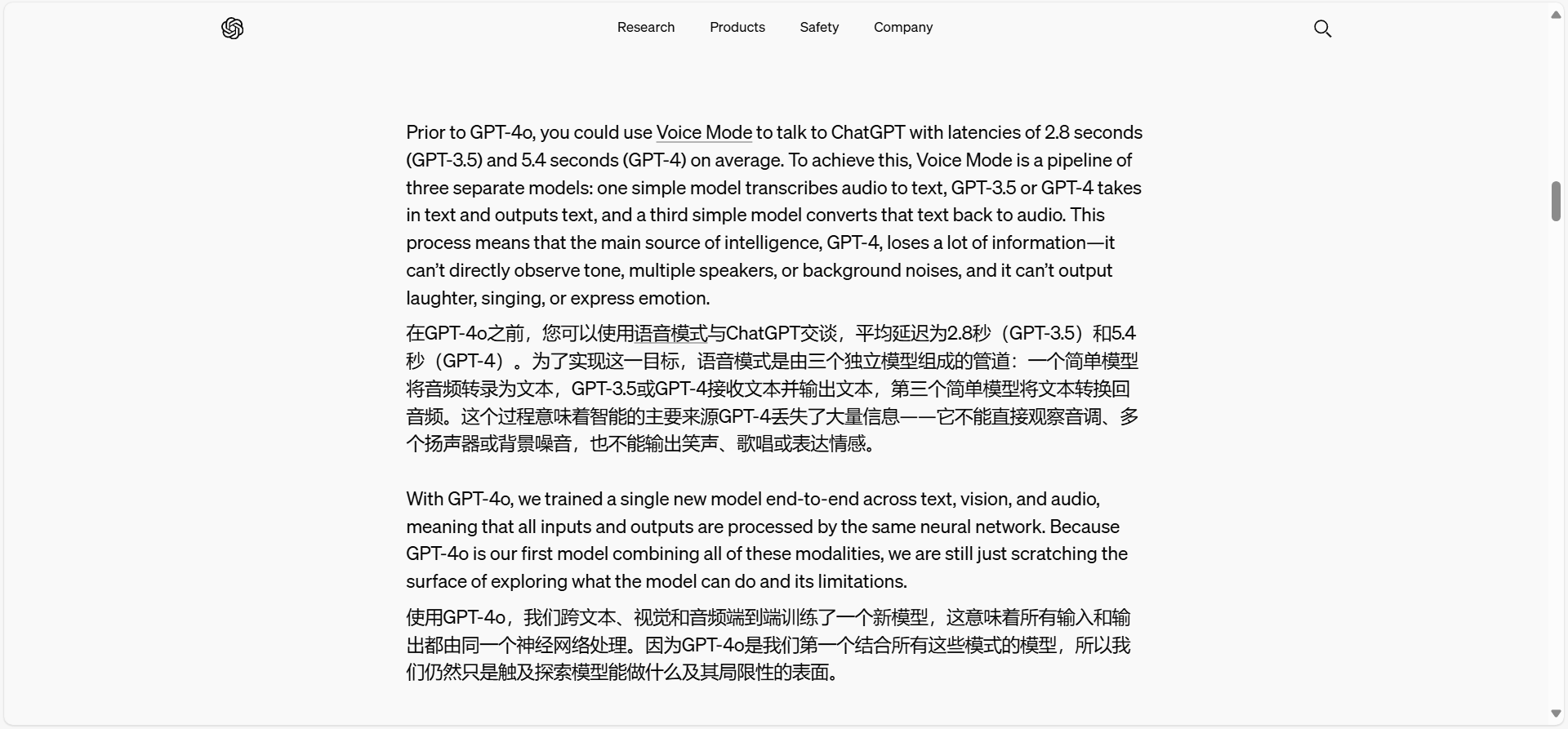

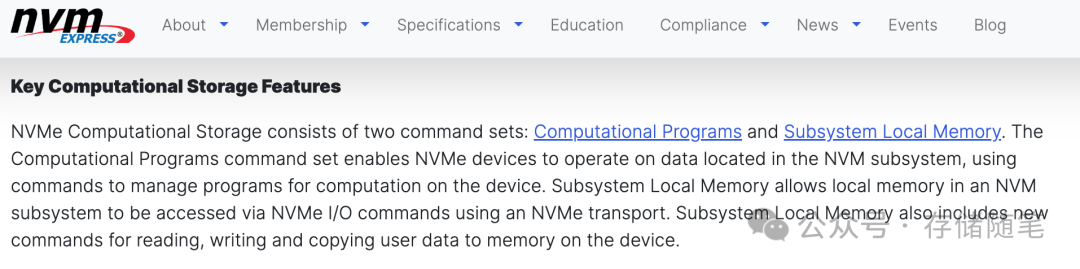

1、在许多关键指标上有了显著提升,例如 TextVQA, DocVQA。

2、支持 8K 文本长度。

3、支持高达 1344 * 1344 的图像分辨率。

4、提供支持中英文双语的开源模型版本。

二、安装环境

docker run -it --rm --gpus=all -v /datas/work/zzq:/workspace cog:v1.0 bash

git clone GitHub - THUDM/CogVLM2: GPT4V-level open-source multi-modal model based on Llama3-8B

pip install decord

pip install pytorchvideo

三、推理测试

1、模型下载

https://huggingface.co/THUDM/cogvlm2-video-llama3-chat/tree/main

2、CogVLM2测试

cd /workspace/CogVLMv2/CogVLM2

修改模型路径

python video_demo/cli_video_demo.py --quant 8

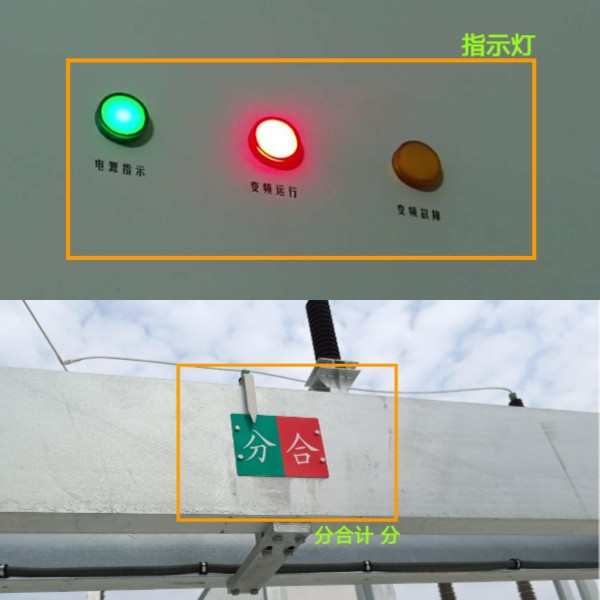

显存占用

测试结果