目录

一、引言

二、深度估计(depth-estimation)

2.1 概述

2.2 技术路径

2.3 应用场景

2.4 pipeline参数

2.4.1 pipeline对象实例化参数

2.4.2 pipeline对象使用参数

2.4 pipeline实战

2.5 模型排名

三、总结

一、引言

pipeline(管道)是huggingface transformers库中一种极简方式使用大模型推理的抽象,将所有大模型分为音频(Audio)、计算机视觉(Computer vision)、自然语言处理(NLP)、多模态(Multimodal)等4大类,28小类任务(tasks)。共计覆盖32万个模型

今天介绍CV计算机视觉的第一篇,深度估计(depth-estimation),在huggingface库内有106个图片深度估计的模型。

二、深度估计(depth-estimation)

2.1 概述

深度估计是一种计算机视觉任务,旨在从2D图像估计深度。该任务需要输入RGB图像并输出深度图像。深度图像包括关于从视点到图像中的物体的距离的信息,该视点通常是拍摄图像的相机。

2.2 技术路径

2014年之前,采用传统的方法进行深度估计,2014年之后采用深度学习方法,同时分为监督和半监督/无监督两条roadmap。

首先看一下基于深度学习方法depth-estimation的开山之作Depth Map Prediction from a Single Image using a Multi-Scale Deep Network

模型架构使用堆叠的卷积层预测,该论文发表于2014年,早于VGG,所以网络结构遵循AlexNet的设计。其希望捕捉全局信息和布局信息,蓝色框部分用于得到粗略的全局信息,而且Coarse 5和Coarse 6部分使用的是全连接层;橙色框部分处理原图和得到的全局信息,最终预测得到深度图。训练过程分为两步,第一步先训练coarse网络,然后冻结之后再训练fine网络。

再看2024年较火的由港大&字节提出用于任意图像的深度估计大模型:Depth Anything

- 首先, 基于数据集 Dl 学习一个老师模型 T;

- 然后, 利用 T 为数据集 Du 赋予伪标签;

- 最后, 基于两个数据训练一个学生模型 S 。

2.3 应用场景

- 自动驾驶与机器人导航:在自动驾驶车辆和各种服务机器人中,通过单目摄像头获取环境图像,估计出前方或周围物体的距离,对于避障、路径规划至关重要。

- 增强现实(AR):在AR应用中,准确估计摄像头与现实世界之间的深度关系,是实现虚拟物体与真实环境无缝融合的关键。

- 3D建模与重建:从单目视频或图像序列中估计深度,可以用于构建场景的3D模型,应用于考古、建筑、室内设计等领域。

- 无人机导航与避障:无人机在执行复杂飞行任务时,需要实时理解周围环境的深度信息,单目深度估计可以提供这种能力,尤其是在成本和重量敏感的应用中。

- 物体识别与抓取:在机器人操作和自动化仓库系统中,单目深度估计帮助机器人准确识别和抓取物体,提高自动化效率。

- 地形测绘:在无人机遥感、农业监测等应用中,单目相机结合其他传感器数据,可以辅助进行地形的快速测绘和分析。

2.4 pipeline参数

2.4.1 pipeline对象实例化参数

- model(PreTrainedModel或TFPreTrainedModel)— 管道将使用其进行预测的模型。 对于 PyTorch,这需要从PreTrainedModel继承;对于 TensorFlow,这需要从TFPreTrainedModel继承。

- image_processor ( BaseImageProcessor ) — 管道将使用的图像处理器来为模型编码数据。此对象继承自 BaseImageProcessor。

- modelcard(

str或ModelCard,可选)— 属于此管道模型的模型卡。- framework(

str,可选)— 要使用的框架,"pt"适用于 PyTorch 或"tf"TensorFlow。必须安装指定的框架。- task(

str,默认为"")— 管道的任务标识符。- num_workers(

int,可选,默认为 8)— 当管道将使用DataLoader(传递数据集时,在 Pytorch 模型的 GPU 上)时,要使用的工作者数量。- batch_size(

int,可选,默认为 1)— 当管道将使用DataLoader(传递数据集时,在 Pytorch 模型的 GPU 上)时,要使用的批次的大小,对于推理来说,这并不总是有益的,请阅读使用管道进行批处理。- args_parser(ArgumentHandler,可选) - 引用负责解析提供的管道参数的对象。

- device(

int,可选,默认为 -1)— CPU/GPU 支持的设备序号。将其设置为 -1 将利用 CPU,设置为正数将在关联的 CUDA 设备 ID 上运行模型。您可以传递本机torch.device或str太- torch_dtype(

str或torch.dtype,可选) - 直接发送model_kwargs(只是一种更简单的快捷方式)以使用此模型的可用精度(torch.float16,,torch.bfloat16...或"auto")- binary_output(

bool,可选,默认为False)——标志指示管道的输出是否应以序列化格式(即 pickle)或原始输出数据(例如文本)进行。

2.4.2 pipeline对象使用参数

- images(

str、List[str]或PIL.Image)List[PIL.Image]——管道处理三种类型的图像:

- 包含指向图像的 http 链接的字符串

- 包含图像本地路径的字符串

- 直接在 PIL 中加载的图像

管道可以接受单张图片或一批图片,然后必须以字符串形式传递。一批图片必须全部采用相同的格式:全部为 http 链接、全部为本地路径或全部为 PIL 图片。

- timeout(可选

float,默认为 None)— 等待从网络获取图像的最长时间(以秒为单位)。如果为 None,则不设置超时,并且调用可能会永远阻塞。

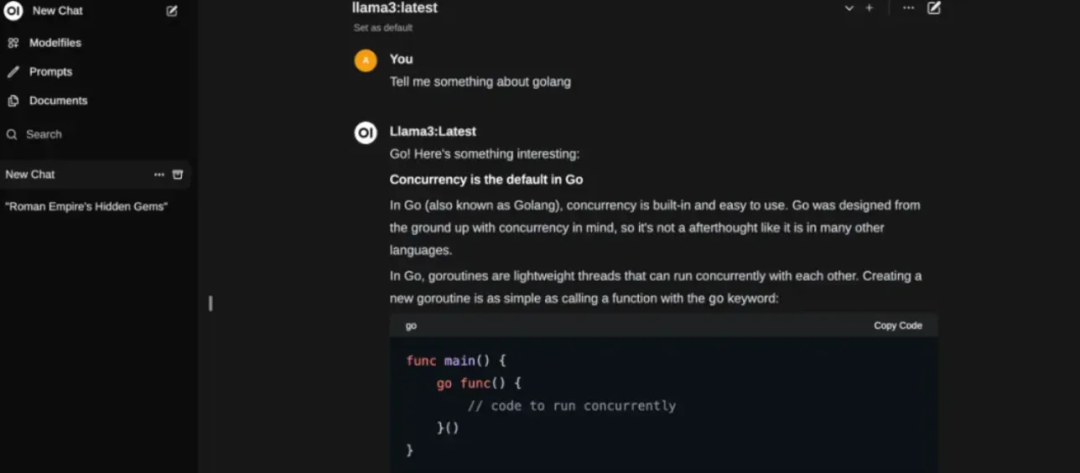

2.4 pipeline实战

将http链接中的两只猫咪图片进行深度估计

采用pipeline代码如下

import os

os.environ["HF_ENDPOINT"] = "https://hf-mirror.com"

os.environ["CUDA_VISIBLE_DEVICES"] = "2"

from transformers import pipeline

depth_estimator = pipeline(task="depth-estimation", model="LiheYoung/depth-anything-base-hf")

output = depth_estimator("http://images.cocodataset.org/val2017/000000039769.jpg")

output["depth"].save("depth.png")

print(output)output中的结果为

{'predicted_depth': tensor([[[26.3997, 26.3004, 26.3929, ..., 24.8488, 24.9059, 20.0686],

[26.2260, 26.2093, 26.3428, ..., 24.8447, 24.6682, 24.6084],

[26.0719, 26.0483, 26.1255, ..., 24.7053, 24.6745, 24.5809],

...,

[43.2635, 43.2344, 43.2892, ..., 39.0545, 39.2170, 39.0817],

[43.3637, 43.2703, 43.3899, ..., 39.1390, 38.9937, 39.0317],

[38.7509, 43.2192, 43.4387, ..., 38.5407, 38.3691, 35.3691]]]), 'depth': <PIL.Image.Image image mode=L size=640x480 at 0x7FAA9F2E5CD0>}将Image类型的图片保存并打开

基于此深度估计图片,我们可以进行上色等处理。

2.5 模型排名

在huggingface上,我们将深度估计(depth-estimation)模型按下载量从高到低排序:

三、总结

本文对transformers之pipeline的深度估计(depth-estimation)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以基于pipeline使用文中的代码极简的使用计算机视觉中的深度估计(depth-estimation)模型,应用于3D建模、自动驾驶距离测算等。

期待您的3连+关注,如何还有时间,欢迎阅读我的其他文章:

《Transformers-Pipeline概述》

【人工智能】Transformers之Pipeline(概述):30w+大模型极简应用

《Transformers-Pipeline 第一章:音频(Audio)篇》

【人工智能】Transformers之Pipeline(一):音频分类(audio-classification)

【人工智能】Transformers之Pipeline(二):自动语音识别(automatic-speech-recognition)

【人工智能】Transformers之Pipeline(三):文本转音频(text-to-audio/text-to-speech)

【人工智能】Transformers之Pipeline(四):零样本音频分类(zero-shot-audio-classification)

《Transformers-Pipeline 第二章:计算机视觉(CV)篇》

【人工智能】Transformers之Pipeline(五):深度估计(depth-estimation)

【人工智能】Transformers之Pipeline(六):图像分类(image-classification)

【人工智能】Transformers之Pipeline(七):图像分割(image-segmentation)

【人工智能】Transformers之Pipeline(八):图生图(image-to-image)

【人工智能】Transformers之Pipeline(九):物体检测(object-detection)

【人工智能】Transformers之Pipeline(十):视频分类(video-classification)

【人工智能】Transformers之Pipeline(十一):零样本图片分类(zero-shot-image-classification)

【人工智能】Transformers之Pipeline(十二):零样本物体检测(zero-shot-object-detection)

《Transformers-Pipeline 第三章:自然语言处理(NLP)篇》

【人工智能】Transformers之Pipeline(十三):填充蒙版(fill-mask)

【人工智能】Transformers之Pipeline(十四):问答(question-answering)

【人工智能】Transformers之Pipeline(十五):总结(summarization)

【人工智能】Transformers之Pipeline(十六):表格问答(table-question-answering)

【人工智能】Transformers之Pipeline(十七):文本分类(text-classification)

【人工智能】Transformers之Pipeline(十八):文本生成(text-generation)

【人工智能】Transformers之Pipeline(十九):文生文(text2text-generation)

【人工智能】Transformers之Pipeline(二十):令牌分类(token-classification)

【人工智能】Transformers之Pipeline(二十一):翻译(translation)

【人工智能】Transformers之Pipeline(二十二):零样本文本分类(zero-shot-classification)

《Transformers-Pipeline 第四章:多模态(Multimodal)篇》

【人工智能】Transformers之Pipeline(二十三):文档问答(document-question-answering)

【人工智能】Transformers之Pipeline(二十四):特征抽取(feature-extraction)

【人工智能】Transformers之Pipeline(二十五):图片特征抽取(image-feature-extraction)

【人工智能】Transformers之Pipeline(二十六):图片转文本(image-to-text)

【人工智能】Transformers之Pipeline(二十七):掩码生成(mask-generation)

【人工智能】Transformers之Pipeline(二十八):视觉问答(visual-question-answering)