- 首先yowov2是一款简单且实时的时空动作检测方案,fastreid是行人重识别(身份识别)

- yowov2介绍链接直达

- fastreid链接直达

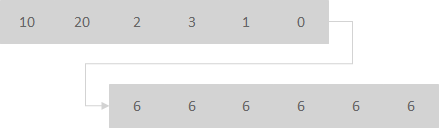

- 为时空动作检测任务设计实时框架仍然是一个挑战。YOWOv2 提出了一种新颖的实时动作检测框架,利用三维骨干和二维骨干进行准确的动作检测。经过改进,YOWOv2 明显优于 YOWO,并且仍然可以保持实时检测。YOWOv2 在数据集 UCF101-24 上以超过 20 FPS 的速度实现了 87.0% 的视频帧 mAP 和 52.8% 的全视频 mAP。在数据集 AVA 上,YOWOv2 在提速 20 FPS 的同时实现了 21.7% 的视频帧 mAP。

- 引入身份识别可以精确记录某个人的动作信息

- 效果图

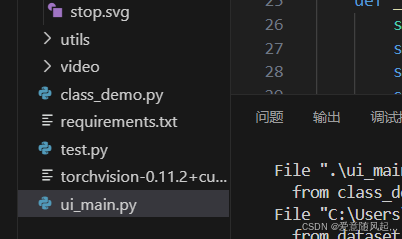

- ui界面 含有摄像头和视频检测, 同时右侧可以选择模型, 摄像头, 和是否使用CUDA

-

动作识别预览(弯腰和站立, 动作很多(摔倒动作,骑马动作都有, 如果需要自己训练动作,则自己制作ava数据集进行模型训练))

-

身份识别预览(左下角)身份识别 FastReID利用预训练的深度卷积神经网络(如ResNet、MobileNet等)作为基础模型,通过特征提取网络来提取图像中的行人特征。可以用来描述行人的外观特征、姿势等信息。并通过计算余弦相似度来度量在特征空间中度量行人之间的相似度。

-

- 详细实现:

- 首先创建YOWOv2环境,分为虚拟环境和Anaconda环境两种

-

先讲使用虚拟环境的,linux上主环境的是 python3.8,

1 创建虚拟环境, 当前文件夹就会有一个yowov2-virtual的文件夹

python3 -m vene yowov2-virtual2, 激活环境

source yowov2-virtual/bin/activate3, 安装环境(pytorch1.10.1和cuda10.2) (这个因为是外网的,需要梯子(不然很慢))

pip install torch==1.10.1+cu102 torchvision==0.11.2+cu102 -f https://download.pytorch.org/whl/cu102/torch_stable.html4. 进入项目安装依赖

pip install -r requirements.txt如果使用anaconda, 则

1. 创建anaconda环境

conda create -n yowov2-fastreid python==3.82. 然后激活环境(如果activate 不行, 则试试source)

conda activate yowov2-fastreid3. 与上面第三步一致 之后再运行ui_main.py 启动ui界面

-

详细使用信息

- 视频已经上传到b站

- B站视频链接直达

- 闲鱼链接直达

- 视频已经上传到b站

YOWOv2(yowov2)动作识别+Fastreid身份识别 详细安装与实现

news2026/2/15 18:18:37

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/1926015.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

用API实现商品sku抓取字段展示-淘宝sku区间价展示逻辑和规则分析

有卖家问我:我的链接里面有5个sku,都是不同的价格,为什么消费者看到的不是最低价呢?

这是因为淘宝平台商品价格的展示规则发生了变化,存在SKU区间价的产品,现在在搜索结果页面的曝光已经不是默认显示最低s…

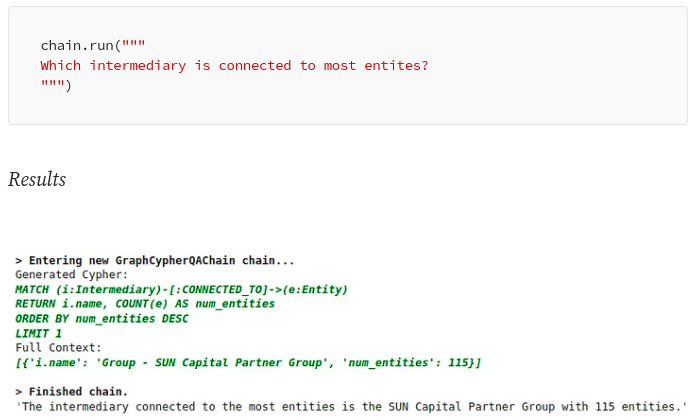

知识图谱与 LLM:微调与检索增强生成

Midjourney 的知识图谱聊天机器人的想法。 大型语言模型 (LLM) 的第一波炒作来自 ChatGPT 和类似的基于网络的聊天机器人,这些模型在理解和生成文本方面非常出色,这让人们(包括我自己)感到震惊。

我们中的许多人登录并测试了它写…

为企业提升销售工作效率的工作手机管理系统

在竞争日益激烈的市场环境中,企业的销售团队如同前线战士,其作战效率直接关乎企业的生存与发展。然而,传统销售管理模式下的信息孤岛、沟通不畅、数据混乱等问题,正悄然成为制约销售效率提升的瓶颈。今天,我们为您揭秘…

Linux限速工具:FlowMaster - IP级网络流量控制脚本

目录 前言:

Github加速器:

简介

功能

安装方法

使用方法

数值单位

基本命令

选项

示例

启动 FlowMaster

重启 FlowMaster

停止 FlowMaster

查看状态

查看 Iptables 设置

许可证

贡献

联系我们 前言: 在市面上看了好多关于网…

Hive及其架构简介

什么是 Hive ?

一个基于 Hadoop 的数据仓库,适用于一些高延迟性的应用(离线开发),可以将存储在 Hadoop 文件中的结构化、半结构化数据文件映射为一张数据库表,并基于表提供类似 SQL 的查询模型,…

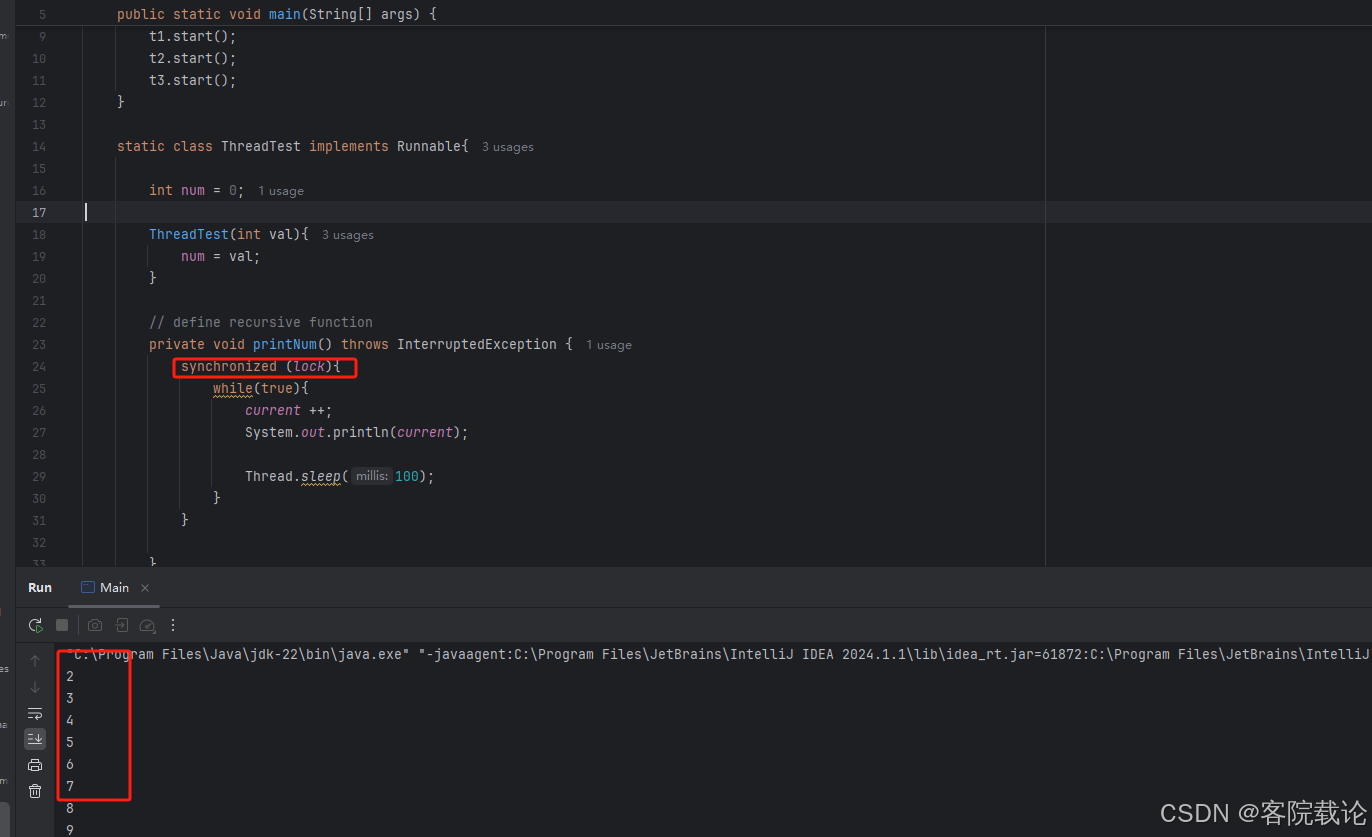

秋招突击——7/12——复习{每日温度、完全平方数、无重复最长子串}——新作{字节面试——控制多线程按照顺序输出}

文章目录 引言复习每日温度复习实现参考学习 完全平方数复习实现参考学习 无重复字符的最长子串复习实现参考学习 新作控制多线程输出Java实现线程——不使用锁实现使用synchronized关键实现——使用锁实现使用synchronized、wait和notify关键字实现 总结 引言

今天又要面试字…

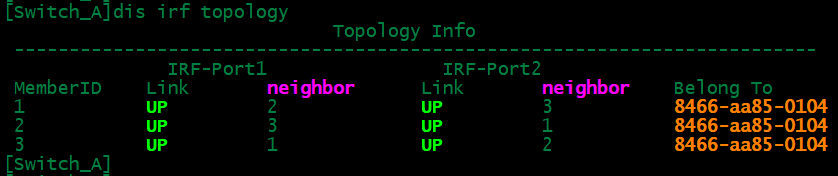

006-三台交换机堆叠

三台交换机堆叠

链形连接和环形连接 链形配置IRF与环形配置IRF的区别

三个交换机链形配置IRF与三个交换机环形配置IRF的主要区别体现在以下几个方面:

物理位置要求: 链形连接:对成员设备的物理位置要求相对较低,主要适用于成员…

Java 过载状态下的快速失败

Java Chassis 3技术解密:过载状态下的快速失败

在 熔断机制的改进路程 技术解密中,总结了如何设计一个优雅的熔断机制。 作为微服务最重要的治理策略之一,熔断机制能够在故障场景起到防止雪崩效应的作用。过载状态是一种特殊的故障场景&…

商品详情使用富文本编辑器

1、https://www.wangeditor.com/ 1、安装依赖包 npm install wangeditor/editor-for-vuenext --save 2、因为好多页面都需要用到,封装富文本编辑器组件 Editor.vue代码

<template><div style"border: 1px solid #ccc"><Toolbar style&q…

Syslog 管理工具

Syslog常被称为系统日志或系统记录,是一种用来在互联网协议(TCP/IP)的网上中传递记录档消息的标准,常用来指涉实际的Syslog 协议,或者那些提交syslog消息的应用程序或数据库。

系统日志协议(Syslog&#x…

成为CMake砖家(3):Windows安装make.exe

大家好,我是白鱼。相信很多朋友已经在用 CMake 做交叉编译了, 而交叉编译往往少不了 make.exe, 这篇来讲讲 make.exe 在 Windows 上的安装。

1. 交叉编译需要 generator

CMake 本身是一个 meta build tool, 或者说它是派发任务到具体的 bui…

Windows上网络调试助手NetAssist的使用

NetAssist是Windows上的网络调试助手,从 https://free.cmsoft.cn 下载最新的5.0.13版本,解压缩后直接双击NetAssist.exe即可,无需安装,界面如下图所示: (1).支持的协议类型包括:UDP、UDP IPv6、TCP Client、…

操作系统真象还原:创建文件系统

14.2 创建文件系统

14.2.1 创建超级块、i结点、目录项

超级块

/** Author: Adward-DYX 1654783946qq.com* Date: 2024-05-07 10:18:02* LastEditors: Adward-DYX 1654783946qq.com* LastEditTime: 2024-05-07 11:24:50* FilePath: /OS/chapter14/14.2/fs/super_block.h* Des…

P14-磁通量、高斯定理

高斯定理: 由于磁感线是闭合的,因此对于任一闭合曲面来说,有多少条磁感线进入闭合曲面,就一定有多少条磁感线穿出该闭合曲面。也就是说,通过任意闭合曲面的磁通量必等于零,称为磁场的高斯定理或磁通连续定…

前端面试题(CSS篇六)

一、浏览器如何判断是否支持 webp 格式图片 (1)宽高判断法。通过创建image对象,将其src属性设置为webp格式的图片,然后在onload事件中获取图片的宽高,如果能够获取,则说明浏览器支持webp格式图片。如果不能…

【pbootcms】新环境搭建环境安装时发生错误

【pbootcms】新环境搭建环境安装时发生错误

提示一下内容:

登录请求发生错误,您可按照如下方式排查: 1、试着删除根目录下runtime目录,刷新页面重试 2、检查系统会话文件存储目录是否具有写入权限; 3、检查服务器环境pathinfo及伪静态规则配置; 先按照…

OWASP 移动应用 2024 十大安全风险

1. OWASP 移动应用 2024 十大安全风险

开放全球应用程序安全项目 (OWASP) 是一个非营利性基金会,致力于提高软件的安全性。自 2014、2016 年两次发布了移动应用的十大风险后,今年再次发布2024版。这对移动应用软件的检查工具有着…

IDEA社区版使用Maven archetype 创建Spring boot 项目

1.新建new project

2.选择Maven Archetype

3.命名name

4.选择存储地址

5.选择jdk版本

6.Archetype使用webapp

7.create创建项目 创建好长这样。 检查一下自己的Maven是否是自己的。 没问题的话就开始增添java包。

[有的人连resources包也没有,那就需要自己添…

5、Hacker_Kid-v1.0.1

中等难度 目标root权限 先进行一波IP地址发现

netdiscover -i eth0 -r 192.168.1.1/24

发现存在的靶机ip 进行一波端口的探测 发现是一个apache的服务和一个tornado的网站 这里有个细节部分,53端口常见的情况都是走的udp协议做的域名解析,这里查询出来…