目录

01 算法原理

02 骨干架构

03 实验结果

一种崭新的大语言模型(LLM)架构有望取代当前主导 AI 领域的 Transformer,并在性能上超越 Mamba。

论文地址:https://arxiv.org/abs/2407.04620

本周一,关于 Test-Time Training(TTT)的研究论文在人工智能社区引发了广泛讨论。

该研究由斯坦福大学、加州大学伯克利分校、加州大学圣迭戈分校和 Meta 的研究人员共同完成。他们设计了一个新架构 TTT,利用机器学习模型取代了 RNN 的隐藏状态。

通过输入 token 的梯度下降,该模型能够压缩上下文。

研究作者之一 Karan Dalal 表示,他相信这将彻底改变语言模型的方法。

没体验过OpenAI最新版GPT-4o?快戳最详细升级教程,几分钟搞定:

升级ChatGPT-4o Turbo步骤![]() https://www.zhihu.com/pin/1768399982598909952如何使用WildCard正确方式打开GPT-4o,目前 WildCard 支持的服务非常齐全,可以说是应有尽有!

https://www.zhihu.com/pin/1768399982598909952如何使用WildCard正确方式打开GPT-4o,目前 WildCard 支持的服务非常齐全,可以说是应有尽有!

官网有更详细介绍:WildCard

TTT 层直接取代了 Attention,并通过表达性记忆实现了线性复杂性架构,使模型能够在上下文中训练数百万甚至数十亿个 token 的 LLM。

在对比 125M 到 1.3B 参数规模的大模型时,研究发现 TTT-Linear 和 TTT-MLP 均能匹敌或超越最强大的 Transformers 和 Mamba 架构方法。

TTT 层作为一种新的信息压缩和模型记忆机制,可以直接替代 Transformer 中的自注意力层。

这不仅在理论上具有线性复杂度,而且在实际运行时间上也更快。

在论文上线后,作者公开了代码与 jax 以供人们训练和测试:https://github.com/test-time-training/ttt-lm-jax

还有 PyTorch 推理代码:https://github.com/test-time-training/ttt-lm-pytorch

01 算法原理

长上下文的挑战是 RNN 层本质上所固有的:与自注意力机制不同,RNN 层必须将上下文压缩为固定大小的隐藏状态,更新规则需要识别数千甚至数百万个 token 之间的底层结构和关系。

研究团队首先观察到,自监督学习可以将大量训练集压缩为 LLM 等模型的权重,而这些模型通常对其训练数据之间的语义联系有深刻理解。

受此启发,团队设计了一类新的序列建模层,其中隐藏状态是一个模型,更新规则是自监督学习的一个步骤。

由于更新测试序列上的隐藏状态过程相当于在测试时训练模型,因此这种新层被称为测试时训练(Test-Time Training, TTT)层。

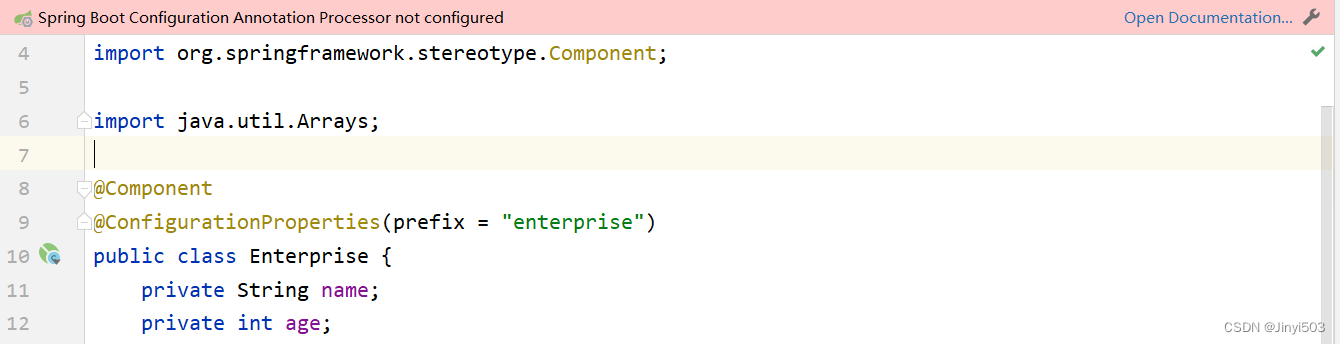

团队引入了两个简单的实例:TTT-Linear 和 TTT-MLP,其中隐藏状态分别是线性模型和两层 MLP。TTT 层可以集成到任何网络架构中并进行端到端优化,类似于 RNN 层和自注意力。

为了让 TTT 层更加高效,该研究采取了一些改进措施:

首先,类似于在常规训练期间对小批量序列采取 gradient step 以获得更好的并行性,该研究在 TTT 期间使用小批量 token。

其次,该研究为每个 TTT 小批量内的操作开发了一种双重形式,以更好地利用现代 GPU 和 TPU。双重形式的输出与简单实现等效,但训练速度快了 5 倍以上。

如图 3 所示,TTT-Linear 在 8k 上下文中比 Transformer 更快,与 Mamba 相当。

研究团队认为:所有序列建模层都可以看作将历史上下文存储到隐藏状态中,如图 4 所示。

例如,RNN 层(如 LSTM、RWKV 和 Mamba 层)将上下文压缩为跨时间的固定大小状态。这种压缩会产生两种后果:

一方面,将输入标记 x_t 映射到输出 token z_t 是高效的,因为每个 token 的更新规则和输出规则都需要恒定的时间。

另一方面,RNN 层在长上下文中的性能受限于其隐藏状态 s_t 的表现力。

自注意力也可以从上述角度来看待,只不过它的隐藏状态(通常称为 Key-Value 缓存)是一个随 t 线性增长的列表。

它的更新规则是将当前的 KV 元组追加到该列表中,而输出规则则扫描 t 前的所有元组,以形成注意力矩阵。

隐藏状态明确存储了所有历史上下文,无需压缩,这使得自注意力在长上下文方面比 RNN 层更具表现力。

然而,扫描这个线性增长的隐藏状态所需的时间也是线性增长的。为了保持长上下文的高效和表现力,研究者需要一种更好的压缩启发式。

具体来说,需要将成千上万或上百万的 token 压缩到一个隐藏状态中,从而有效捕捉它们的底层结构和关系。这听起来似乎有些高难度,但实际上很多人都对这种启发式非常熟悉。

02 骨干架构

将任何 RNN 层集成到更大架构中的最简洁方法是直接替换 Transformer 中的自注意力,在这里称为骨干。

然而,现有的 RNN(如 Mamba 和 Griffin 等)都使用了与 Transformer 不同的骨干层。最值得注意的是,它们的骨干层在 RNN 层之前包含了时间卷积,这可能有助于收集跨时间的局部信息。

在对 Mamba 主干网进行试验后,研究者发现它也能改善 TTT 层的困惑度,因此将其纳入了建议方法中,详见图 16。

03 实验结果

在实验中,研究人员将 TTT-Linear 和 TTT-MLP 与两种基线模型——Transformer 和 Mamba 进行了比较。

从图 11 中可以得出以下结论:

- 2k 上下文:TTT-Linear (M)、Mamba 和 Transformer 的性能相当,因为它们的曲线大多重叠。在 FLOP 预算较大的情况下,TTT-MLP (M) 的性能略显不足。尽管 TTT-MLP 在各种模型大小下的困惑度比 TTT-Linear 更优,但额外的 FLOPs 成本抵消了这一优势。

- 8k 上下文:TTT-Linear (M) 和 TTT-MLP (M) 的表现显著优于 Mamba,这与 2k 上下文中的观察结果形成鲜明对比。即使是使用 Transformer 主干网络的 TTT-MLP (T) 在 1.3B 参数规模时也略胜 Mamba。一项显著发现是,随着上下文长度的增加,TTT 层相对于 Mamba 层的优势也在扩大。

- 当上下文长度达到 8k 时,Transformer 在每种模型尺寸下的困惑度表现依旧良好,但由于 FLOPs 成本的增加,其竞争力已明显下降。

如何使用WildCard正确方式打开GPT-4o,目前 WildCard 支持的服务非常齐全,可以说是应有尽有!

官网有更详细介绍:WildCard

推荐阅读:

GPT-4o不仅能写代码,还能自查Bug,程序员替代进程再进一步!

GPT-4替代大学生参加考试,94%成功作弊未被发现!