1、模型训练

模型训练一般分为四个步骤:

- 构建数据集。

- 定义神经网络模型。

- 定义超参、损失函数及优化器。

- 输入数据集进行训练与评估。

现在我们有了数据集和模型后,可以进行模型的训练与评估。

2、构建数据集

首先从数据集 Dataset加载代码,构建数据集。

import mindspore

from mindspore import nn

from mindspore.dataset import vision, transforms

from mindspore.dataset import MnistDataset

# Download data from open datasets

from download import download

url = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/" \

"notebook/datasets/MNIST_Data.zip"

path = download(url, "./", kind="zip", replace=True)

def datapipe(path, batch_size):

image_transforms = [

vision.Rescale(1.0 / 255.0, 0),

vision.Normalize(mean=(0.1307,), std=(0.3081,)),

vision.HWC2CHW()

]

label_transform = transforms.TypeCast(mindspore.int32)

#mindspore.dataset.transforms.TypeCast(data_type)

#将输入的Tensor转换为指定的数据类型。

dataset = MnistDataset(path)

dataset = dataset.map(image_transforms, 'image')

dataset = dataset.map(label_transform, 'label')

dataset = dataset.batch(batch_size)

return dataset

train_dataset = datapipe('MNIST_Data/train', batch_size=64)

test_dataset = datapipe('MNIST_Data/test', batch_size=64)

3、定义神经网络模型

从网络构建中加载代码,构建一个神经网络模型。

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

#将数据从start_dim 到 end_dim 的维度,对输入Tensor进行展平

self.dense_relu_sequential = nn.SequentialCell(

#构造Cell顺序容器。

nn.Dense(28*28, 512),

nn.ReLU(),

nn.Dense(512, 512),

nn.ReLU(),

nn.Dense(512, 10)

)

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

model = Network()4、定义超参、损失函数和优化器

4.1 超参

超参(Hyperparameters)是可以调整的参数,可以控制模型训练优化的过程,不同的超参数值可能会影响模型训练和收敛速度。目前深度学习模型多采用批量随机梯度下降算法进行优化,随机梯度下降算法的原理如下:

公式中,𝑛是批量大小(batch size),η是学习率(learning rate)。另外,𝑤𝑡为训练轮次𝑡中的权重参数,∇𝑙为损失函数的导数。除了梯度本身,这两个因子直接决定了模型的权重更新,从优化本身来看,它们是影响模型性能收敛最重要的参数。一般会定义以下超参用于训练:

-

训练轮次(epoch):训练时遍历数据集的次数。

-

批次大小(batch size):数据集进行分批读取训练,设定每个批次数据的大小。batch size过小,花费时间多,同时梯度震荡严重,不利于收敛;batch size过大,不同batch的梯度方向没有任何变化,容易陷入局部极小值,因此需要选择合适的batch size,可以有效提高模型精度、全局收敛。

-

学习率(learning rate):如果学习率偏小,会导致收敛的速度变慢,如果学习率偏大,则可能会导致训练不收敛等不可预测的结果。梯度下降法被广泛应用在最小化模型误差的参数优化算法上。梯度下降法通过多次迭代,并在每一步中最小化损失函数来预估模型的参数。学习率就是在迭代过程中,会控制模型的学习进度。

epochs = 3

batch_size = 64

learning_rate = 1e-24.2 损失函数

损失函数(loss function)用于评估模型的预测值(logits)和目标值(targets)之间的误差。训练模型时,随机初始化的神经网络模型开始时会预测出错误的结果。损失函数会评估预测结果与目标值的相异程度,模型训练的目标即为降低损失函数求得的误差。

常见的损失函数包括用于回归任务的nn.MSELoss(均方误差)和用于分类的nn.NLLLoss(负对数似然)等。 nn.CrossEntropyLoss 结合了nn.LogSoftmax和nn.NLLLoss,可以对logits 进行归一化并计算预测误差。

loss_fn = nn.CrossEntropyLoss()4.3 优化器

模型优化(Optimization)是在每个训练步骤中调整模型参数以减少模型误差的过程。MindSpore提供多种优化算法的实现,称之为优化器(Optimizer)。优化器内部定义了模型的参数优化过程(即梯度如何更新至模型参数),所有优化逻辑都封装在优化器对象中。在这里,我们使用SGD(Stochastic Gradient Descent)优化器。

mindspore.nn.SGD(params, learning_rate=0.1, momentum=0.0, dampening=0.0, weight_decay=0.0, nesterov=False, loss_scale=1.0)

随机梯度下降的实现。动量可选。

【参数】

-

params (Union[list[Parameter], list[dict]]) - 当 params 为会更新的 Parameter 列表时, params 中的元素必须为类 Parameter。当 params 为 dict 列表时,”params”、”lr”、”weight_decay”、”grad_centralization”和”order_params”为可以解析的键。

-

params - 必填。当前组别的权重,该值必须是 Parameter 列表。

-

lr - 可选。如果键中存在”lr”,则使用对应的值作为学习率。如果没有,则使用优化器中的参数 learning_rate 作为学习率。支持固定和动态学习率。

-

weight_decay - 可选。如果键中存在”weight_decay”,则使用对应的值作为权重衰减值。如果没有,则使用优化器中配置的 weight_decay 作为权重衰减值。当前 weight_decay 仅支持float类型,不支持动态变化。

-

grad_centralization - 可选。如果键中存在”grad_centralization”,则使用对应的值,该值必须为布尔类型。如果没有,则认为 grad_centralization 为False。该参数仅适用于卷积层。

-

order_params - 可选。值的顺序是参数更新的顺序。当使用参数分组功能时,通常使用该配置项保持 parameters 的顺序以提升性能。如果键中存在”order_params”,则会忽略该组配置中的其他键。”order_params”中的参数必须在某一组 params 参数中。

-

-

learning_rate (Union[float, int, Tensor, Iterable, LearningRateSchedule]) - 默认值:

0.1。-

float - 固定的学习率。必须大于等于零。

-

int - 固定的学习率。必须大于等于零。整数类型会被转换为浮点数。

-

Tensor - 可以是标量或一维向量。标量是固定的学习率。一维向量是动态的学习率,第i步将取向量中第i个值作为学习率。

-

Iterable - 动态的学习率。第i步将取迭代器第i个值作为学习率。

-

LearningRateSchedule - 动态的学习率。在训练过程中,优化器将使用步数(step)作为输入,调用 LearningRateSchedule 实例来计算当前学习率。

-

-

momentum (float) - 浮点动量,必须大于等于0.0。默认值:

0.0。 -

dampening (float) - 浮点动量阻尼值,必须大于等于0.0。默认值:

0.0。 -

weight_decay (float) - 权重衰减(L2 penalty),必须大于等于0。默认值:

0.0。 -

nesterov (bool) - 启用Nesterov动量。如果使用Nesterov,动量必须为正,阻尼必须等于0.0。默认值:

False。

-

loss_scale (float) - 梯度缩放系数,必须大于0.0。如果 loss_scale 是整数,它将被转换为浮点数。通常使用默认值,仅当训练时使用了 FixedLossScaleManager,且 FixedLossScaleManager 的 drop_overflow_update 属性配置为

False时,此值需要与 FixedLossScaleManager 中的 loss_scale 相同。有关更多详细信息,请参阅 mindspore.amp.FixedLossScaleManager。默认值:1.0。

我们通过model.trainable_params()方法获得模型的可训练参数,并传入学习率超参来初始化优化器。

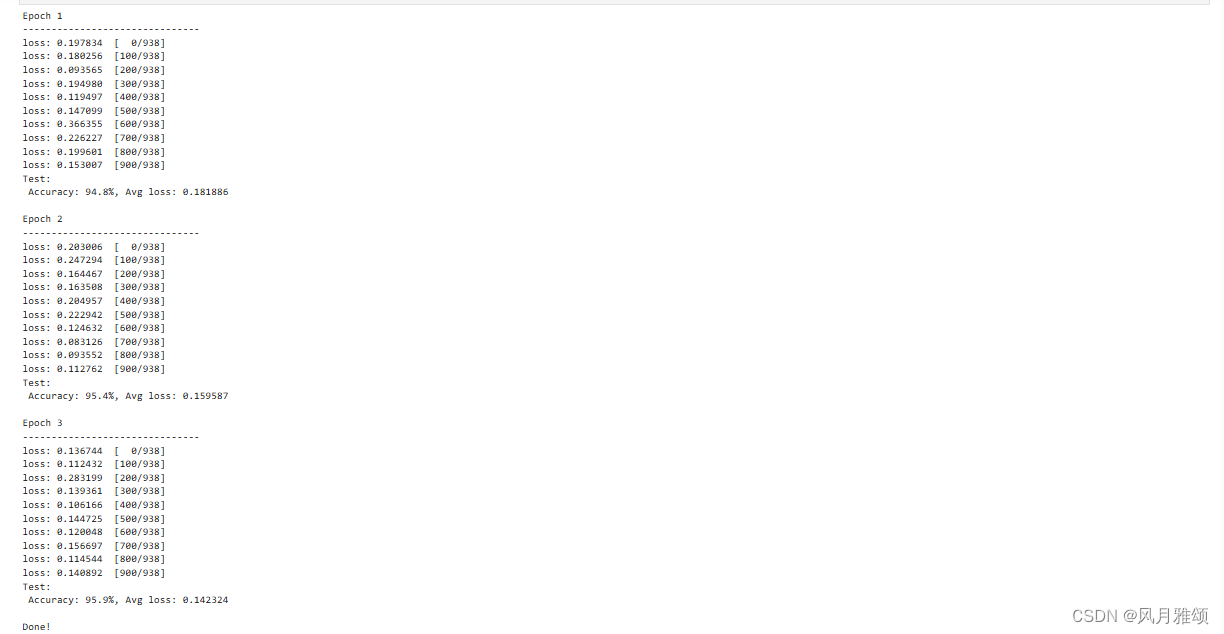

5、训练与评估

设置了超参、损失函数和优化器后,我们就可以循环输入数据来训练模型。一次数据集的完整迭代循环称为一轮(epoch)。每轮执行训练时包括两个步骤:

- 训练:迭代训练数据集,并尝试收敛到最佳参数。

- 验证/测试:迭代测试数据集,以检查模型性能是否提升。

接下来我们定义用于训练的train_loop函数和用于测试的test_loop函数。

使用函数式自动微分,需先定义正向函数forward_fn,使用value_and_grad获得微分函数grad_fn。然后,我们将微分函数和优化器的执行封装为train_step函数,接下来循环迭代数据集进行训练即可。

mindspore.value_and_grad(fn, grad_position=0, weights=None, has_aux=False, return_ids=False)

生成求导函数,用于计算给定函数的正向计算结果和梯度。

函数求导包含以下三种场景:

-

对输入求导,此时 grad_position 非None,而 weights 是None;

-

对网络变量求导,此时 grad_position 是None,而 weights 非None;

-

同时对输入和网络变量求导,此时 grad_position 和 weights 都非None。

【参数】

-

fn (Union[Cell, Function]) - 待求导的函数或网络。

-

grad_position (Union[NoneType, int, tuple[int]]) - 指定求导输入位置的索引。若为int类型,表示对单个输入求导;若为tuple类型,表示对tuple内索引的位置求导,其中索引从0开始;若是None,表示不对输入求导,这种场景下, weights 非None。默认值:

0。 -

weights (Union[ParameterTuple, Parameter, list[Parameter]]) - 训练网络中需要返回梯度的网络变量。一般可通过 weights = net.trainable_params() 获取。默认值:

None。 -

has_aux (bool) - 是否返回辅助参数的标志。若为

True, fn 输出数量必须超过一个,其中只有 fn 第一个输出参与求导,其他输出值将直接返回。默认值:False。 -

return_ids (bool) - 是否返回由返回的梯度和指定求导输入位置的索引或网络变量组成的tuple。若为

True,其输出中所有的梯度值将被替换为:由该梯度和其输入的位置索引,或者用于计算该梯度的网络变量组成的tuple。默认值:False。

# Define forward function

def forward_fn(data, label):

logits = model(data)

loss = loss_fn(logits, label)

return loss, logits

# Get gradient function

grad_fn = mindspore.value_and_grad(forward_fn, None, optimizer.parameters, has_aux=True)

# Define function of one-step training

def train_step(data, label):

(loss, _), grads = grad_fn(data, label)

optimizer(grads)

return loss

def train_loop(model, dataset):

size = dataset.get_dataset_size()

model.set_train()

for batch, (data, label) in enumerate(dataset.create_tuple_iterator()):

loss = train_step(data, label)

if batch % 100 == 0:

loss, current = loss.asnumpy(), batch

print(f"loss: {loss:>7f} [{current:>3d}/{size:>3d}]")test_loop函数同样需循环遍历数据集,调用模型计算loss和Accuray并返回最终结果。

def test_loop(model, dataset, loss_fn):

num_batches = dataset.get_dataset_size()

model.set_train(False)

total, test_loss, correct = 0, 0, 0

for data, label in dataset.create_tuple_iterator():

pred = model(data)

total += len(data)

test_loss += loss_fn(pred, label).asnumpy()

correct += (pred.argmax(1) == label).asnumpy().sum()

test_loss /= num_batches

correct /= total

print(f"Test: \n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")