>- **🍨 本文为[🔗365天深度学习训练营](https://mp.weixin.qq.com/s/0dvHCaOoFnW8SCp3JpzKxg) 中的学习记录博客**

>- **🍖 原作者:[K同学啊](https://mtyjkh.blog.csdn.net/)**目录

目录

一、前言

二、我的环境

三、前期准备

1.设置GPU

2.导入数据

3.归一化

4.可视化图片

5.调整图片格式

四、构建简单的cnn网络

五.编译模型

六、训练模型

七预测

八、知识点详解

1. MNIST手写数字数据集介绍

2. 神经网络程序说明

3.模型结构说明

八、总结

一、前言

作为一名研究牲,一定要了解pytorch和tensorflow。下面我来介绍一下。

TensorFlow和PyTorch是两个流行的开源机器学习库,它们都支持深度学习模型的开发和训练。尽管它们在很多方面有相似之处,但它们之间也存在一些关键的区别:

1. **设计哲学**:

- **TensorFlow**:最初由Google Brain团队开发,TensorFlow的设计更倾向于生产环境,强调模型的可扩展性和部署的灵活性。TensorFlow提供了一个静态计算图,这意味着在执行之前,整个计算图需要被定义和优化。

- **PyTorch**:由Facebook的AI研究团队开发,PyTorch的设计更倾向于研究和快速原型开发,强调动态性和易用性。PyTorch使用动态计算图,允许在运行时修改图。

2. **易用性**:

- **TensorFlow**:对于初学者来说可能稍微复杂一些,因为它需要用户理解计算图的概念。

- **PyTorch**:提供了一个更接近于NumPy的API,使得从NumPy过渡到深度学习更加自然。

3. **灵活性**:

- **TensorFlow**:由于其静态图的特性,可能在某些需要高度灵活性的场景下不如PyTorch灵活。

- **PyTorch**:动态图使得在运行时修改模型变得更加容易,这对于研究和快速迭代非常有用。

4. **性能**:

- 两者在性能上都非常出色,但TensorFlow在某些情况下可能因为其优化的静态图而提供更好的性能。

5. **社区和生态系统**:

- **TensorFlow**:由于其较早的发布和Google的支持,拥有一个庞大的社区和丰富的库。

- **PyTorch**:虽然起步较晚,但社区发展迅速,特别是在研究领域。

6. **部署**:

- **TensorFlow**:提供了TensorFlow Serving等工具,使得模型部署更加方便。

- **PyTorch**:模型部署可能需要更多的工作,但PyTorch与ONNX(Open Neural Network Exchange)的集成正在改善这一状况。

7. **多GPU支持**:

- **TensorFlow**:从设计之初就考虑了多GPU支持。

- **PyTorch**:虽然也支持多GPU,但在某些情况下可能需要更多的手动配置。

8. **API一致性**:

- **TensorFlow**:API在不同版本之间可能发生变化,这可能会影响向后兼容性。

- **PyTorch**:API相对稳定,变化较少。

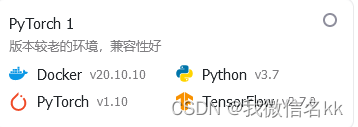

选择哪个框架往往取决于个人偏好、项目需求和团队熟悉度。两者都是强大的工具,能够支持复杂的深度学习任务。二、我的环境

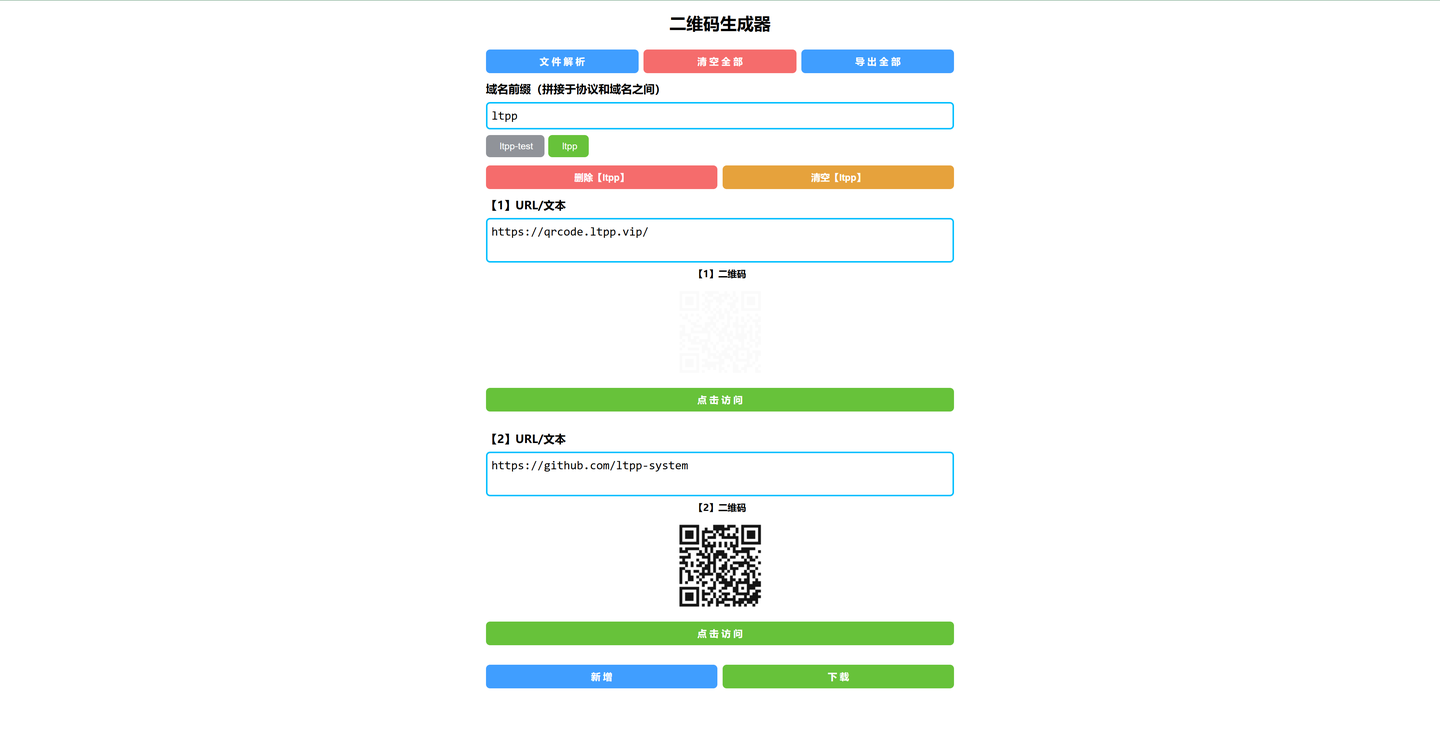

三、前期准备

1.设置GPU

import tensorflow as tf

gpus = tf.config.list_physical_devices("GPU")

if gpus:

gpu0 = gpus[0] #如果有多个GPU,仅使用第0个GPU

tf.config.experimental.set_memory_growth(gpu0, True) #设置GPU显存用量按需使用

tf.config.set_visible_devices([gpu0],"GPU")2.导入数据

import tensorflow as tf

from tensorflow.keras import datasets, layers, models

import matplotlib.pyplot as plt

# 导入mnist数据,依次分别为训练集图片、训练集标签、测试集图片、测试集标签

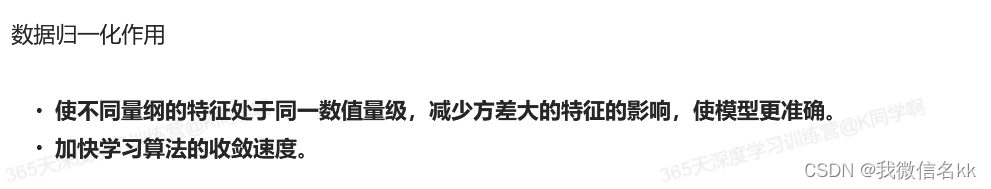

(train_images, train_labels), (test_images, test_labels) = datasets.mnist.load_data()3.归一化

归一化与标准化![]() https://blog.csdn.net/qq_38251616/article/details/126048261

https://blog.csdn.net/qq_38251616/article/details/126048261

# 将像素的值标准化至0到1的区间内。(对于灰度图片来说,每个像素最大值是255,每个像素最小值是0,也就是直接除以255就可以完成归一化。)

train_images, test_images = train_images / 255.0, test_images / 255.0

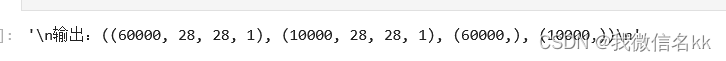

# 查看数据维数信息

train_images.shape,test_images.shape,train_labels.shape,test_labels.shape

"""

输出:((60000, 28, 28), (10000, 28, 28), (60000,), (10000,))

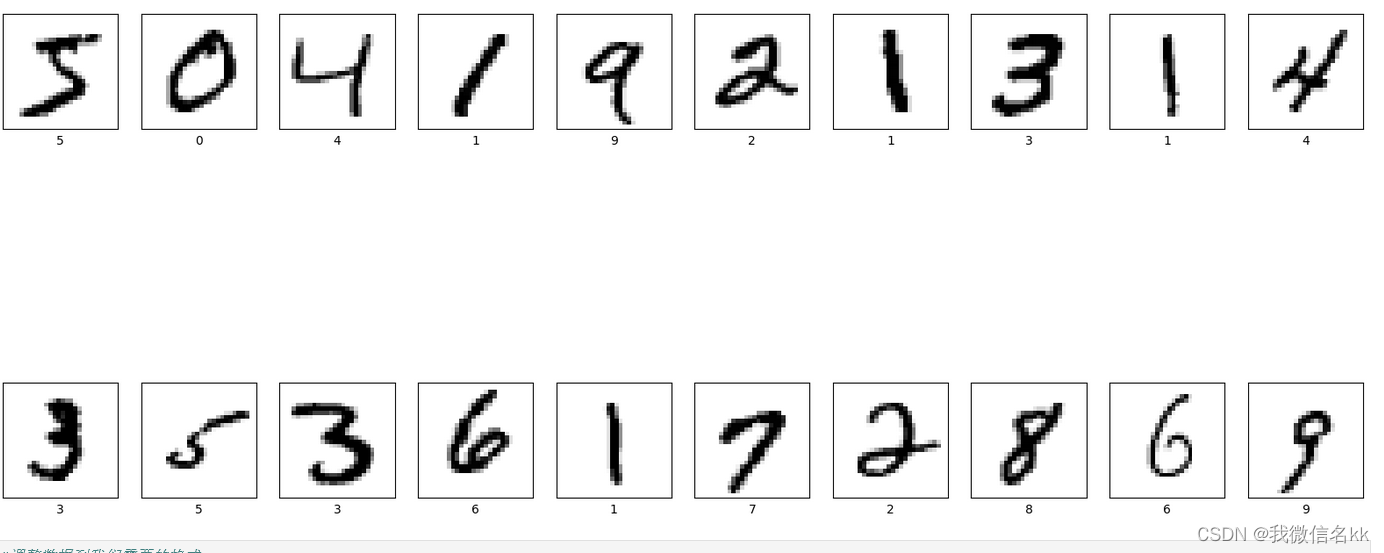

"""4.可视化图片

# 将数据集前20个图片数据可视化显示

# 进行图像大小为20宽、10长的绘图(单位为英寸inch)

plt.figure(figsize=(20,10))

# 遍历MNIST数据集下标数值0~49

for i in range(20):

# 将整个figure分成5行10列,绘制第i+1个子图。

plt.subplot(2,10,i+1)

# 设置不显示x轴刻度

plt.xticks([])

# 设置不显示y轴刻度

plt.yticks([])

# 设置不显示子图网格线

plt.grid(False)

# 图像展示,cmap为颜色图谱,"plt.cm.binary"为matplotlib.cm中的色表

plt.imshow(train_images[i], cmap=plt.cm.binary)

# 设置x轴标签显示为图片对应的数字

plt.xlabel(train_labels[i])

# 显示图片

plt.show()5.调整图片格式

#调整数据到我们需要的格式

train_images = train_images.reshape((60000, 28, 28, 1))

test_images = test_images.reshape((10000, 28, 28, 1))

train_images.shape,test_images.shape,train_labels.shape,test_labels.shape

"""

输出:((60000, 28, 28, 1), (10000, 28, 28, 1), (60000,), (10000,))

"""

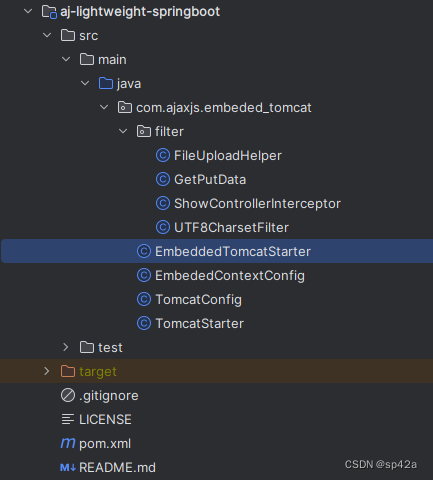

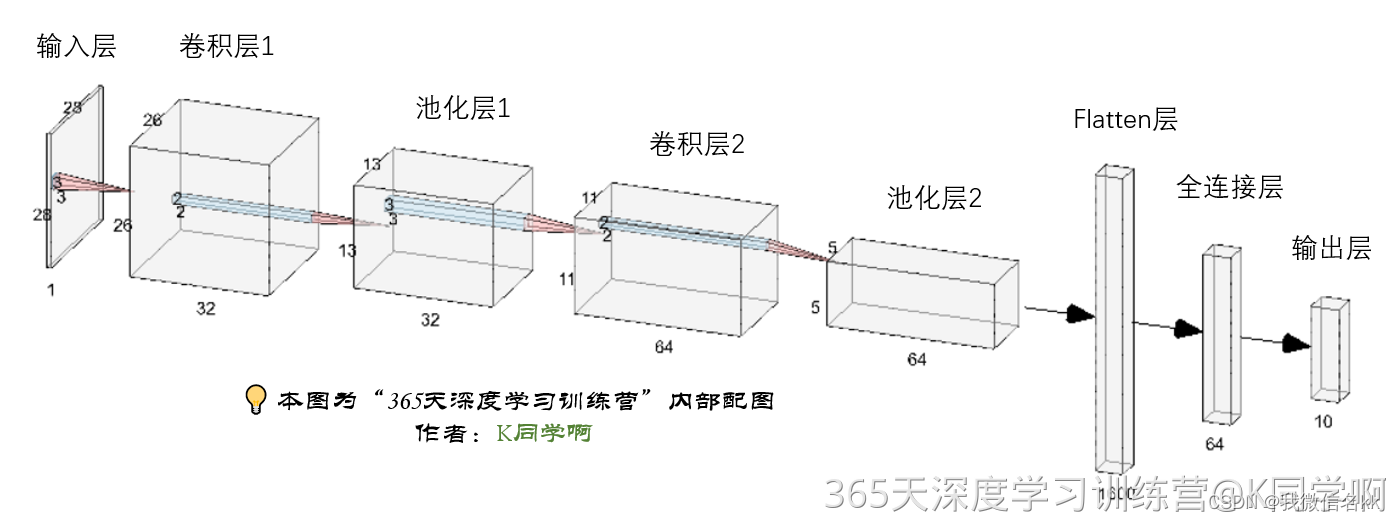

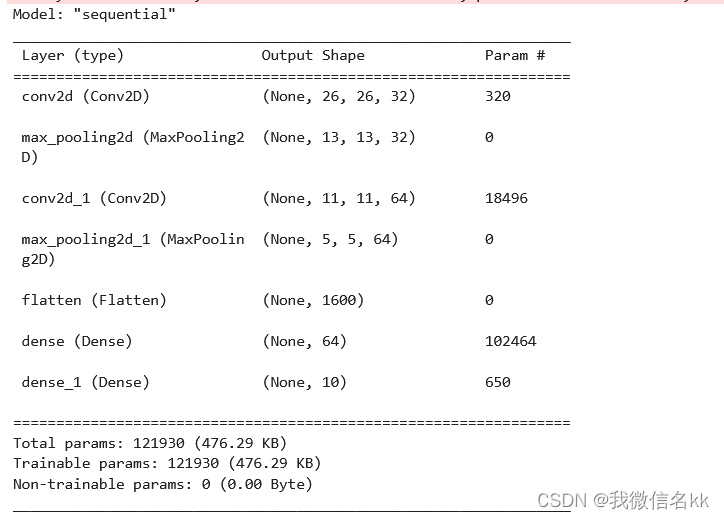

四、构建简单的cnn网络

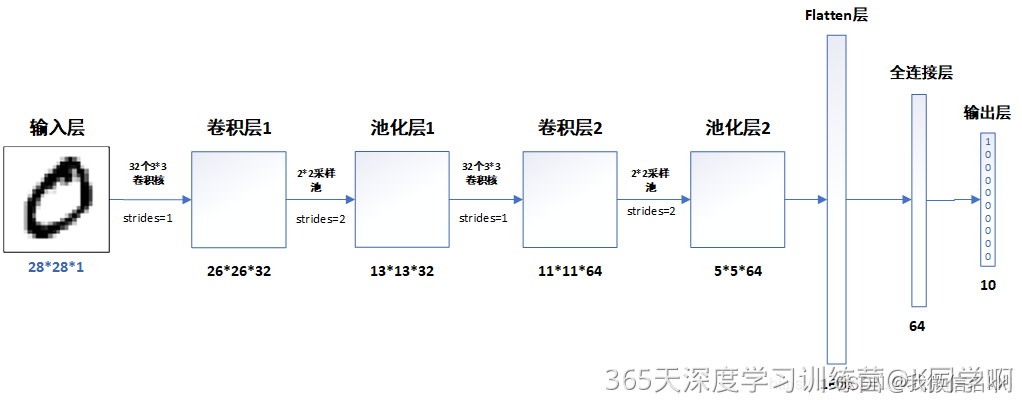

网络结构图

(1)第一步构建cnn网络模型

(2)第二步:加载并打印模型

(3)第三步: 输出结果编辑

# 创建并设置卷积神经网络

# 卷积层:通过卷积操作对输入图像进行降维和特征抽取

# 池化层:是一种非线性形式的下采样。主要用于特征降维,压缩数据和参数的数量,减小过拟合,同时提高模型的鲁棒性。

# 全连接层:在经过几个卷积和池化层之后,神经网络中的高级推理通过全连接层来完成。

model = models.Sequential([

# 设置二维卷积层1,设置32个3*3卷积核,activation参数将激活函数设置为ReLu函数,input_shape参数将图层的输入形状设置为(28, 28, 1)

# ReLu函数作为激活励函数可以增强判定函数和整个神经网络的非线性特性,而本身并不会改变卷积层

# 相比其它函数来说,ReLU函数更受青睐,这是因为它可以将神经网络的训练速度提升数倍,而并不会对模型的泛化准确度造成显著影响。

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

#池化层1,2*2采样

layers.MaxPooling2D((2, 2)),

# 设置二维卷积层2,设置64个3*3卷积核,activation参数将激活函数设置为ReLu函数

layers.Conv2D(64, (3, 3), activation='relu'),

#池化层2,2*2采样

layers.MaxPooling2D((2, 2)),

layers.Flatten(), #Flatten层,连接卷积层与全连接层

layers.Dense(64, activation='relu'), #全连接层,特征进一步提取,64为输出空间的维数,activation参数将激活函数设置为ReLu函数

layers.Dense(10) #输出层,输出预期结果,10为输出空间的维数

])

# 打印网络结构

model.summary()

五.编译模型

"""

这里设置优化器、损失函数以及metrics

这三者具体介绍可参考我的博客:

https://blog.csdn.net/qq_38251616/category_10258234.html

"""

# model.compile()方法用于在配置训练方法时,告知训练时用的优化器、损失函数和准确率评测标准

model.compile(

# 设置优化器为Adam优化器

optimizer='adam',

# 设置损失函数为交叉熵损失函数(tf.keras.losses.SparseCategoricalCrossentropy())

# from_logits为True时,会将y_pred转化为概率(用softmax),否则不进行转换,通常情况下用True结果更稳定

loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True),

# 设置性能指标列表,将在模型训练时监控列表中的指标

metrics=['accuracy'])# model.compile()方法用于在配置训练方法时,告知训练时用的优化器、损失函数和准确率评测标准

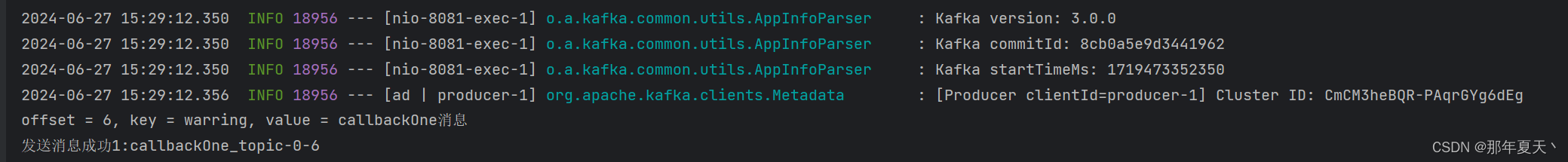

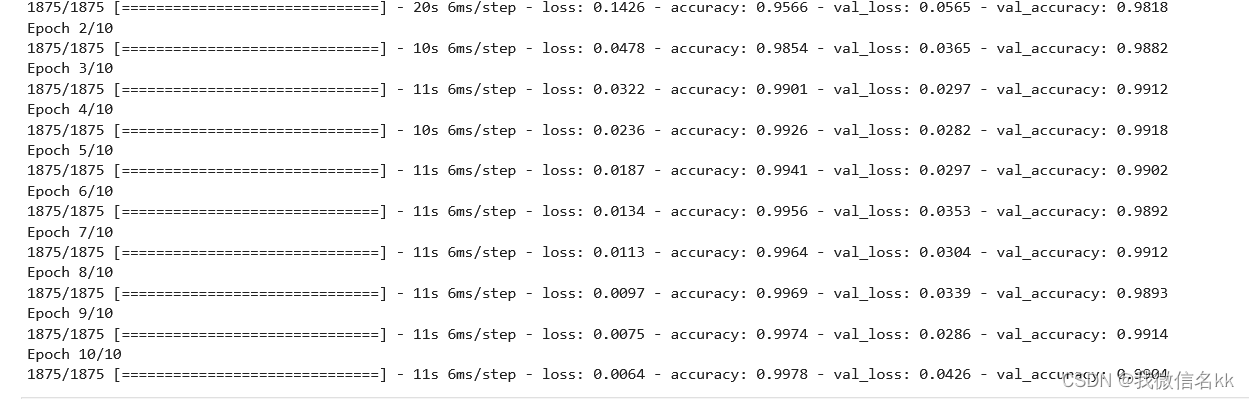

六、训练模型

"""

这里设置输入训练数据集(图片及标签)、验证数据集(图片及标签)以及迭代次数epochs

关于model.fit()函数的具体介绍可参考我的博客:

https://blog.csdn.net/qq_38251616/category_10258234.html

"""

history = model.fit(

# 输入训练集图片

train_images,

# 输入训练集标签

train_labels,

# 设置10个epoch,每一个epoch都将会把所有的数据输入模型完成一次训练。

epochs=10,

# 设置验证集

validation_data=(test_images, test_labels))

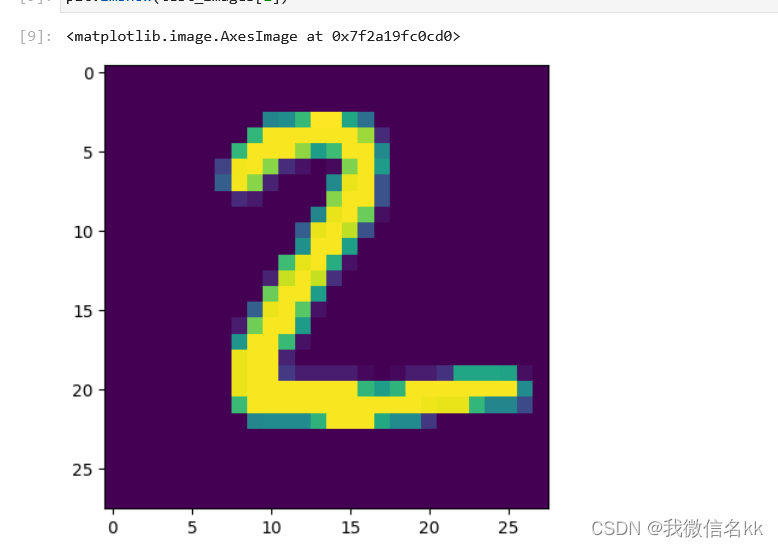

七预测

通过下面的网络结构我们可以简单理解为,输入一张图片,将会得到一组数,这组代表这张图片上的数字为0~9中每一个数字的几率(并非概率),out数字越大可能性越大,仅此而已

在这一步中部分同学会因为 matplotlib 版本原因报 Invalid shape (28, 28, 1) for image data 的错误提示,可以将代码改为 plt.imshow(test_images[1].reshape(28,28)) 。

plt.imshow(test_images[1])

#输出测试集中第一张图片的预测结果

pre = model.predict(test_images) # 对所有测试图片进行预测

pre[1] # 输出第一张图片的预测结果

八、知识点详解

本文使用的是最简单的CNN模型- -LeNet-5,如果是第一次接触深度学习的话,可以先试着把代码跑通,然后再尝试去理解其中的代码。

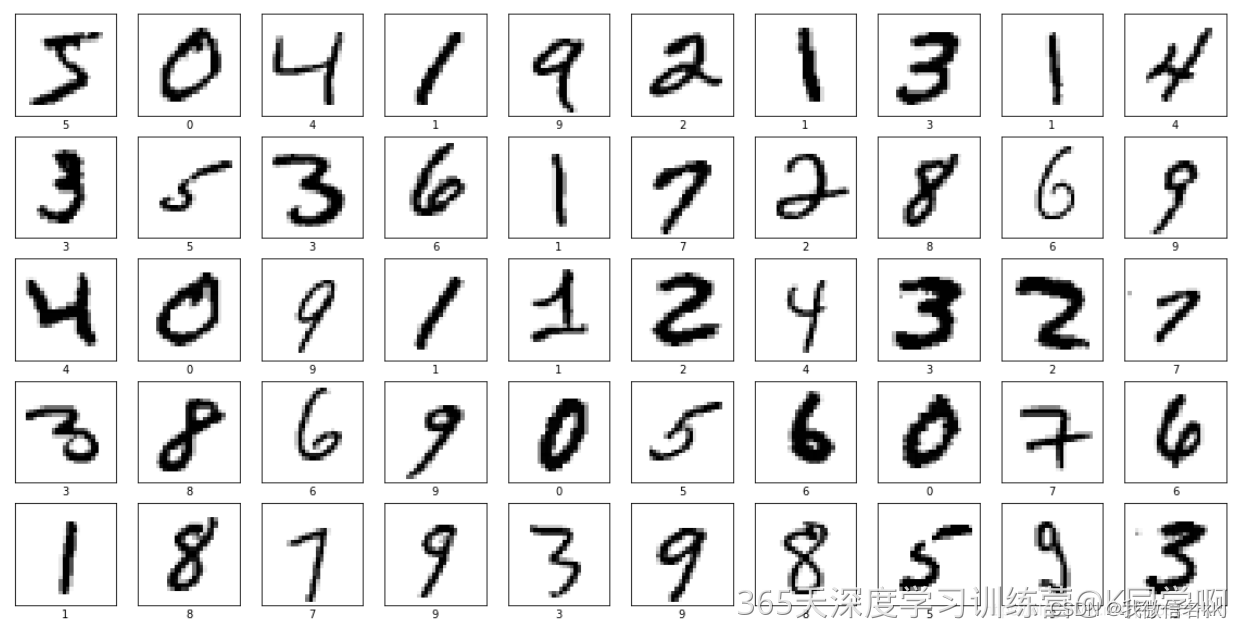

1. MNIST手写数字数据集介绍

MNIST手写数字数据集来源于是美国国家标准与技术研究所,是著名的公开数据集之一。数据集中的数字图片是由250个不同职业的人纯手写绘制,数据集获取的网址为:MNIST handwritten digit database, Yann LeCun, Corinna Cortes and Chris Burges(下载后需解压)。我们一般会采用(train_images, train_labels), (test_images, test_labels) = datasets.mnist.load_data()这行代码直接调用,这样就比较简单

MNIST手写数字数据集中包含了70000张图片,其中60000张为训练数据,10000为测试数据,70000张图片均是28*28,数据集样本如下:

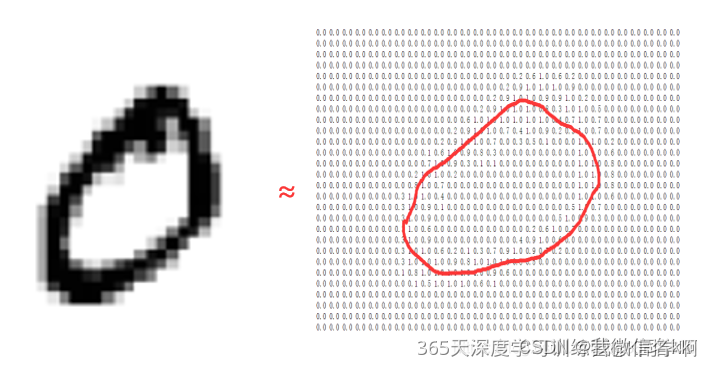

如果我们把每一张图片中的像素转换为向量,则得到长度为28*28=784的向量。因此我们可以把训练集看成是一个[60000,784]的张量,第一个维度表示图片的索引,第二个维度表示每张图片中的像素点。而图片里的每个像素点的值介于0-1之间。

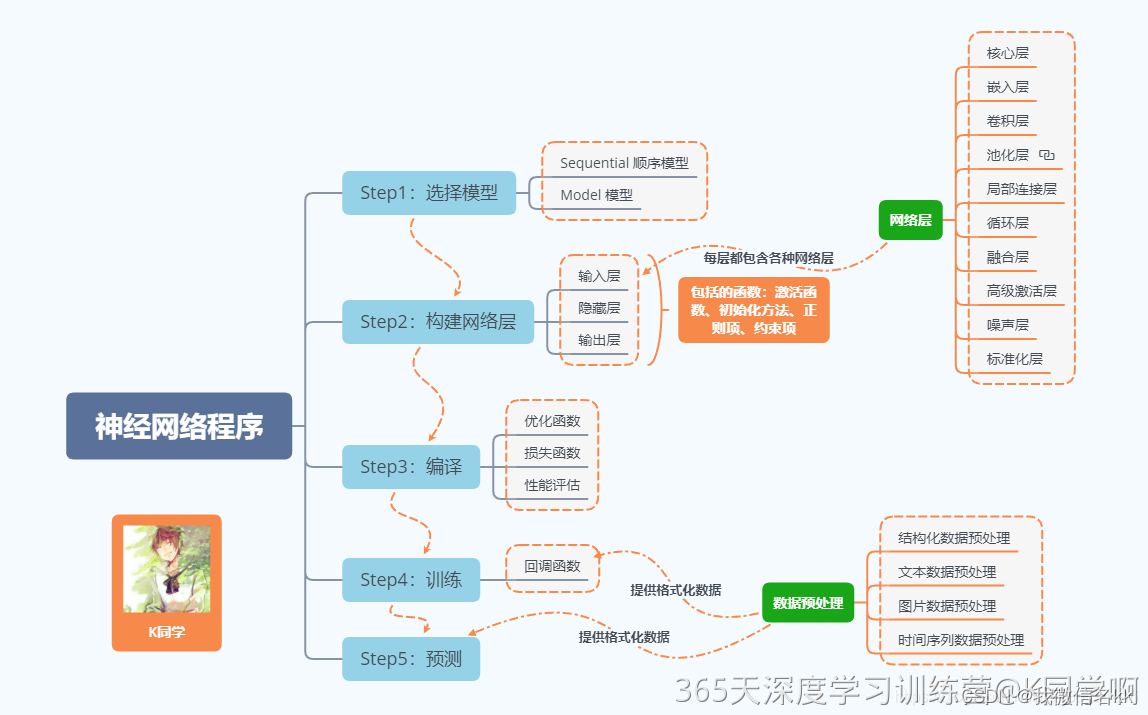

2. 神经网络程序说明

3.模型结构说明

各层的作用

- 输入层:用于将数据输入到训练网络

- 卷积层:使用卷积核提取图片特征

- 池化层:进行下采样,用更高层的抽象表示图像特征

- Flatten层:将多维的输入一维化,常用在卷积层到全连接层的过渡

- 全连接层:起到“特征提取器”的作用

- 输出层:输出结果

八、总结

本周的任务中,实现了手写数字识别的任务,第一点就是准备数据集,本次数据集是可以直接下载的不用导入,构建模型,使用的是最基础的- -LeNet-5,卷积层提取特征,池化层降采样,重复两遍之后来个flatten层拉伸一下,便于全连接层输入,全连接层得出分类结果。优化器损失函数直接放在# model.compile()方法用于在配置训练方法时,告知训练时用的优化器、损失函数和准确率评测标准#方法里面了,最后直接训练即可。整体比较顺利。