开源与专有软件之间的斗争早已为人所熟知。然而,长期以来弥漫在软件圈的紧张关系已经渗透到了人工智能领域,部分原因在于没有人能在AI背景下就“开源”的真正含义达成一致。

相关阅读:GPT-4o通过整合文本、音频和视觉实现人性化的AI交互,OpenAI推出了其新的旗舰模型GPT-4o,它无缝整合了文本、音频和视觉输入与输出,有望提高机器交互的自然性。现在Plus用户可以直接使用GPT-4o,关于如何开通Plus,可以使用WildCard平台。或者可以使用镜像站,已实现所有功能(包括实时语音对话)。

《纽约时报》最近发表了一篇对Meta CEO马克·扎克伯格的溢美之词,指出他对“开源AI”的拥抱使他在硅谷重新受欢迎。然而,大多数估计认为,Meta的Llama品牌的大型语言模型并不是真正的开源,这突显了争论的核心。WildCard也支持Claude, Midjourney, Adobe, Patreon, Midjourney, OF, X等的订阅。

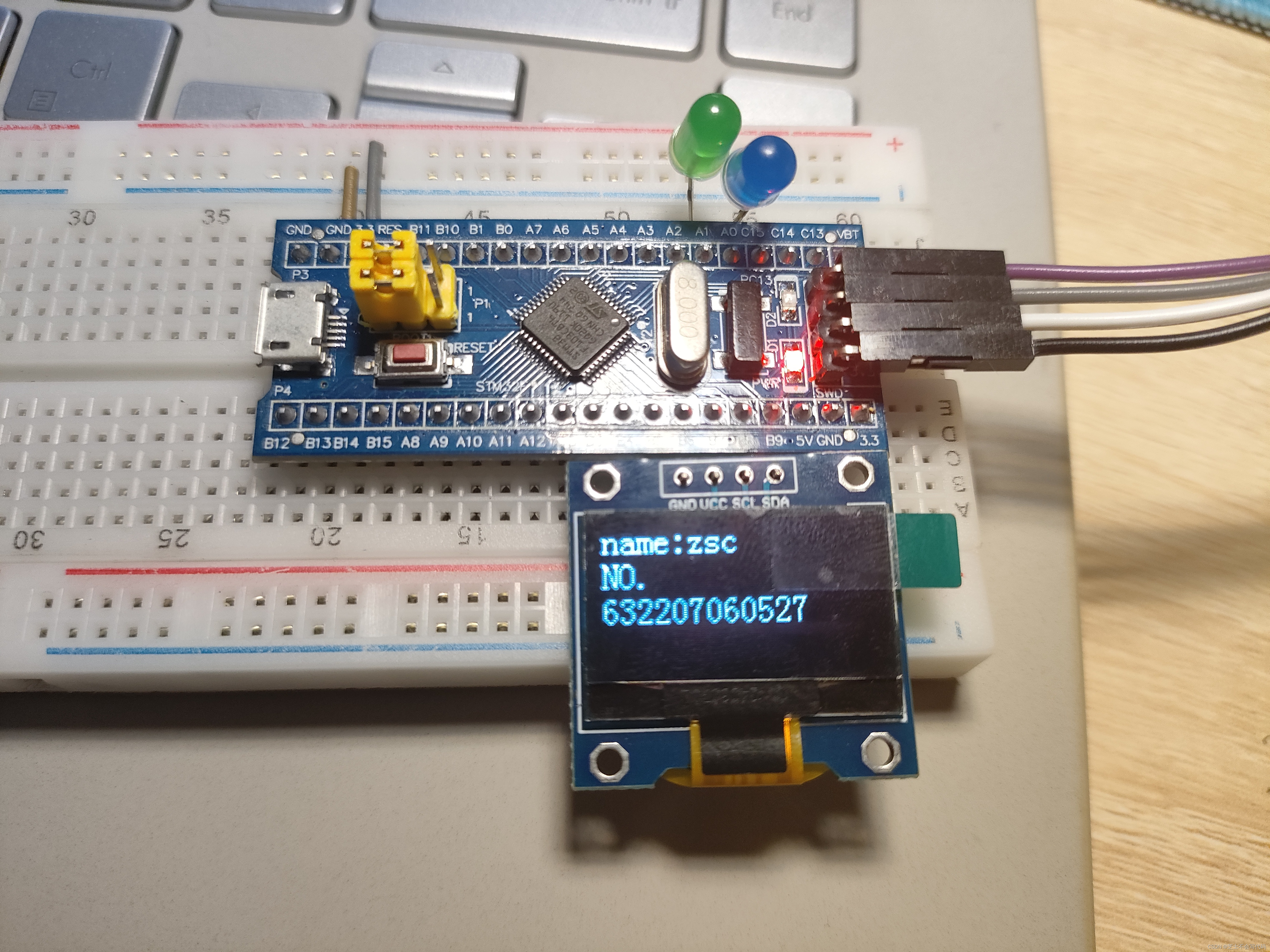

正是这一挑战促使开源倡议(OSI)试图解决这个问题,其执行董事斯特凡诺·马夫弗利(如上图)通过会议、研讨会、小组讨论、网络研讨会、报告等方式进行努力。

AI不是软件代码

OSI已经管理开源定义(OSD)超过四分之一个世纪,规定了“开源”一词在软件中的适用和应当应用的方式。符合这一定义的许可证可以合法地被认为是“开源”,尽管它承认存在从极其宽松到不那么宽松的许可证谱系。

但将软件中的遗留许可和命名惯例移植到AI上是有问题的。开源倡导者、风投公司OSS Capital创始人约瑟夫·杰克斯甚至表示,“不存在开源AI这种东西”,指出“开源是专为软件源代码发明的。”进一步说,“神经网络权重”(NNWs)——这是人工智能领域用来描述在训练过程中网络学习的参数或系数的术语——在任何有意义的方式上都无法与软件相比。

“神经网络权重不是软件源代码;它们对人类不可读,也无法调试,”杰克斯指出。“此外,开源的基本权利也不能以任何一致的方式转移到NNWs上。”

正是这些不一致性去年促使杰克斯和OSS Capital同事希瑟·米克尔提出了自己的定义,围绕“开放权重”的概念展开。马夫弗利对此也表示赞同。“这个观点是正确的,”他告诉TechCrunch。“我们最初的辩论之一是是否要将其称为开源AI,但每个人都已经在使用这个术语了。”

Meta分析

成立于1998年的OSI是一家非营利公共利益公司,围绕倡导、教育和其核心存在理由:开源定义,进行各种开源相关活动。如今,该组织依靠赞助进行资助,其成员包括亚马逊、谷歌、微软、思科、英特尔、Salesforce和Meta等。

Meta目前与OSI的关系尤其值得注意,因为它涉及到“开源AI”的概念。尽管Meta将其AI挂在开源的名义上,但该公司对其Llama模型的使用有显著的限制:当然,它们可以免费用于研究和商业用途,但每月用户超过7亿的应用开发者必须向Meta申请特别许可证,而Meta将完全自行决定是否授予该许可证。

Meta对其LLMs的语言有些灵活。虽然公司确实称其Llama 2模型为开源,但随着Llama 3的到来,该公司在术语上有所退缩,使用了“开放可用”和“开放可访问”等短语。然而,在某些地方,它仍将该模型称为“开源”。

“参与讨论的每个人都完全同意Llama本身不能被视为开源,”马夫弗利说。“我与Meta工作的人的对话中,他们知道这有点牵强。”

此外,有人可能会认为这里存在利益冲突:一家希望借用开源品牌的公司同时也为“定义”的管理者提供资金?

这也是OSI试图多样化其资金来源的原因之一,最近获得了斯隆基金会的资助,帮助其推动全球多方利益相关者达成开源AI定义。TechCrunch透露,这笔资助约为25万美元,马夫弗利希望这能改变其对企业资金依赖的印象。

“这正是斯隆资助使之更加清晰的事情之一:我们随时可以告别Meta的钱,”马夫弗利说。“即使在斯隆资助之前,我们也可以做到这一点,因为我知道我们将获得其他人的捐赠。Meta非常清楚这一点。他们没有干涉这一过程,微软、GitHub、亚马逊或谷歌也没有干涉——他们绝对知道他们不能干涉,因为组织的结构不允许这样做。”

开源AI的工作定义

当前的开源AI定义草案版本为0.0.8,包含三个核心部分:引言,概述了文件的范围;开源AI定义本身;以及检查表,列出了开源合规AI系统所需的组件。

根据当前草案,开源AI系统应允许用户在不寻求许可的情况下出于任何目的使用系统;允许他人研究系统的工作原理并检查其组件;以及修改和共享系统以任何目的。

但最大的挑战之一是数据——也就是说,如果公司没有提供训练数据集供他人检查,AI系统是否可以被归类为“开源”?根据马夫弗利的说法,了解数据的来源以及开发者如何标记、去重和过滤数据更为重要。同时,还要了解用来从各种来源组装数据集的代码。

“知道这些信息比单纯的数据集要好得多,”马夫弗利说。

虽然访问完整的数据集会很好(OSI将其视为“可选”组件),但马夫弗利表示,在许多情况下这是不可能或不实际的。这可能是因为数据集中包含了开发者没有权限重新分发的机密或受版权保护的信息。此外,还有一些训练机器学习模型的技术,其中数据本身实际上并未与系统共享,如联邦学习、差分隐私和同态加密。

这正好突显了“开源软件”和“开源AI”之间的根本区别:意图可能相似,但它们并不完全可比,这种差异正是OSI试图在其定义中捕捉的。

在软件中,源代码和二进制代码是同一工件的两种视图:它们以不同形式反映同一个程序。但训练数据集和随后的训练模型是不同的东西:你可以使用同一个数据集,但不一定能一致地重新创建同一个模型。

“在训练过程中发生的各种统计和随机逻辑意味着它不能像软件一样具有可重复性,”马夫弗利补充道。

因此,开源AI系统应该易于复制,并有明确的说明。这就是开源AI定义检查表的作用,该检查表基于最近发表的一篇学术论文《模型开放性框架:促进人工智能的可复现性、透明度和可用性的完整性和开放性》。

这篇论文提出了模型开放性框架(MOF),一个基于模型完整性和开放性对机器学习模型进行评分的分类系统。MOF要求AI模型开发的特定组件“在适当的开源许可证下包含并发布”,包括训练方法和模型参数的详细信息。

稳定的条件

OSI称定义的正式发布为“稳定版本”,就像一个公司在应用程序经过广泛测试和调试后准备好投放市场时所做的那样。OSI故意不称其为“最终发布”,因为其部分内容可能会不断发展。

“我们不能指望这个定义像开源定义一样持续26年,”马夫弗利说。“我不认为定义的顶部部分——例如‘什么是AI系统?’——会有很大变化。但我们在检查表中提到的部分,那些组件列表取决于技术?明天,谁知道技术会是什么样子。”

稳定的开源AI定义预计将在10月底的All Things Open会议上由董事会批准,在此期间,OSI将在全球范围内进行巡回演讲,横跨五大洲,寻求更多关于“开源AI”定义的“多样化输入”。但任何最终的更改可能只是一些“小调整”。

“这是最后的冲刺,”马夫弗利说。“我们已经达到了定义的功能完整版本;我们有了所有需要的元素。现在我们有了检查表,所以我们正在检查其中没有意外;没有系统应该包含或排除。”