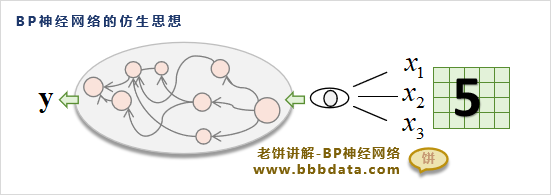

本文来自:老饼讲解-BP神经网络 https://www.bbbdata.com

目录

一、BP神经网络的仿生意义

二、BP神经网络的结构

三、BP神经网络的前馈与后馈

3.1 BP神经网络的前馈

3.2 什么是BP神经网络的后馈

四、BP神经网络的训练

4.1 BP神经网络归一化

4.2 梯度下降算法求解BP神经网络

五、用matlab工具箱实现BP神经网络

5.1 问题阐述

5.2 matlab实现BP神经网络代码

一、BP神经网络的仿生意义

BP神经网络的设计思路是什么呢?它借鉴于人脑的工作原理

在人的眼睛看到符号“5”的后,大脑将判别出它是5

BP正是要模仿这个行为,把这个行为过程简单拆分为:

(1) 眼睛接受了输入

(2) 把输入信号传给其它脑神经元

(3) 脑神经元综合处理后,输出结果为5

我们都知道, 神经元与神经元之间是以神经冲动的模式进行传值,信号到了神经元,都是以电信号的形式存在,当电信号在神经元积累到超过阈值时,就会触发神经冲动,将电信号传给其它神经元。正是根据这个思路,就构造出了以上的神经网络结构。

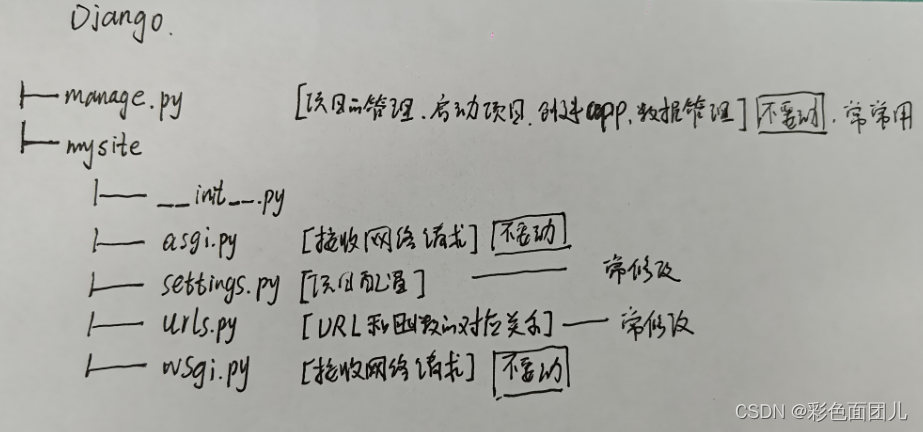

二、BP神经网络的结构

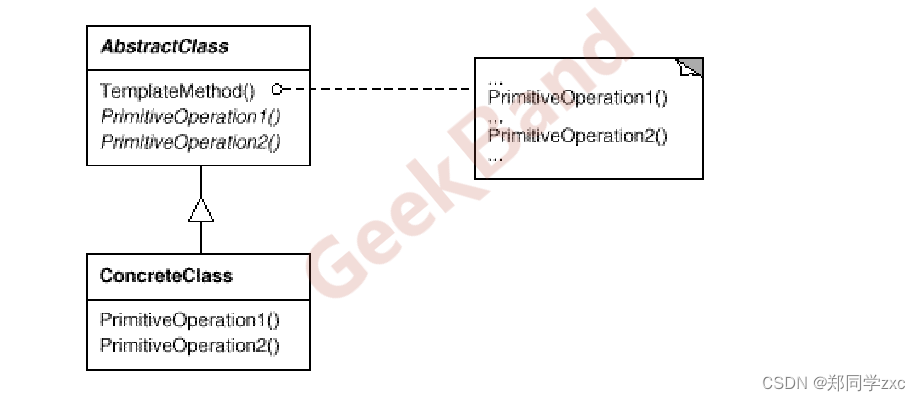

BP的通用结构如下

在通用结构中,包含了输入层、隐层和输出层,隐层和输出层的神经元都有自己的阈值和激活函数

它属于前馈型神经网络,即神经元是层层连接、逐层向前传递

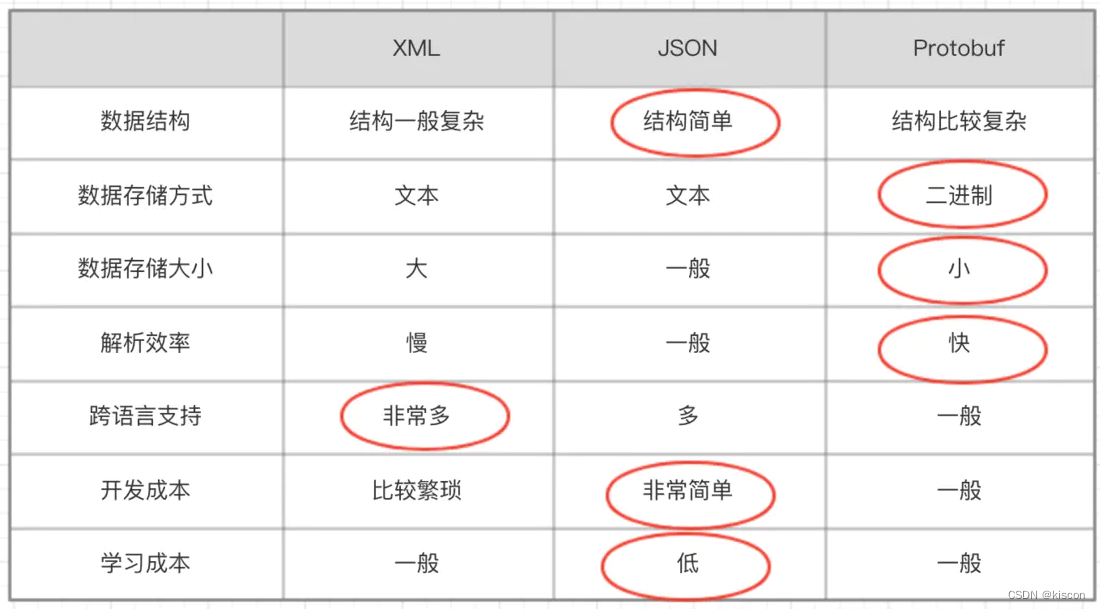

BP神经网络的传递函数最基本、最常用的传递函数有tansig、logsig和purelin函数,BP神经网络的传递函数也称为激活函数,本文介绍这三个传递函数的一些性质

三、BP神经网络的前馈与后馈

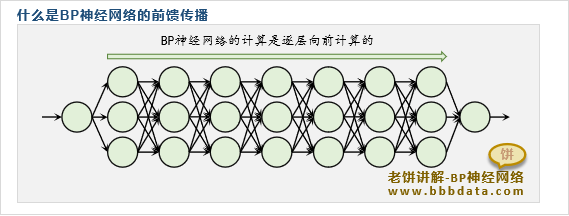

3.1 BP神经网络的前馈

正向传播(前馈)是指BP神经网络的输出计算过程是前馈的,

即计算完一层,得到结果,再以该层的结果作为下层的输入,计算下一层

用网络的输入计算第一层的输出,

把第一层的输出作为第二层的输入,计算第二层的输出

把第二层的输出作为第三层的输入,计算第三层的输出

....

直到最后一层的输出,就是网络的输出

一般说BP神经网络的前馈、向前传播等等,实际说的就是"BP神经网络输出的计算过程"

3.2 什么是BP神经网络的后馈

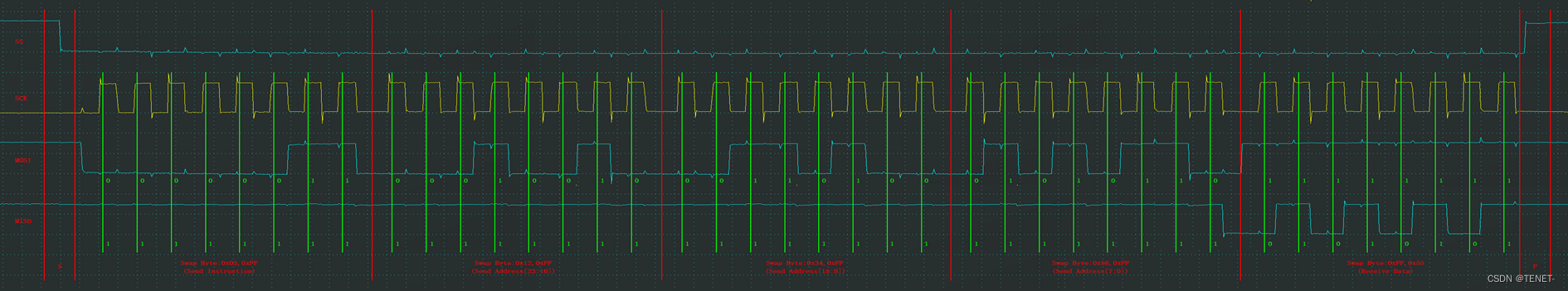

反向传播指的是BP神经网络计算参数的梯度时的计算方式

由于BP神经网络求解时所使用的是梯度下降算法(或其他算法),这些算法一般都需要利用误差函数对参数的梯度

因此,计算梯度是BP神经网络训练中重要的一部分,而反向传播式地计算梯度就是BP神经网络的特色,

BP神经网络之所以叫BP(Back Propagation Neural Network)神经网络,指的正是它计算梯度时这种后馈的特色

BP神经网络是如何反向传播式计算梯度的,如下,是一个K层的BP神经网络:

四、BP神经网络的训练

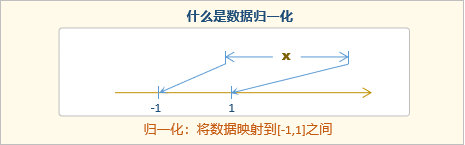

4.1 BP神经网络归一化

BP神经网络归一化一般是指按公式将数据归一化到[-1,1]之间,

反归一化则是把归一化后的数据映射回原始数据,在训练阶段和应用阶段都涉及到数据归一化的相关处理 ,训练阶段需要在训练前把所有数据归一化后再进行训练

其中,归一化公式如下:

4.2 梯度下降算法求解BP神经网络

梯度下降求解BP神经网络的算法流程如下:

1. 先初始化W,b

2. 按照梯度公式算出梯度

3. 将W和b往负梯度方向调整

4. 不断循环(1)(2)(3),直到达到终止条件

终止条件为:达到最大迭代次数,或误差足够小

详细实现代码:

matlab实现BP神经网络的代码-不调用工具箱自己实现-老饼讲解

五、用matlab工具箱实现BP神经网络

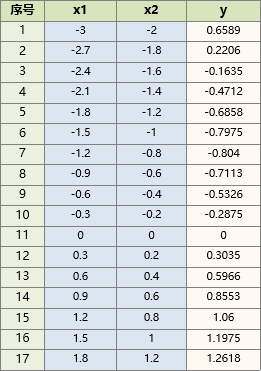

5.1 问题阐述

现有数据如下

x1, x2 为输入,y 为对应的输出,现需要训练一个网络,用 x1, x2 预测 y

5.2 matlab实现BP神经网络代码

通过代码,使用数据对上面的BP神经网络模型进行训练,下面是matlab2018a的代码实现

x1 = [-3,-2.7,-2.4,-2.1,-1.8,-1.5,-1.2,-0.9,-0.6,-0.3,0,0.3,0.6,0.9,1.2,1.5,1.8]; % x1:x1 = -3:0.3:2;

x2 = [-2,-1.8,-1.6,-1.4,-1.2,-1,-0.8,-0.6,-0.4,-0.2,0,0.2,0.4,0.6,0.8,1,1.2]; % x2:x2 = -2:0.2:1.2;

y = [0.6589,0.2206,-0.1635,-0.4712,-0.6858,-0.7975,-0.8040,...

-0.7113,-0.5326,-0.2875 ,0,0.3035,0.5966,0.8553,1.0600,1.1975,1.2618]; % y: y = sin(x1)+0.2*x2.*x2;

inputData = [x1;x2]; % 将x1,x2作为输入数据

outputData = y; % 将y作为输出数据

setdemorandstream(88888); % 指定随机种子,这样每次训练出来的网络都一样。

%使用用输入输出数据(inputData、outputData)建立网络,

%隐节点个数设为3.其中隐层、输出层的传递函数分别为tansig和purelin,使用trainlm方法训练。

net = newff(inputData,outputData,3,{'tansig','purelin'},'trainlm');

%设置一些常用参数

net.trainparam.goal = 0.0001; % 训练目标:均方误差低于0.0001

net.trainparam.show = 400; % 每训练400次展示一次结果

net.trainparam.epochs = 15000; % 最大训练次数:15000.

[net,tr] = train(net,inputData,outputData); % 调用matlab神经网络工具箱自带的train函数训练网络

simout = sim(net,inputData); % 调用matlab神经网络工具箱自带的sim函数得到网络的预测值

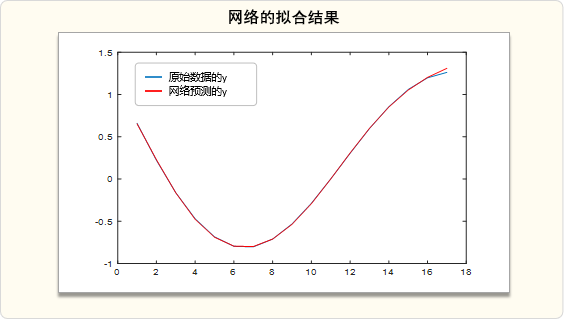

figure; % 新建画图窗口窗口

t=1:length(simout);

plot(t,y,t,simout,'r') % 画图,对比原来的y和网络预测的y运行代码后得到训练数据的拟合效果图如下

可以看到,对于训练数据,模型的预测与原始数据基本一致

上面已经得到训练好的模型,在新的x数据进来时,就可以借助网络,对y作出预测.

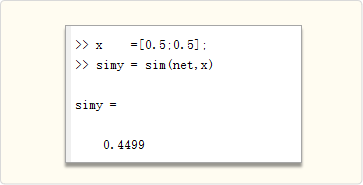

如果想知道 x1=0.5, x2=0.5时的值,可输入如下代码

x =[0.5;0.5];

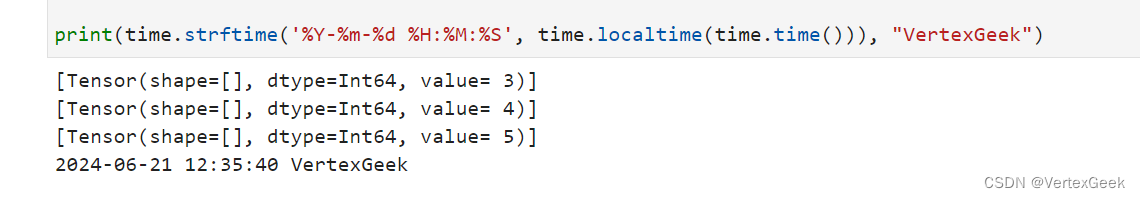

simy = sim(net,x)命令窗口输出如下

这样,就得到了输入为 [0.5,0.5] 时,y的预测值.

以上就是一个BP神经网络的简单应用例子了~

相关链接:

《老饼讲解-机器学习》:老饼讲解-机器学习教程-通俗易懂

《老饼讲解-神经网络》:老饼讲解-matlab神经网络-通俗易懂

《老饼讲解-深度学习》:深度学习-Pytorch教程-pytorch入门