在本文中我们将学习DeepSeek量化微调的方法,并且从微调结果体会大模型微调的重要性。

引言

在当前快速发展的自然语言处理领域,模型的精度和效率是关键。量化和微调技术可以有效提高模型性能。本文将探讨如何对DeepSeek-7B-chat模型进行4bits量化,并利用Qlora技术进行微调,以实现高效的模型部署。

什么是模型量化?

模型量化是将高精度的浮点数表示转换为低精度表示(如4bits),以减少模型的存储和计算资源。量化可以显著降低模型的内存占用和计算复杂度,同时保持较高的推理性能。

DeepSeek-7B-chat模型

DeepSeek-7B-chat是一个大规模的语言模型,设计用于对话生成和语言理解。其庞大的参数量使得直接部署在资源受限的环境中具有挑战性,因此量化技术尤为重要。

Qlora 技术简介

Qlora(Quantized Low-Rank Adapter)是一种优化微调技术,适用于量化后的模型。通过低秩近似和适应层的结合,Qlora在微调阶段保持高效,并在不显著增加计算成本的情况下提高模型性能。

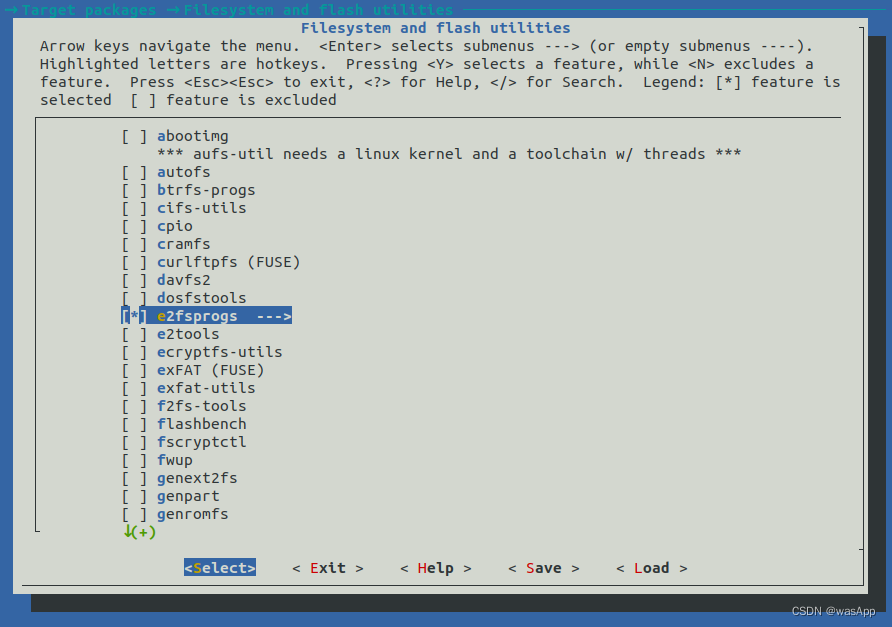

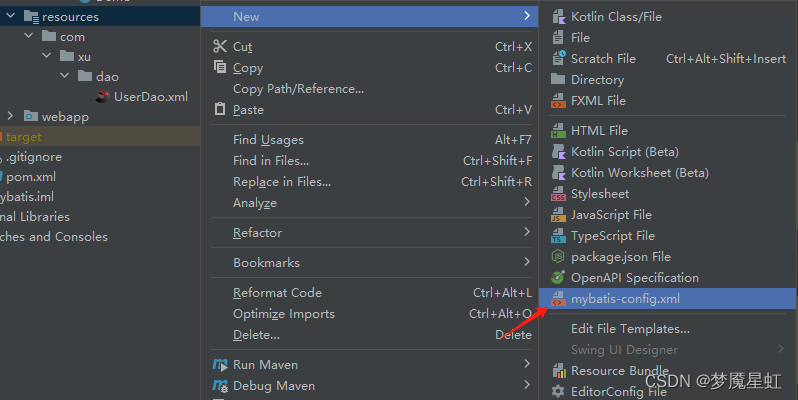

环境配置

pip install transformers==4.35.2

pip install peft==0.4.0

pip install datasets==2.10.1

pip install accelerate==0.20.3

pip install tiktoken

pip install transformers_stream_generator

pip install bitsandbytes==0.41.1指令集构建

LLM 的微调一般指指令微调过程。所谓指令微调,是说我们使用的微调数据形如:

{

"instrution":"回答以下用户问题,仅输出答案。",

"input":"1+1等于几?",

"output":"2"

}

其中,instruction 是用户指令,告知模型其需要完成的任务;input 是用户输入,是完成用户指令所必须的输入内容;output 是模型应该给出的输出。即我们的核心训练目标是让模型具有理解并遵循用户指令的能力。因此,在指令集构建时,我们应针对我们的目标任务,针对性构建任务指令集。

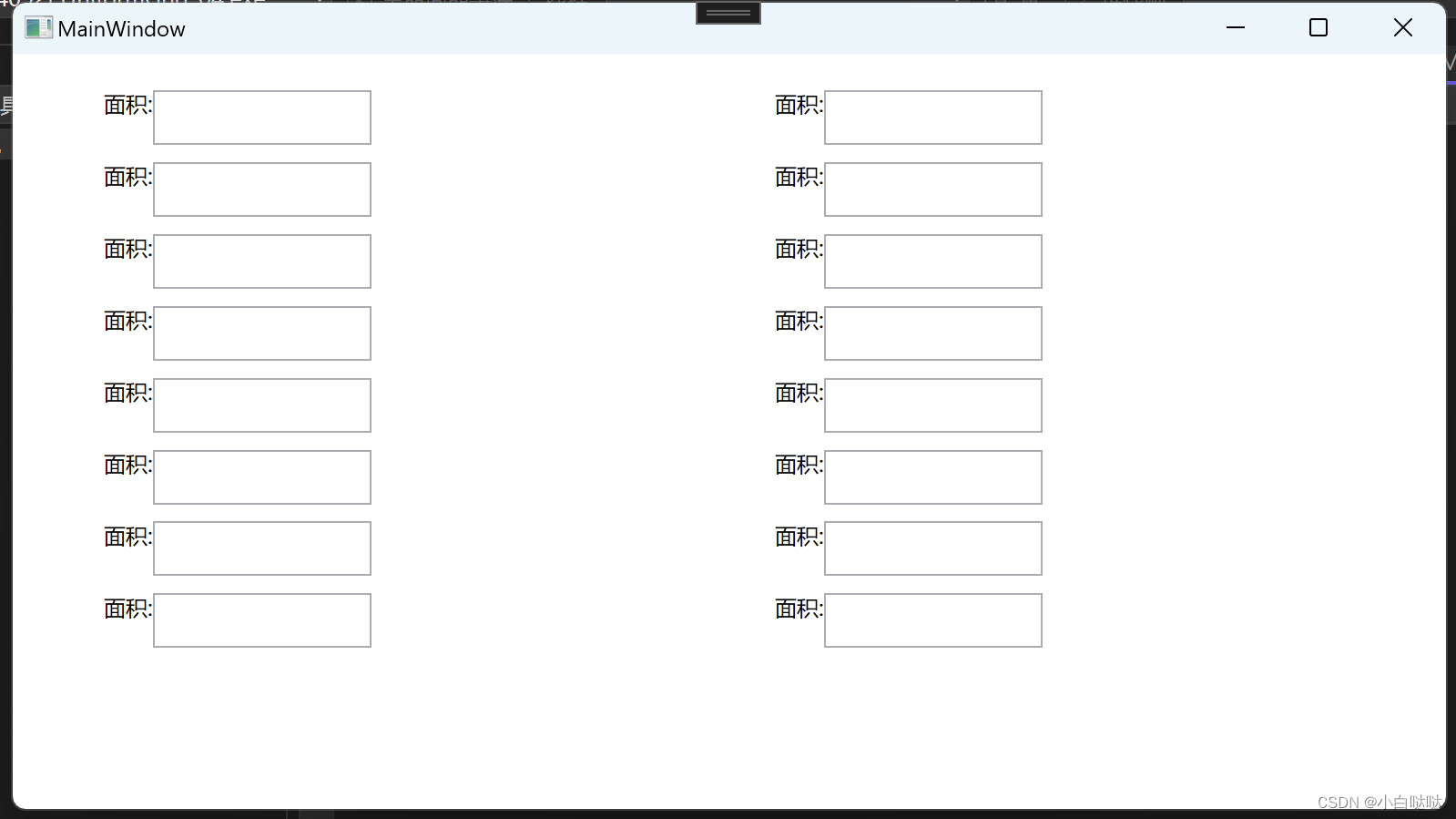

数据格式化

Lora 训练的数据是需要经过格式化、编码之后再输入给模型进行训练的,如果是熟悉 Pytorch 模型训练流程的同学会知道,我们一般需要将输入文本编码为 input_ids,将输出文本编码为 labels,编码之后的结果都是多维的向量。我们首先定义一个预处理函数,这个函数用于对每一个样本,编码其输入、输出文本并返回一个编码后的字典:

def process_func(example):

MAX_LENGTH = 384 # Llama分词器会将一个中文字切分为多个token,因此需要放开一些最大长度,保证数据的完整性

input_ids, attention_mask, labels = [], [], []

instruction = tokenizer(f"User: {example['instruction']+example['input']}\n\n", add_special_tokens=False) # add_special_tokens 不在开头加 special_tokens

response = tokenizer(f"Assistant: {example['output']}<|end▁of▁sentence|>", add_special_tokens=False)

input_ids = instruction["input_ids"] + response["input_ids"] + [tokenizer.pad_token_id]

attention_mask = instruction["attention_mask"] + response["attention_mask"] + [1] # 因为eos token咱们也是要关注的所以 补充为1

labels = [-100] * len(instruction["input_ids"]) + response["input_ids"] + [tokenizer.pad_token_id]

if len(input_ids) > MAX_LENGTH: # 做一个截断

input_ids = input_ids[:MAX_LENGTH]

attention_mask = attention_mask[:MAX_LENGTH]

labels = labels[:MAX_LENGTH]

return {

"input_ids": input_ids,

"attention_mask": attention_mask,

"labels": labels

}加载tokenizer和半精度模型

tokenizer = AutoTokenizer.from_pretrained('./deepseek-ai/deepseek-llm-7b-chat/', use_fast=False, trust_remote_code=True)

tokenizer.padding_side = 'right' # padding在右边

model = AutoModelForCausalLM.from_pretrained(

'/root/model/deepseek-ai/deepseek-llm-7b-chat/',

trust_remote_code=True,

torch_dtype=torch.half,

device_map="auto",

low_cpu_mem_usage=True, # 是否使用低CPU内存

load_in_4bit=True, # 是否在4位精度下加载模型。如果设置为True,则在4位精度下加载模型。

bnb_4bit_compute_dtype=torch.half, # 4位精度计算的数据类型。这里设置为torch.half,表示使用半精度浮点数。

bnb_4bit_quant_type="nf4", # 4位精度量化的类型。这里设置为"nf4",表示使用nf4量化类型。

bnb_4bit_use_double_quant=True # 是否使用双精度量化。如果设置为True,则使用双精度量化。

)

model.generation_config = GenerationConfig.from_pretrained('/root/model/deepseek-ai/deepseek-llm-7b-chat/')

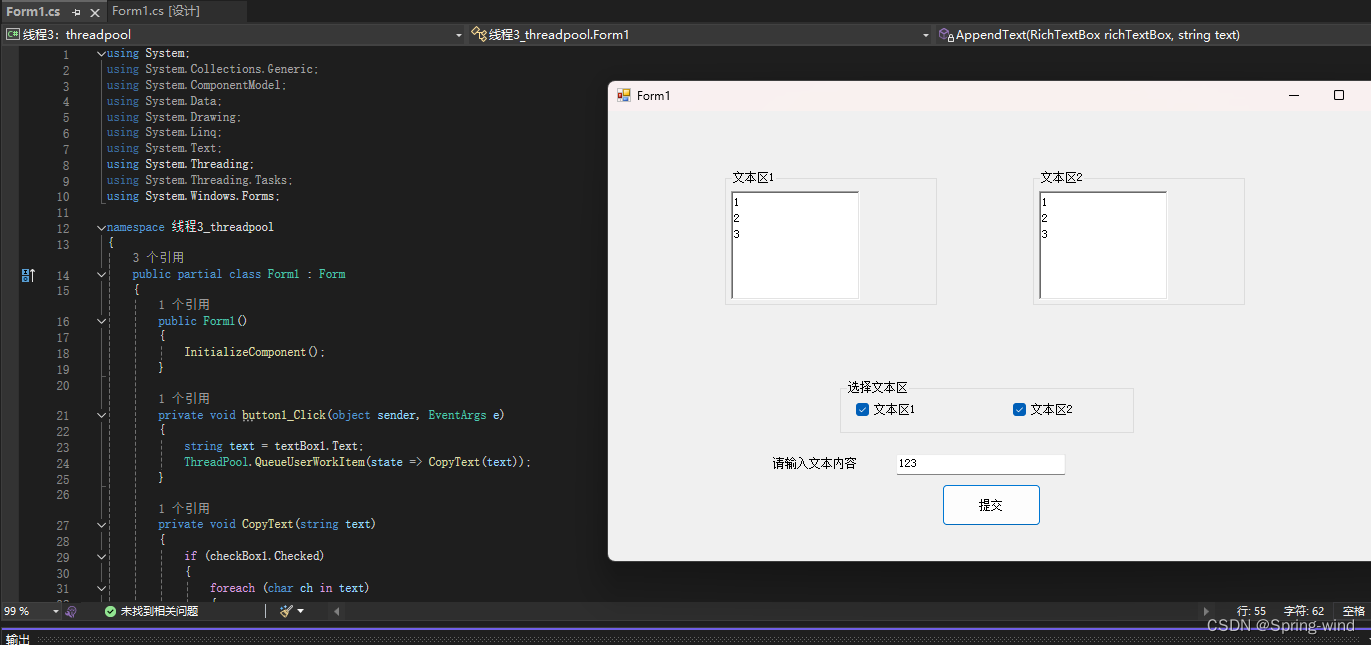

model.generation_config.pad_token_id = model.generation_config.eos_token_id定义LoraConfig

task_type:模型类型target_modules:需要训练的模型层的名字,主要就是attention部分的层,不同的模型对应的层的名字不同,可以传入数组,也可以字符串,也可以正则表达式。r:lora的秩,具体可以看Lora原理lora_alpha:Lora alaph,具体作用参见Lora原理

config = LoraConfig(

task_type=TaskType.CAUSAL_LM,

target_modules=["q_proj", "k_proj", "v_proj", "o_proj", "gate_proj", "up_proj", "down_proj"],

inference_mode=False, # 训练模式

r=8, # Lora 秩

lora_alpha=32, # Lora alaph,具体作用参见 Lora 原理

lora_dropout=0.1# Dropout 比例

)自定义 TrainingArguments 参数

output_dir:模型的输出路径per_device_train_batch_size:顾名思义batch_sizegradient_accumulation_steps: 梯度累加,如果你的显存比较小,那可以把batch_size设置小一点,梯度累加增大一些。logging_steps:多少步,输出一次lognum_train_epochs:顾名思义epochgradient_checkpointing:梯度检查,这个一旦开启,模型就必须执行model.enable_input_require_grads(),这个原理大家可以自行探索,这里就不细说了。optim="paged_adamw_32bit"使用QLora的分页器加载优化器

args = TrainingArguments(

output_dir="./output/DeepSeek",

per_device_train_batch_size=8,

gradient_accumulation_steps=2,

logging_steps=10,

num_train_epochs=3,

save_steps=100,

learning_rate=1e-4,

save_on_each_node=True,

gradient_checkpointing=True,

optim="paged_adamw_32bit" # 优化器类型

)使用 Trainer 训练

trainer = Trainer(

model=model,

args=args,

train_dataset=tokenized_id,

data_collator=DataCollatorForSeq2Seq(tokenizer=tokenizer, padding=True),

)

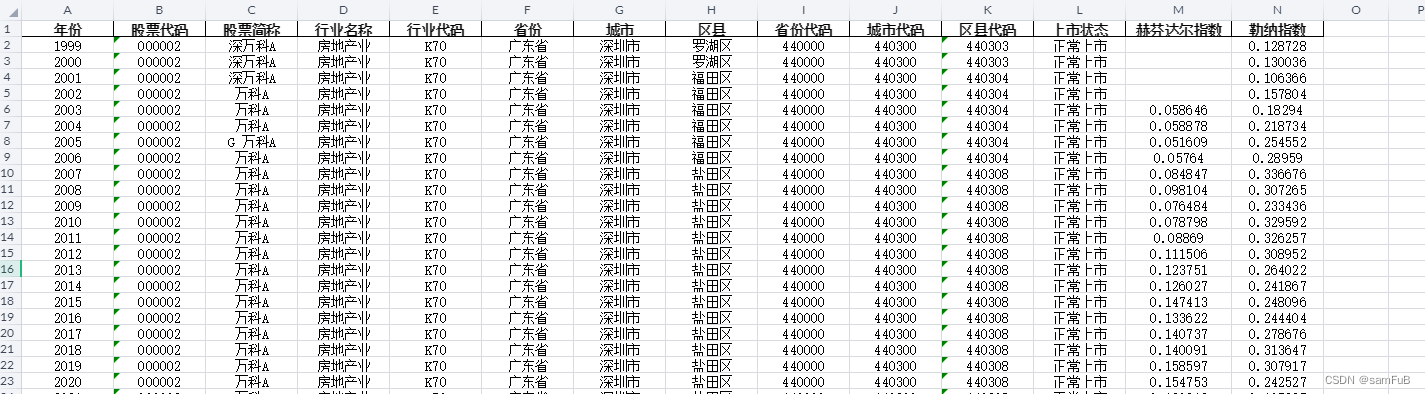

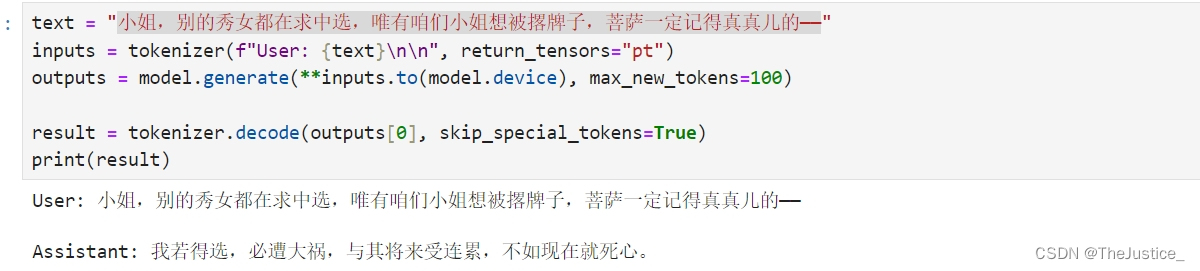

trainer.train()在利用量化微调之后,我们能明显看出大模型的推理能力增强,结果如下:

效果很明显,当没有进行微调时,模型的理解能力还停留在信息检索层面,当微调之后,我们能进入角色对话状态,很好地带入语境。

以此模型微调为基础,我们可以深入探讨模型的量化与微调。

模型量化是将模型权重从高精度的浮点数表示(如32位浮点数)转换为低精度表示(如8位、4位甚至1位),以减少模型的内存占用和计算资源。常见的量化方法包括:

- 静态量化:在训练后对模型进行量化。

- 动态量化:在推理过程中进行量化。

- 量化感知训练(QAT):在训练过程中模拟量化的影响。

量化的好处

- 减少内存占用:显著减少模型的存储空间。

- 加速推理:降低计算复杂度,提高推理速度。

- 节省能耗:在移动设备或嵌入式系统中,量化模型能显著降低能耗。

量化过程 以4bits量化为例,主要步骤包括:

- 缩放和零点计算:将浮点数范围映射到整数范围。

- 量化权重和激活:使用缩放因子和零点进行量化。

- 反量化:在推理时将量化值恢复为浮点数进行计算。

QLoRA 简介 QLoRA(Quantized Low-Rank Adapter)是一种优化微调技术,结合了量化和低秩适配层,通过降低模型参数的秩和引入适配层,实现高效微调。

QLoRA 的优势

- 高效训练:减少训练参数,降低计算资源需求。

- 保持性能:在量化后的模型上进行微调,保持模型的高性能。

- 灵活性强:适用于多种模型和任务,特别是大规模语言模型。

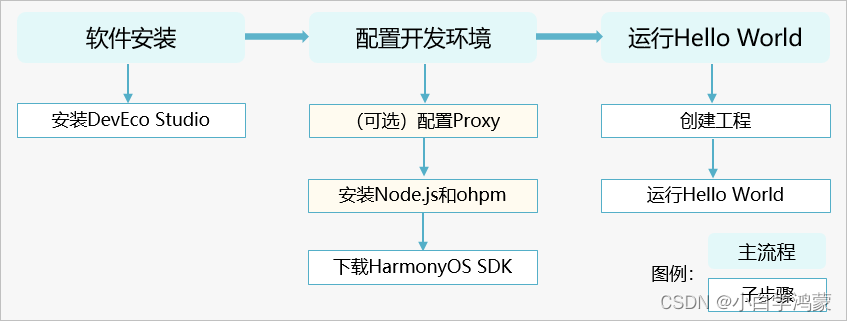

QLoRA 微调步骤

- 数据准备:整理微调所需的数据集。

- 模型量化:先对模型进行量化,如前文的4bits量化。

- 低秩适配:使用低秩近似技术降低模型参数的秩。

- 适配层训练:引入适配层,结合数据进行微调。

学习原文链接