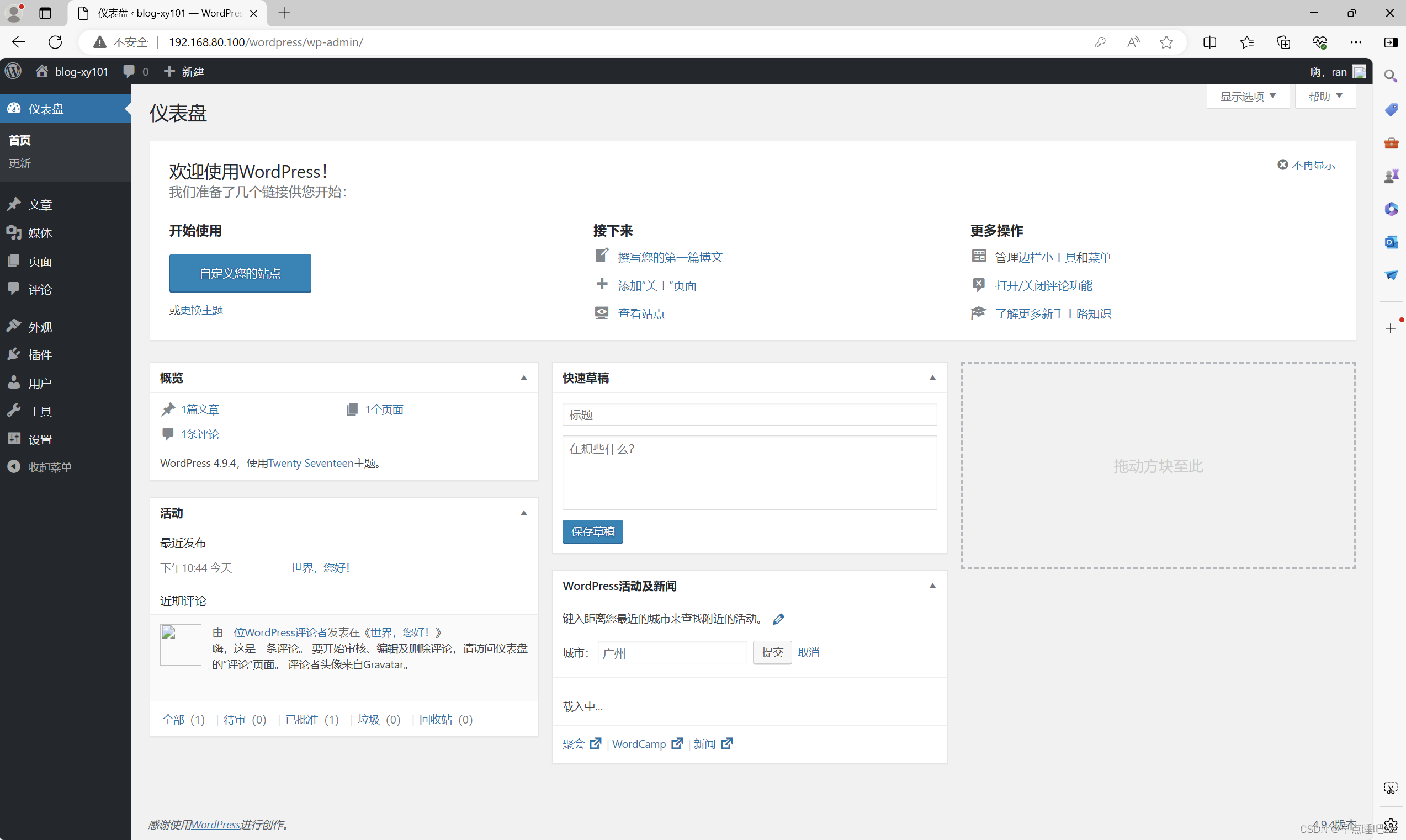

yolov8逐步分解(1)--默认参数&超参配置文件加载

yolov8逐步分解(2)_DetectionTrainer类初始化过程

yolov8逐步分解(3)_trainer训练之模型加载_yolov8 加载模型-CSDN博客

YOLOV8逐步分解(4)_模型的构建过程

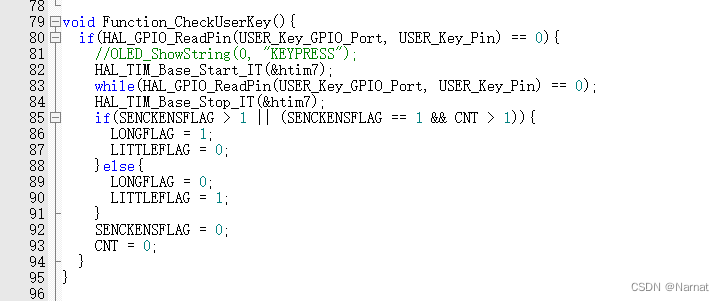

在上述文章逐步分解(3)和(4)中主要讲解了模型训练初始设置中self.setup_model()函数模型的加载及构建过程,本章将讲解混合精度训练AMP的相关代码。

下面是_setup_train()函数的详细代码。

def _setup_train(self, world_size):

""" Builds dataloaders and optimizer on correct rank process. """

# Model

self.run_callbacks('on_pretrain_routine_start')

ckpt = self.setup_model()#加载模型

self.model = self.model.to(self.device)

self.set_model_attributes()

# Check AMP

self.amp = torch.tensor(self.args.amp).to(self.device) # True or False

if self.amp and RANK in (-1, 0):

callbacks_backup = callbacks.default_callbacks.copy() # backup callbacks as check_amp() resets them

self.amp = torch.tensor(check_amp(self.model), device=self.device) #使用 check_amp 函数检查模型是否支持混合精度

callbacks.default_callbacks = callbacks_backup # restore callbacks, 恢复回之前备份的回调函数

if RANK > -1 and world_size > 1: # DDP 使用 dist.broadcast 将 self.amp 张量从rank 0广播到其他所有rank(返回None)。

dist.broadcast(self.amp, src=0) # broadcast the tensor from rank 0 to all other ranks (returns None)

self.amp = bool(self.amp) # as boolean

self.scaler = amp.GradScaler(enabled=self.amp) #创建一个 scaler 对象,用于在混合精度训练中缩放梯度

if world_size > 1:

self.model = DDP(self.model, device_ids=[RANK])

# Check imgsz

gs = max(int(self.model.stride.max() if hasattr(self.model, 'stride') else 32), 32) # grid size (max stride)

self.args.imgsz = check_imgsz(self.args.imgsz, stride=gs, floor=gs, max_dim=1)

# Batch size

if self.batch_size == -1: #表示批量大小需要自动估计

if RANK == -1: # single-GPU only, estimate best batch size

self.args.batch = self.batch_size = check_train_batch_size(self.model, self.args.imgsz, self.amp)#估计最佳批量大小

else:

SyntaxError('batch=-1 to use AutoBatch is only available in Single-GPU training. '

'Please pass a valid batch size value for Multi-GPU DDP training, i.e. batch=16')

# Dataloaders

batch_size = self.batch_size // max(world_size, 1)

self.train_loader = self.get_dataloader(self.trainset, batch_size=batch_size, rank=RANK, mode='train')#获取训练集

if RANK in (-1, 0):

self.test_loader = self.get_dataloader(self.testset, batch_size=batch_size * 2, rank=-1, mode='val') #获取测试集

self.validator = self.get_validator() #创建验证器(validator),用于评估模型在验证数据集上的性能。

metric_keys = self.validator.metrics.keys + self.label_loss_items(prefix='val')

self.metrics = dict(zip(metric_keys, [0] * len(metric_keys))) # TODO: init metrics for plot_results()?

self.ema = ModelEMA(self.model)

if self.args.plots and not self.args.v5loader: #如果 self.args.plots 为真且 self.args.v5loader 为假

self.plot_training_labels() #绘制训练标签的图表

# Optimizer

self.accumulate = max(round(self.args.nbs / self.batch_size), 1) # accumulate loss before optimizing

weight_decay = self.args.weight_decay * self.batch_size * self.accumulate / self.args.nbs # scale weight_decay

iterations = math.ceil(len(self.train_loader.dataset) / max(self.batch_size, self.args.nbs)) * self.epochs

self.optimizer = self.build_optimizer(model=self.model,

name=self.args.optimizer,

lr=self.args.lr0,

momentum=self.args.momentum,

decay=weight_decay,

iterations=iterations)

# Scheduler

if self.args.cos_lr:

self.lf = one_cycle(1, self.args.lrf, self.epochs) # cosine 1->hyp['lrf']

else:

self.lf = lambda x: (1 - x / self.epochs) * (1.0 - self.args.lrf) + self.args.lrf # linear

self.scheduler = optim.lr_scheduler.LambdaLR(self.optimizer, lr_lambda=self.lf)

self.stopper, self.stop = EarlyStopping(patience=self.args.patience), False

self.resume_training(ckpt) #恢复训练过程。ckpt 是一个检查点文件,用于加载之前保存的模型和训练状态。

self.scheduler.last_epoch = self.start_epoch - 1 # do not move

self.run_callbacks('on_pretrain_routine_end') #运行预训练过程结束时的回调函数。1. setup_model()的代码讲解

前面已经讲解了self.setup_model()的代码,这里再简单介绍一下相关代码:

# Model

self.run_callbacks('on_pretrain_routine_start')

ckpt = self.setup_model()#加载模型

self.model = self.model.to(self.device)

self.set_model_attributes()1.1 self.run_callbacks('on_pretrain_routine_start'):

这行代码触发了预训练例程开始的回调函数。回调函数是一种允许在训练过程中的特定时间点执行自定义操作的机制。

在这里,可能有一些定制的操作需要在模型预训练开始时执行,比如日志记录、模型参数初始化等。

1.2. ckpt = self.setup_model():

这行代码调用了 self.setup_model() 方法,它负责设置和加载模型。

ckpt 变量可能保存着模型的检查点(checkpoint)信息,例如预训练的权重等,以便后续使用。

1.3. self.model = self.model.to(self.device):

这行代码将模型移动到指定的设备上,通常是 GPU 或 CPU。

这是为了确保模型的计算在正确的硬件设备上进行,以利用硬件加速提高训练效率。

1.4. self.set_model_attributes():

这行代码调用了 self.set_model_attributes() 方法,可能用于设置或更新模型的一些属性。

Yolov8中用于设置属性names。

这段代码是模型训练流程的初始化阶段。它执行了一些必要的模型加载构建等设置和准备工作,为后续的训练过程做好了准备。

2. 混合精度训练MAP代码讲解

# Check AMP

self.amp = torch.tensor(self.args.amp).to(self.device) # True or False

if self.amp and RANK in (-1, 0):

callbacks_backup = callbacks.default_callbacks.copy() # backup callbacks as check_amp() resets them

self.amp = torch.tensor(check_amp(self.model), device=self.device) #使用 check_amp 函数检查模型是否支持混合精度

callbacks.default_callbacks = callbacks_backup # restore callbacks, 恢复回之前备份的回调函数

if RANK > -1 and world_size > 1: # DDP 使用 dist.broadcast 将 self.amp 张量从rank 0广播到其他所有rank(返回None)。

dist.broadcast(self.amp, src=0) # broadcast the tensor from rank 0 to all other ranks (returns None)

self.amp = bool(self.amp) # as boolean

self.scaler = amp.GradScaler(enabled=self.amp) #创建一个 scaler 对象,用于在混合精度训练中缩放梯度

if world_size > 1:

self.model = DDP(self.model, device_ids=[RANK])上述代码是处理模型的混合精度训练(Automatic Mixed Precision, AMP),可以参考文章深度学习之混合精度训练AMP介绍。下面逐步解释一下它的代码:

2.1 self.amp = torch.tensor(self.args.amp).to(self.device):

这行代码将用户传入的 self.args.amp 参数(True或False)转换为一个 PyTorch 张量,并将其移动到指定的设备上。

这个 self.amp 张量将用于决定是否启用混合精度训练。

2.2 if self.amp and RANK in (-1, 0)::

这个条件检查是否启用了混合精度训练,并且当前进程的 rank 为 -1 或 0。

rank 为 -1 通常表示单机训练,rank 0 表示分布式训练中的主进程。

2.3 self.amp = torch.tensor(check_amp(self.model), device=self.device):

这行代码使用 check_amp() 函数检查模型是否支持混合精度训练。

检查结果被存储在 self.amp 张量中。

2.4 callbacks.default_callbacks = callbacks_backup:

在调用 check_amp() 之前,代码先备份了默认的回调函数列表。

这是因为 check_amp() 可能会重置回调函数,所以需要在检查完成后将其恢复。

2.5 if RANK > -1 and world_size > 1:

如果当前处于分布式训练模式(RANK > -1 且 world_size > 1),则使用 dist.broadcast() 将 self.amp 张量从 rank 0 广播到所有其他rank。

这确保了所有进程使用相同的 self.amp 值。

2.6 self.amp = bool(self.amp):

将 self.amp 从张量转换为布尔值,方便后续使用。

2.7 self.scaler = amp.GradScaler(enabled=self.amp):

创建一个 GradScaler 对象,用于在启用混合精度训练时缩放梯度。

2.8 self.model = DDP(self.model, device_ids=[RANK]):

如果是分布式训练,则将模型包装成 DistributedDataParallel (DDP)模型,以支持分布式训练。

这段代码的主要目的是检查模型是否支持混合精度训练,并根据检查结果设置相应的配置。这有助于提高训练效率和性能。