想象一下:你闭上眼睛,脑海中构思一个场景,用简短的语言描述出来,然后“啪”的一声,一张栩栩如生的图片就出现在你眼前。这不再是科幻小说里才有的情节,而是Stable Diffusion——一种前沿的AI图片生成算法——所带来的现实。在本系列的万字长文中,我们将深入探索Stable Diffusion的神秘面纱,揭秘它是如何将文字描述转化为令人惊叹的视觉艺术。无论你是AI技术的爱好者、数字艺术的探索者,还是仅仅对这门新兴科学充满好奇,这都将是一次知识与想象的盛宴。那么,系好安全带,让我们一起启程,进入AI创造的奇妙世界。

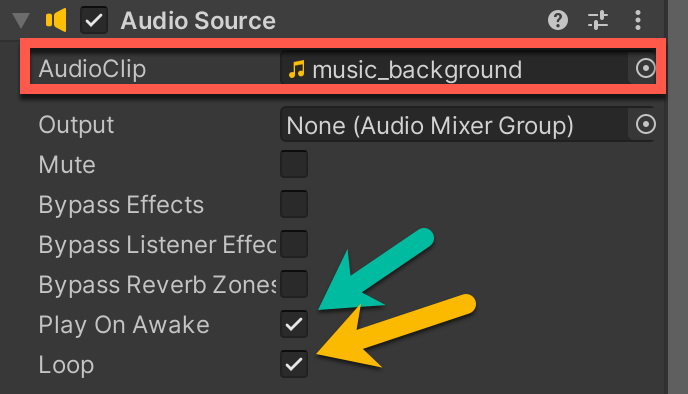

Stable diffusion 效果如何

先来感受一下 stable diffusion 能创造出什么样的神奇效果。

8K 画质的变色龙图片,不敢相信这不是摄像机拍摄的而是 AI 生成的。

自拍写真也充满了细节!远处的模糊处理和近处的细节凸显,像极了真人拍摄的图片。那是不是 AI 只能生成类似真人拍摄的图片呢?

梦幻风格的图片也能拿捏!接下来是硬核技术部分,绑好安全带,发车!

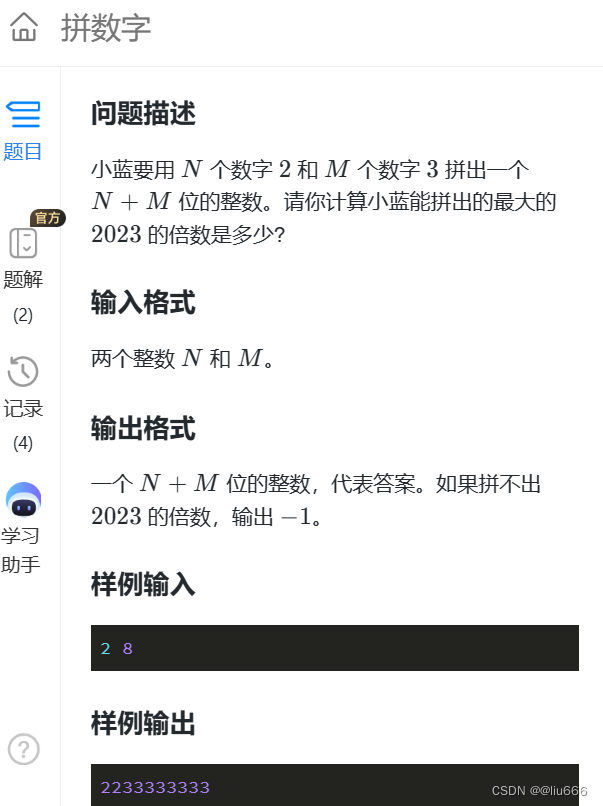

Stable diffusion 整体介绍:

-

Stable Diffusion 是一个2022年发布的文本到图像潜在扩散模型,基于 Latent Diffusion Models(LDMs)实现,由 CompVis、Stability AI 和 LAION的研究人员创建。

-

Stability AI公司在2022年10月完成了1.01亿美元的融资,估值目前已经超过10亿美元。

原理:

-

Diffusion Models的核心原理源于物理中的扩散过程。在物理学中,扩散过程描述的是粒子从高浓度区域向低浓度区域的随机性运动,而 Diffusion Models 将数据生成过程建模为粒子扩散过程,也就是一系列微小的、连续的随机变化过程,具体表现就是从一些随机噪声逐步生成真实数据的过程,就像在随机扩散过程中,分子从高浓度区域向低浓度区域移动那样。

-

Diffusion Models可以生成高质量的图片,主要是得益于以下几点:

-

(1)生成过程是迭代的:在Diffusion Models中,数据的生成过程是一个多次不断迭代和优化的过程,会经历从粗糙到细致 --> 更细致 --> 非常细致 的过程,这就使得模型能够逐步生成出越来越精细的特征,因此可以生成很高质量逼真的图片。

-

(2)全概率模型:Diffusion Models是一种全概率模型,它会考虑数据的所有可能性。由于添加的噪声是随机的,这就使得数据在各个维度上都可能发生变化,换句话说,就是在全局范围内都有可能出现的数据,因此可以说从简单分布进行扩散的过程将会遍历所有可能的数据点。事实上,一直扩散下去(时间趋向无穷),理论上可以覆盖整个数据空间。这使得模型能够生成出各种各样的图片,包括那些在训练数据中很少出现但是仍然符合现实世界特征的图片。

-

(3)字符级细节:由于Diffusion Models的生成过程可以通过控制迭代的步数,生成过程可以捕获到非常小的细节,比如图像的纹理,形状和颜色等,因此可以生成出高质量的图片。

-

(4)最大似然训练:Diffusion Models通常采用最大似然训练,这确保了模型能够精确地拟合训练数据的分布,从而生成出高质量的图片。

主要流程:

-

文本编码器(Text Encoder): 将人类输入的文字串转换成机器可理解的数字信息,输出语义向量。

-

图片生成器(Image Generator): 核心模块,接受 latent + text + time 作为输入,生成图片。

-

图片解码器(Image Generator): 将生成的 latent image 解码为 RGB 图片;

应用:

-

可用于文生成图、图生成图、特定角色刻画、超分或上色任务。

-

可用于AI绘画,图像生成等领域,提高生成可控性,改变部分行业的生产模式。

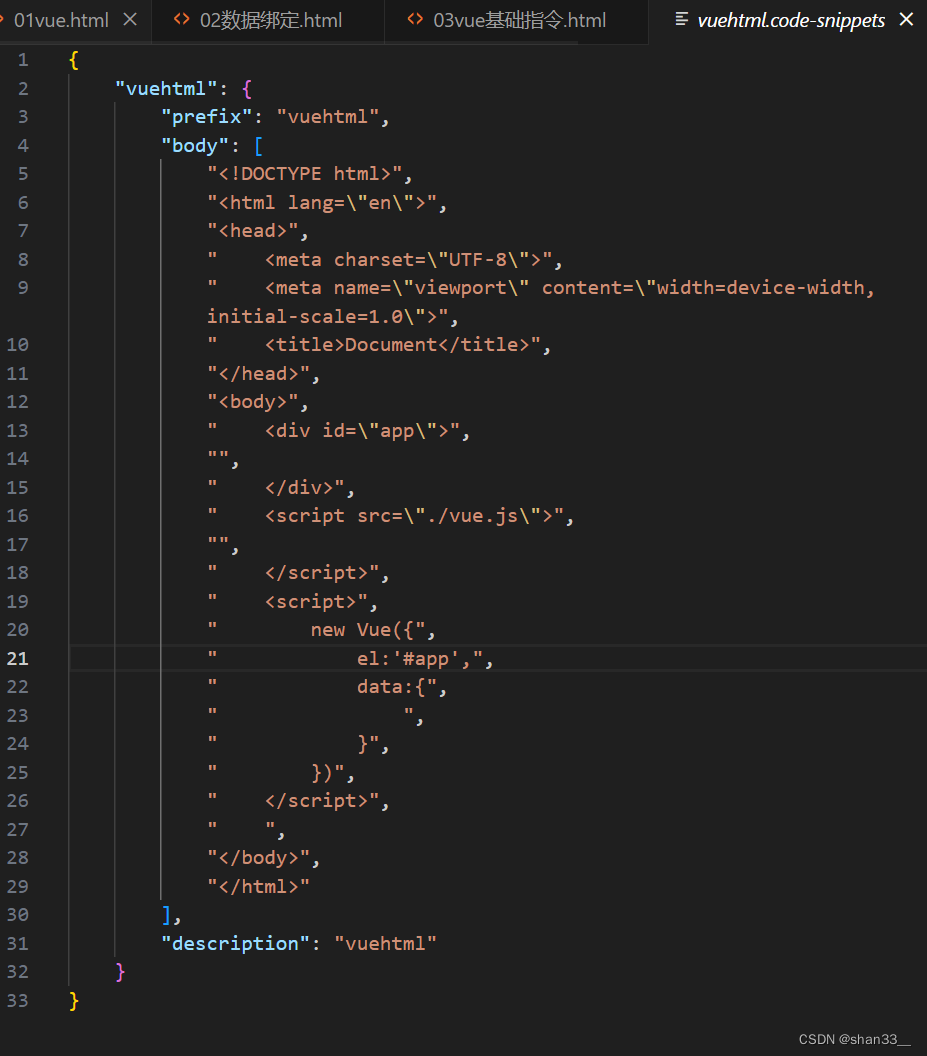

模型发展路径:

Diffusion model --> Latent diffusion model --> Stable diffusion model, 我们按照这个顺序来学习掌握 Stable Diffusion.

接下来我们会逐步学习 Stable diffusion, 欢迎点赞关注获取最新的技术教程!

![C++ 日志库 log4cpp 编译、压测及其范例代码 [全流程手工实践]](https://img-blog.csdnimg.cn/direct/1e0f7d5b801d4deea521fe4d14759cc5.png)

![[董晓算法]搜索相关题目及模板](https://img-blog.csdnimg.cn/direct/35f8136c36ef4a54bcbc935b00cfba4b.png)