1、Tactile-Augmented Radiance Fields

中文标题:触觉增强的辐射场

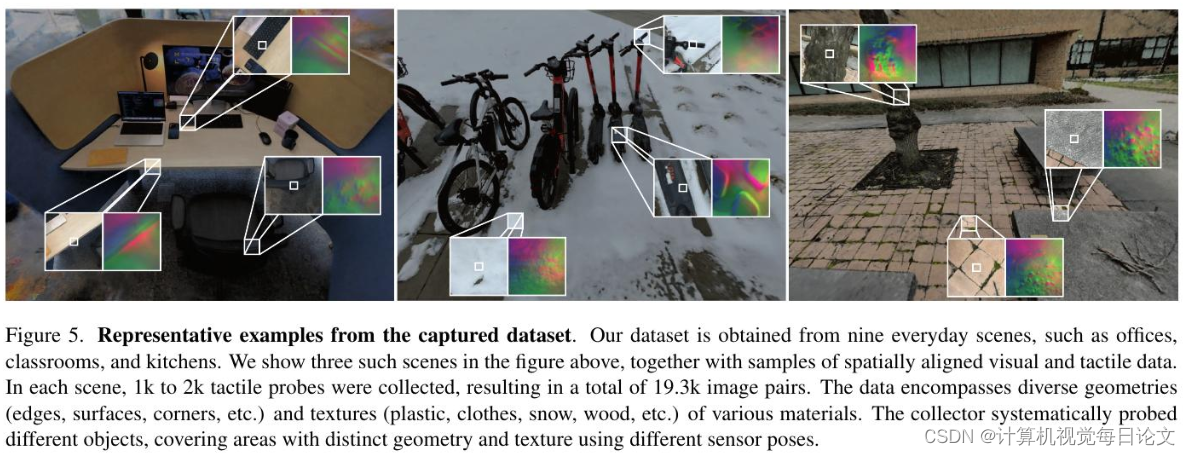

简介:我们提出了一种新的场景表示方法,称为"触觉增强的辐射场(Tactile-Augmented Radiance Fields, TaRF)"。这种方法将视觉和触觉信息融合到一个共享的三维空间中。通过拍摄一组照片和采集少量触觉探探探针,我们可以获得一个场景的TaRF表示。我们利用了两个重要的洞察:1)基于视觉的触觉传感器可以通过多视角几何方法与图像对齐;2)场景中视觉和结构相似的区域通常也具有相似的触觉特征。基于这些洞察,我们将触觉信号注册到捕获的视觉场景中,并训练一个条件扩散模型,用于从神经辐射场渲染的RGB-D图像生成相应的触觉信号。

为了评估这种方法,我们收集了一个新的TaRF数据集,其包含更丰富的触觉采样和与之配对的视觉信息。我们展示了这种跨模态生成模型的有效性,以及这种视觉-触觉数据在一些下游任务中的应用价值。

2、Edit-Your-Motion: Space-Time Diffusion Decoupling Learning for Video Motion Editing

中文标题:Edit-Your-Motion: 时空扩散解耦学习用于视频动作编辑

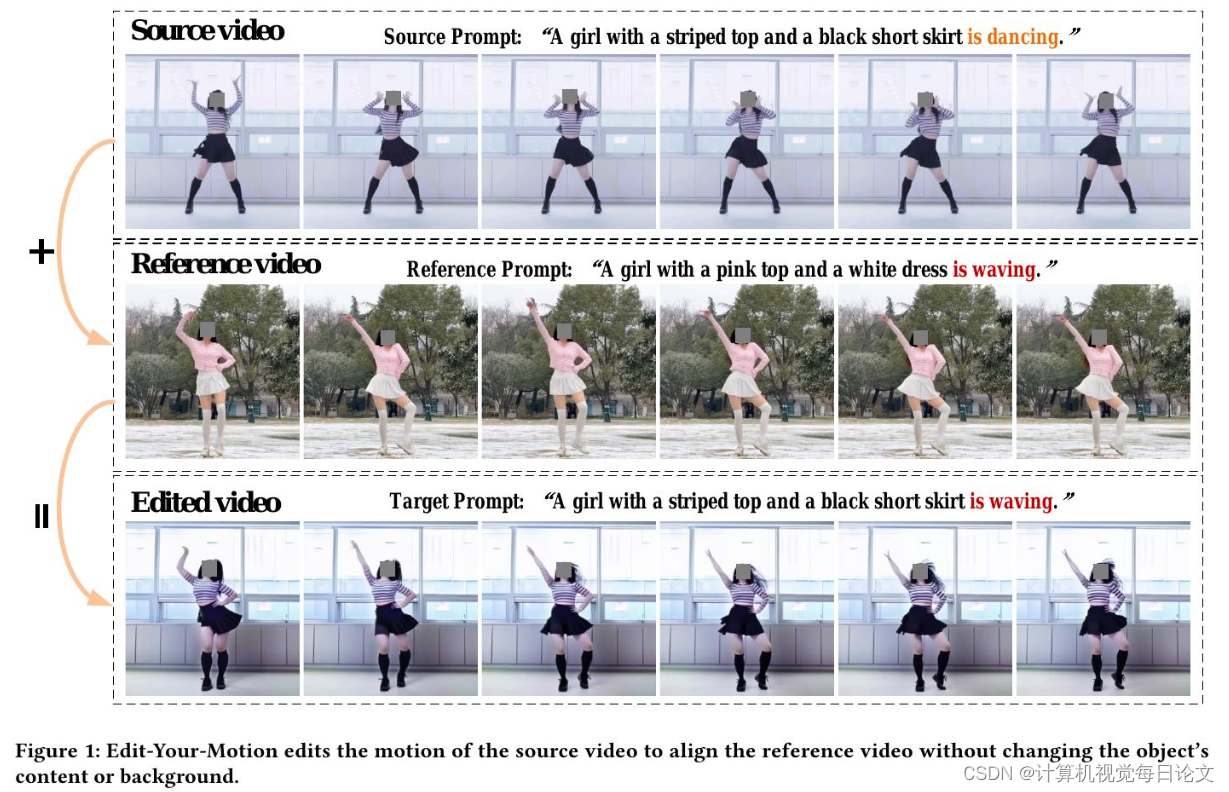

简介:现有的基于扩散的视频编辑方法在运动编辑领域取得了显著进展。大多数方法专注于将视频和参考视频的运动对齐,但并没有限制视频背景和对象内容的保持不变,因此可以生成出人意料的视频内容。

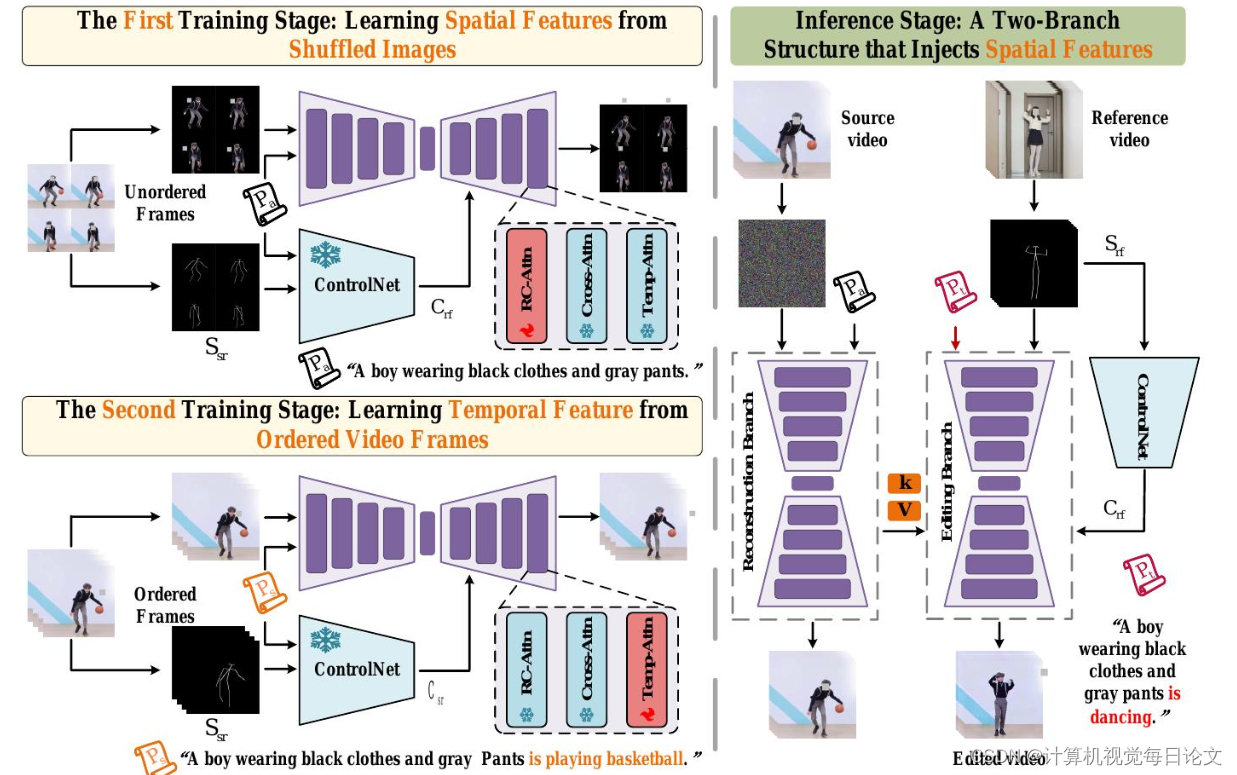

本文提出了一种名为"Edit-Your-Motion"的单步视频运动编辑方法,只需对一对文本-视频进行训练。我们设计了一种详细提示引导学习策略(DPL),可以将时空扩散模型中的时间和空间特征进行解耦。DPL分两个训练阶段进行:第一阶段专注于学习空间特征(对象内容),通过打乱视频帧顺序来分解时间关系;第二阶段则恢复时间关系,学习时间特征(背景和对象运动)。

在推断阶段,我们采用双分支结构,将源对象内容特征注入编辑分支,实现对视频运动的编辑。"Edit-Your-Motion"可以让用户编辑源视频中对象的运动,生成更加丰富多样的视频内容。实验结果表明,该方法优于现有方法。

3、A Significantly Better Class of Activation Functions Than ReLU Like Activation Functions

中文标题:比 ReLU 等激活函数更好的激活函数类

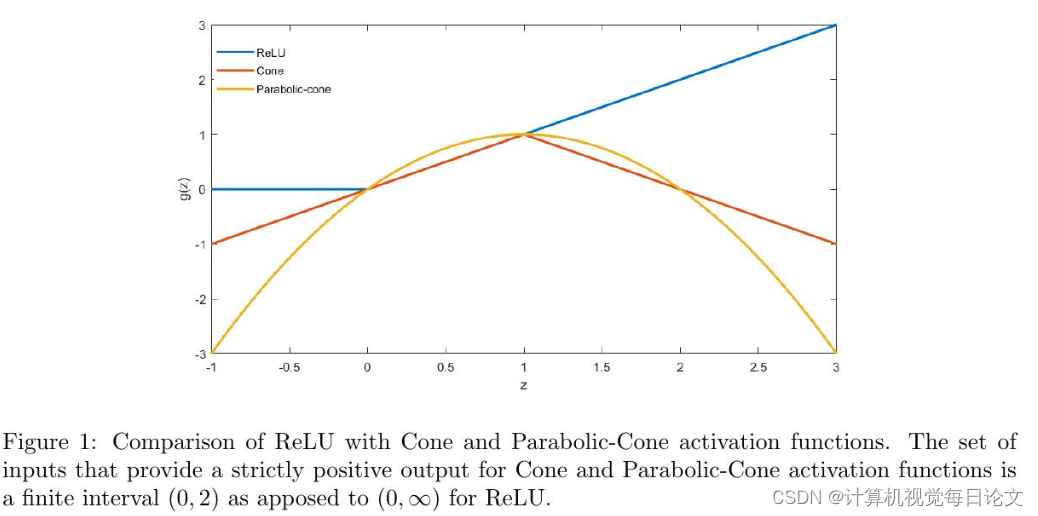

简介:本文提出了两种新型的激活函数,分别称为"锥形激活函数"和"抛物线锥形激活函数",它们在某些方面表现优于传统的ReLU和Sigmoidal激活函数:

锥形激活函数在有限区间内为正值,在区间端点处变为零,这使得它能够比无限宽的半空间更精细地将输入特征空间划分为正类和负类。甚至单个使用锥形激活函数的神经元就可以学习XOR函数。

这两种新激活函数在CIFAR-10和Imagenette基准测试中的准确率都明显优于常用激活函数,同时使用的神经元数量也更少。

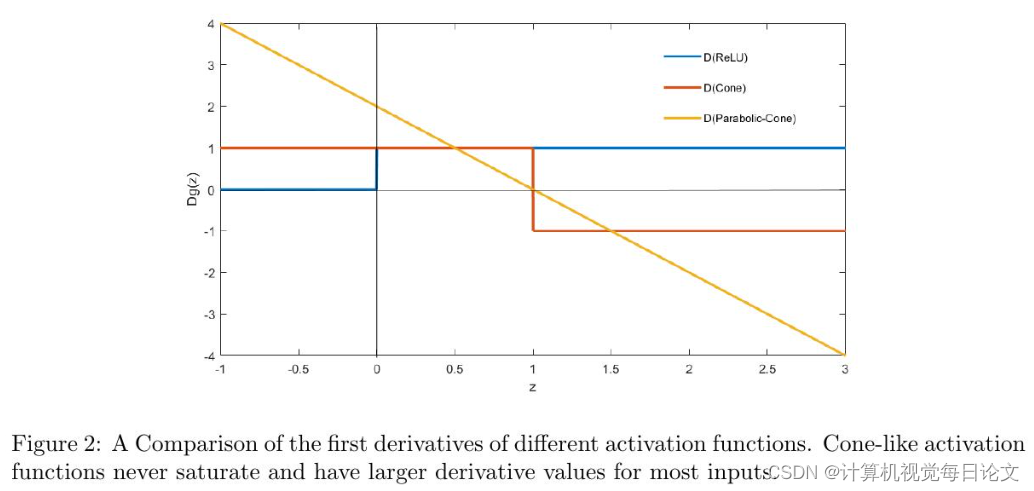

这些新激活函数具有比ReLU更大的导数,证明了它们可以加速神经网络的训练收敛。

总之,本文提出的这两种新型激活函数在分类任务中展示了优异的表现,可以作为针对特定问题的替代选择。