换了新电脑,重新装一下anaconda这些编程环境。好久没装过了,自己也需要查查资料,然后记录一下,分享给别人。

目标,三个环境:1.anaconda基础环境(包含xgboost和lightgbm),2.TensorFlow环境,3.Pytorch环境(能用GPU加速的那种。)

Anaconda安装

这个装了太多次了,很简单,选一个自己喜欢的版本下载就行。一般没什么特殊要求就直接开官网下载就行:Distribution | Anaconda

之前是打开直接点下载,现在还需要你填邮件,当然也可以点击跳过。然后找自己对应的电脑系统安装就行。

我看了一下,这个Windows版本是py3.11,我觉得太高了,就去以往的列表找一下之前的版本的安装包。Index of / (anaconda.com)

我看这个2023年的7月感觉不错,我就下载这个版本安装了。

下载好的exe文件直接双击运行:

点击下一步,我同意,然后这里可以选自己用,也可以选所有人用:

选择安装路径

这个选前2个就行:

第三个是清除安装包,我觉得没必要。

然后等待安装完成:

一直点击继续,到最后这两个去掉勾选就行了。

点击完成!基础的环境就安装好了。

环境变量

查看一下anaconda路径有没有在环境变量里面,其实不在环境变量里面也不影响运行,但是在的话更好,这与会避免后面可能的报错。

在查找里面搜索如下的 编辑系统环境变量,

点击环境变量

在用户变量里面找到Path这一列,双击

我里面没得环境变量,按道理来说安装的时候会让你勾选的。我这个安装包没看见,所以我自己手动把anaconda,还有里面的带bin 和scripts的这些路径都添加到环境变量了。同学可以模仿这个路径复制进去就行。

设置好之后点确定确定。

然后win+r,输入cmd,打开

输入下面红色框框的东西,出现了信息就说明安装好了,环境变量也成功了。

安装xgboost和lightgbm

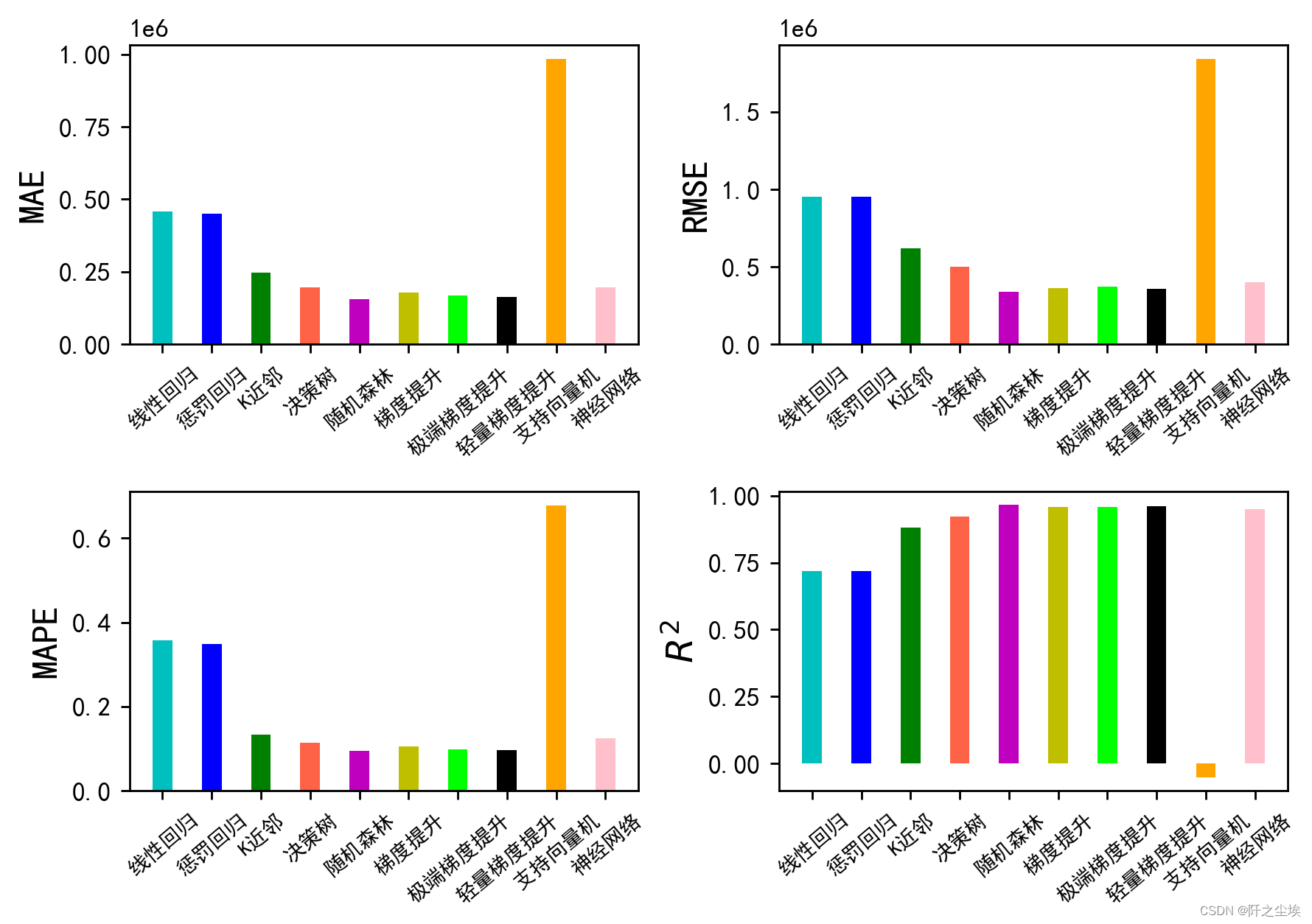

这两个包时做表格数据的机器学习效果最好的模型。若是不需要的同学,只做深度学习的话就可以跳过。

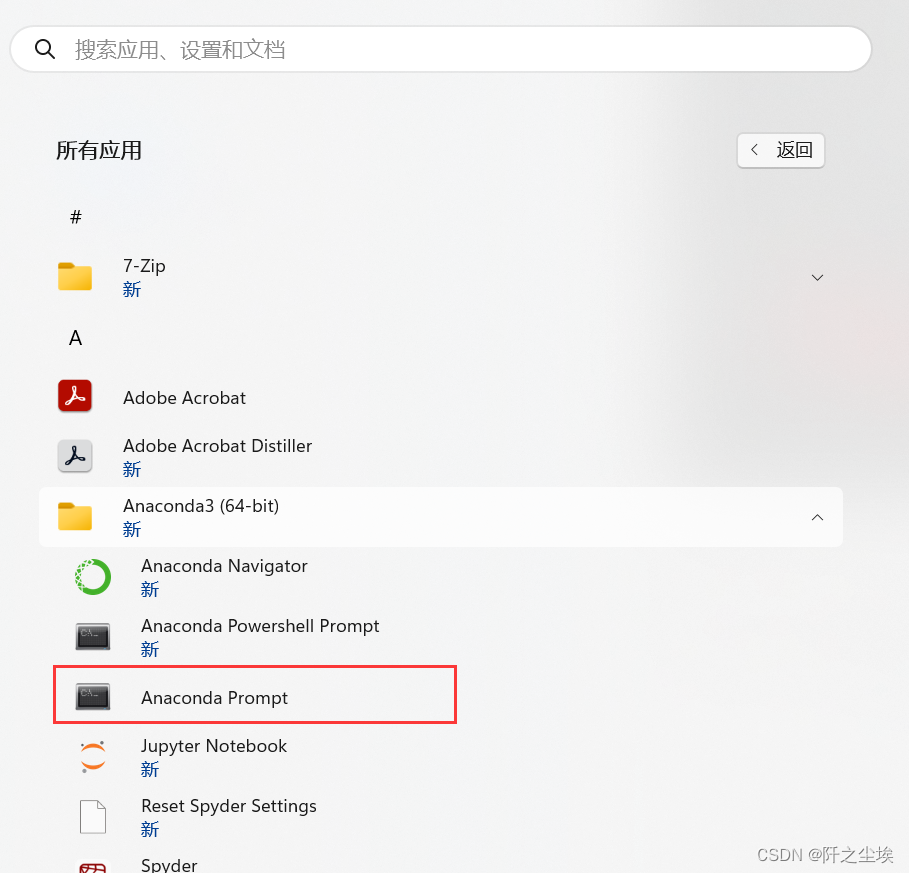

在菜单键的所有应用中,打开anaconda的命令提示符,

输入:

pip install xgboost

等待安装好就行。

若出现一屏幕的红色字体报错的话:

不要慌,你看见time out就表示是超时了,我们只需要再输入一遍回车等待就行。还超时的话就不停地输入这个安装命令和回车。。装好为止。

lightgbm也是一样的

pip install lightgbm

等待安装好就行。

测试

装好了,当然要看看能不能正常运行了。我们首先打开jupyter notebook(现在实习的公司用的是jupyter lab,都可以,我比较喜欢notebook)

还是打开conda的命令提示符:

切换到D盘(因为我代码放在D盘的),然后输入jupyter notebook

等待一下,就能看到下面的网址了

按道理来说,一个会自动跳转到默认的浏览器打开他们的,但是我新电脑没有跳转。。算了,无伤大雅,我手动复制到浏览器打开,然后沿着代码文件的路径进去打开要运行的代码文件:

直接重启运行全部代码

OK完美运行,速度很快(毕竟是新电脑)

测试完成!基础环境就已经装好了,下面来装TensorFlow。

TensorFlow安装

选择版本

深度学习首先得问题就是用CPU跑,还是GPU跑。。我当然想用GPU跑,不然买新电脑是做啥、、GPU跑得多块,一下就训练完了。然后库的版本,我其实也想装个比较新的版本,但是TensorFlow的环境这几年真的不太行了,毕竟谷歌自己都不怎么用了,现在都去弄pytorch了。

然后我自己去官网看了看:

Build from source on Windows | TensorFlow (google.cn)

发现他们从2.10版本之后的版本,win系统都不支持cuda了,见鬼,看来我想装2.11版本以上的TensorFlow 这英伟达显卡起不来作用了,那就老老实实装CPU版本吧。

看看CPU版本的对照型号:

我还是感觉太新的版本不好,咋们就来个python3.11,TensorFlow2.15的吧。

虚拟环境安装

为什么要创建虚拟环境呢?就是防止版本冲突,深度学习依赖的库太多,要是你在基础环境里面哪天不小心升级了一个包,然后整个深度学习框架不能用了就会很尴尬。。

所以我们先要创建一个虚拟环境,然后在里面安装TensorFlow。

还是打开命令提示符,输入下面的代码

conda create --name tensorflow_env python=3.11 anaconda这一行的功能是创建一个名称为:“tensorflow_env”的虚拟环境,安装py3.11的内核,我后面带了一个anaconda是因为我喜欢在这个TensorFlow环境里面把所有的anaconda组件都带上,免得如果只装py的话,后面还需要安装一堆常用的包(pandas,numpy,seaborn)等。。。

然后会跳出来一堆包的名称,输入y,同意安装

安装好了上面会提示你怎么激活环境,怎么退出环境:

输入“conda activate tensorflow_env”激活虚拟环境后,还可以在里面“conda --version”,查看版本信息,‘conda info’,还可以看看里面有哪些库:“pip list”

然后就是安装TensorFlow了。很简单其实,就是pip就行了。我还作死看了一下他默认给我装的3.11是3.11几,一看好家伙,是3.11.9,这无线接近3.12的版本的py能上TensorFlow2.15吗,我只能先试试了。

输入:

pip install tensorflow==2.15.0

然后等待安装

仔细一看他装的包,keras就在里面,不用额外装了。

感觉可以用了,我去跑个代码试试:

可以没问题是能运行的,但是好像keras库里面发出来警告,keras里面的TensorFlow的api没有更新,虽然能用。。但是好像也不长久了。。没事,反正后面keras也可以用pytorch的框架了,想这样过渡凑合着用吧。

(ps,不想这样被警告的同学,可以换TensorFlow2.14版本试一下,说不定就还好。)

TensorFlow安装完成!虽然用不了GPU加速,但是也还不错了,也是没办法的事情官网都不支持cuda了。

下面去安装pytorch 的环境。pytorch就可以用gpu了。

Pytorch安装

版本选择

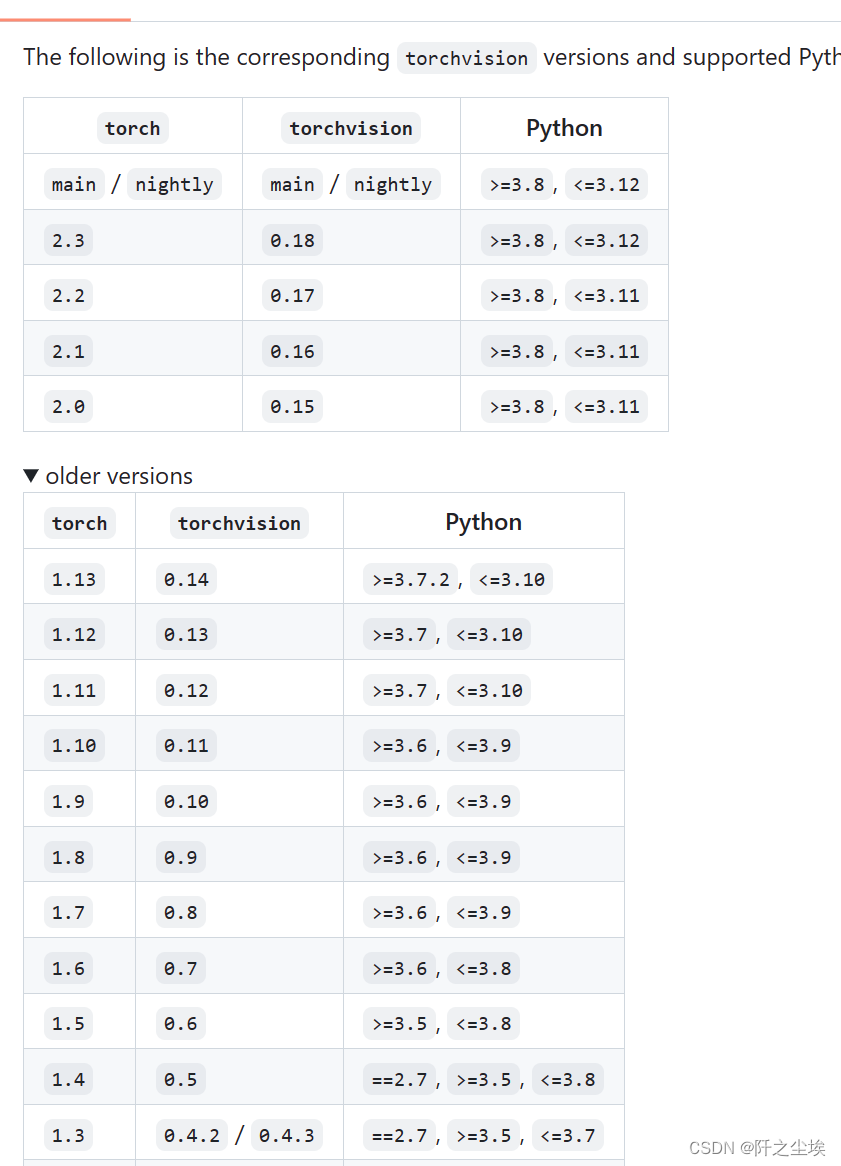

pytorch的安装就有点讲究了,除了前面说的虚拟环境外,torch包的版本,py 的版本,还有cuda 的版本要都对应上。

(不过现在的pytorch安装是不需要装什么cuda驱动的,只要版本是对的,就一行命令就安装好了)

首先在英伟达的控制面板里面去找自己显卡的的CUDA Toolkit的版本

没这个就在搜索里面搜

可以看到我的CUDA Toolkit是12.2.146的版本,也就是说CUDA 12.2以下的版本应该都是支持的。

怎么查看cuda和pytorch版本的关系呢?,可以查看官网的安装命令:

Previous PyTorch Versions | PyTorch

上面会有每个torch版本的对应的cuda的版本命令:

例如这里的2.2.2就支持cuda11.8和12.2的版本。

那我们12.2的cuda就都可以选了,无所谓,那就来最新版本的pytorch2.3吧!

我就准备用这个命令安装了。

cuda和pytorch版本对应了后,去找python 的版本。

然后去官网查看py和pytorch的版本对应关系:

GitHub - pytorch/vision: Datasets, Transforms and Models specific to Computer Vision

其实基本上3.8-3.11这个版本的python都是支持2.0以上版本的 torch 的。

那我们还是弄一个3.11版本的py吧。

开始安装!

虚拟环境安装

所以我们先要创建一个虚拟环境,然后在里面安装pytorch。

还是打开命令提示符,输入下面的代码

conda create --name pytorch_env python=3.11这一行的功能是创建一个名称为:“pytorch_env”的虚拟环境,安装py3.11的内核,这次后面没有带anaconda,所以这个环境后面还需要安装一堆常用的数据科学的包(pandas,numpy,seaborn)等。。。

然后还是会跳出来一堆包的名称,但是明显少一些,都是很基础的包。输入y,同意安装

安装好了上面会提示你怎么激活环境,怎么退出环境:

同样我们激活这个虚拟环境

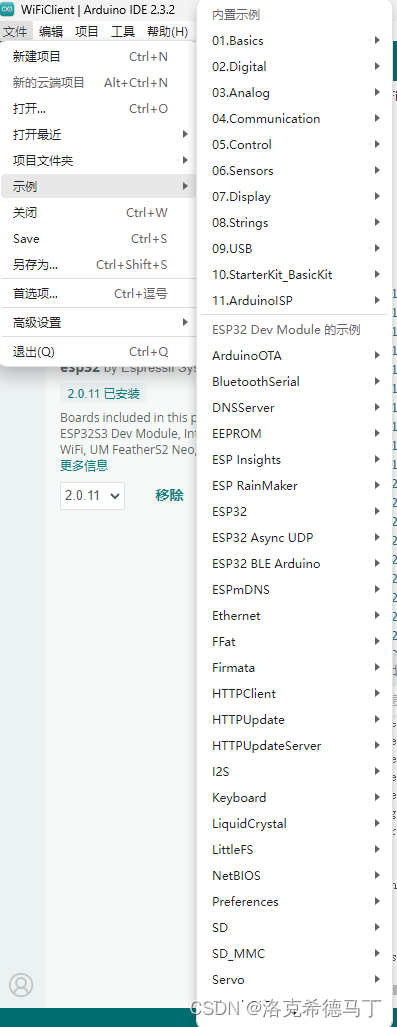

conda activate pytorch_env然后我从官网上掏出了最新的安装命令:Start Locally | PyTorch

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121我是cuda是最新的12.2才敢这样做的,其他同学的版本不一样的可不要学我,要去查找对应cuda 的torch版本的安装命令。

等待安装,包还挺大。

(等待安装的时候我就在想,这个torch环境在anaconda里面,所以我外面要装stable diffusion的时候还要装一下torch环境,不过这样也好,隔开的,一个科研跑数据,一个画画,挺好的。)

安装过程可能会提示你什么什么包没有,装一下就好了。然后还可以反复运行上面pytorch 的安装代码,没事,就反复运行尝试就行。

还可以参考李沐老师的这本书的教程,b站也有网课。

安装 — 动手学深度学习 2.0.0 documentation (d2l.ai)

pytorch 的生态和环境还是很丰富,啥问题都可以上网找得到的。

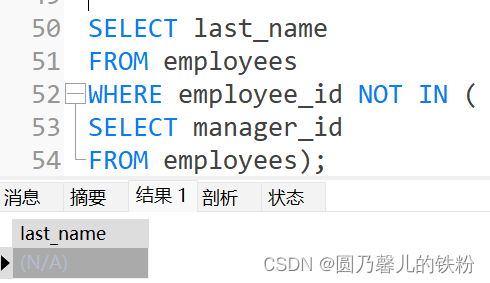

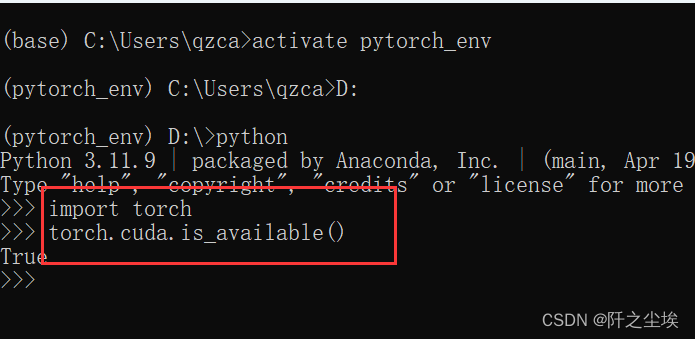

安装完了, 我在这个虚拟环境下输入python,进入py 的环境,然后输入下面的py代码测试是不是能用到cuda显卡:

import torch

torch.cuda.is_available()

好耶,是可以的。看来现在的pytorch安装是不需要装什么cuda驱动的。

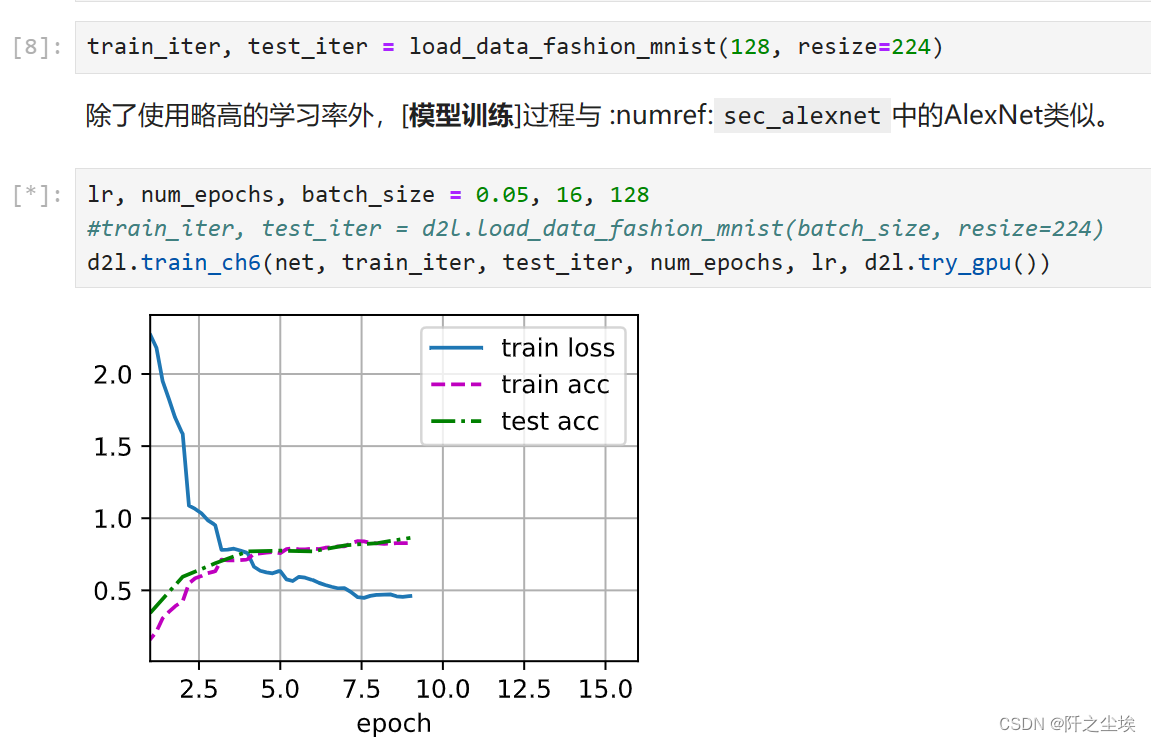

安装完了,我去跑个代码试试,找了个vgg,还有点大的神经网络。

完全能运行,一点问题都没有。我显卡被狂用。。温度上升。。

大功告成!机器学习和深度学习的环境都装备好了! 后面就轻松愉快的写代码了

(创作不易,各位看官觉得还不错能帮到你们就点个赞和收藏吧)