提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

文章目录

- 前言

- 一、文章涉及概念讲解

- 二、操作步骤

- 1.创建 snapshot repository

- 操作主机hadoop1

- 分别操作从机hadoop2和hadoop3

- 2. 查看仓库信息

- 3. 备份索引,生成快照

- 4. 数据迁移

- 总结

前言

言简意赅,本篇文章解决的问题是:当一个es集群中有数据,需要将数据迁移到另外一个es集群,或者是需要将es中的数据备份。(理论上单机es也可以实现功能,且可能不会有文章涉及的报错信息)

一、文章涉及概念讲解

1. snapshot:使用 Elasticsearch 提供的 snapshot 功能,将数据快照保存到本地或者远程存储库中。

2. snapshot repository:,指定要备份的数据在哪里存储。

3. restore:使用 Elasticsearch 提供的 restore 功能,将备份的数据恢复到新的Elasticsearch集群中。

二、操作步骤

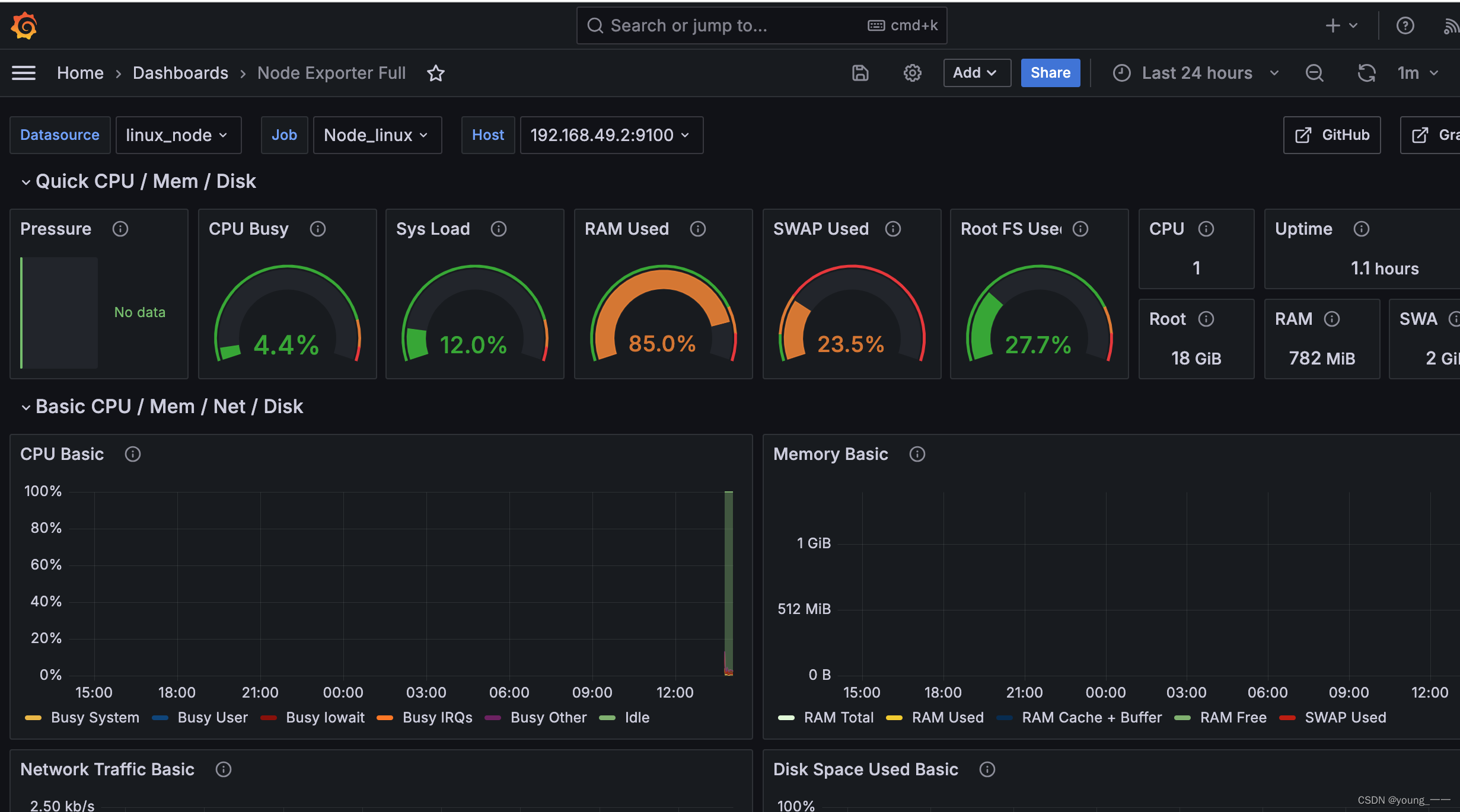

前置条件: es集群能够正常启动;kibana也能够正常运行,能够在5601端口访问kibana提供的客户端。

1.创建 snapshot repository

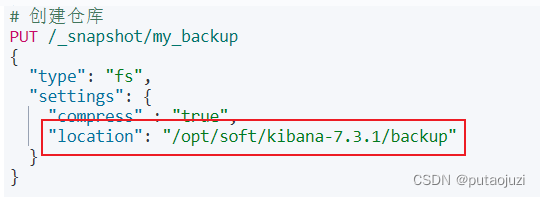

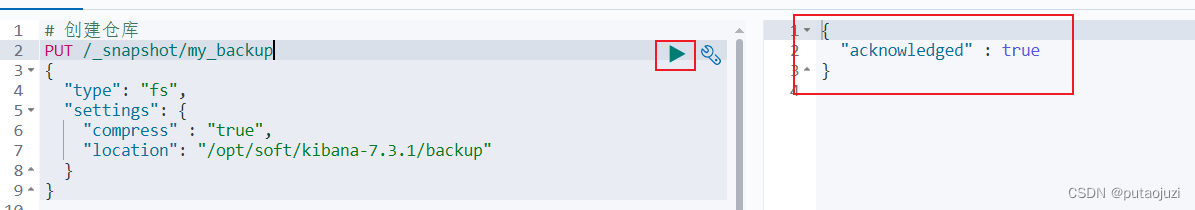

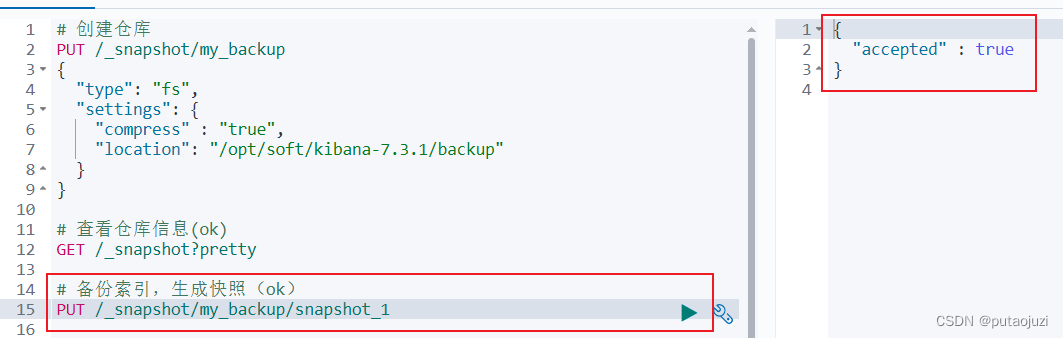

# 创建仓库

PUT /_snapshot/my_backup

{

"type": "fs",

"settings": {

"compress" : "true",

"location": "/opt/soft/kibana-7.3.1/backup"

}

}

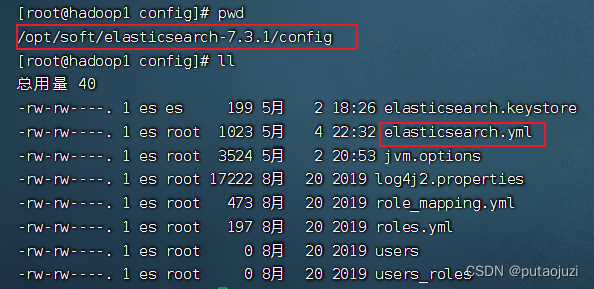

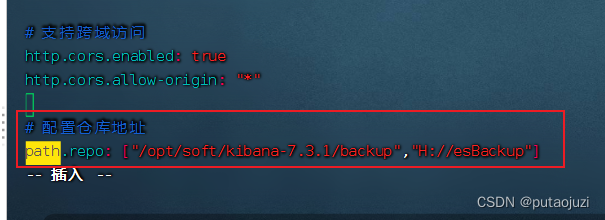

需要注意的是,这里的location需要配置在es的配置文件中,也就是elasticsearch.yml中。(对于es集群的架构,则每个es服务上,都要添加此配置)

配置仓库地址:数组的形式,可以配置多个地址。

配置成功后,需要重新启动es集群。

此时,重新执行创建仓库的代码,可能仍然会报错:(单机es可能不会报错)

repository_verification_exception:is not shared between this node and the master node or that permissions on the store don’t allow reading files written by the master node

{“error”:{“root_cause”:[{“type”:“repository_verification_exception”,“reason”:"[my_backup] [[mu3vPb-eTBeom4ElNsSeoQ, ‘RemoteTransportException[[node-1][10.10.77.100:9300][internal:admin/repository/verify]]; nested: RepositoryVerificationException[[my_backup] a file written by master to the store [/home/es/elasticsearch-5.1.1/data/bak] cannot be accessed on the node [{node-1}{mu3vPb-eTBeom4ElNsSeoQ}{gCm1zrtWT12WzrjFiVDGrQ}{10.10.77.100}{10.10.77.100:9300}]. This might indicate that the store [/home/es/elasticsearch-5.1.1/data/bak] is not shared between this node and the master node or that permissions on the store don’t allow reading files written by the master node];’],...

先介绍一下我目前的架构,es集群是一主二从,分别是hadoop1、hadoop2、hadoop3,其中hadoop1是主机,因此,kibana只部署在hadoop1的主机上。首先发请求创建仓库的文件夹是必须存在的,且三台主机上都需要存在这个目录。

也就是:

然后就重点来分析一下这个问题,由于es和kibana是不支持root用户启动服务的,因此往往我们会创建一个新用户,并赋予这个用户es和kibana目录下的操作权限,由这个用户来管理es和kibana服务(这里创建了名为“es”的普通用户)。由于创建仓库涉及三台机器上的backup目录文件修改,因此,我认为问题可能在于es无法免密登录其它两台从机,并没有权限修改其它两台机器上的backup目录。(当然root用户是可以实现免密登录的)

因此,解决方法可以从多个方面考虑,例如:1. 配置使用root用户启动es和kibana的服务… 2. 配置es用户免密登录,并赋予修改文件权限

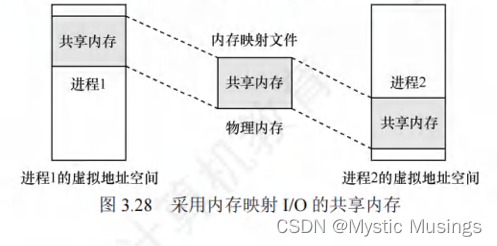

以上的方法是否可行,暂无去亲自实践。本次解决问题的方法是:使用nfs服务器,实现三台机器的backup文件内容共享。

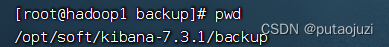

操作主机hadoop1

a. 安装 NFS 服务器所需的软件包

yum install -y nfs-utils

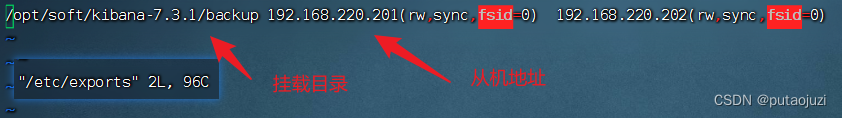

b. 编辑exports文件,添加从机挂载目录以及地址信息

vim /etc/exports

rw表示可读写;sync表示同步写

c. 启动nfs服务

#rpcbind做开机启动

systemctl enable rpcbind.service

#启动rpcbind服务

systemctl start rpcbind.service

systemctl enable nfs-server.service

systemctl start nfs-server.service

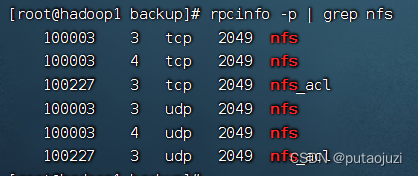

d. 确认NFS服务器启动成功

rpcinfo -p | grep nfs

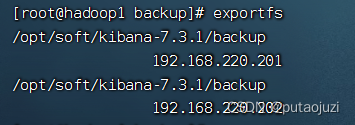

e. 检查 NFS 服务器是否挂载我们想共享的目录

exportfs

分别操作从机hadoop2和hadoop3

a. 首先是安裝nfs,同上

yum install -y nfs-utils

b. 启动rpcbind服务 (客户端不需要启动nfs服务)

#rpcbind做开机启动

systemctl enable rpcbind.service

#启动rpcbind服务

systemctl start rpcbind.service

c. 从机上使用 mount 挂载服务器端的目录(首先得在从机上创建目录,如果不存在的话)

# 在hadoop2和hadoop3上分别执行(其中192.168.220.200为hadoop1的ip)

mount -t nfs 192.168.220.200:/opt/soft/kibana-7.3.1/backup /opt/soft/kibana-7.3.1/backup

d. 查看挂载情况

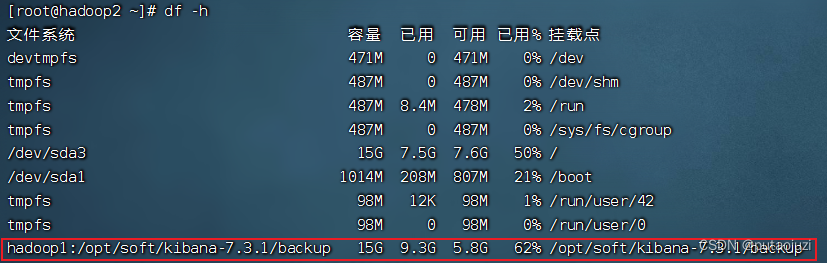

df -h

现在应该就可以重新执行创建仓库的代码了:

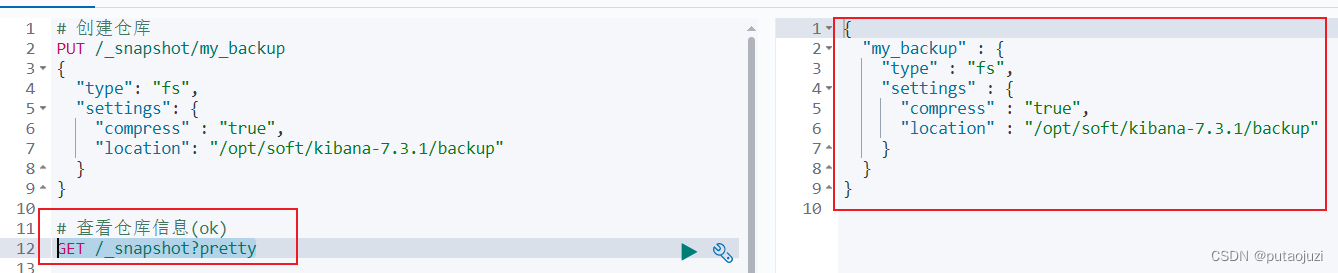

2. 查看仓库信息

GET /_snapshot?pretty

3. 备份索引,生成快照

# my_backup:仓库名称;snapshot_1:快照名称

PUT /_snapshot/my_backup/snapshot_1

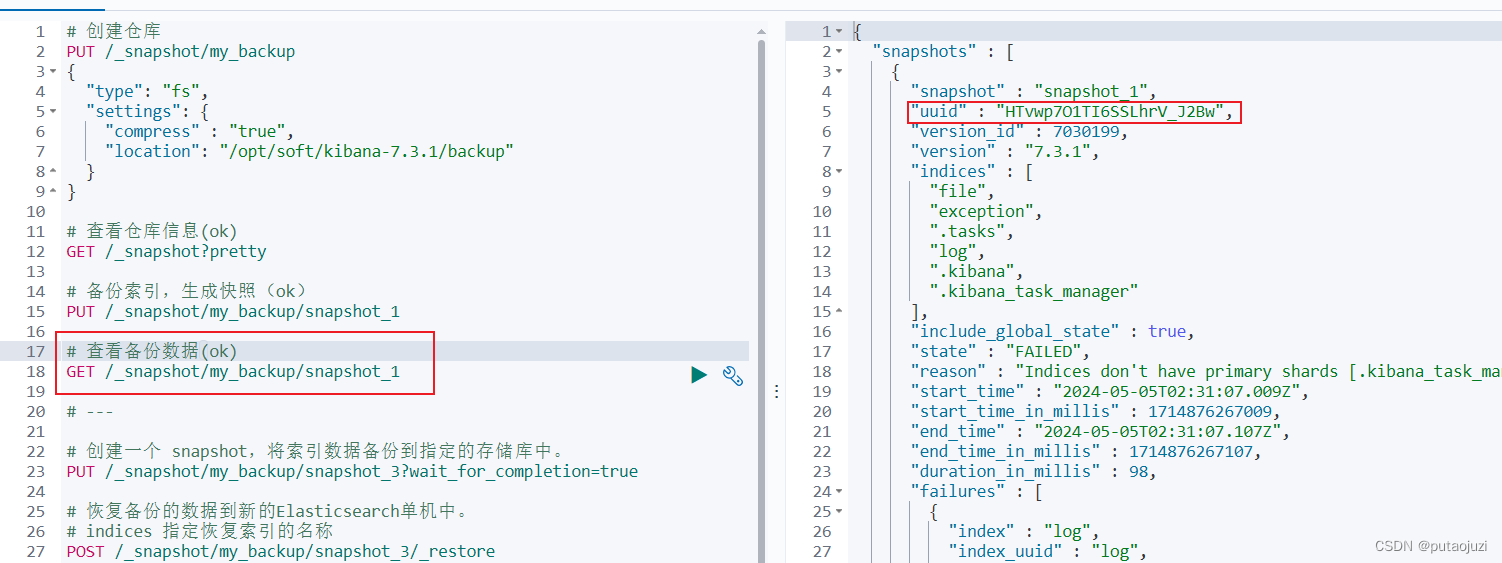

查看备份数据

GET /_snapshot/my_backup/snapshot_1

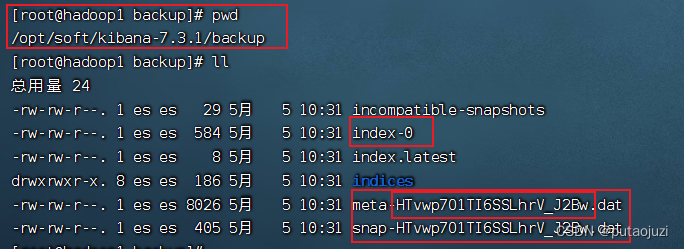

生成快照后,备份文件夹里就可以查看到对应的信息了:

其中,index-0 存放了快照的基本信息,meta-xxx.dat 以及snap-xxx.dat 应该就是实际存放的数据。

4. 数据迁移

迁入地集群也需要配置elasticsearch.yml文件,增加path.repo的配置。目标ES集群中也需要创建repository。

将备份文件复制到新的Elasticsearch集群中的同一个位置。

在新的es集群创建一个相同的 snapshot repository,用于存储恢复的数据。

数据恢复

# 数据拷贝后,目标主机执行

# 恢复备份的数据到新的Elasticsearch集群中。

# indices 指定恢复索引的名称

POST /_snapshot/my_backup/snapshot_1/_restore

{

"indices": [

"log",

"file",

"exception",

".tasks",

".kibana_task_manager"],

"ignore_unavailable": true,

"include_global_state": false,

"rename_pattern": "index_(.+)",

"rename_replacement": "restored_index_$1"

}

以上就是将一个es集群的数据迁移到另一个es集群的步骤。注意,在进行数据迁移前,需要确保es的版本一致,否则可能会导致索引不兼容或者其他问题。

相关DSL

# 创建仓库

PUT /_snapshot/my_backup

{

"type": "fs",

"settings": {

"compress" : "true",

"location": "/opt/soft/kibana-7.3.1/backup"

}

}

# 查看仓库信息(ok)

GET /_snapshot?pretty

# 备份索引,生成快照(ok)

PUT /_snapshot/my_backup/snapshot_2

# 查看备份快照数据(ok)

GET /_snapshot/my_backup/snapshot_1

# ---

# 创建一个 snapshot,将索引数据备份到指定的存储库中。

PUT /_snapshot/my_backup/snapshot_3?wait_for_completion=true

# 恢复所有索引

POST /_snapshot/my_backup/snapshot_1/_restore?wait_for_completion=true

# 恢复备份的数据到新的Elasticsearch集群中。

# indices 指定恢复索引的名称

POST /_snapshot/my_backup/snapshot_/_restore

{

"indices": [

"log",

"file",

"exception",

".tasks",

".kibana_task_manager"],

"ignore_unavailable": true,

"include_global_state": false,

"rename_pattern": "index_(.+)",

"rename_replacement": "restored_index_$1"

}

# ---

# 查看所有索引

GET _cat/indices?v&pretty

# 删除所有索引

DELETE /_all

DELETE /.kibana

DELETE /file

总结

本篇文章仅供学习和参考,如有涉及侵权,请及时联系笔者!

参考文章:

- elasticsearch的数据迁移

- es单机数据迁移到另一个es单机