U-Net: 用于图像分割的深度学习网络

引言

在计算机视觉领域,图像分割是一项重要的任务,旨在将图像中的每个像素分配到预定义的类别或区域。传统的图像分割方法通常基于手工设计的特征和启发式算法,但随着深度学习的发展,基于深度神经网络的图像分割方法取得了显著的进展。

U-Net 是一种经典的深度学习网络架构,专门用于解决医学图像分割问题,尤其是对于较小的训练数据集。U-Net 的特点是具有对称的 U 形结构,并且通过跳跃连接(skip connections)在不同层级之间传递信息,从而帮助网络更好地捕获图像中的细微特征。

在本文中,我们将介绍 U-Net 的数学原理、代码实现和实验结果,并讨论其在图像分割任务中的应用和性能。

基本原理

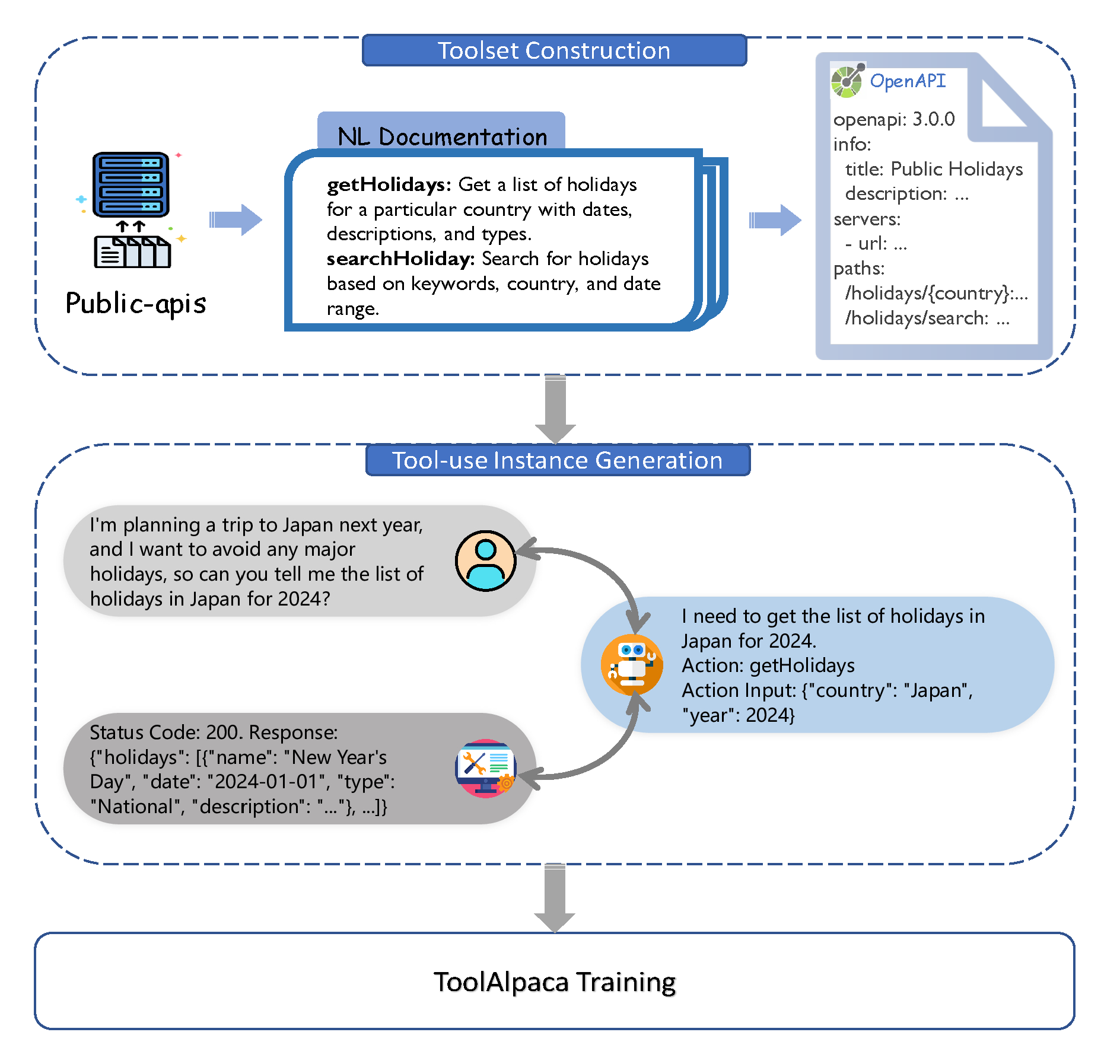

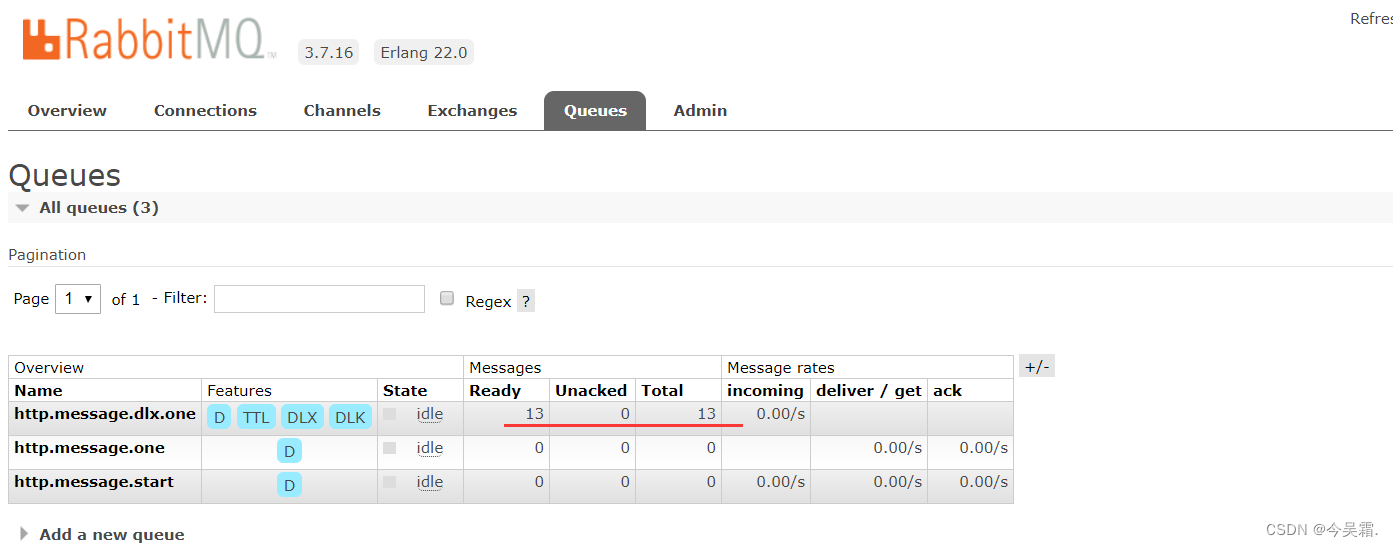

U-Net 的核心思想是将图像分割任务视为图像到图像的映射问题,其中输入是原始图像,输出是相应的分割掩码(即每个像素的类别标签)。U-Net 采用了编码器-解码器(encoder-decoder)结构,并在中间添加了跳跃连接,以便更好地保留图像的空间信息(U-Net 网络架构图如下图所示)。

跳跃连接(Skip Connections)

跳跃连接是指在 U-Net 结构中,将编码器中的特征图直接连接到解码器相应阶段的特征图上。这种机制允许低级特征直接传递到解码器,与高级特征进行合并,从而帮助网络更好地还原图像的细节和结构。

跳跃连接的作用包括:

- 提供了更多的信息路径,使得网络能够更好地利用不同层级的特征信息。

- 缓解了信息丢失的问题,特别是在解码器阶段需要重建细节时。

对称的 U 形结构

U-Net 的整体结构呈现出对称的 U 形,即编码器和解码器之间形成了对称关系。这种结构的设计有助于建立直接的编码器-解码器关联,并提高了网络的信息传递效率。

对称的 U 形结构的特点包括:

- 编码器逐渐减少图像的空间尺寸和通道数,同时提取高级特征。

- 解码器逐步将特征图还原到原始输入图像的尺寸,并逐渐生成分割掩码。

- 对称结构有助于保持编码器和解码器之间的特征匹配,从而提高网络的性能和稳定性。

合并特征信息

在 U-Net 的解码器阶段,来自编码器的特征图与上采样后的特征图进行合并。这种合并操作允许解码器利用来自不同层级的信息,并帮助网络更好地还原图像的细节和结构。

合并特征信息的作用包括:

- 允许网络利用编码器和解码器之间的多层级特征信息,从而提高分割性能。

- 通过将不同层级的特征进行融合,使得网络能够更好地捕获图像中的细微特征。

代码实现

以下是使用 PyTorch 实现的简化版本 U-Net 的代码:

import torch

import torch.nn as nn

class DoubleConv(nn.Module):

def __init__(self, in_channels, out_channels):

super(DoubleConv, self).__init__()

self.conv = nn.Sequential(

nn.Conv2d(in_channels, out_channels, 3, 1, 1),

nn.ReLU(inplace=True),

nn.Conv2d(out_channels, out_channels, 3, 1, 1),

nn.ReLU(inplace=True)

)

def forward(self, x):

return self.conv(x)

class UNet(nn.Module):

def __init__(self, in_channels, out_channels):

super(UNet, self).__init__()

self.conv1 = DoubleConv(in_channels, 64)

self.pool = nn.MaxPool2d(2)

self.conv2 = DoubleConv(64, 128)

self.conv3 = DoubleConv(128, 256)

self.conv4 = DoubleConv(256, 512)

self.conv5 = DoubleConv(512, 1024)

self.up = nn.Upsample(scale_factor=2, mode='bilinear', align_corners=True)

self.conv6 = DoubleConv(1024, 512)

self.conv7 = DoubleConv(512, 256)

self.conv8 = DoubleConv(256, 128)

self.conv9 = DoubleConv(128, 64)

self.conv10 = nn.Conv2d(64, out_channels, 1)

def forward(self, x):

x1 = self.conv1(x)

x2 = self.conv2(self.pool(x1))

x3 = self.conv3(self.pool(x2))

x4 = self.conv4(self.pool(x3))

x5 = self.conv5(self.pool(x4))

x = self.conv6(torch.cat([x5, self.up(x4)], dim=1))

x = self.conv7(torch.cat([x, self.up(x3)], dim=1))

x = self.conv8(torch.cat([x, self.up(x2)], dim=1))

x = self.conv9(torch.cat([x, self.up(x1)], dim=1))

x = self.conv10(x)

return x

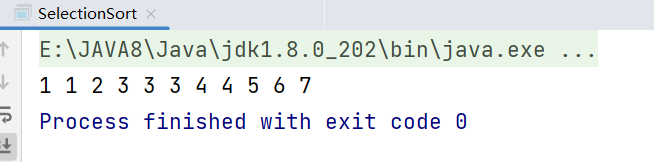

上述代码定义了一个简单的 U-Net 模型,包括 DoubleConv 类用于构建 U-Net 的基本卷积块,以及 UNet 类用于定义完整的 U-Net 结构。在 UNet 类中,我们首先定义了编码器部分(conv1 到 conv5),然后定义了解码器部分(conv6 到 conv10),并在每个解码器阶段添加了跳跃连接。

总结

U-Net 是一种强大的深度学习网络架构,特别适用于图像分割任务,尤其是对于医学图像等领域。其独特的 U 形结构和跳跃连接机制使其能够有效地捕获图像中的细微特征,并产生高质量的分割结果。