时序预测 | Matlab实现BiTCN-BiLSTM双向时间卷积神经网络结合双向长短期记忆神经网络时间序列预测

目录

- 时序预测 | Matlab实现BiTCN-BiLSTM双向时间卷积神经网络结合双向长短期记忆神经网络时间序列预测

- 预测效果

- 基本介绍

- 程序设计

- 参考资料

预测效果

基本介绍

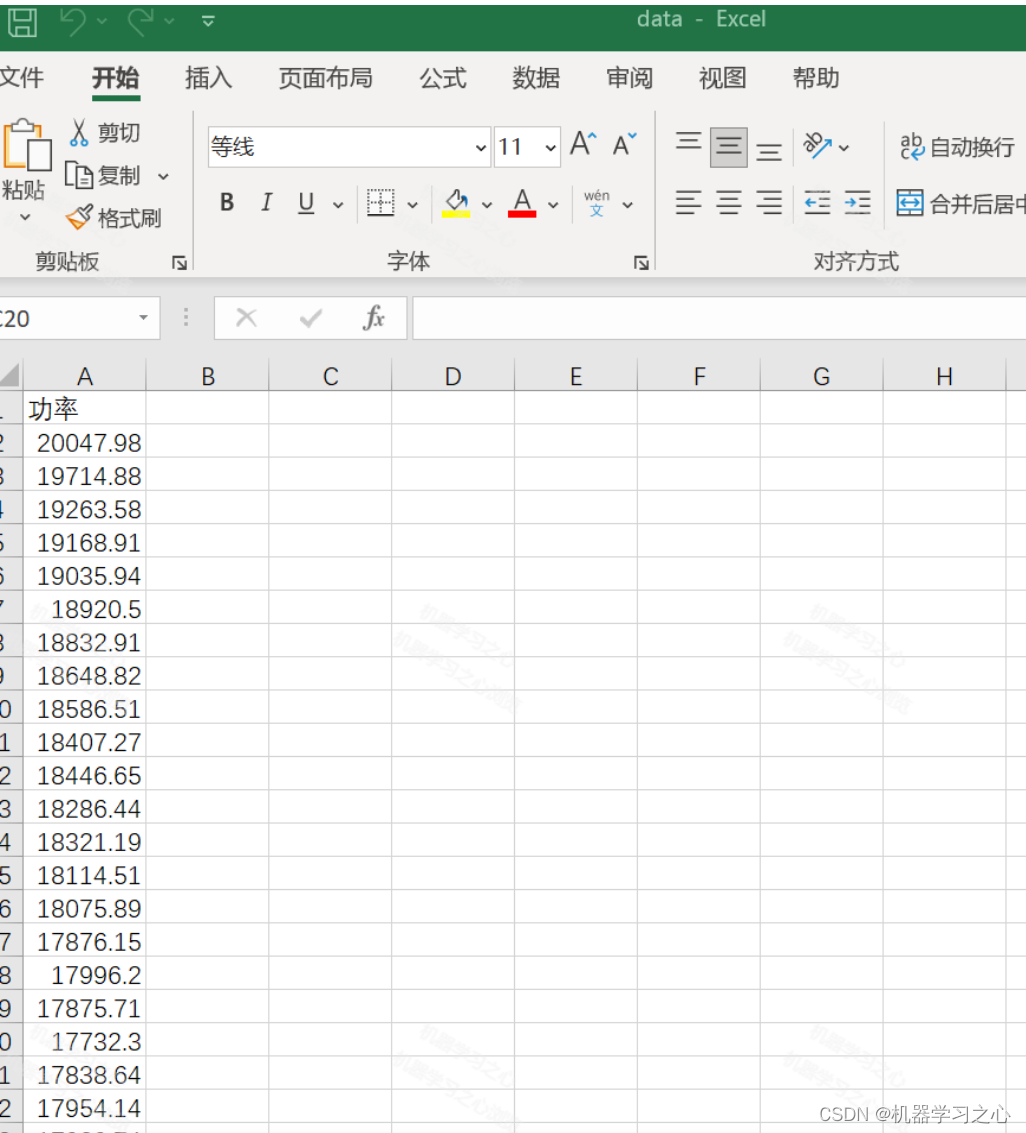

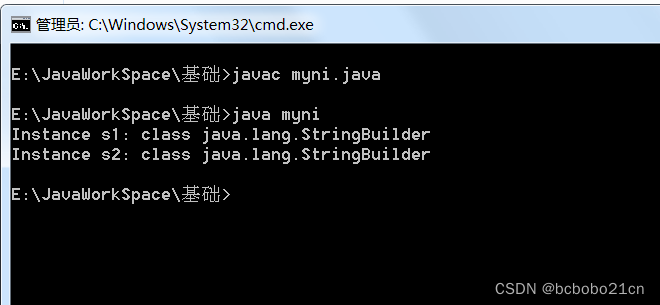

1.Matlab实现BiTCN-BiLSTM双向时间卷积神经网络结合双向长短期记忆神经网络时间序列预测(完整源码和数据),单变量时间序列预测,运行环境matlab2023及以上,excel数据,方便替换;

2.评价指标RMSE、MAPE、MAE、MSE、R2等;

3.程序语言为matlab,程序可出预测效果图,误差分析图。

4.代码特点:参数化编程、参数可方便更改、代码编程思路清晰、注释明细。

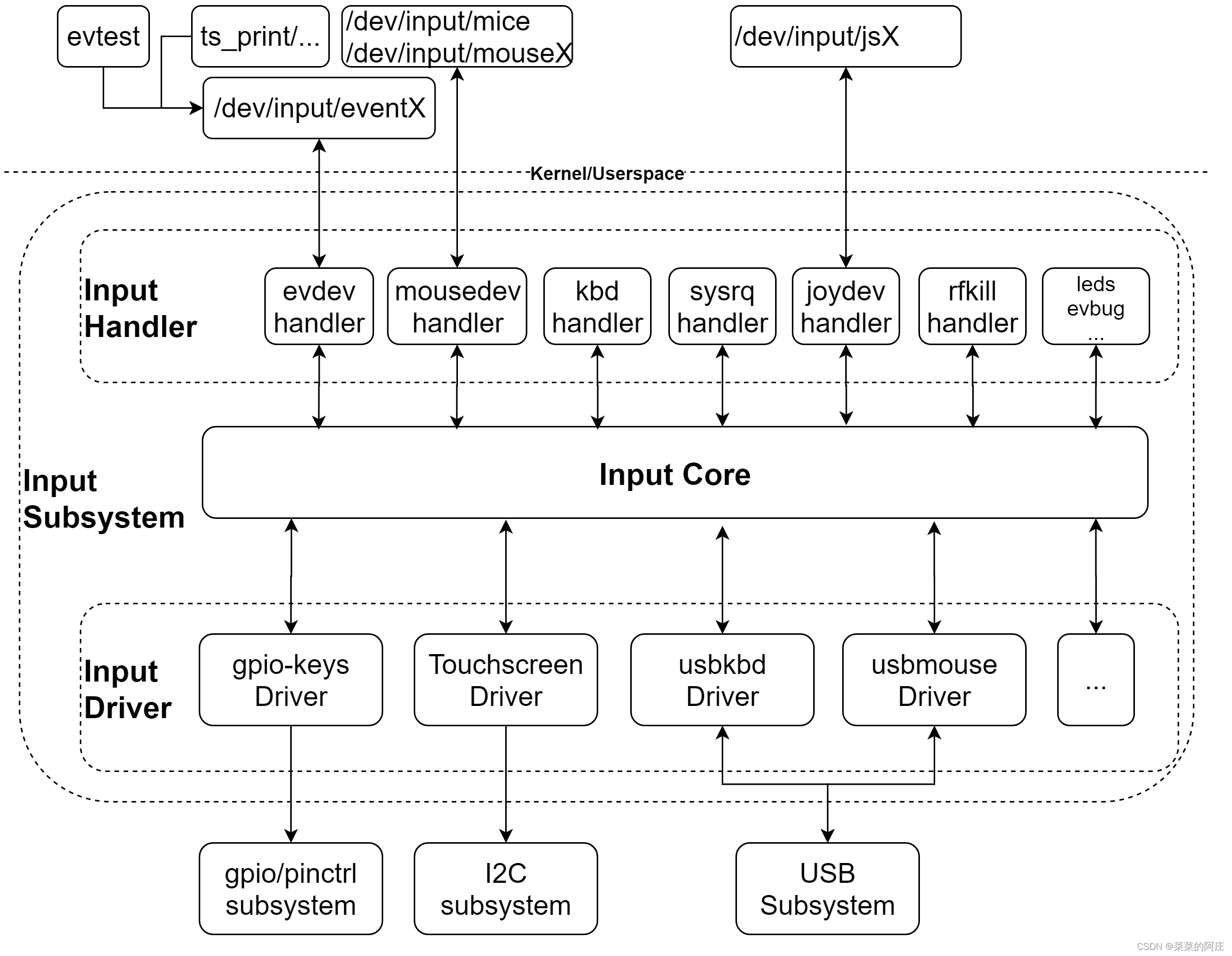

BiTCN-BiLSTM是双向时间卷积神经网络(BiTCN)与双向长短期记忆神经网络(BiLSTM)的结合,用于时间序列预测。这种组合模型充分利用了两种网络结构的优势,旨在提高时间序列预测的精度和效率。

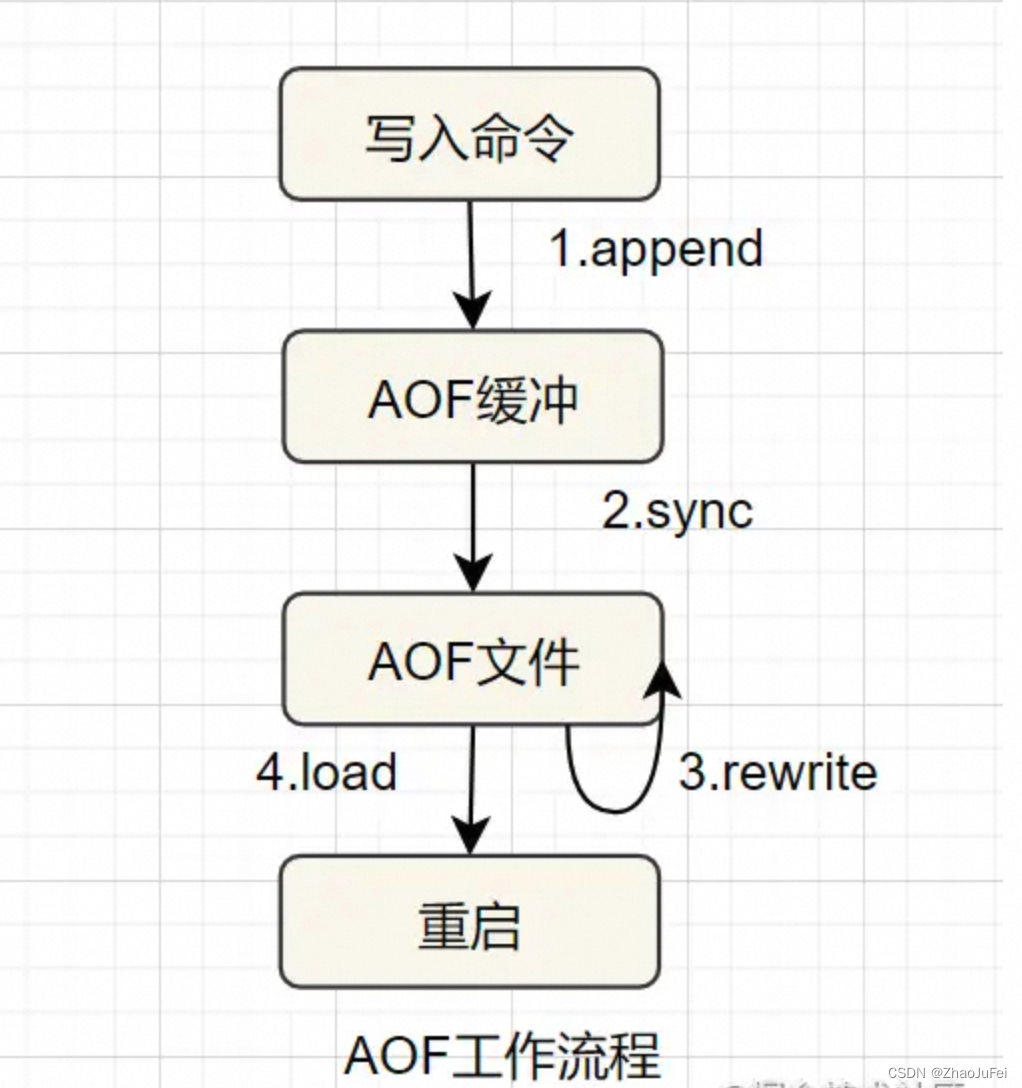

首先,BiTCN通过卷积操作捕捉时间序列中的局部特征,同时其双向结构允许网络从前向和后向两个方向提取信息,从而更全面地理解数据。这种结构使得BiTCN能够学习到数据中的复杂模式和结构。

而BiLSTM则是一种特殊的循环神经网络,通过引入长短期记忆机制,能够处理长距离依赖关系,有效记住并利用历史信息。其双向结构则使得网络能够同时考虑前向和后向的上下文信息,从而进一步提高预测的准确性。

将BiTCN和BiLSTM结合,可以使得模型既能够捕捉到时间序列的局部特征,又能够处理长距离依赖关系,同时充分利用前后向的上下文信息。这种组合模型在时间序列预测中具有很大的潜力,可以应用于各种需要预测未来趋势的场景,如金融市场预测、气象预测、能源需求预测等。

需要注意的是,BiTCN-BiLSTM模型的训练和调优可能需要大量的数据和计算资源,并且需要对模型参数进行精细调整以优化性能。此外,对于不同的应用场景和数据集,可能需要设计不同的网络结构和参数设置来达到最佳的预测效果。

总的来说,BiTCN-BiLSTM是一种强大的时间序列预测模型,结合了卷积神经网络和循环神经网络的优点,具有广泛的应用前景。

程序设计

- 完整源码和数据获取方式资源出下载Matlab实现BiTCN-BiLSTM双向时间卷积神经网络结合双向长短期记忆神经网络时间序列预测 。

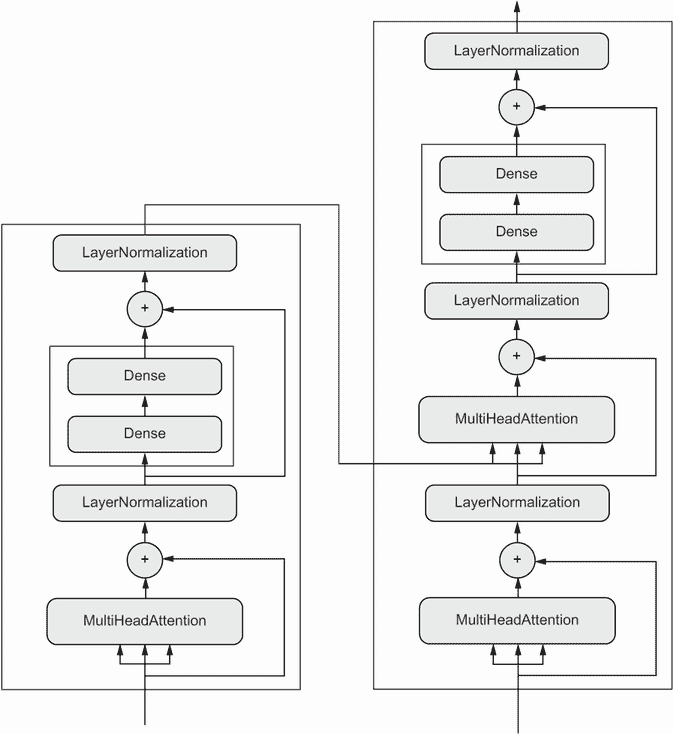

% 添加残差块到网络

lgraph = addLayers(lgraph, layers);

% 连接卷积层到残差块

lgraph = connectLayers(lgraph, outputName, "conv1_" + i);

% 创建 TCN反向支路flip网络结构

Fliplayers = [

FlipLayer("flip_" + i) % 反向翻转

convolution1dLayer(1, numFilters, Name = "convSkip_"+i); % 反向残差连接

convolution1dLayer(filterSize, numFilters, DilationFactor = dilationFactor, Padding = "causal", Name="conv2_" + i) % 一维卷积层

layerNormalizationLayer % 层归一化

spatialDropoutLayer(dropoutFactor) % 空间丢弃层

convolution1dLayer(filterSize, numFilters, DilationFactor = dilationFactor, Padding = "causal") % 一维卷积层

layerNormalizationLayer % 层归一化

reluLayer % 激活层

spatialDropoutLayer(dropoutFactor, Name="drop" + i) % 空间丢弃层

];

% 添加 flip 网络结构到网络

lgraph = addLayers(lgraph, Fliplayers);

% 连接 flip 卷积层到残差块

lgraph = connectLayers(lgraph, outputName, "flip_" + i);

lgraph = connectLayers(lgraph, "drop" + i, "add_" + i + "/in3");

lgraph = connectLayers(lgraph, "convSkip_"+i, "add_" + i + "/in4");

% 残差连接 -- 首层

if i == 1

% 建立残差卷积层

% Include convolution in first skip connection.

layer = convolution1dLayer(1,numFilters,Name="convSkip");

lgraph = addLayers(lgraph,layer);

lgraph = connectLayers(lgraph,outputName,"convSkip");

lgraph = connectLayers(lgraph,"convSkip","add_" + i + "/in2");

else

lgraph = connectLayers(lgraph,outputName,"add_" + i + "/in2");

end

% Update layer output name.

outputName = "add_" + i;

end

% CSDN 机器学习之心

参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/128577926?spm=1001.2014.3001.5501

[2] https://blog.csdn.net/kjm13182345320/article/details/128573597?spm=1001.2014.3001.5501

![练习 10 Web [MRCTF2020]你传你呢](https://img-blog.csdnimg.cn/direct/16aad8fae7fc4c0395601e3c49b0ec82.png)