一、背景

AI大模型与小模型之间存在一种“脱胎”与“反哺”的关系,这种关系在AI技术的发展中起到了重要的作用。

首先,我们来理解一下“脱胎”的概念。在AI领域,大模型通常具有更大的参数量、更强的表达能力和更高的计算需求。这些大模型通过大规模的数据训练,能够学习到更加复杂和精细的特征,从而在多种任务上表现出色。小模型则相对简单,参数量较小,计算需求较低。大模型可以通过知识蒸馏(Knowledge Distillation)等技术,将其学到的知识和经验“传授”给小模型,使得小模型能够在保持一定性能的同时,降低计算需求和参数量。这种过程就像是大模型“脱胎”为小模型,将自身的精华传递给后者。

接下来,我们来看看“反哺”的过程。虽然小模型在性能和计算需求上相对较低,但它们在某些特定任务或场景下可能具有更好的表现。例如,在资源受限的环境或实时性要求较高的任务中,小模型可能更加适用。此外,小模型通常具有更快的训练速度和更低的内存消耗,这使得它们在某些场景下更加灵活和高效。这些优势使得小模型在某些方面能够“反哺”大模型。例如,小模型可以在某些特定任务上提供优化和改进的建议,帮助大模型更好地适应这些任务。同时,小模型还可以为大模型提供额外的数据或特征,以提高其性能和泛化能力。

总之,AI大模型与小模型之间的“脱胎”与“反哺”关系体现了AI技术的不断进步和优化。大模型通过知识蒸馏等技术将自身的知识和经验传递给小模型,使得小模型能够在保持一定性能的同时降低计算需求和参数量。而小模型则通过在某些特定任务或场景下的优势来“反哺”大模型,为其提供优化和改进的建议以及额外的数据或特征。这种相互作用和协同进化的过程将推动AI技术的持续发展和进步。

二、反哺

AI大模型与小模型之间的“反哺”过程主要体现在以下几个方面:

- 特定任务优化:小模型在某些特定任务或场景下可能表现出比大模型更好的性能。例如,在资源受限的环境或实时性要求较高的任务中,小模型可能更加适用。小模型可以将其在这些特定任务上的优化和改进建议反馈给大模型,帮助大模型在这些任务上实现更好的性能。

- 数据增强:小模型由于其较小的参数量和计算需求,可能更适合处理大规模的数据集。小模型可以通过对原始数据进行预处理或生成新的数据,为大模型提供更多的训练数据。这些数据可以用于增强大模型的训练效果,提高其泛化能力。

- 特征提取:小模型在训练过程中可能会学习到一些与大模型不同的特征。这些特征可能对于某些任务是有益的。小模型可以将其学习到的特征提取出来,与大模型的特征进行融合,以提高大模型在这些任务上的性能。

- 模型压缩与加速:小模型通常具有更快的训练速度和更低的内存消耗。大模型可以通过借鉴小模型的架构或优化技术,实现自身的压缩和加速。这样,大模型可以在保持较高性能的同时,降低计算需求和内存消耗,从而更加适应实际应用场景。

总之,AI大模型与小模型之间的“反哺”过程是一个相互学习、相互优化的过程。小模型通过其在特定任务、数据增强、特征提取和模型压缩等方面的优势,为大模型提供优化和改进的建议,帮助大模型更好地适应实际应用场景。这种相互作用和协同进化的过程将推动AI技术的持续发展和进步。

101. **多目标优化与协同决策(Multi-Objective Optimization and Collaborative Decision-Making)**:

- 针对涉及多个相互影响的目标和约束条件的行业问题,构建可以实现多目标优化和协同决策的AI大模型,有效整合不同行业小模型的解决方案,达成全局最优或平衡点。

102. **对抗性训练与鲁棒性提升(Adversarial Training and Robustness Enhancement)**:

- 利用对抗性训练方法提高AI大模型对噪声、异常值以及恶意攻击的抵抗力,确保其在面临不同行业应用场景下的稳定性和可靠性。

103. **基于规则推理的人工智能系统(Rule-Based Reasoning AI Systems)**:

- 结合传统的基于规则推理技术与现代机器学习方法,使AI大模型能够理解和执行从各行业小模型中提取的专家规则,并在此基础上进行创新和拓展。

104. **深度神经网络的可解释模块化(Interpretable Modularization in Deep Neural Networks)**:

- 将AI大模型设计为由多个可解释、具有特定功能的模块组成,每个模块对应不同行业的知识与特性。通过模块间的灵活组合和优化,提升大模型在处理跨行业问题时的透明度与泛化能力。

105. **基于案例推理与在线学习结合(Case-Based Reasoning Combined with Online Learning)**:

- 结合案例推理方法,在AI大模型中构建一个能够实时更新、存储并检索典型实例库的机制,使其能从各行业小模型积累的经验中快速学习,并在新场景下实现有效的决策支持。

106. **主动式领域适应(Active Domain Adaptation)**:

- 设计AI大模型具备主动探索和适应新行业的能力,通过选择性地收集最有价值的数据或设置最优的训练目标,加速对新领域的学习进程和性能提升。

107. **分布式联邦学习与隐私保护(Distributed Federated Learning with Privacy Protection)**:

- 在确保数据隐私的前提下,利用分布式联邦学习技术让AI大模型能够在多行业间安全地共享和整合知识,从而提高整体模型性能,同时遵守严格的隐私法规要求。

108. **自反馈循环学习(Self-Feedback Loop Learning)**:

- 构建AI大模型自我迭代改进的机制,使其在执行任务的过程中能够根据结果反馈不断调整自身策略,并从各行业小模型中学到的知识中提取通用模式,以持续优化其表现。

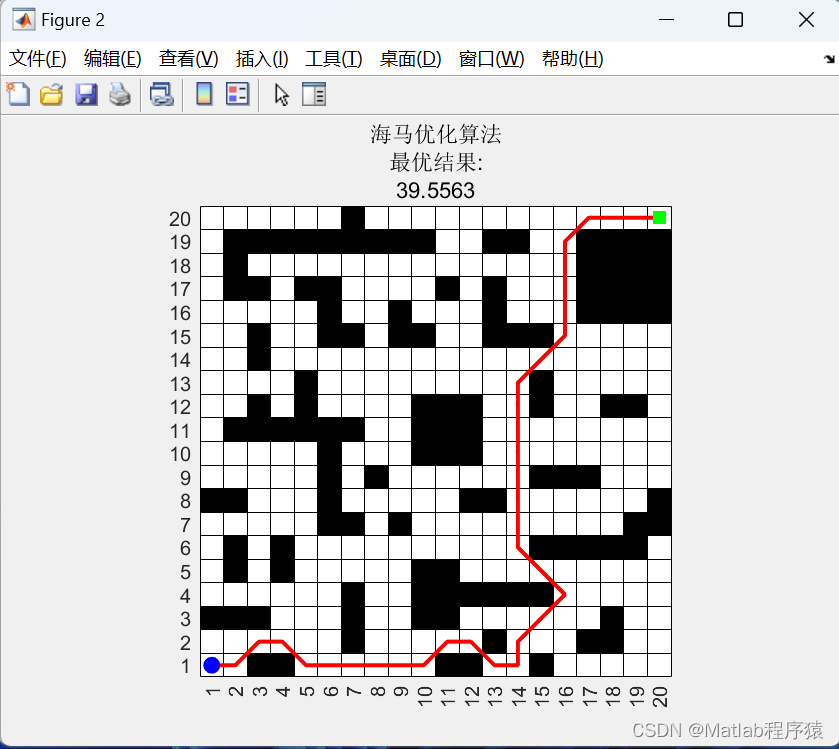

此图片来源于网络

以上108种策略拓展了AI大模型融合众多行业小模型知识的维度和途径,旨在打造一个更加智能、高效且具有广泛适应性的综合性人工智能系统,为解决实际业务中的复杂挑战提供有力支撑。

基于现有的机器学习、深度学习和人工智能技术原理,国内外前沿期刊将一些核心概念和方法进行了组合与扩展,以展示在实际应用中如何利用众多行业AI小模型来提升AI大模型的能力。这些策略涵盖了广泛的知识点,包括但不限于迁移学习、元学习、多任务学习、强化学习、自适应学习、可解释性、分布式学习等,并结合具体应用场景进行了拓展。

尽管部分描述可能尚未有现成的完整解决方案或成熟案例,但它们体现了目前研究领域的前沿趋势和技术探索方向。通过整合不同技术和算法,可以为解决跨行业知识融合的实际问题提供创新思路和潜在路径。

此图片来源于网络