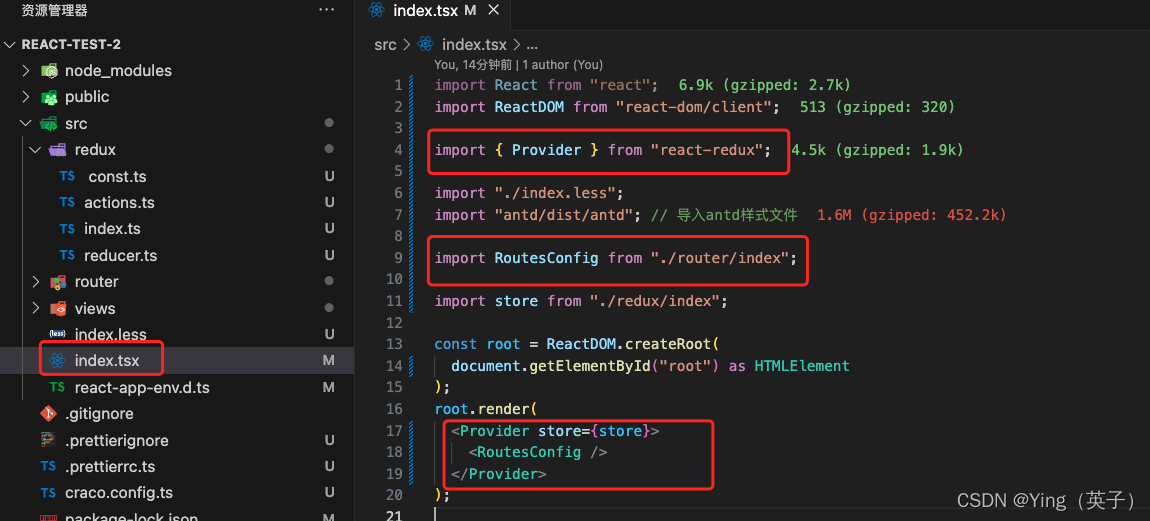

一、说明

聊天机器人提供自动对话,可以帮助用户完成任务或寻求信息。随着深度学习的最新进展,聊天机器人正变得越来越具有对话性和实用性。这个全面的教程将利用 PyTorch 和 Python 从头开始构建聊天机器人,涵盖模型架构、数据准备、训练循环、评估和部署。

查看 JavaScript 中的自然语言处理 (NLP)(系列)

二、设置 Python 环境

我们首先需要一个环境来运行我们的聊天机器人代码。本指南使用 Python 3.8 和 PyTorch 1.12:

# Create conda env

conda create -n chatbot python=3.8

conda activate chatbot# Install PyTorch

pip install torch==1.12.0+cpu torchvision==0.13.0+cpu torchaudio===0.12.0 -f https://download.pytorch.org/whl/torch_stable.html

# Check installs

python -c "import torch; print(torch.__version__)"这为我们提供了用于机器学习工作的最新 PyTorch 版本。

三、聊天机器人模型架构

模型架构定义了生成聊天机器人响应的数据流和计算。我们将使用基于 LSTM 的编码器-解码器架构,该架构通常用于序列到序列任务。

编码器将输入语句(例如,“天气预报是什么?”)映射到固定长度的矢量表示形式中。解码器将此表示映射到自然语言响应(例如,“今天天气晴朗,25摄氏度”)。

import torch

import torch.nn as nnclass EncoderLSTM(nn.Module):

def __init__(self, input_size, hidden_size):

super().__init__()

self.lstm = nn.LSTM(input_size, hidden_size)

def forward(self, input):

_, (hidden, cell) = self.lstm(input)

return hidden, cell

class DecoderLSTM(nn.Module):

def __init__(self, input_size, hidden_size):

super().__init__()

self.lstm = nn.LSTM(input_size, hidden_size)

def forward(self, input):

outputs, _ = self.lstm(input)

return outputs

class Seq2Seq(nn.Module):

def __init__(self, encoder, decoder):

super().__init__()

self.encoder = encoder

self.decoder = decoder我们实例化编码器和解码器,并将它们组合成一个 Seq2Seq 模型。我们将对此进行端到端的训练。

四、准备训练数据

我们需要一个对话示例数据集来训练我们的模型。导入数据集后,我们将文本标记为整数序列:

Kaggle 托管对话语料库,如 Ubuntu 对话语料库、句子释义集合和每日对话数据集,它们提供 100k+ 对话交流。这些是免费下载和使用的。

data = load_dataset("daily_dialog")def tokenize(text):

return [vocab[token] for token in text.split(" ")]

vocab = {"hello": 1, "what": 2, "is": 3, ...}

tokenized_data = data.map(tokenize)我们可以将其拆分为训练集和验证集:

from sklearn.model_selection import train_test_splittrain_data, val_data = train_test_split(tokenized_data)五、训练循环

准备好数据后,我们定义模型、损失准则和优化器,然后循环示例:

embed_size = 128

hidden_size = 512

model = Seq2Seq(encoder=EncoderLSTM(embed_size, hidden_size),

decoder=DecoderLSTM(embed_size, hidden_size))criterion = nn.NLLLoss()

optimizer = torch.optim.Adam(model.parameters())

for epoch in range(10):

for input, target in train_data:

output = model(input)

loss = criterion(output, target)

loss.backward()

optimizer.step()

optimizer.zero_grad()通过反复计算损失和反向传播,我们的模型学习了生成逻辑。

六、模型评估

我们使用困惑度和 BLEU 分数等指标评估我们训练有素的聊天机器人的验证数据:

from transformers import GPT2Tokenizertokenizer = GPT2Tokenizer.from_pretrained("gpt2")

scores = evaluate(model, val_data, tokenizer)

print(f"Perplexity score: {scores['perplexity']}")

print(f"BLEU score: {scores['bleu']}")这些度量检查模型生成的流畅性、合理性和准确性。

七、部署

一旦我们有了一个高性能模型,我们就使用 FastAPI 将其打包到 API 中:

import fastapiapp = fastapi.FastAPI()

@app.post("/chat")

def chat(input: str):

input = tokenize(input)

output = model(input)

return {"bot": output}API 获取输入文本,将其馈送到我们的模型以生成机器人响应,并返回预测。

八、结论

有了它,我们在 Python 中拥有了一个功能齐全的深度学习聊天机器人,可以响应消息并进行对话!我们学习了如何对模型进行排序,例如擅长文本数据的 LSTM,在 PyTorch 中训练聊天机器人模型,并了解如何优化、改进和部署我们的创作。

还有很多事情可以做,比如添加个性化、链接 API 数据源以获取新鲜事实、集成翻译功能等等——聊天机器人的工作永远不会完成!我喜欢指导您完成本教程,并希望您能使用这些新技能来构建您的智能聊天应用程序。

九、常见问题解答

- 为什么 PyTorch 更适合聊天机器人而不是 TensorFlow 或其他库?

我不会说它一定更好,但 PyTorch 的急切执行(动态计算而不是静态图)可以使迭代和调试更容易。所有主要框架都有其优势。选择你喜欢与之合作的人!

- 我需要多少数据来训练一个好的聊天机器人?

没有硬性门槛,但一般来说,对话数据越多越好。数十万到数百万个对话示例对于生成类似人类的响应并非不切实际。利用预先训练的语言模型检查点也有帮助。

- 需要什么样的硬件计算能力?我可以在本地或笔记本电脑上运行复杂的模型吗?

建议使用 GPU 加速,以获得除最基本原型之外的所有原型的良好性能。如果您没有认真的硬件,云服务提供 GPU 甚至量子加速训练!但要开始在本地进行试验,稍后再扩大规模。

- 除了聊天机器人,我还可以使用 PyTorch 探索哪些其他 NLP 应用程序?

吨!文本分类、语义搜索、语法校正、预测类型、文档摘要、语言翻译......天空是无限的!PyTorch 拥有出色的文本支持和活跃的开发人员社区。