工作中经常会使用到轻量级的网络模型来进行开发,所以平时也会常常留意使用和记录,在前面的博文中有过很多相关的实践工作,感兴趣的话可以自行移步阅读即可。

《移动端轻量级模型开发谁更胜一筹,efficientnet、mobilenetv2、mobilenetv3、ghostnet、mnasnet、shufflenetv2驾驶危险行为识别模型对比开发测试》

《基于Pytorch框架的轻量级卷积神经网络垃圾分类识别系统》

《基于轻量级卷积神经网络模型实践Fruits360果蔬识别——自主构建CNN模型、轻量化改造设计lenet、alexnet、vgg16、vgg19和mobilenet共六种CNN模型实验对比分析》

《探索轻量级模型性能上限,基于GhostNet模型开发构建多商品细粒度图像识别系统》

《基于轻量级神经网络GhostNet开发构建的200种鸟类细粒度识别分析系统》

《基于MobileNet的轻量级卷积神经网络实现玉米螟虫不同阶段识别分析》

《python开发构建轻量级卷积神经网络模型实现手写甲骨文识别系统》

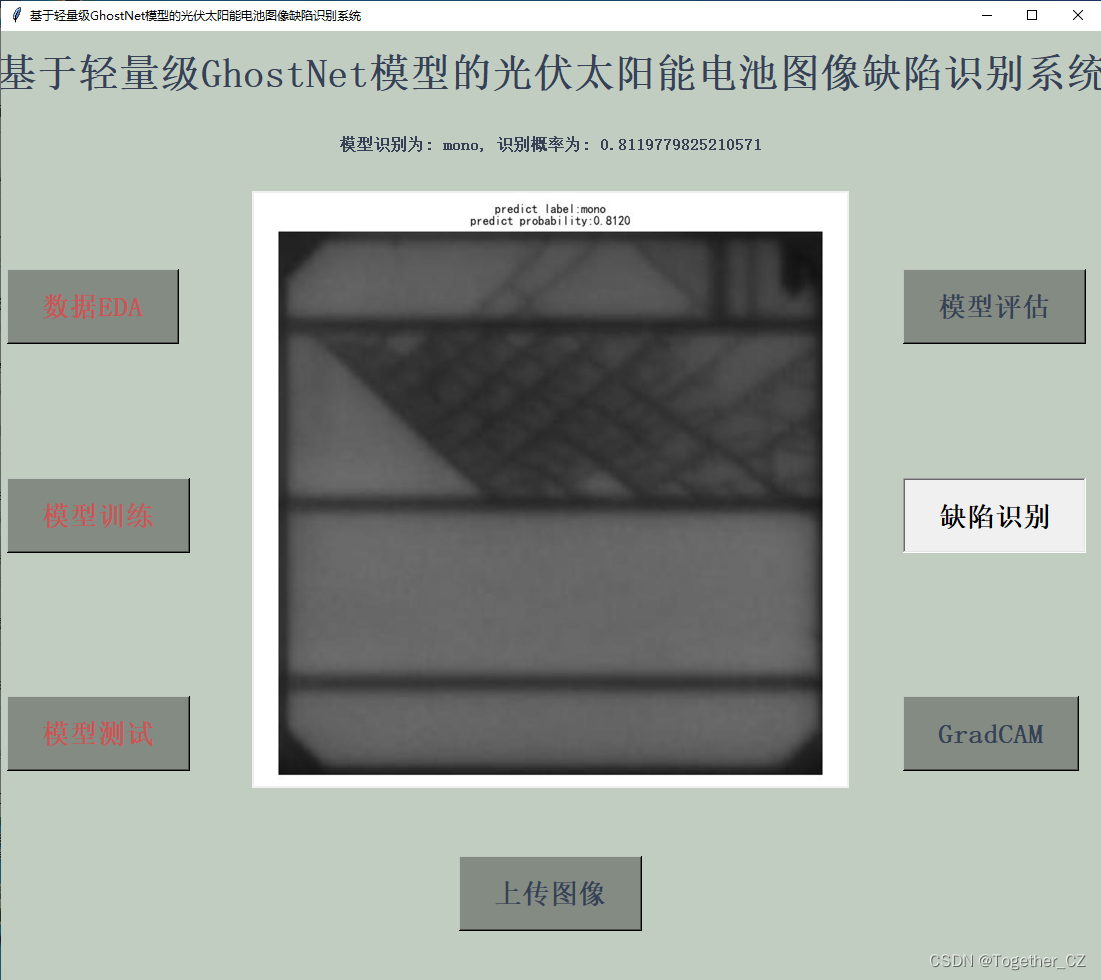

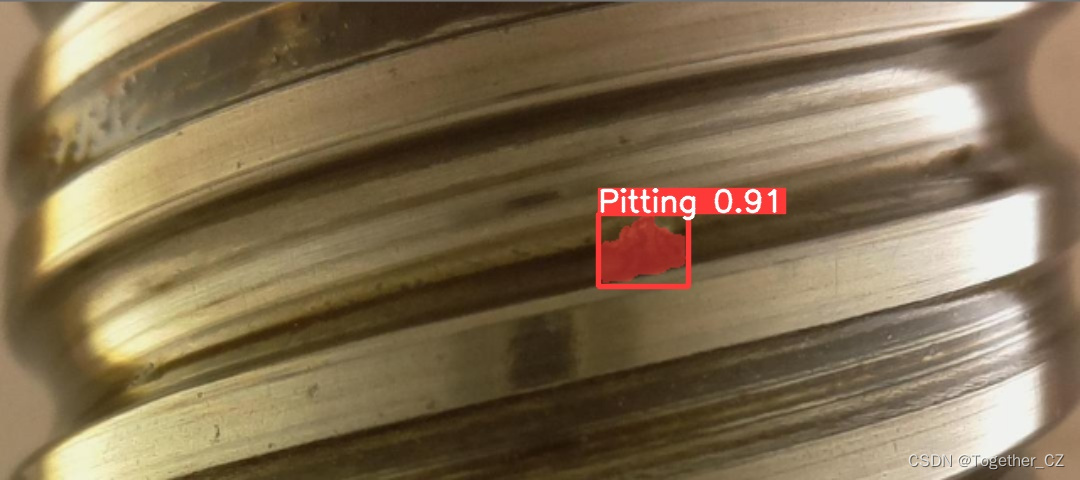

首先看下实例效果:

本文使用的是GhostNet模型,GhostNet 是一种轻量级卷积神经网络,是专门为移动设备上的应用而设计的。其主要构件是 Ghost 模块,一种新颖的即插即用模块。Ghost 模块设计的初衷是使用更少的参数来生成更多特征图 (generate more features by using fewer parameters)。

官方论文地址在这里,如下所示:

官方也开源了项目,地址在这里,如下所示:

可以详细阅读官方的代码实例即可,之后可以基于自己的数据集来开发构建模型即可。

这里给出GhostNet的核心实现部分,如下所示:

class GhostNet(nn.Module):

def __init__(self, cfgs, num_classes=1000, width_mult=1.0):

super(GhostNet, self).__init__()

self.cfgs = cfgs

output_channel = _make_divisible(16 * width_mult, 4)

layers = [

nn.Sequential(

nn.Conv2d(3, output_channel, 3, 2, 1, bias=False),

nn.BatchNorm2d(output_channel),

nn.ReLU(inplace=True),

)

]

input_channel = output_channel

block = GhostBottleneck

for k, exp_size, c, use_se, s in self.cfgs:

output_channel = _make_divisible(c * width_mult, 4)

hidden_channel = _make_divisible(exp_size * width_mult, 4)

layers.append(

block(input_channel, hidden_channel, output_channel, k, s, use_se)

)

input_channel = output_channel

self.features = nn.Sequential(*layers)

output_channel = _make_divisible(exp_size * width_mult, 4)

self.squeeze = nn.Sequential(

nn.Conv2d(input_channel, output_channel, 1, 1, 0, bias=False),

nn.BatchNorm2d(output_channel),

nn.ReLU(inplace=True),

nn.AdaptiveAvgPool2d((1, 1)),

)

input_channel = output_channel

output_channel = 1280

self.classifier = nn.Sequential(

nn.Linear(input_channel, output_channel, bias=False),

nn.BatchNorm1d(output_channel),

nn.ReLU(inplace=True),

nn.Dropout(0.2),

nn.Linear(output_channel, num_classes),

)

self._initialize_weights()

def forward(self, x, need_fea=False):

if need_fea:

features, features_fc = self.forward_features(x, need_fea)

x = self.classifier(features_fc)

return features, features_fc, x

else:

x = self.forward_features(x)

x = self.classifier(x)

return x

def forward_features(self, x, need_fea=False):

if need_fea:

input_size = x.size(2)

scale = [4, 8, 16, 32]

features = [None, None, None, None]

for idx, layer in enumerate(self.features):

x = layer(x)

if input_size // x.size(2) in scale:

features[scale.index(input_size // x.size(2))] = x

x = self.squeeze(x)

return features, x.view(x.size(0), -1)

else:

x = self.features(x)

x = self.squeeze(x)

return x.view(x.size(0), -1)

def _initialize_weights(self):

for m in self.modules():

if isinstance(m, nn.Conv2d):

nn.init.kaiming_normal_(m.weight, mode="fan_out", nonlinearity="relu")

elif isinstance(m, nn.BatchNorm2d):

m.weight.data.fill_(1)

m.bias.data.zero_()

def cam_layer(self):

return self.features[-1]简单看下数据集情况:

官方的说明指出来数据集来源于原始高分辨率光伏图像中提取,该数据集包含2624个300x300像素的8位灰度图像样本,这些图像是从44个不同的太阳能模块中提取的具有不同退化程度的功能性和有缺陷的太阳能电池。注释图像中的缺陷是固有型或非固有型的,并且已知会降低太阳能模块的功率效率。所有图像都根据大小和视角进行了标准化。此外,在提取太阳能电池之前,消除了由用于捕获EL图像的相机镜头引起的任何失真。每个图像都标注有缺陷概率(0和1之间的浮点值)和太阳能电池图像最初提取的太阳能模块类型(单晶体或多晶体)。

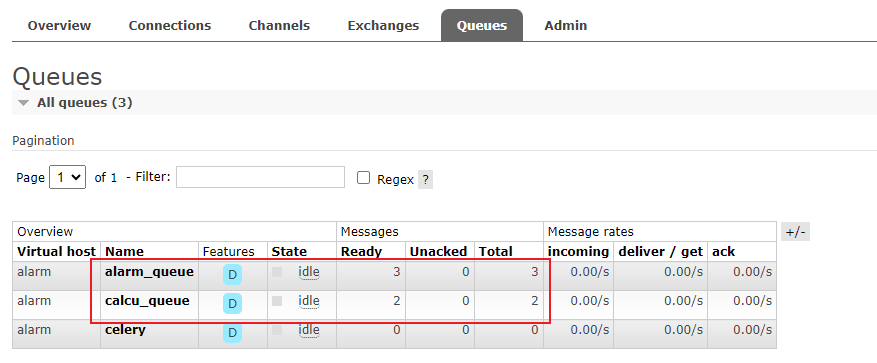

数据分布可视化如下所示:

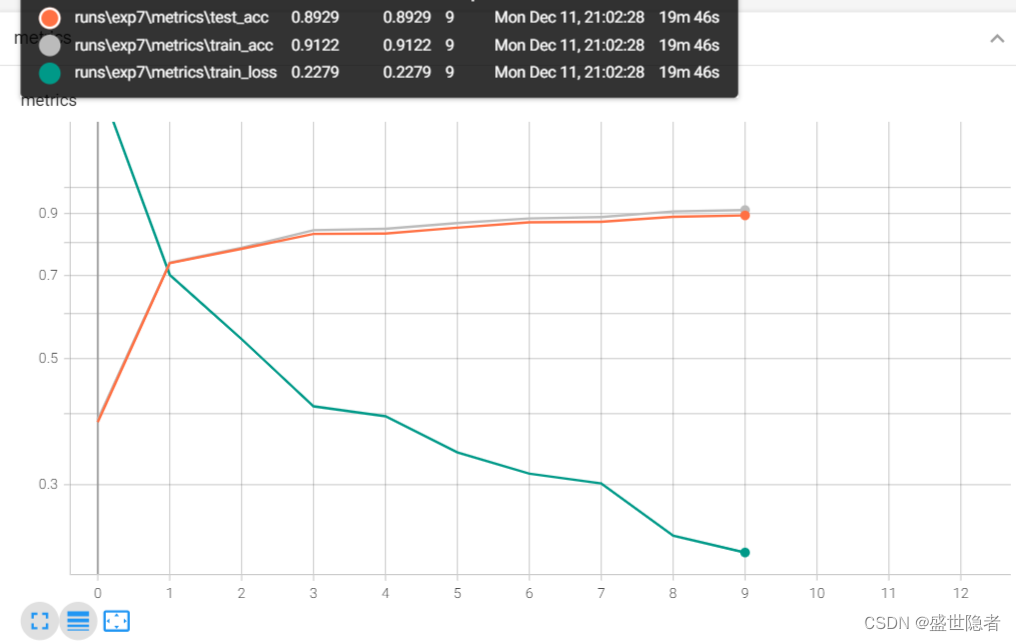

训练完成后看下结果详情:

【混淆矩阵】

【loss曲线】

【acc曲线】

Batch实例可视化如下所示:

可视化推理实例如下所示:

感兴趣的话也都可以自己动手实践下!

![[足式机器人]Part2 Dr. CAN学习笔记-自动控制原理Ch1-3燃烧卡路里-系统分析实例](https://img-blog.csdnimg.cn/direct/feb729847fcf47658cdec044fbb98b8b.png)

![[算法基础 ~排序] Golang 实现](https://img-blog.csdnimg.cn/direct/529cd6681050486c8dd5e50eb7a08b18.png)