目录

Stable Diffusion基本使用方法

学术加速测试

配置中文插件

Prompt与Negative prompt

采样器说明

人像生成

水光效果

微调的使用

图像生成种子/seed使用

附加/Extra

微调实例测试

图生图微调

编辑

使用蒙版微调

Stable Diffusion基本使用方法

环境配置:

Ubuntu20.04, Python 3.10, Stable Diffusion v1-5, CUDA 11.7, cuDNN 8, Pytorch 2, JupyterLab

Stable Diffusion是一款AIGC图片生成模型。该环境已预装webui及JupyterLab,支持可视化文件管理及环境调优。

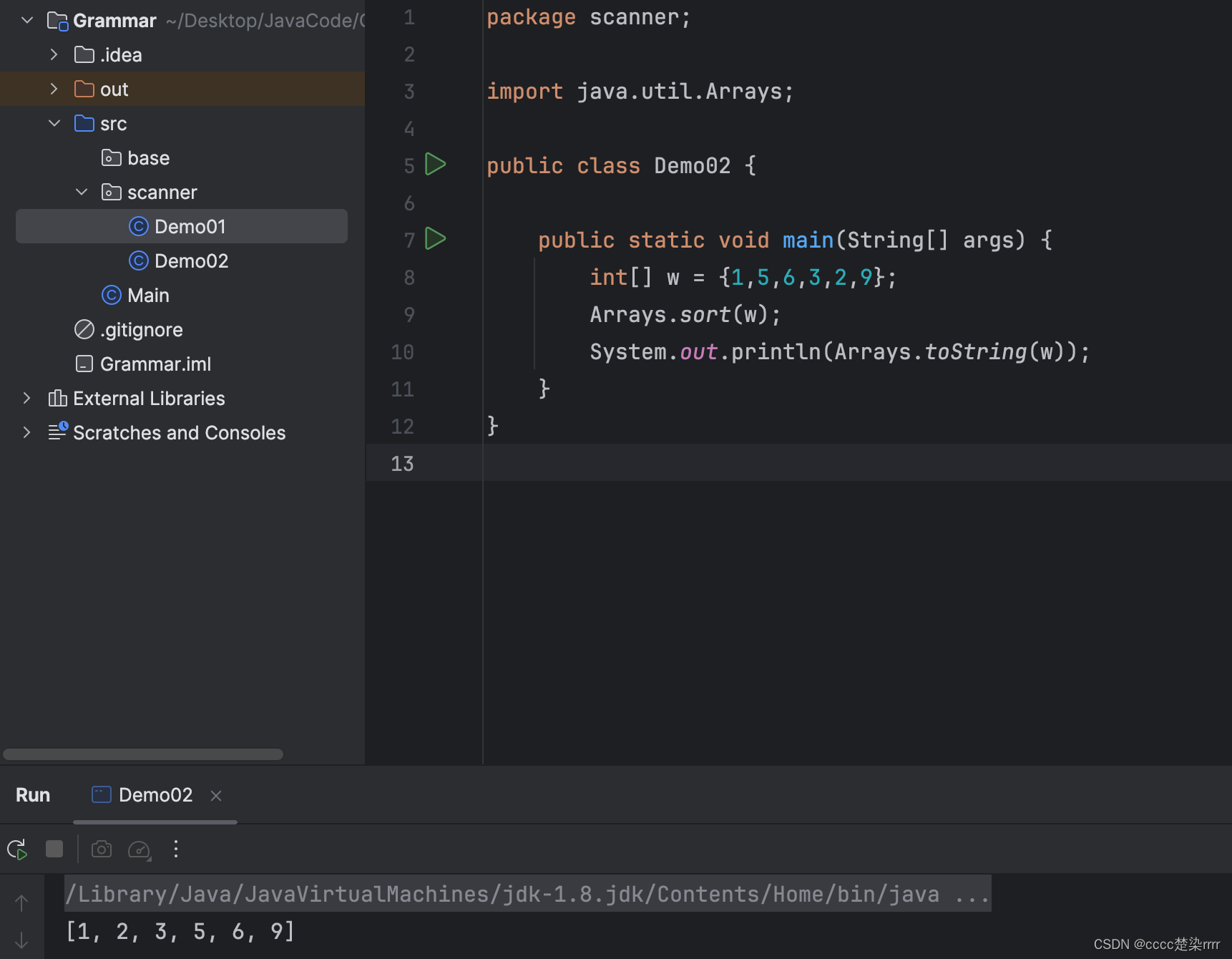

学术加速测试

现在已经加了一个【学术加速设置】的功能,这个可以在对应的描述中看到,对部分学术资源平台加速下载,我们可以实验一下下载【中文插件】来测试一下。

如果是之前配置过的朋友应该知道在可以加速之前的速度实在是让人惊叹,这回搜搜一下就能看到效果。

这是单独启动后测试的,速度的确是快了很多倍。

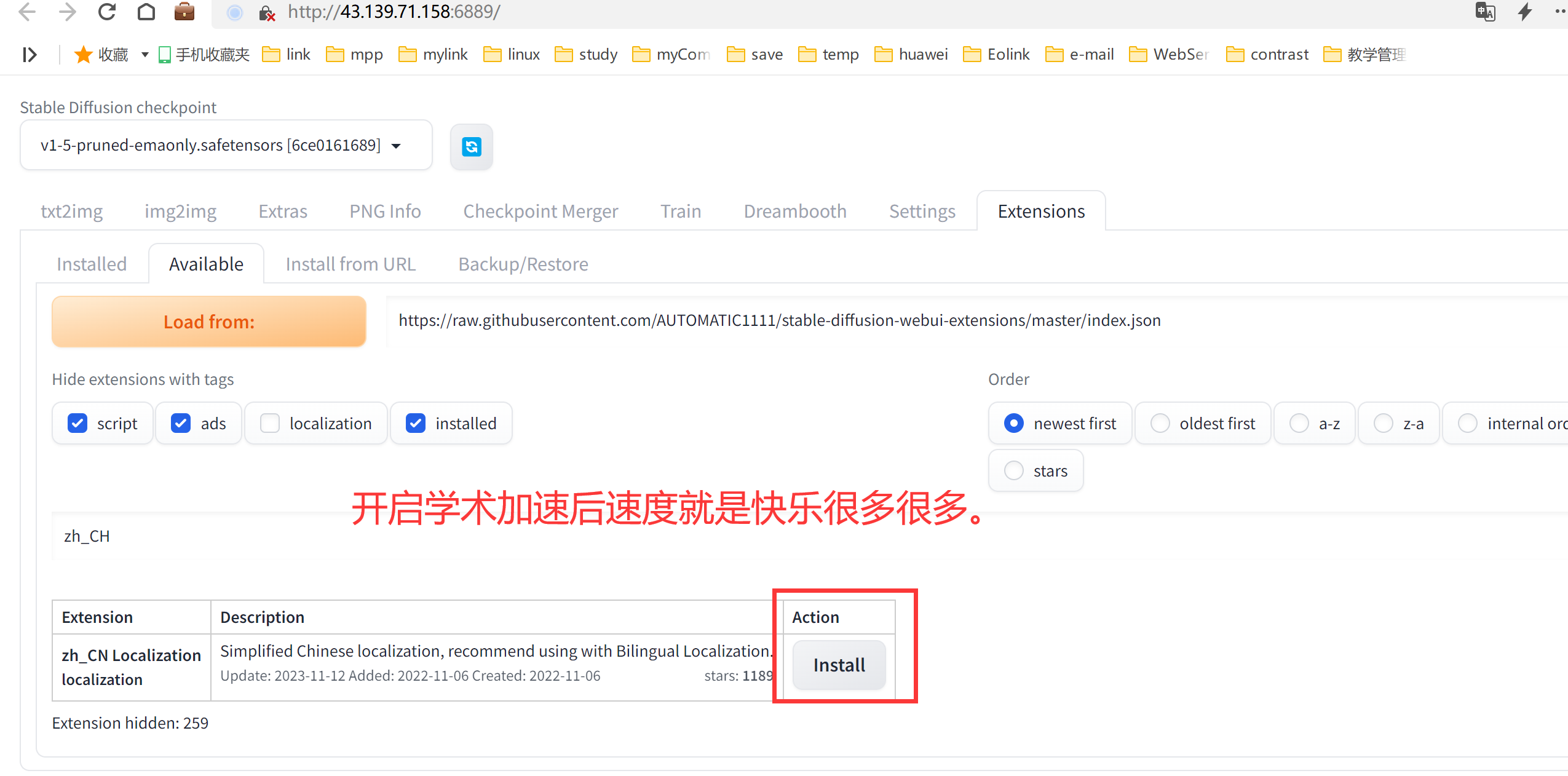

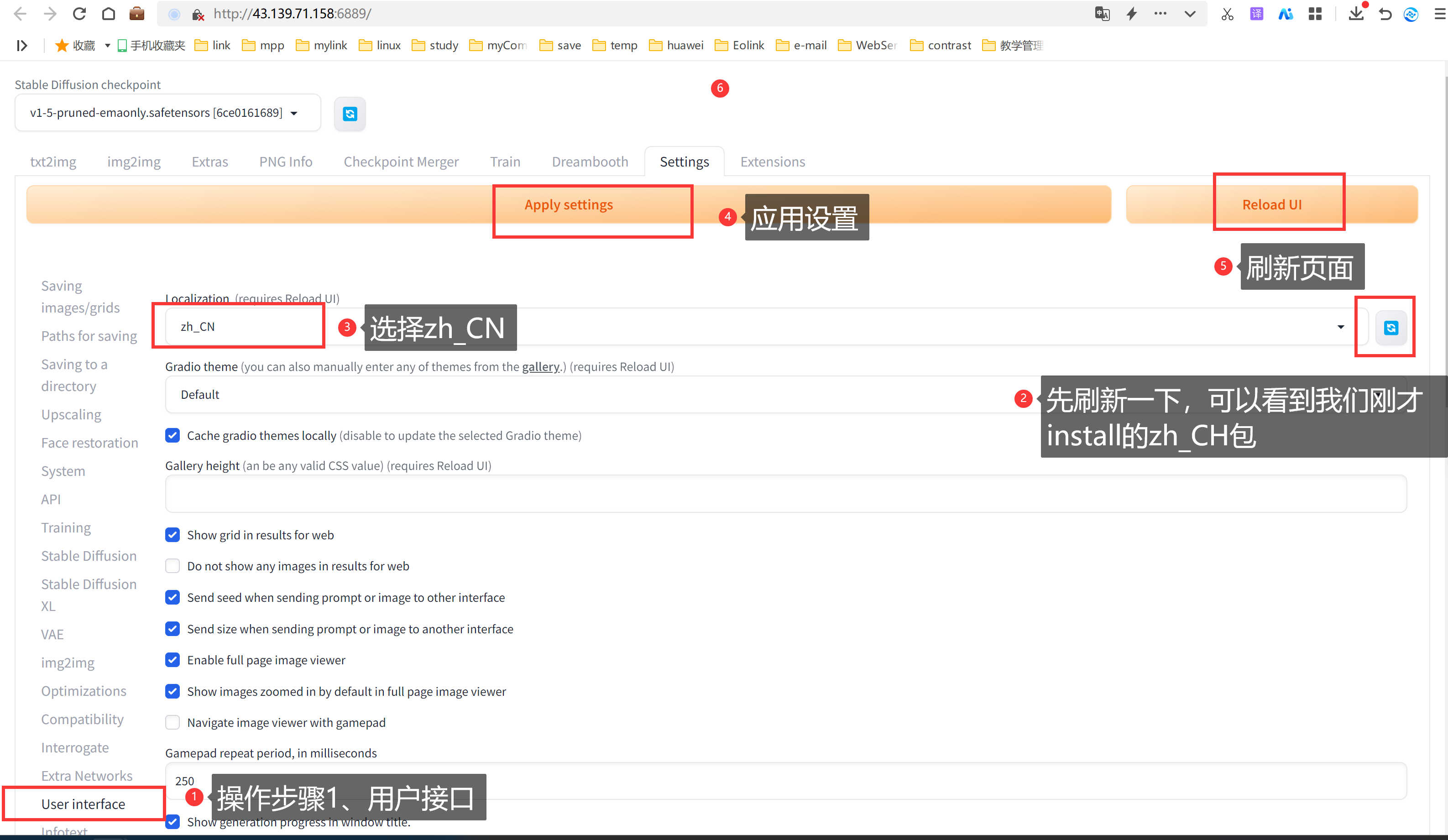

配置中文插件

按照步骤来啊,这个操作应该熟练一些了呢。

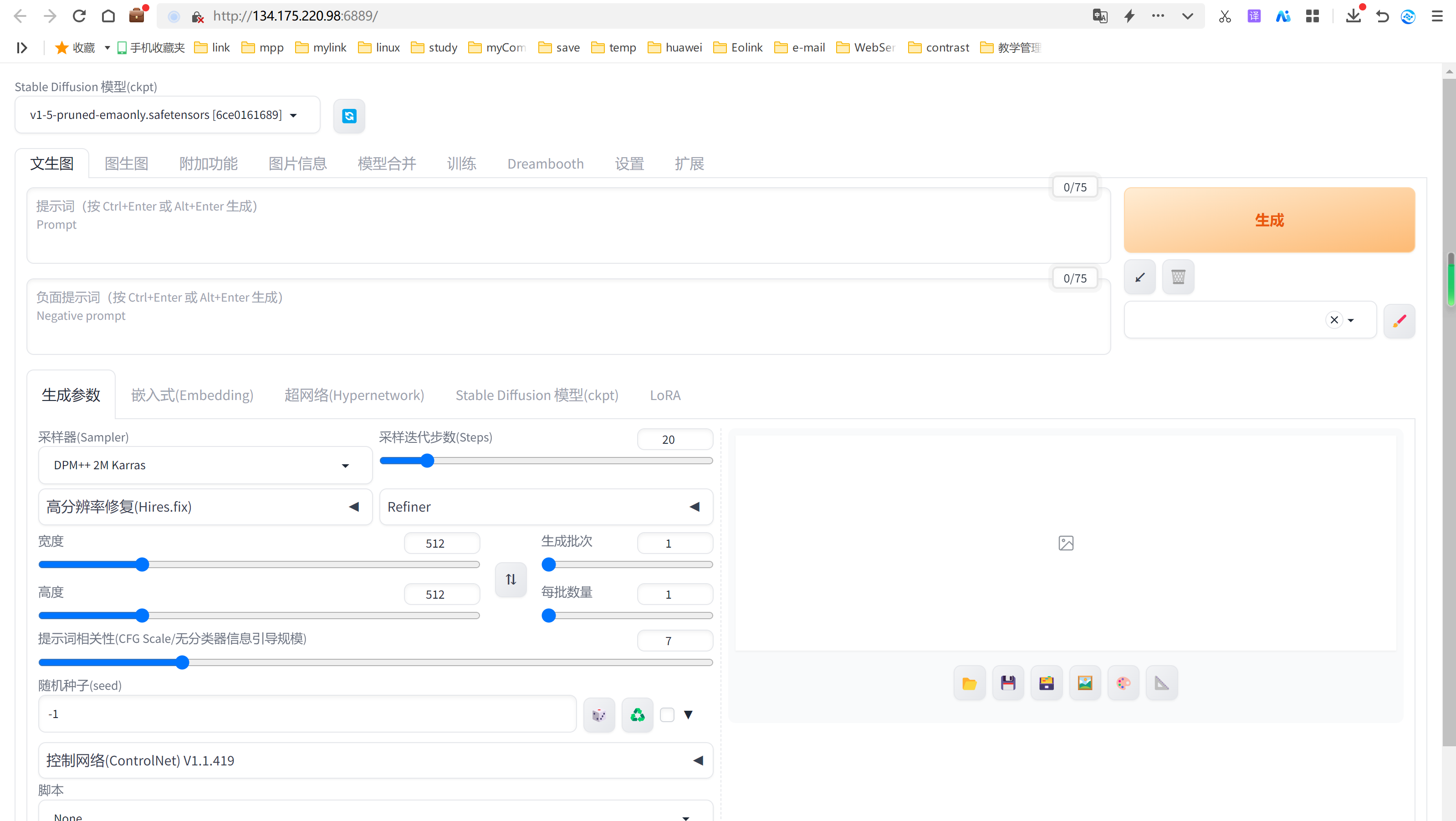

中文插件安装完毕后效果:

Prompt与Negative prompt

正反提示词,这里是在想要生成目标的内容中直接去掉会出现瑕疵的可能项。

采样器说明

Euler

基于Karras论文,在K-diffusion实现20-30steps就能生成效果不错的图片,采样器设置页面中的 sigma noise,sigma tmin和sigma churn会影响。Euler采样器是最简单、最快速的一种选择。它可以在较短的时间内生成图像,但可能缺少多样性。如果你对运行时间有严格的要求,或者你只需要一个大致的结果,那么选择Euler采样器是个不错的选择。

Euler a

使用了祖先采样(Ancestral sampling)的Euler方法受采样器设置中的eta参数影响。Euler a采样器相较于Euler更具多样性,可以以较少的步数产生很大的变化。不同步数可能会产生不同的结果。但需要注意的是,太高的步数(超过30)并不一定能带来更好的效果。如果你希望在较短的步数内获得多样性,Euler a采样器是一个值得尝试的选择。LMS

线性多步调度器(Linear multistep scheduler)源于K-diffusion。

heun

基于Karras论文,在K-diffusion实现受采样器设置页面中的 sigma参数影响。

DPM2

Katherine Crowson在K-diffusion实现受采样器设置页面中的 sigma参数影响。

DPM2 a

使用了祖先采样(Ancestral sampling)的DPM2方法受采样器设置中的ETA参数影响。

DPM++ 2S a

基于Cheng Lu等人的论文,在K-diffusion实现的2阶单步并使用了祖先采样(Ancestral sampling)的方法。受采样器设置中的eta参数影响Cheng Lu的github]https://github.com/LuChengTHU/dpm-solver)中也提供已经实现的代码,并且可以自定义,1、2、3阶,和单步多步的选择webui使用的是K-diffusion中已经固定好的版本。

DPM++ 2M

基于Cheng Lu等人的论文的论文,在K-diffusion实现的2阶多步采样方法,被社区玩家称为最强采样器,速度和质量平衡优秀比上方版本更优秀也更复杂。DPM++ SDE

基于Cheng Lu等人的论文的,DPM++的SDE版本(随机微分方程),DPM++原本是ODE(常微分方程)在K-diffusion实现的版本中调用了祖先采样(Ancestral sampling)方法,所以受采样器设置中的ETA参数影响。

DPM fast

基于Cheng Lu等人的论文,在K-diffusion实现的固定步长采样方法,用于steps小于20的情况

受采样器设置中的ETA参数影响。

DPM adaptive

基于Cheng Lu等人的论文,在K-diffusion实现的自适应步长采样方法。受采样器设置中的ETA参数影响。

LMS Karras

基于Karras论文,运用了相关Karras的noise schedule的方法,可以算作是LMS使用Karras noise schedule的版本。LMS采样器是Euler的衍生版本,使用了一种相关但稍有不同的方法,即平均过去的几个步骤以提高准确性。大约30步可以得到稳定的结果。如果你对图像的准确性有较高的要求,可以考虑使用LMS采样器。

DDIM

随latent diffusion的最初repository一起出现, 基于Jiaming Song等人的论文目前最容易被当作对比对象的采样方法在采样器设置界面有自己的ETA PLMS元老级,随latent diffusion的最初repository一起出现。DDIM采样器收敛速度较快,但相对而言效率较低。它需要较多的步数才能获得较好的结果,因此更适合用于重绘时的使用。如果你希望在纠正错误或调整提示词时进行迭代绘制,DDIM是一个可靠的选择。UniPC(推荐使用)

目前最新采样器,基于Wenliang Zhao等人)的论文,理论上目前最快采样器,10步即可获得高质量结果,UniPC采样器是效果较好且速度非常快的一种选择。它在平面、卡通风格的图像表现方面较为突出。如果你希望快速生成具有良好效果的图像,尤其是针对平面和卡通风格的创作,强烈推荐使用UniPC采样器。

这里我推荐使用【UniPC】还是不错的。

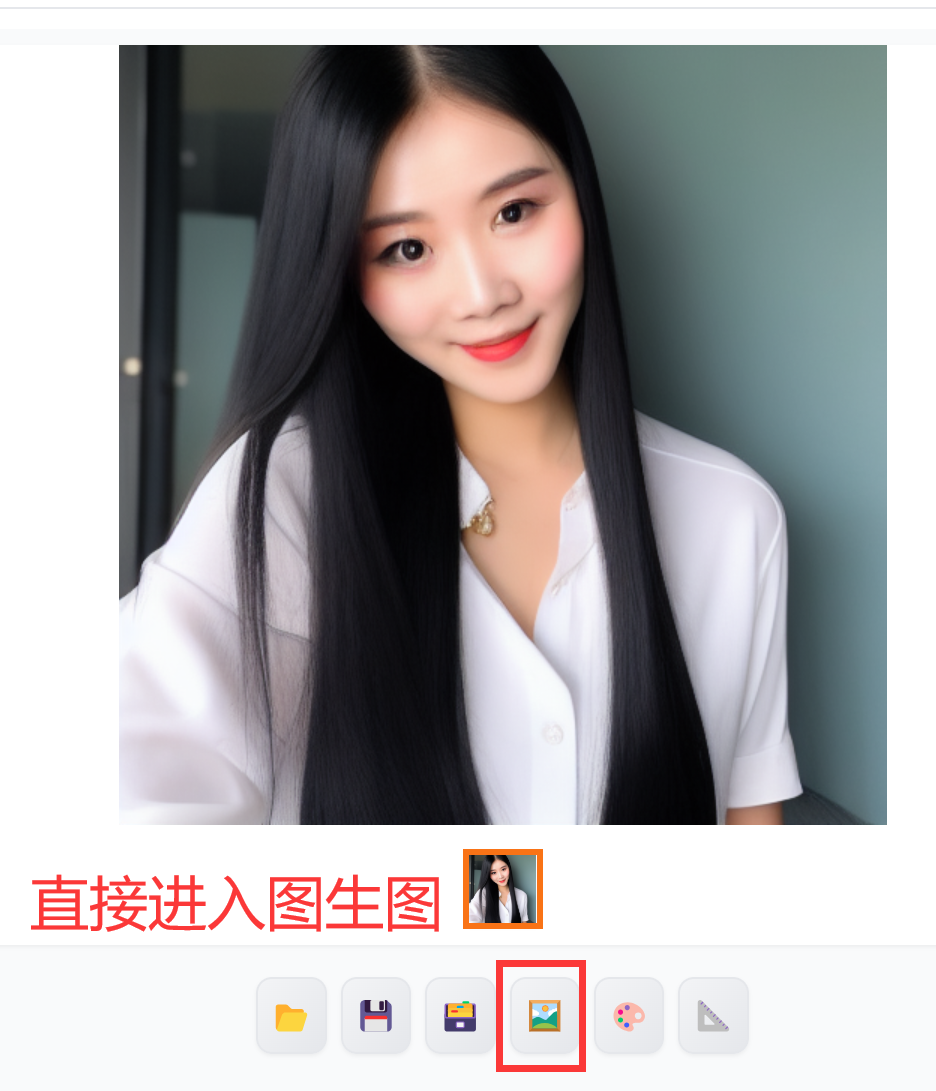

人像生成

正向提示词:

Star face, long black hair, beauty, wearing a white shirt, upper body frontal photo, ultra-clear, cute, lolita, natural black pupils, bright eyes, Chinese style, well-proportioned, regular facial features, no stretching, first love, light blue Color background, tie, campus, desks and chairs, school uniform, long hair to waist, smile, dimples

对照中文:

明星脸,乌黑长发,美女,穿白色衬衫,上身正面照,超清,可爱,萝莉,自然黑色瞳孔,有神的眼睛,国风,匀称,五官端正,无拉伸,初恋,浅蓝色背景,领带,校园,桌椅,校服,长发及腰,微笑,酒窝

反向提示词:

(semi-realistic, cgi, 3d, render, sketch, cartoon, drawing, anime:1.4), text, close up, cropped, out of frame, worst quality, low quality, jpeg artifacts, pgly, duplicate, morbid, mutilated, extra fingers, mutated hands, poorly drawn hands, poorly drawn face, mutation, deformed, blurry, dehydrated, bad anatomy, bad proportions, extra limbs, cloned face, disfigured, gross proportions, malformed limbs, missing arms, missing legs, extra arms, extra legs, fused fingers, too many fingers, long neck

中文对照:

(半写实、cgi、3d、渲染、草图、卡通、绘画、动漫:1.4)、文本、特写、裁剪、出框、最差质量、低质量、jpeg 伪影、pgly、重复、病态、残缺、额外的手指、变异的手、画得不好的手、画得不好的脸、突变、变形、模糊、脱水、不良的解剖结构、不良的比例、额外的肢体、克隆的脸、毁容、总体比例、畸形的四肢、缺失的手臂、缺失的腿、额外的手臂、多余的腿、融合的手指、太多的手指、长脖子

生成图片效果:(还算OK的姑娘,一会我们可以多seed微调一下)

稍微微调一下(可以再下方找到微调方法)

水光效果

效果图:

正向提示词:

ball of water suspended in the air, ripples and splash on surface, sunlight gleaming, with sparkling crisp radiant reflections, Canon 35mm lens, hyperrealistic photography, style of unsplash

反向提示词:

word,error,cropped,worst quality,low quality,artifacts,signature,username,blurry,mutation,(duplicate:1.4),blurry,watermark, water-marked ,Signature,sketches,easynegative,border, blurry,depth of field, blurry background, empty picture frame, photo frames,(Object deformation:1.4),Retro style

采样器以及其它参数:

生成效果:

微调的使用

【腾讯云 HAI域探秘】——Stable Diffusion预装环境生成AIGC图片——必会技能【微调】

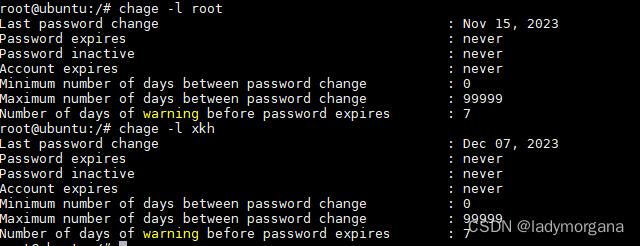

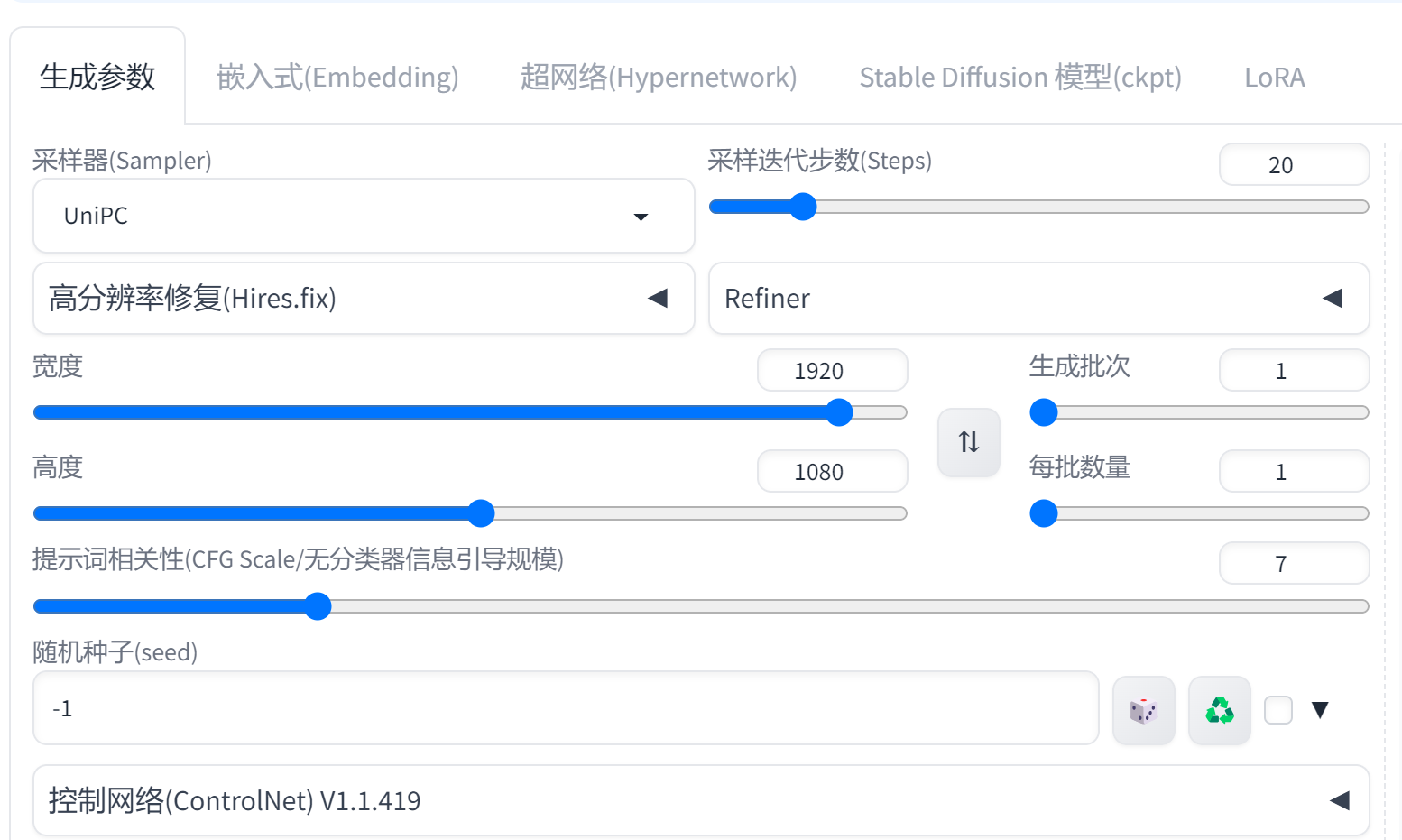

图像生成种子/seed使用

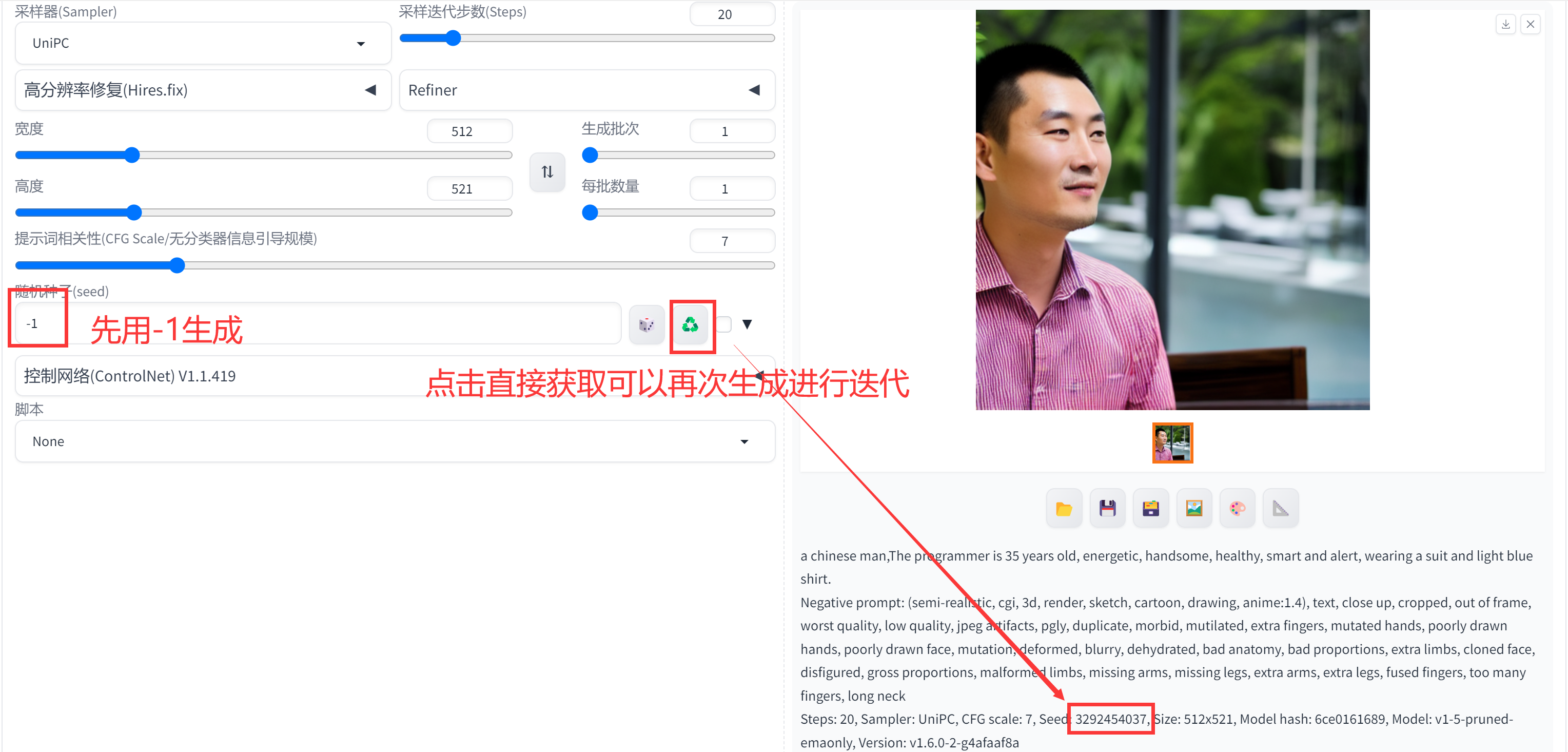

用于图像的微调,用大图不方便,我换成512*512的再测试一下,提示词变成生成人物。

正向提示词:

a chinese man,The programmer is 35 years old, energetic, handsome, healthy, smart and alert, wearing a suit and light blue shirt.

反向提示词:

(semi-realistic, cgi, 3d, render, sketch, cartoon, drawing, anime:1.4), text, close up, cropped, out of frame, worst quality, low quality, jpeg artifacts, pgly, duplicate, morbid, mutilated, extra fingers, mutated hands, poorly drawn hands, poorly drawn face, mutation, deformed, blurry, dehydrated, bad anatomy, bad proportions, extra limbs, cloned face, disfigured, gross proportions, malformed limbs, missing arms, missing legs, extra arms, extra legs, fused fingers, too many fingers, long neck

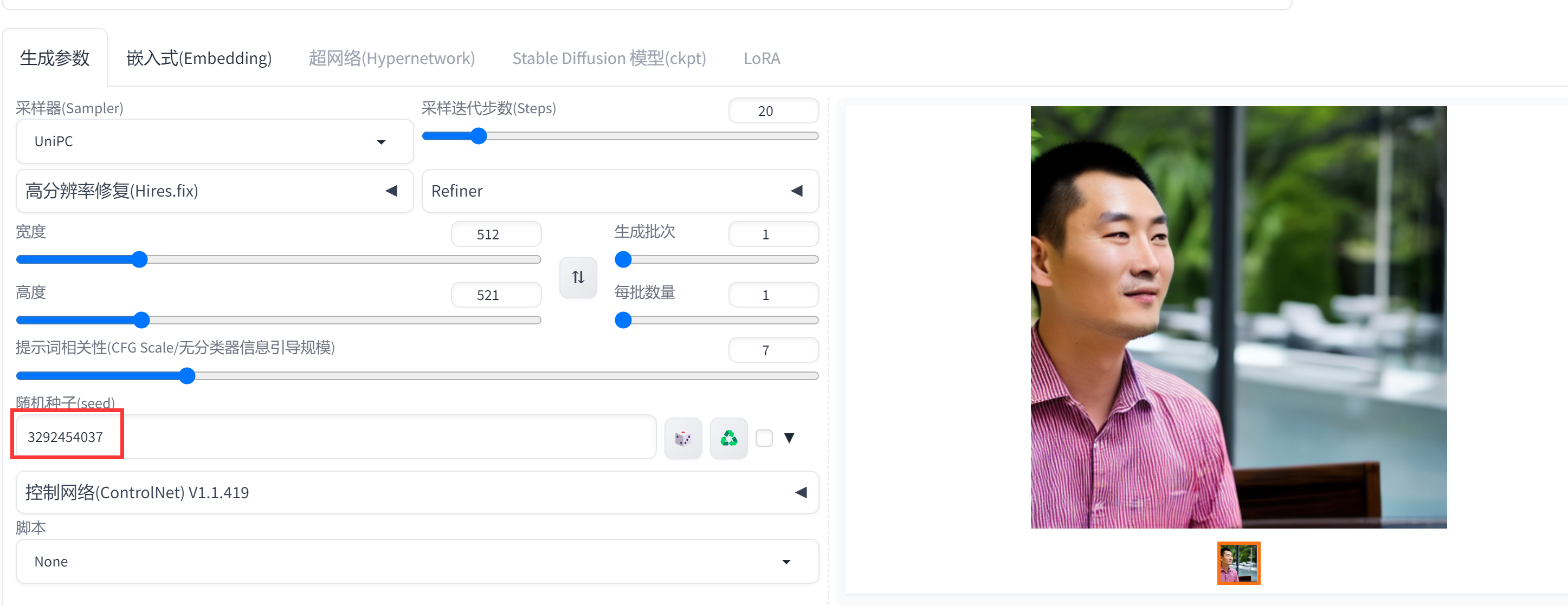

这里可以看到seed了,我们就再生成一次。

这是根据Seed再次生成的效果(看不到多大效果,因为我们没有附加处理):

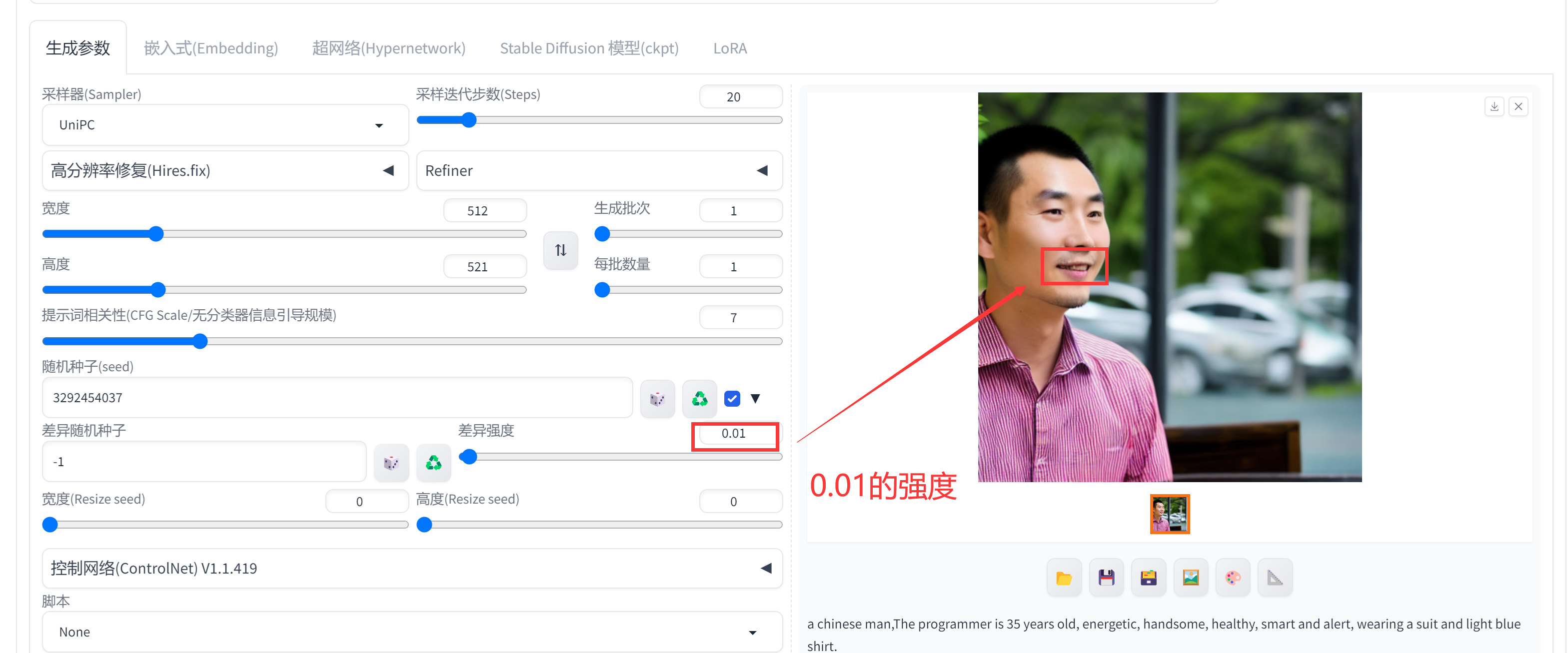

附加/Extra

这里的差异随机种子和随机种子一样,差异强度别多了,一点点调整。

看看0.01的强度变化。

微调0.05

改变差异随机种子

微调实例测试

我们先来描绘一张非常漂亮的图片。使用【UniPC】生成时间太长,这里采样器换一下,更换成【Euler a】,效率会高些,但是质量会弱一些。多来几次。总会有好的。

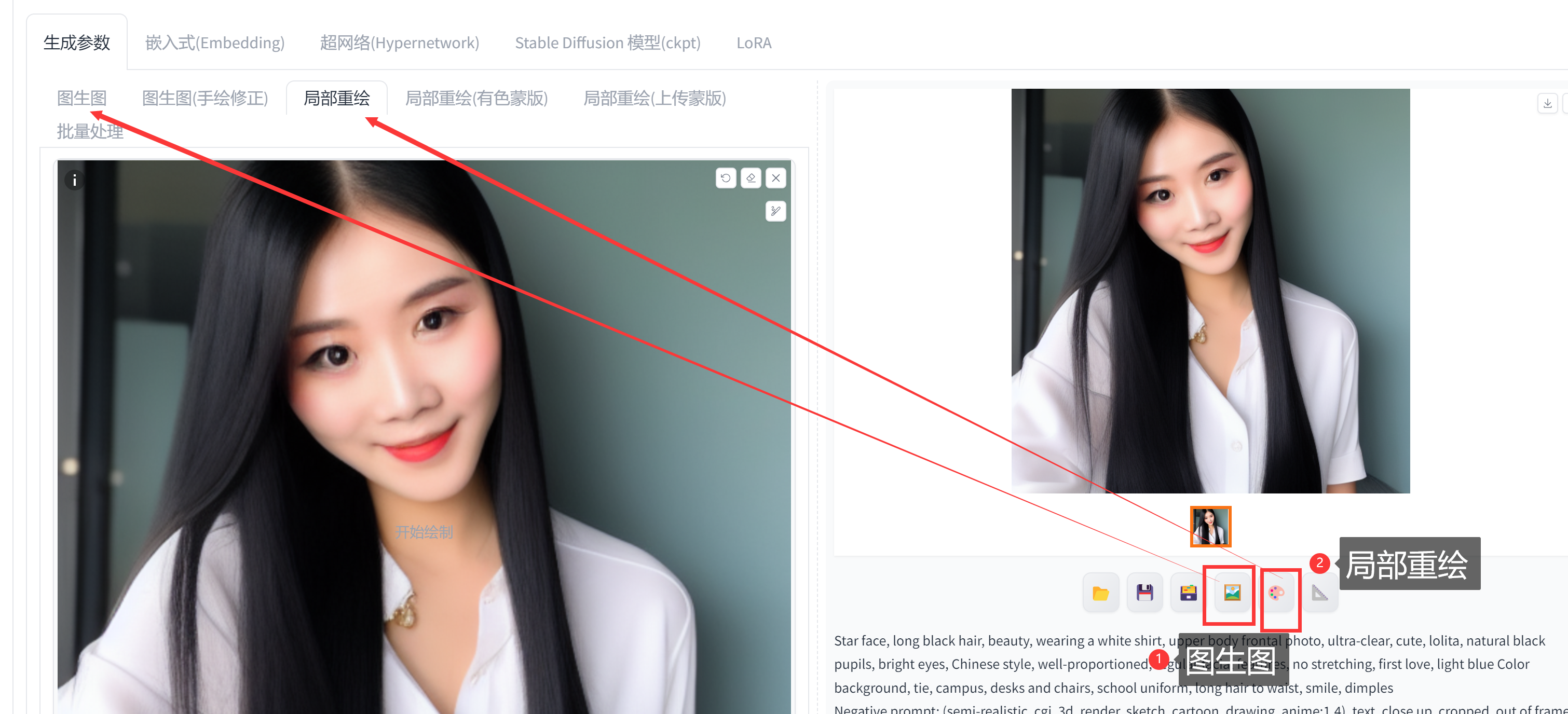

图生图微调

有的时候生成的还是比较满意的,但是就优点瑕疵,例如上图领口有一个饰品,我想换一下,就可以使用图生图的微调。

使用蒙版微调

注意修改一下参数。

使用画笔绘制要微调的位置

多生成几次就能看到一个想要的结果了

好的,到此,美丽的小姐姐就呈现出来了,爱你呦。