继今年春天发布 GPT-4 之后,OpenAI 又创造了一个不眠夜。

过去一年,ChatGPT 绝对是整个科技领域最热的词汇。

北京时间 11 月 7 日凌晨 02:00,OpenAI 的首次 DevDay 开发者日活动正式开始。Keynote 主论坛环节由 Sam Altman 主讲并在油管现场直播,配合现场的演示,展示了多款新产品的发布,整整 45 分钟,内容紧凑而真诚。我完完整整看了这个45分钟的主题演讲视频,内容非常丰富,下面我来帮大家梳理一下其中值得关注的信息, 亮点摘要【全是重点】:

-

GPT4 支持 128k 上下文。

-

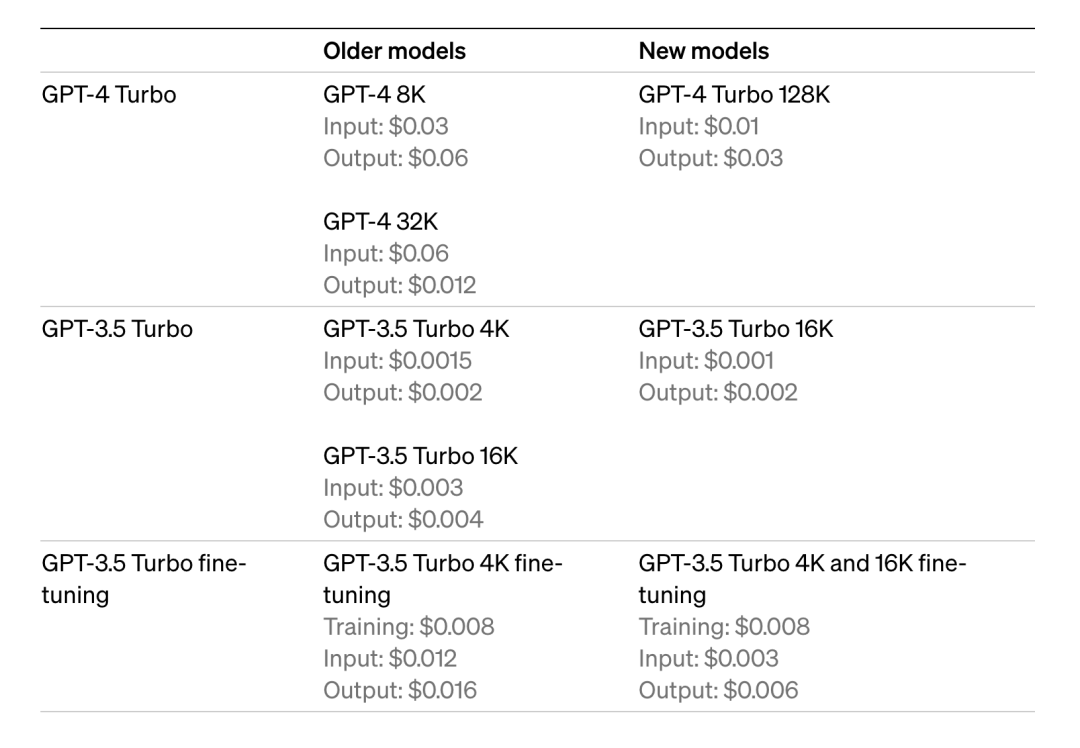

新 GPT 只需要 1/3 的价格。

-

定制化 GPT & GPTs 应用商店。

-

GPT4 打通联网模式、插件模式、代码执行模式、Dall-E模型。

-

GPT 新增 log probability 输出。

-

新增 json 格式支持。

作为备受期待的首届开发者大会,Altman 这次给我们带来了一系列全新的 AI 模型和工具,包括如下:

- 全新的 GPT-4 Turbo 模型

- 更可控的输出:函数调用增强、JSON 模式

- 开放新的 API:DALLE-3、GPT-4 Turbo with vision、TTS 和 Whisper V3

- GPT-4 微调、自定义模型

- GPTs:创建自定义版本的 ChatGPT

- GPT Store 即将上线

- Assistants API:更接近 AI 智能体的体验

一、GPT-4 Turbo 正式发布,支持 128k 上下文窗口

今日发布的 GPT-4 Turbo,最大的改动在于知识库的更新截至 2023 年 4 月,相较于过往版本只收录了 2021 年 9 月前的世界知识,GPT-4 Turbo 拥有了更新的知识库。

另外就是 GPT-4 Turbo 支持 128k 上下文窗口,相当于 300 多页文本的内容。Altman 还强调本次优化模型性能后,与 GPT-4 相比还能够极大地压缩 Token 的使用成本。

GPT-4 Turbo 还加入了 JSON 模式,这确保模型将使用有效的 JSON 进行响应。新的 API 参数 response_format 使模型能够限制其输出,以生成语法正确的 JSON 对象。JSON 模式对于开发者在函数调用之外,在对话窗口就能完成 API 中生成 JSON。

此前网络中一直传言将在本次开发者日上正式发布 GPT-5,最终只见证了 GPT-4 Turbo 的到来。虽然不能消除开发者们对 GPT-5 不能及时发布的遗憾,但是也能感受到 OpenAI 在重大版本发布上的谨慎与克制。

二、GPT 商店即将上线:OpenAI 的生态野心

科技圈常常将 ChatGPT 出现,类比于苹果发布 iPhone 这类跨时代重大事件。在这次发布会的 GPTs 这部分,就能够感受到 OpenAI 想通过模型技术建立更大生态的雄心壮志。

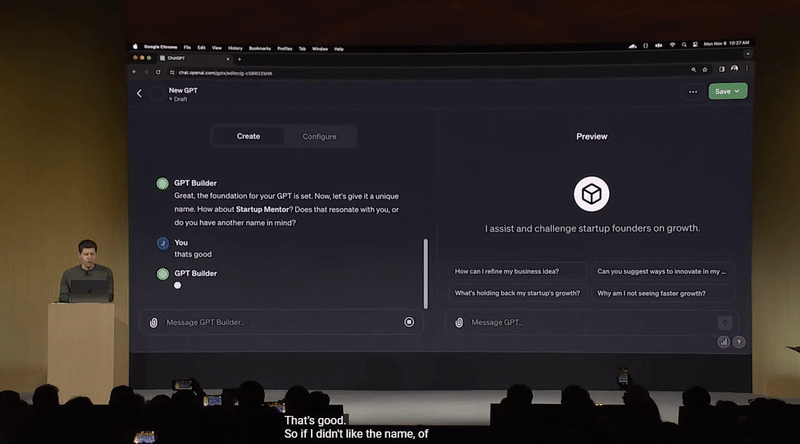

根据 Sam Altman 的解释,GPTs 是针对特定目的进行自定义的 ChatGPT 版本,无需任何写代码的经验,完全靠自然语言的输入,就可以创造出属于自己的 GPTs。现场 OpenAI 提供了自定义 GPT 示例:Canva 和 ZapierAI ,通过非常简单的交互,就可以实现自定义 GPT 的生成。

目前部分自定义 GPT 已经支持 ChatGPT Plus 和企业用户试用。

除了在主论坛环节详细介绍 GPTs 生态之外,OpenAI 已经在官网上发布了博客文章,详细介绍 GPTs 的特性与设计理念。在官方发布的一段视频,展示了如何使用一个宠物医生 GPT 来解决狗狗日常护理的问题。

目前已经有 Amgen、Bain、and Square 等几家公司,已经开始使用 GPT 提供的 自定义 GPT 进入业务,预计将在近期向 API 用户和企业客户端用户全面开放。

同时,在本月晚些时候,OpenAI 将会推出 GPT 商店功能,主要用于分享用户构建的自定义 GPT 助手。

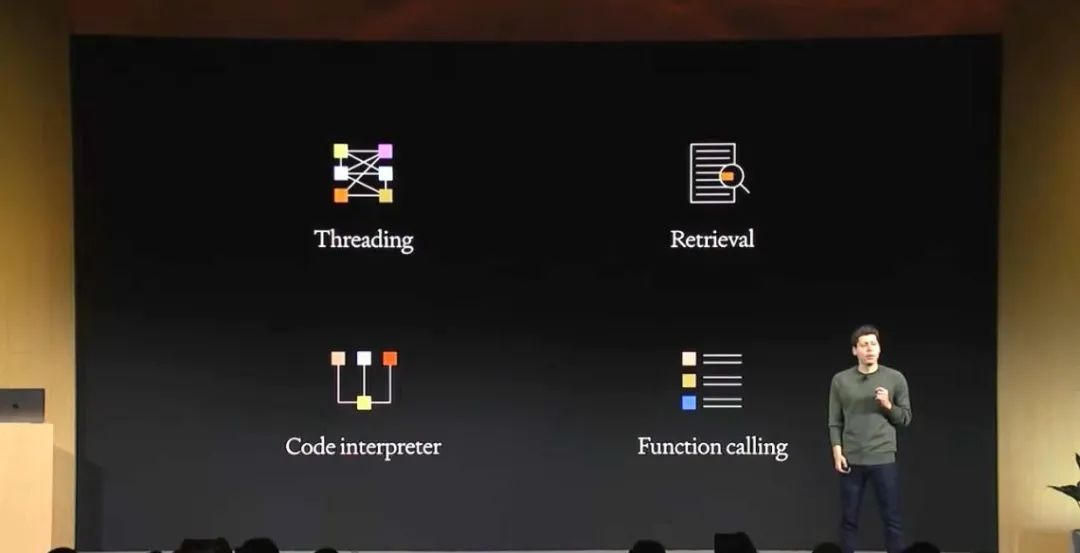

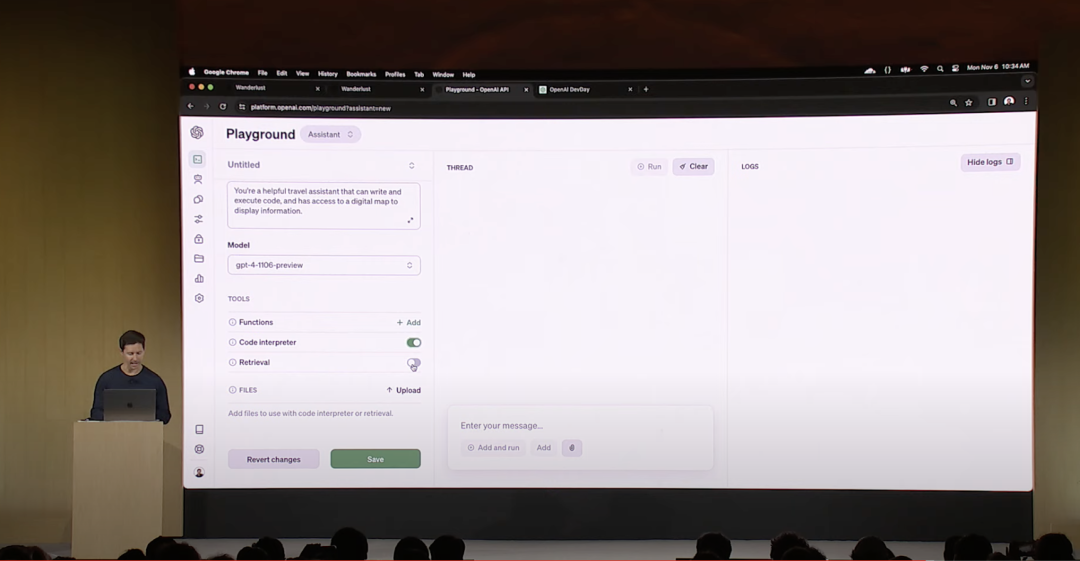

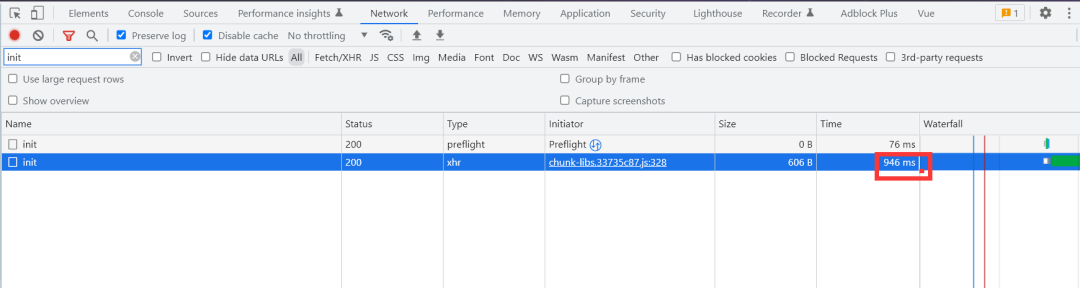

三、Assistants API:Agent 第一步

Assistants API 是帮助开发者在自己的程序中构建 Agent 的第一步,是一种专门构建的人工智能产品,具有特定的指令,利用额外的知识,并且可以调用模型和工具来执行任务。新的 Assistants API 提供了代码解释器和检索以及函数调用等新功能,可以处理你以前必须自己完成的大量繁重工作,并使你能够构建高质量的 AI 应用程序。

代码解释器:在沙盒执行环境中编写和运行 Python 代码,可以生成图形和图表,并处理具有不同数据和格式的文件。它允许开发者迭代运行代码来解决复杂的代码和数学问题等等。

检索:利用模型之外的知识来增强助手,例如专有领域数据、产品信息或用户提供的文档。这意味着开发者不需要计算和存储文档的嵌入,或实现分块和搜索算法。Assistants API 根据在 ChatGPT 中构建知识检索的经验,优化了要使用的检索技术。

函数调用:使助手能够调用你定义的函数并将函数响应合并到其消息中。

目前可以前往 Assistants Playground 来尝试 Assistants API Beta 版。

开发者可以前往 Assistants playground 试用 Assistants API 测试版,无需编写任何代码:https://platform.openai.com/playground?mode=assistant

四、多模态能力,持续推进、全面开花

多模态作为当前模型团队重点关注和发展的技术,开发者可以通过文本转语音 API 从文本生成人类质量的语音。

开发者可以通过图像 API 将 DALL·E 3直接集成到他们的应用程序和产品中,并将 DALL·E-3 指定为模型。目前 Snap、可口可乐和 Shutterstock 等公司已使用 DALL·E 3 为其客户和活动生成图像和设计的服务。

图片

与之前版本的 DALL·E 类似,该 API 包含内置审核功能,可帮助开发人员保护其应用程序免遭滥用。目前提供不同的格式和质量选项,每生成一张图像的起价为 0.04 美元,可以查看 API 中的 DALL·E 3 入门指南。

GPT-4 Turbo with vision,开发者可以通过 API 中的 gpt-4-vision-preview 来访问。OpenAI 计划为主要的 GPT-4 Turbo 模型提供视觉支持,价格取决于输入图像的大小,例如像素 1080×1080 的图像需要的成本为 0.00765 美元。

五、其他更新

Copyright Shield

OpenAI 表示,他们致力于通过系统中的内置版权保护措施来保护客户,所以推出了新的版权保障措施 ——Copyright Shield。如果你面临有关版权侵权的法律索赔,他们将介入并保护客户,并支付由此产生的费用。这适用于 ChatGPT 企业版和我们的开发者平台的一般可用功能。

Whisper v3 和 Consistency Decoder

Whisper 是 OpenAI 开源的一款语音转文本模型。在这次开发者大会上,Altman 官宣了新版本 Whisper large-v3,其特点是提高了各种语言的识别性能。他们还计划在不久的将来在 API 中支持 Whisper v3。

内容参考:

发布会回放:https://www.youtube.com/watch?v=U9mJuUkhUzk

DevDay:https://openai.com/blog/new-models-and-developer-products-announced-at-devday

GPTs:https://openai.com/blog/introducing-gpts

特邀现场观察团:Keven Liu

500px: https://500px.com/rongxinliu

Github: https://github.com/rongxin-liu

注:内容来自于网络,侵删!

![[HTML]Web前端开发技术1,meta,HBuilder等——喵喵画网页](https://img-blog.csdnimg.cn/b7a382b2692248c2a83227ad0bbe8160.png)