ResNet: Deep Residual Learning for Image Recognition(CVPR 2015)

news2026/2/12 23:22:18

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/1124470.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

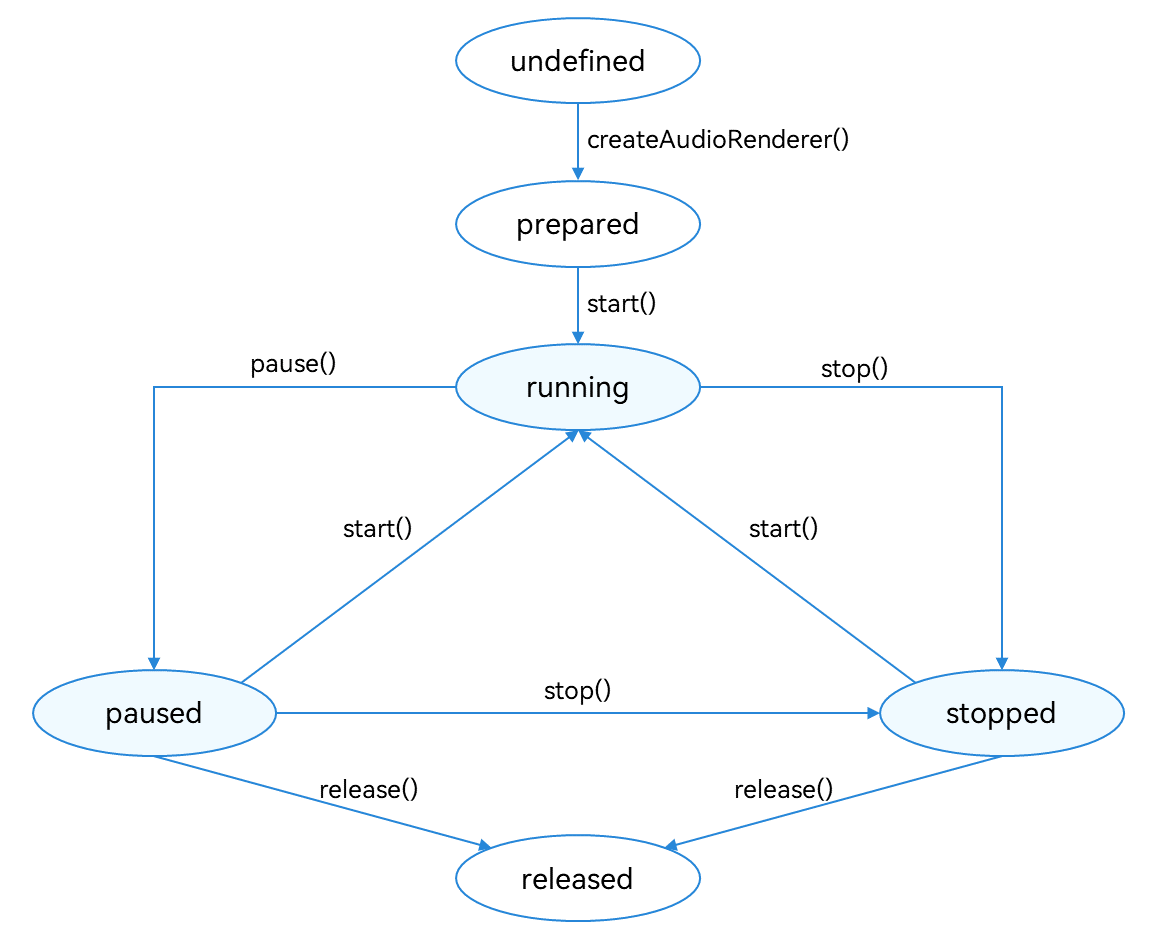

HarmonyOS 音频开发指导:使用 AudioRenderer 开发音频播放功能

AudioRenderer 是音频渲染器,用于播放 PCM(Pulse Code Modulation)音频数据,相比 AVPlayer 而言,可以在输入前添加数据预处理,更适合有音频开发经验的开发者,以实现更灵活的播放功能。

开发指导…

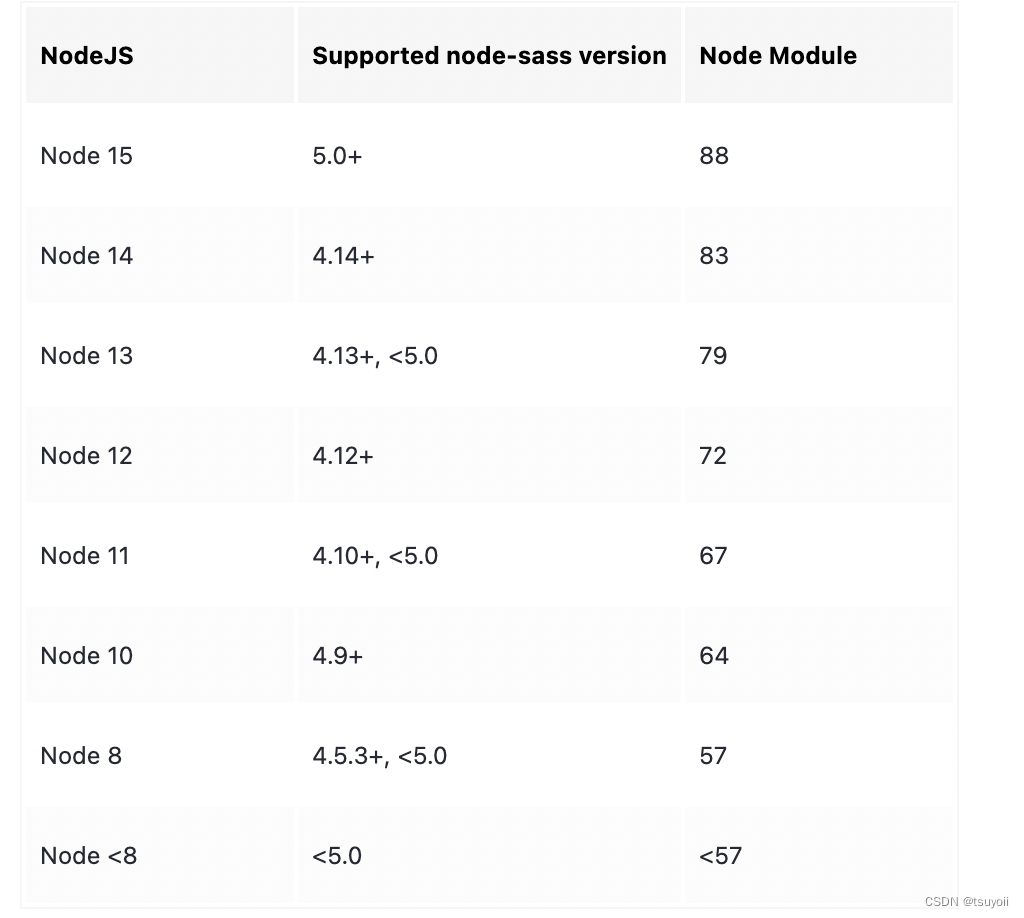

node-sass安装报错

node-sass安装竟然报了python的错

先说最终解决方案 将node换成14版本

声明:个人总结,思路到哪写到哪,不喜请轻喷😂

参考 https://blog.csdn.net/ccm_2354586864

可恶的node-sass让我不得不在周末自愿加班😠

我的…

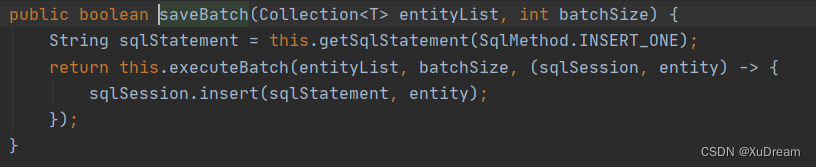

优化mybatisPlus批量新增,新增mapper层批量新增方法,附带代码生成vm模板。

文章目录 一、主题二、效果展示三、mybatis-plus源码分析四、优化思路五、代码优化方法一:修改批量新增SQL方法二:使用insertBatchSomeColumn 方法 一、主题 经发现,mybatisPlus只有Service中存在saveBatch()方法,而Mapper中不存在…

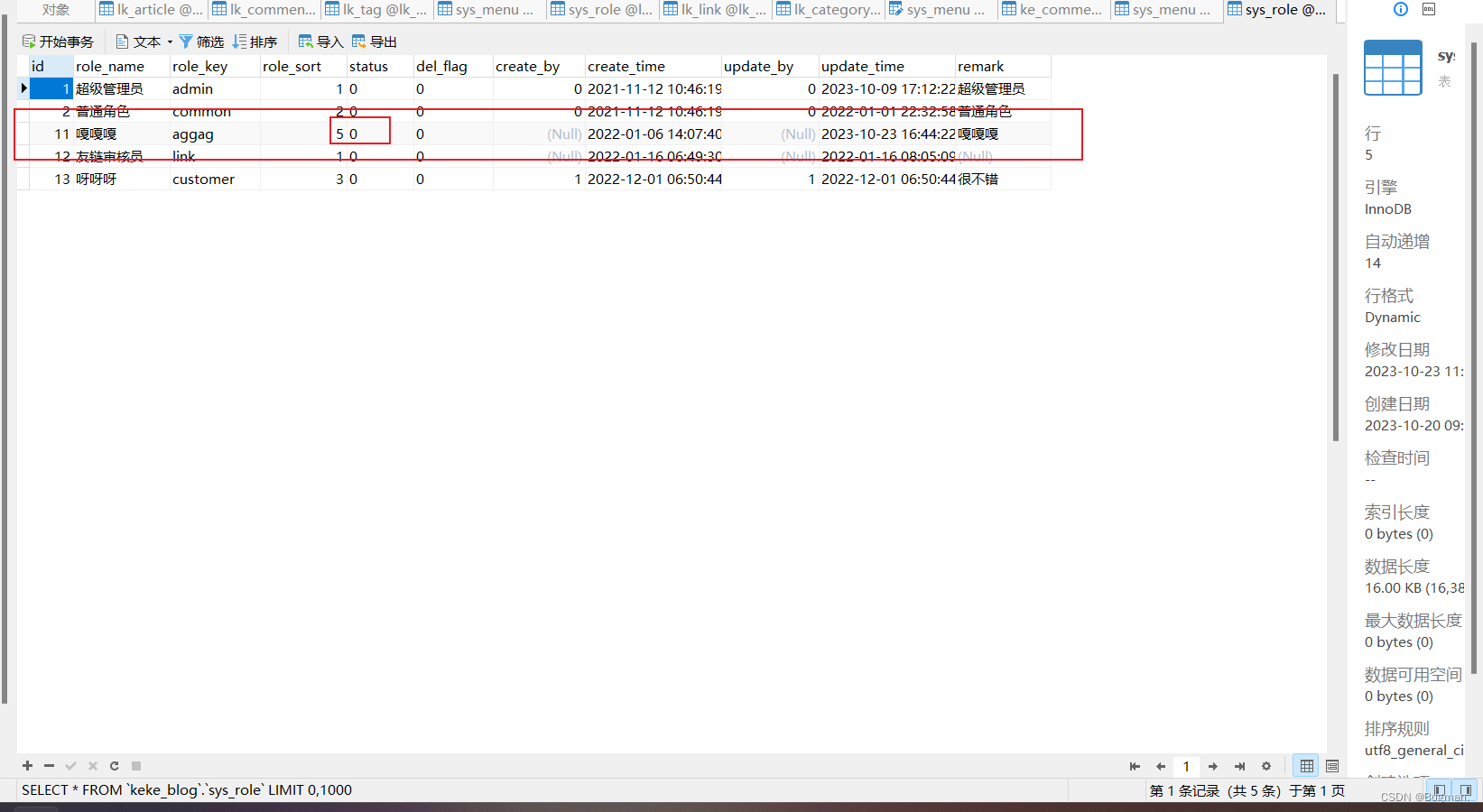

博客后台模块续更(五)

十一、后台模块-菜单列表

菜单指的是权限菜单,也就是一堆权限字符串

1. 查询菜单

1.1 接口分析

需要展示菜单列表,不需要分页。可以针对菜单名进行模糊查询。也可以针对菜单的状态进行查询。菜单要按照父菜单id和orderNum进行排序 请求方式 请求路径…

从0开始学云计算之服务器:服务的定义,特点,应用场景,分类

服务器定义 服务器是计算机的一种。它比普通计算机运行速度更快、负载更高且价格更高。 服务器的英文名称为“Server”,是指在网络上提供各种服务的高性能计算机。作为网络的节点,存储、处理网络上80%的数据、信息,因此也被称为x络的灵魂。

…

三、机器学习基础知识:Python常用机器学习库(Pandas)

文章目录 1、Pandas2、Series数据结构2.1 Series的创建2.2 Series的索引与访问2.3 Series的常见操作 3、DataFrame对象3.1 DataFrame的创建与索引3.2 DataFrame的访问3.3 DataFrame的常见操作 4、数据对齐5、缺失数据处理6、Pandas存取文件 1、Pandas

Pandas 库是以Numpy库为基…

互联网医院牌照|互联网医院牌照资质申请流程和所需材料

那么不同的企业基于不同的业务板块,所需要搭建的互联网医院也存在差异,平衡好自身业务及互联网医疗建设二者间的关系,是企业建设互医的基础需求,那么互联网医院牌照办理流程和材料都包含哪些呢?接下来就给大家介绍下。…

短视频矩阵系统软件源码

短视频矩阵系统软件源码 视频成为获得免费流量最便宜的渠道,平台给所有视频最基础的保底流量。如果按照一个视频最低500流量计算,5个账户就是2500的流量,200个视频就是50W流量,如果从其他渠道获得50W流量是个很困难的事情。短视频…

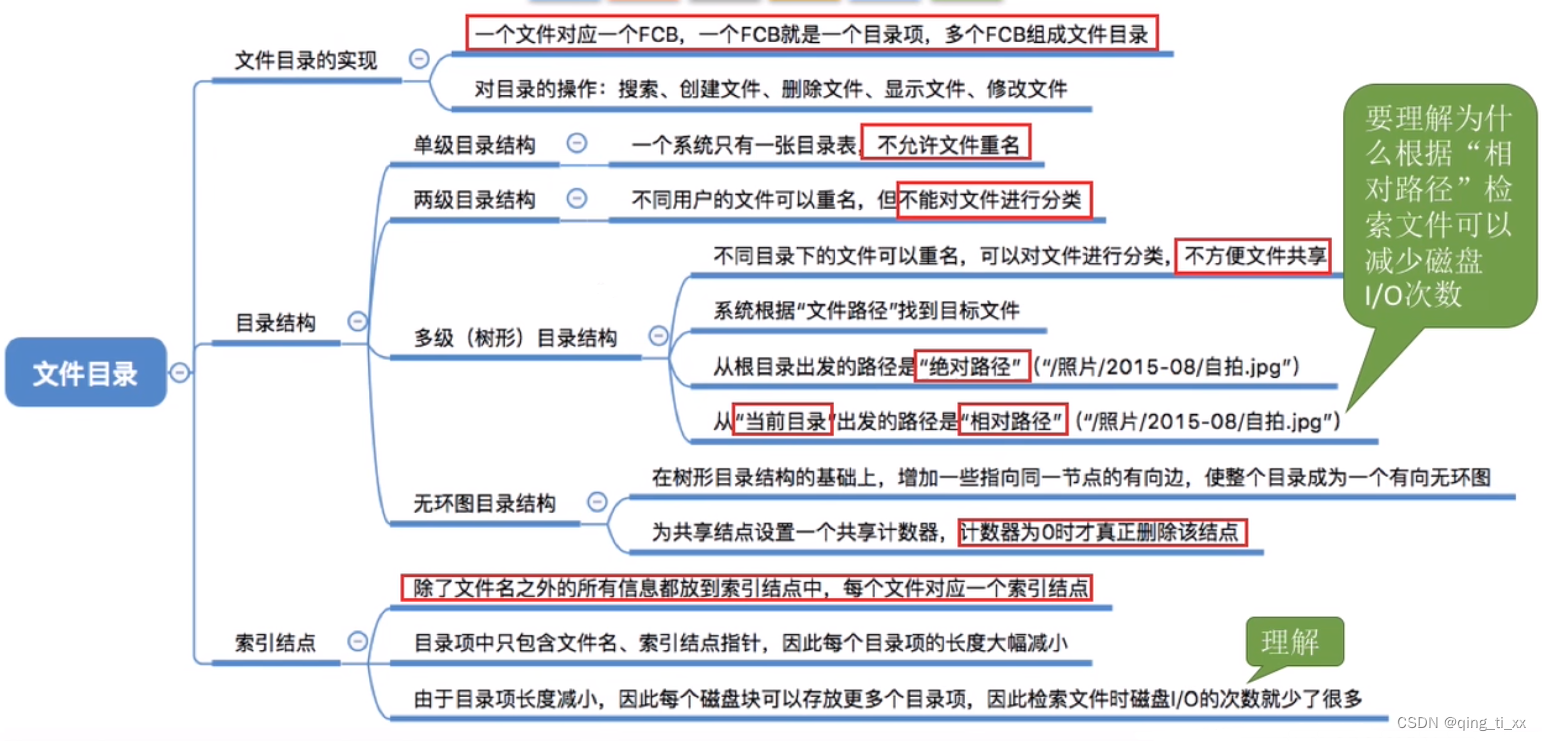

第四章 文件管理 三、文件目录

目录 一、文件控制块

1、定义:

2、要进行哪些操作

(1)搜索:

(2)创建文件:

(3)删除文件:

(4)显示目录:

(5)修改目录:

二、目录结构

1、单…

QSOP24封装的语音芯片优势列举

1. 封装紧凑:QSOP24封装采用了更小的封装尺寸,相比于其他大型封装,它的体积更小、尺寸更紧凑。这使得它在空间受限的应用中更加适用,可以方便地集成到小型或薄型设备中,提供更高的设计灵活性。

2. 强大的功能…

Go之流程控制大全: 细节、示例与最佳实践

引言

在计算机编程中,流程控制是核心的组成部分,它决定了程序应该如何根据给定的情况执行或决策。以下是Go语言所支持的流程控制结构的简要概览:

流程控制类型代码if-else条件分支if condition { } else { }for循环for initialization; con…

el-table相同的值合并单元格+多级表头

<el-table border :data"costList" :span-method"objectSpanMethod" ><el-table-column label"类别" prop"类别" width"120"> </el-table-column><el-table-column label"费用科目" prop&qu…

如何给照片添加水印?请看下面3个简单教程

如何给照片添加水印?随着智能手机的普及和不断提升的拍摄技术,如今人们可以轻松使用手机进行高质量的照片拍摄。从老人到小孩,每个人都可以在日常生活中捕捉到美好瞬间,并将其记录下来。作为一种表达自己的方式,现在手…

重拾潜行初心,用艾尔莎EA B760M-E D5玩转《刺客信条:幻景》

不知不觉,《刺客信条》系列游戏已经推出了有近20部作品。为了体现游戏的差异化,育碧经常会在新作上进行不同程度的玩法修改,然而在多部作品的变化与改动以后,许多玩家已经开始出现了审美疲劳,并怀念起了初代经典而纯粹…

2018年亚太杯APMCM数学建模大赛A题老年人平衡能力的实时训练模型求解全过程文档及程序

2018年亚太杯APMCM数学建模大赛

A题 老年人平衡能力的实时训练模型

原题再现 跌倒在老年人中很常见。跌倒可能会导致老年人出现许多并发症,因为他们的康复能力通常较差,因此副作用可能会使人衰弱,从而加速身体衰竭。此外,对跌倒…

深度分析微软未来十年在AI领域的投资机会

来源:猛兽财经 作者:猛兽财经 总结: (1)人工智能不仅仅是一个概念,还是一场旨在提高生产率的技术革命,并且有可能在未来十年让全球GDP增长10%。 (2)由于庞大的用户规模&…

数字化转型“黑话”知多少?一文让你不仅听得懂、还会落地执行

何为OEE?如何提升OEE?

从上图可知,客户是机加工行业的,而机加工行业属于重资产行业,主要以设备生产为主,管好设备、提升设备的综合效率(OEE)。效率高了,毛利率自然也会增…

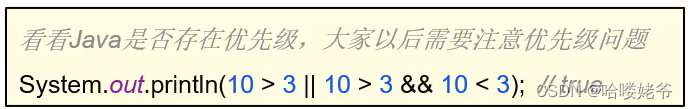

java--三元运算符、运算符的优先级

1.三元运算符介绍

1.格式:条件表达式?值1:值2;

2.执行流程:首先计算关系表达式的值,如果值为true,返回值1,如果为false,返回值2 2.运算符优先级

1.在表达式中…

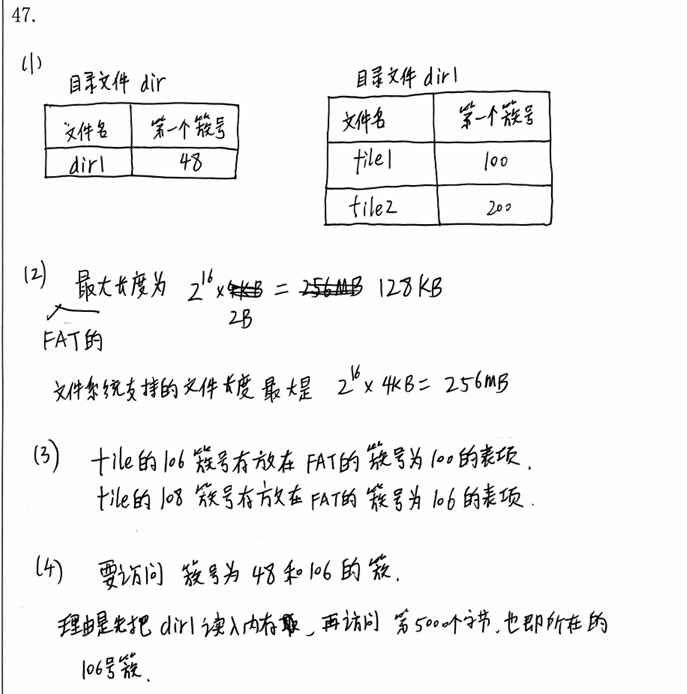

2016年408真题复盘

紫色标记是认为有一定的思维难度或重点总结 红色标记是这次刷真题做错的 记录自己对题目的一些想法与联系,可能并不太关注题目本身。 分数用时 选择部分10/23 78/8044min大题部分10/2361/7076min总分139120min 摘自知乎老哥:“我做历年真题时,…

Unity中Shader的Fallback

文章目录 前言一、解决 Pass 复用的方案方案一:使用之前的UsePass方案,把ShadowCaster的Pass提出来到一个单独的Shader中,在使用的时候直接使用 UsePass方案二:使用Fallback功能 前言

Unity中Shader的Fallback,我们在…