Image fusion in the loop of high-level vision tasks: A semantic-aware real-time infrared and visible image fusion network

(高级视觉任务循环中的图像融合:一种具有语义感知的实时红外与可见光图像融合网络)

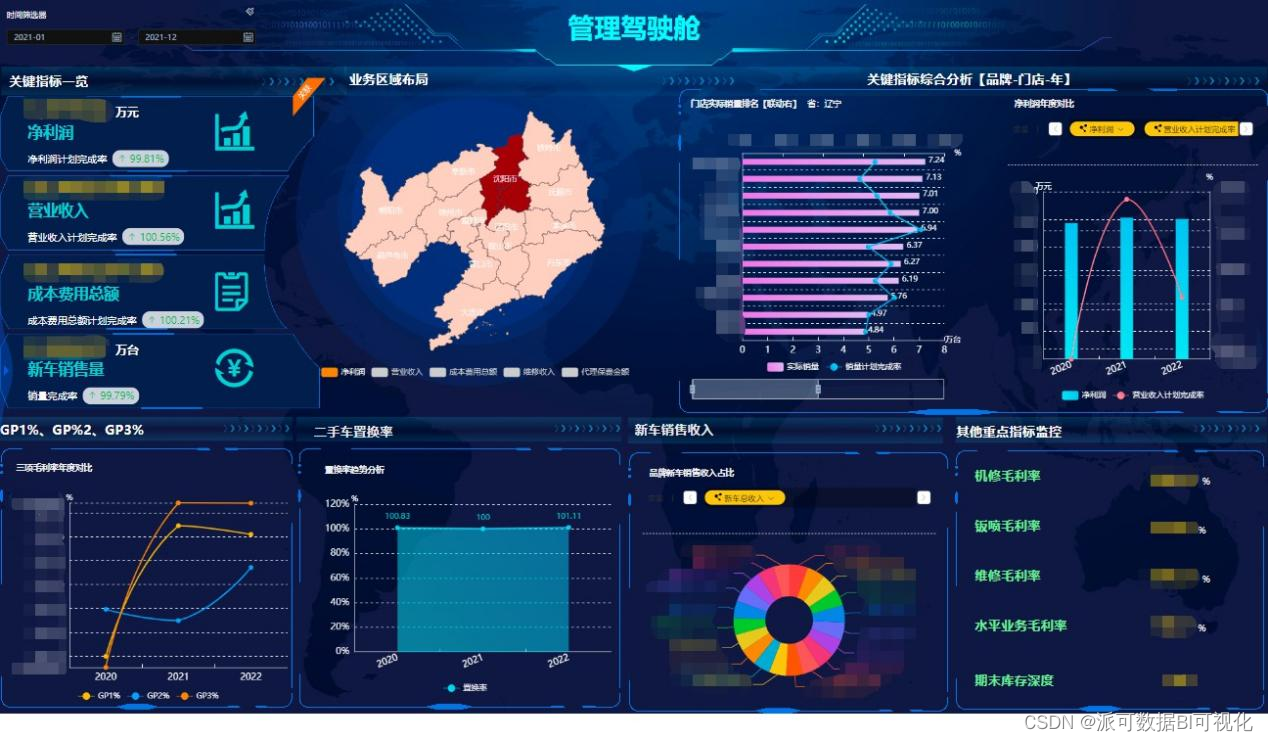

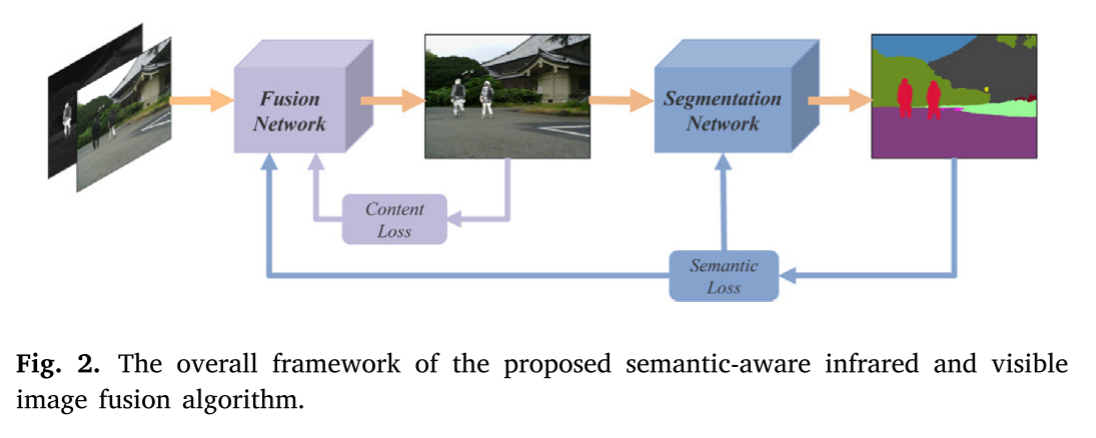

本文提出了一种语义感知的实时图像融合网络(semantic-aware real-time image fusion network (SeAFusion))。一方面,将图像融合模块与语义分割模块级联,利用语义损失引导高层语义信息回流到图像融合模块,有效提高了融合图像的高层视觉任务性能。另一方面,设计了梯度残差密集块(gradient residual dense block,GRDB)来增强融合网络对细粒度空间细节的描述能力。

介绍

对于现存方法的介绍:略

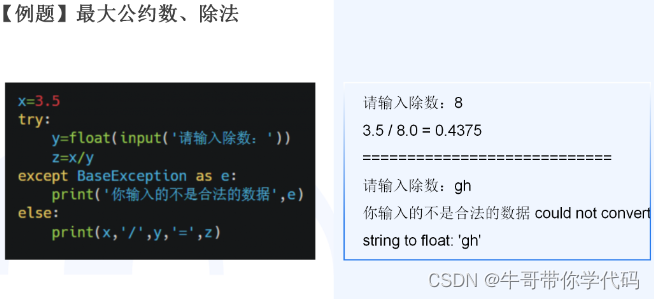

提出了一种基于语义感知的融合网络SeAFusion,用于实现红外和可见光图像的实时融合。该方法的关键是在图像融合和高级视觉任务中同时获得上级的性能。具体地说,我们引入了一个分割网络来预测融合图像的分割结果,并利用它来构造语义损失。然后,利用语义损失指导融合网络的训练,使融合图像包含更多的语义信息。此外,为了满足高级视觉任务的实时性要求,我们开发了一种基于**梯度残差密集块(GRDB)**的轻量级网络。GRDB通过主稠密流实现特征重用,通过剩余梯度流提高对细粒度细节的描述能力。

贡献

1)提出了一种基于语义感知的红外与可见光图像融合框架,该框架在图像融合和高级视觉任务中均具有较好的性能。

2)设计了梯度残差密集块,提高了网络对细粒度细节的描述能力,实现了特征重用。

3)SeAFusion是一种轻量级的实时图像融合模型。这允许将其部署为高级视觉任务的预处理模块。

4)提出一种任务驱动的评价方法,从高级视觉任务的角度评价图像融合的性能。

相关工作

Image fusion algorithms

Traditional image fusion methods

由于特征重构通常是特征提取的逆过程,因此传统图像融合算法的关键在于两个关键要素:特征提取和融合。多尺度分解是特征提取中最常用的变换方案。在过去的几十年里,许多多尺度变换,如拉普拉斯金字塔(LP)、离散小波、shearlet、非下采样轮廓波变换和潜在低秩表示,已经成功地嵌入到基于多尺度变换的图像融合框架中。此外,稀疏表示被用作特征提取技术,其使用过完备字典中的稀疏基来表示源图像。此外,基于子空间的方法也引起了广泛的关注,它将高维图像投影到低维子空间中,以捕捉源图像的内在结构。独立分量分析、主分量分析和非负矩阵分解是基于子空间的融合框架中的代表性方法。

除上述方法外,基于优化的方法为图像融合领域提供了新的视角和前景。特别是Ma等人将红外和可见光图像融合定义为整体强度保持和纹理结构保持,这为基于CNN的方法和基于GAN的方法奠定了坚实的基础。此外,一些研究人员结合了不同框架的优点,提出了混合模型,以追求更好的图像融合性能。特别地,Liu等人通过结合多尺度变换(MST)和稀疏表示(SR)发展了一种通用的图像融合框架,以同时克服基于MST和基于SR的融合方法的固有缺陷。

值得注意的是,日益复杂的变换或表示方法无法满足实时图像融合的需求。此外,手工活动级度量和融合规则活动级度量不能集成语义信息,这将限制融合结果对高级视觉任务的贡献。

基于AE、GAN、CNN的融合方法:略

Task-driven low-level vision algorithms

事实上,已经提出了一些实用的解决方案,将低级算法与高级视觉任务的需求相结合。Li等人设计了一种轻量级去雾网络,称为AOD-Net,它可以很容易地嵌入到其他深度模型中,更快的RCNN,用于改善模糊图像上的高级视觉任务。AODNet是第一个探索去雾算法与高级视觉任务性能之间相关性的工作。随后,Haris等人探索了图像超分辨率如何有助于低分辨率图像中的对象检测。他们开发了一种新颖的超分辨率框架,其中超分辨率子网络在其训练目标中明确地包含检测损失。此外,Liu等人提出了任务驱动的图像去噪方案,该方案将图像去噪和各种高级视觉任务的两个模块级联,并使用联合损失仅更新去噪模型的参数。他们的解决方案可以克服高级视觉任务的性能下降,并在高级视觉信息的指导下生成更具视觉吸引力的结果。近年来,针对自动驾驶领域的实际需求,Guo等人提出了一种新的基于语义精化残差网络和两阶段分割感知联合训练策略的自动驾驶系统建模框架。

本文设计了一种语义感知的红外与可见光图像实时融合框架,以增强融合图像中的语义信息。具体地说,我们首先引入了语义损失的概念,以便在融合图像中融合更多的语义信息。然后,我们量身定做了一个联合的低水平和高水平适应性训练策略,以保持低水平和高水平视觉任务的平衡。最后,我们的融合模型可以生成更具视觉吸引力的融合图像,同时在语义损失的指导下实现高级视觉任务的出色性能。

方法

Problem formulation

给定一对配准后的红外图像𝐼𝑖𝑟∈

R

𝐻

×

𝑊

×

1

R^{𝐻 ×𝑊 ×1}

RH×W×1和可见光图像𝐼𝑣𝑖s∈

R

𝐻

×

𝑊

×

3

R^{𝐻 ×𝑊 ×3}

RH×W×3,在一个定制的损失函数的指导下,通过特征提取、聚合和重构实现图像融合。因此,融合图像的质量𝐼𝑓∈

R

𝐻

×

𝑊

×

3

R^{𝐻 ×𝑊 ×3}

RH×W×3在很大程度上取决于损失函数。为了提高融合性能,设计了一种由内容损失和语义损失组成的联合损失来约束融合网络。我们的语义感知红外和可见光图像融合算法的总体框架如图2所示。

首先,设计了一种基于梯度残差密集块(gradient residual dense block,GRDB)的轻量级融合网络,充分融合源图像中的互补信息。更具体地,我们应用特征提取模块𝐸𝐹从红外和可见光图像中提取具有丰富的细粒度细节信息的深度特征,其可以表示为:

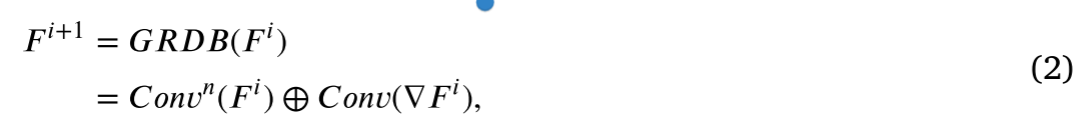

𝐹𝑖𝑟 和 𝐹𝑣𝑖 分别代表红外和可见光特征。此外,在提取高级语义特征的同时,还部署了嵌入在特征提取模块中的GRDB,以提高对细粒度细节的描述能力。给定GRDB的输入

𝐹

𝑖

𝐹^𝑖

Fi,其输出

𝐹

𝑖

+

1

𝐹^{𝑖+1}

Fi+1可表示为:

其中𝐶𝑜𝑛𝑣(·)表示卷积层,𝐶𝑜𝑛𝑣𝑛(·)表示𝑛级联卷积层。▽为梯度算子,即:一种特殊的卷积运算,其卷积核是人工设计的。梯度算子将输入特征与高频卷积核进行卷积,以提取细粒度细节信息。在本研究中,利用著名的Sobel算子来计算梯度大小。此外,⊕表示元素求和。GRDB将可学习的卷积特征与梯度幅度信息聚合在一起。

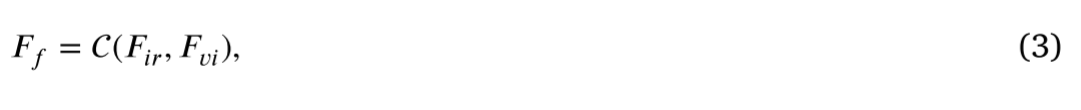

然后,通过特征融合与图像重建模块对融合后的图像进行重建。采用级联融合策略融合深红外和可见光特征,包含丰富的细粒度空间细节。融合过程表示如下:

其中C(·)指的是通道维度中的连接。最后,通过图像重建器𝐼𝑓从融合的特征恢复𝐹𝑓融合的图像R𝐼,其表示为:

此外,充分考虑到高级视觉任务对融合图像的要求,采用语义损失来度量融合图像所包含的语义信息。更具体地说,我们**引入了一个分割模型𝑁𝑠**来对融合图像𝐼𝑓∈

R

𝐻

×

𝑊

×

3

R^{𝐻 ×𝑊 ×3}

RH×W×3执行分割。分割结果𝐼𝑠∈

R

𝐻

×

𝑊

×

𝐶

R^{𝐻 ×𝑊 ×𝐶}

RH×W×C与语义标签𝐿𝑠∈

(

1

,

𝐶

)

𝐻

×

𝑊

(1,𝐶)^{𝐻×𝑊}

(1,C)H×W之间差距可以反映融合图像所包含的语义信息的丰富程度,其中𝐻和𝑊分别为图像的高度和宽度,𝐶表示对象类别的数目。给定融合图像𝐼𝑓,语义感知过程表示为:

分割结果和语义标签之间差距表示为,L𝑠𝑒𝑚𝑎𝑛𝑡𝑖𝑐并定义为:

其中ε(·)表示误差函数。

Loss function

我们的SeAFusion旨在增强融合图像中的语义信息,同时提高视觉质量和评估指标。为了实现这些目标,我们从两个角度设计了损失函数。一方面,SeAFusion需要充分融合源图像中的互补信息,如红外图像中的突出目标和可见光图像中的纹理细节。为此,设计了内容丢失以确保融合图像的视觉保真度。另一方面,融合图像应有效地促进高级视觉任务。为此,我们构造了一个语义损失来反映融合图像对高级视觉任务的贡献程度。

Content loss

为了促进我们的融合模型集成更多有意义的信息,提高视觉质量和量化指标,我们设计了一个内容损失。内容物损失包括两个部分,即,强度损失L𝑖𝑛𝑡和纹理损失L𝑡𝑒𝑥𝑡𝑢𝑟𝑒。内容损失的确切定义表示如下:

其中L𝑖𝑛𝑡约束融合图像的整体表观强度,而L𝑡𝑒𝑥𝑡𝑢𝑟𝑒迫使融合图像包含更细粒度的纹理细节。这里,𝛼用于在强度损失L𝑖𝑛𝑡和纹理损失L𝑡𝑒𝑥𝑡𝑢𝑟𝑒之间取得平衡。

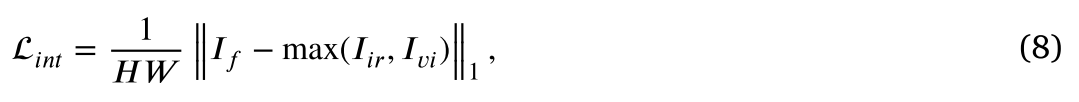

强度损失在像素级测量融合图像和源图像之间的差异。因此,我们将红外和可见光图像的强度损失定义为:

其中𝐻和𝑊分别是图像的高度和宽度,‖·‖1代表𝑙1-范数,max(·)表示元素方面的最大选择。我们通过最大选择策略整合红外和可见光图像的像素强度分布。然后,利用积分分布约束融合图像的像素亮度分布。

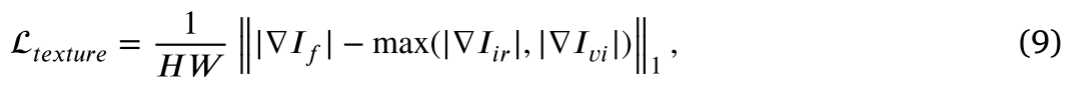

我们期望融合后的图像在保持最佳亮度分布的同时,能够保留源图像丰富的纹理细节。然而,强度损失仅为模型学习提供了粗粒度分布约束。因此,引入纹理损失,使融合图像包含更细粒度的纹理信息。纹理损失定义为:

其中▽表示Sobel梯度算子,用于测量图像的细粒度纹理信息。| ·|指绝对运算。我们假设融合图像的最佳纹理是红外和可见光图像纹理的最大集合。

结果表明,基于梯度残差密集块的融合网络在内容损失的指导下,能够同时实现最优的灰度分布和保留丰富的细节信息。换句话说,内容丢失可以有效地保证我们的模型达到第一个目标,即:改善了融合图像的视觉质量和统计评估度量。

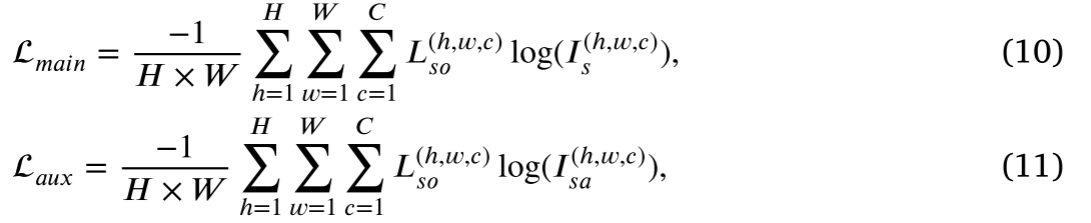

Semantic loss

充分增强融合图像的语义信息是算法的最大创新。我们创造性地设计了一个语义损失来实现这个目标。更具体地说,我们引入了一个实时语义分割模型来分割融合图像,分割网络输出分割结果𝐼𝑠∈

R

𝐻

×

𝑊

×

𝐶

R^{𝐻 ×𝑊 ×𝐶}

RH×W×C和辅助分割结果𝐼𝑠𝑎∈

R

𝐻

×

𝑊

×

𝐶

R^{𝐻 ×𝑊 ×𝐶}

RH×W×C。语义损失包括两个因素,主要语义损失和辅助语义损失。主要语义损失和辅助语义损失定义如下:

其中𝐿𝑠𝑜∈

R

𝐻

×

𝑊

×

𝐶

R^{𝐻 ×𝑊 ×𝐶}

RH×W×C表示从分割标签𝐿𝑠∈

(

1

,

𝐶

)

𝐻

×

𝑊

(1,𝐶)^{𝐻×𝑊}

(1,C)H×W变换而来的独热向量。主语义损失和辅助语义损失从不同角度反映了融合图像所包含的语义信息。最终,语义损失表示如下:

其中,𝜆是一个用于平衡主语义损失和辅助语义损失的常数,参考原文将其设置为0.1。值得注意的是,除了约束融合网络之外,还部署语义损失来训练分割模型。

最后,构造一个联合损失来指导融合模型的训练,定义为:

其中𝛽是表征语义损失的重要性的超参数L𝑠𝑒𝑚𝑎𝑛𝑡𝑖𝑐。重要的是要强调𝛽根据联合的低层和高层自适应训练策略逐渐增加,因为随着训练的进行,分割网络变得与融合模型自适应。

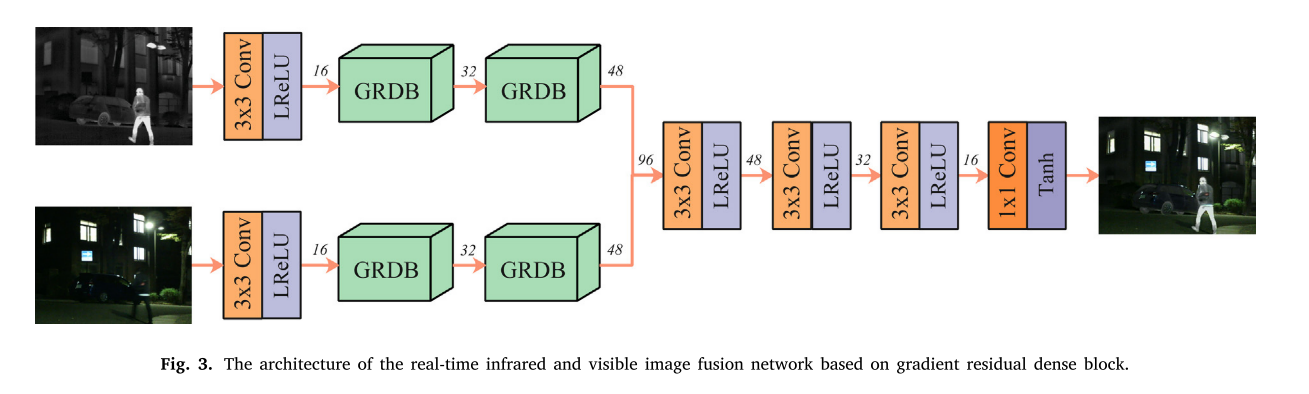

Network architecture

为了实现图像的实时融合,提出了一种基于GRDB的轻量级红外与可见光图像融合网络,如图3所示。该融合网络由特征提取器和图像重建器组成,其中特征提取器包含两个GRDB,用于提取细粒度特征。

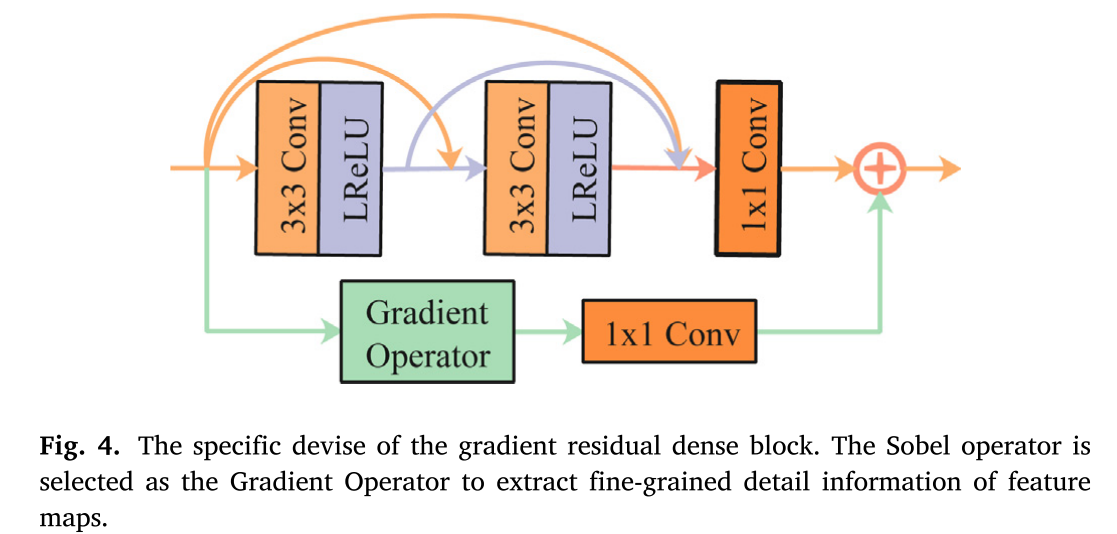

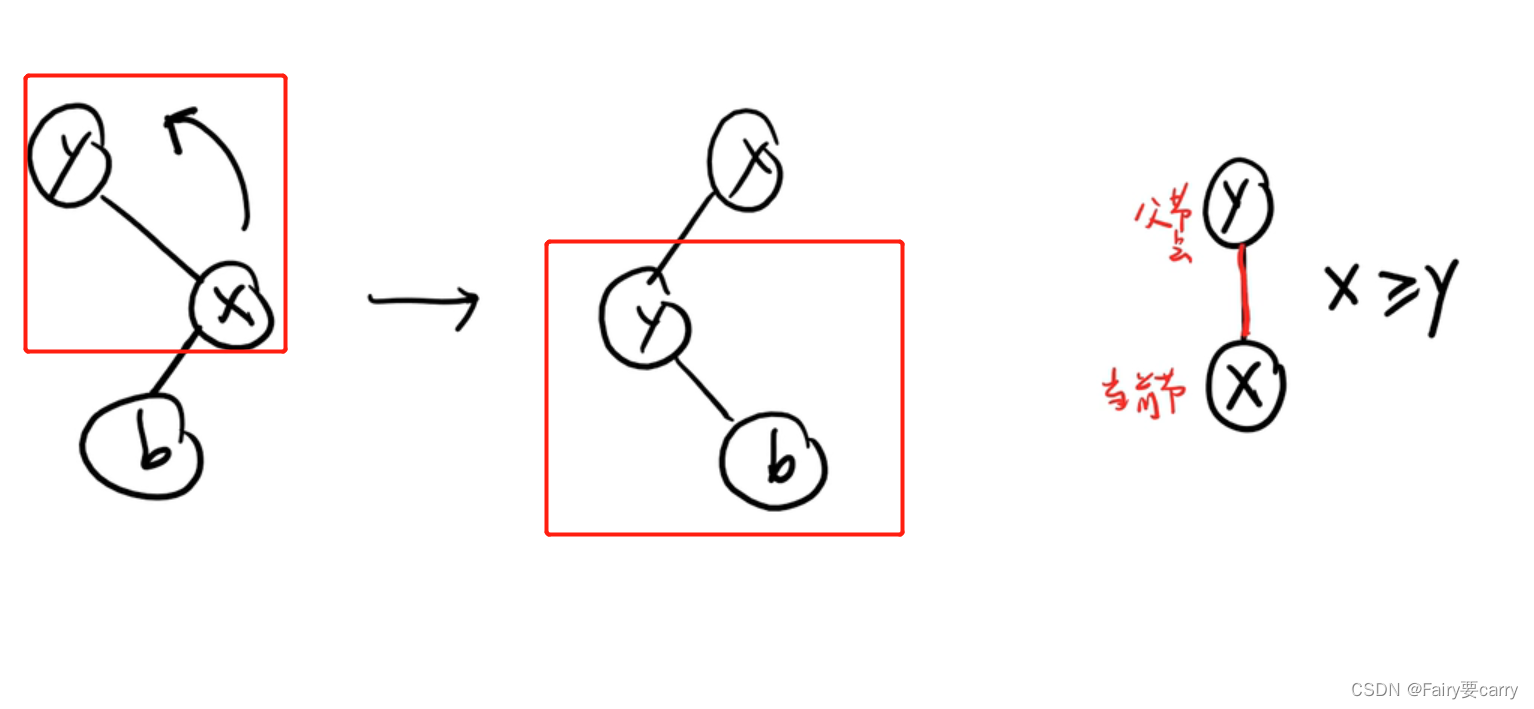

如图3所示,特征提取器包括两个并行的红外和可见光特征提取流,并且每个特征提取流包含公共卷积层和两个GRDB。采用核大小为3 × 3、激活函数为LReLU(Leaky Rectified Linear Unit)的公共卷积层提取浅层特征。紧接着是两个GRDB,用于从浅层特征中提取细粒度特征。GRDB的具体设计如图4所示。梯度剩余密集块是Resblock 的变体,其中主流采用密集连接,残差流集成梯度操作。

我们可以从图4中观察到,主流部署了两个3 × 3的卷积层带有LReLU和一个内核大小为1 × 1的普通卷积层。需要强调的是,我们在主流中引入了密集连接,充分利用了各卷积层提取的特征。残差流采用梯度运算计算特征的梯度大小,并采用1 × 1规则卷积层消除通道维数差异。然后,通过逐元素加法将主密集流和残差梯度流的输出相加,以集成深度特征和细粒度细节特征。

然后,采用级联策略对红外和可见光图像的细粒度特征进行融合,并将融合结果输入图像重建器,实现特征聚合和图像重建。图像重建器由三个串联的3 × 3卷积层和一个1 × 1卷积层组成。所有3 × 3卷积层都使用LReLU作为激活函数,而1 × 1卷积层的激活函数为Tanh。

众所周知,信息丢失是图像融合任务中的一个灾难性问题。因此,除了1 × 1卷积层外,我们的融合网络中的填充被设置为相同的,并且跨距被设置为1。结果表明,该网络没有引入任何降采样,融合后的图像大小与源图像一致。

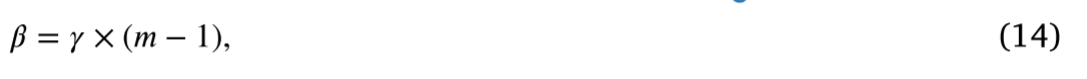

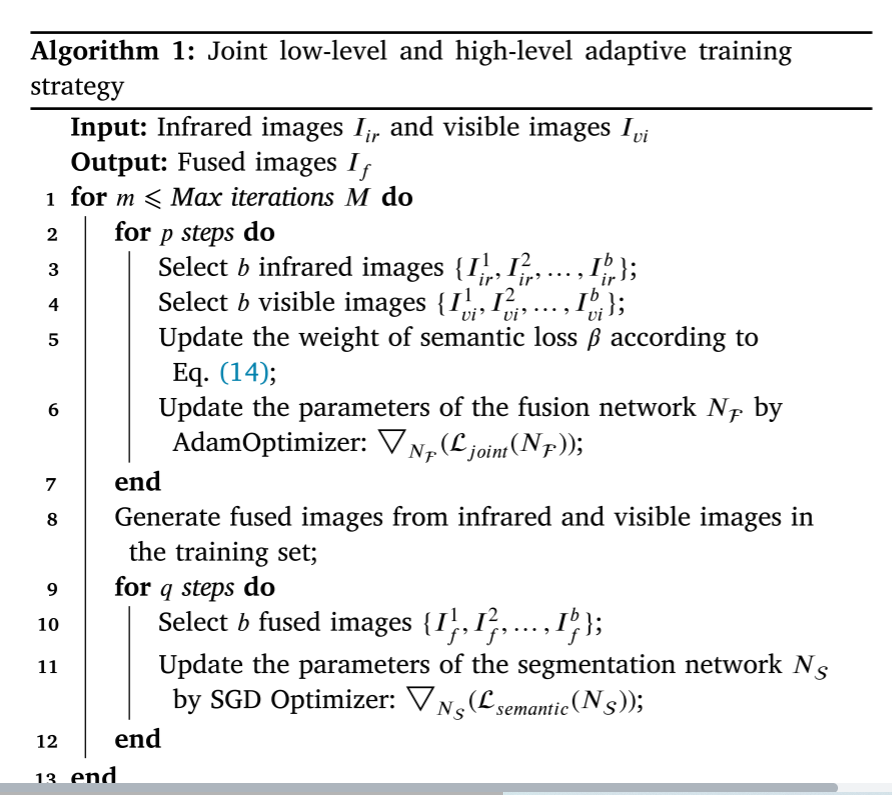

Joint low-level and high-level adaptive training strategy

现有的任务驱动低级视觉方法要么采用预先训练好的高级模型指导低级视觉任务模型的训练,要么在一个阶段内联合训练低级和高级视觉任务模型。然而,在图像融合领域中,难以提供融合图像的真实数据以用于训练高级视觉任务模型。此外,单阶段联合训练策略可能会导致低水平和高水平视觉任务之间难以保持平衡。为此,我们设计了一个联合的低水平和高水平训练策略来训练我们的融合网络。更具体地,我们迭代地训练融合网络和分割网络,并将迭代次数设置为𝑀。首先,在联合损失的指导下,利用Adam优化器对融合网络中的所有参数进行优化。此外,𝛽通过迭代动态调整关节损耗的超参数,其表示如下:

其中𝑚表示第𝑚次迭代。𝛽 由于随着迭代次数的增加,分割网络与融合模型的拟合程度会逐渐提高,语义损失可以更准确地指导融合网络的训练。𝛾 是用于平衡语义损失和内容损失的常数。然后,根据当前融合结果,通过优化语义损失更新分割模型的参数。在每次迭代中,融合模型和分割模型的训练步骤分别为𝑝和𝑞。算法1总结了联合低层和高层自适应训练策略。

![[第十二届蓝桥杯/java/算法]F——时间显示](https://img-blog.csdnimg.cn/fc1df0d1cbdc433c9511401e31018cd4.png)