1. 预测部署简介与总览

本章主要介绍PP-OCRv2系统的高性能推理方法、服务化部署方法以及端侧部署方法。通过本章的学习,您可以学习到:

- 根据不同的场景挑选合适的预测部署方法

- PP-OCRv2系列模型在不同场景下的推理方法

- Paddle Inference、Paddle Serving、Paddle Lite的推理部署开发方法

1.1 简介

在前面几个章节中,我们通过模型训练的方法,得到了训练好的模型,在使用它去预测的时候,我们首先需要定义好模型,然后加载训练好的模型,再将预处理之后的数据送进网络中进行预测、后处理,得到最终的结果。使用这种方法去进行预测,调试方便,但是预测效率比较低下。

针对上面的问题,对于训练得到的模型,一般有下面2种离线预测的方式。

- 基于训练引擎推理,也就是和训练使用同一套引擎,它调试方便,便于我们迅速定位问题,验证正确性。多为Python语言。

- 基于预测引擎推理,将训练得到的模型进行转换,去掉与推理无关的部分,使用这种方法可以加速预测。多为Python语言或C++。

二者具体的区别如下所示。

| 基于训练引擎推理 | 基于预测引擎推理 | |

|---|---|---|

| 特点 | 1. 和训练使用同一套引擎 2. 预测时需要定义网络模型 3. 不适合系统集成 | 1. 需要转换模型,去掉与推理无关的部分 2. 预测时无需定义网络模型 3. 适合系统集成 |

| 编程语言 | 多为Python | Python或者C++ |

| 预测步骤 | 1. Python端定义网络结构 2. 准备输入数据 3. 加载训练模型 4. 执行预测 | 1. 准备输入数据 2. 加载模型结构和模型参数 3.执行预测 |

在实际离线预测部署中,更推荐基于预测引擎进行推理。

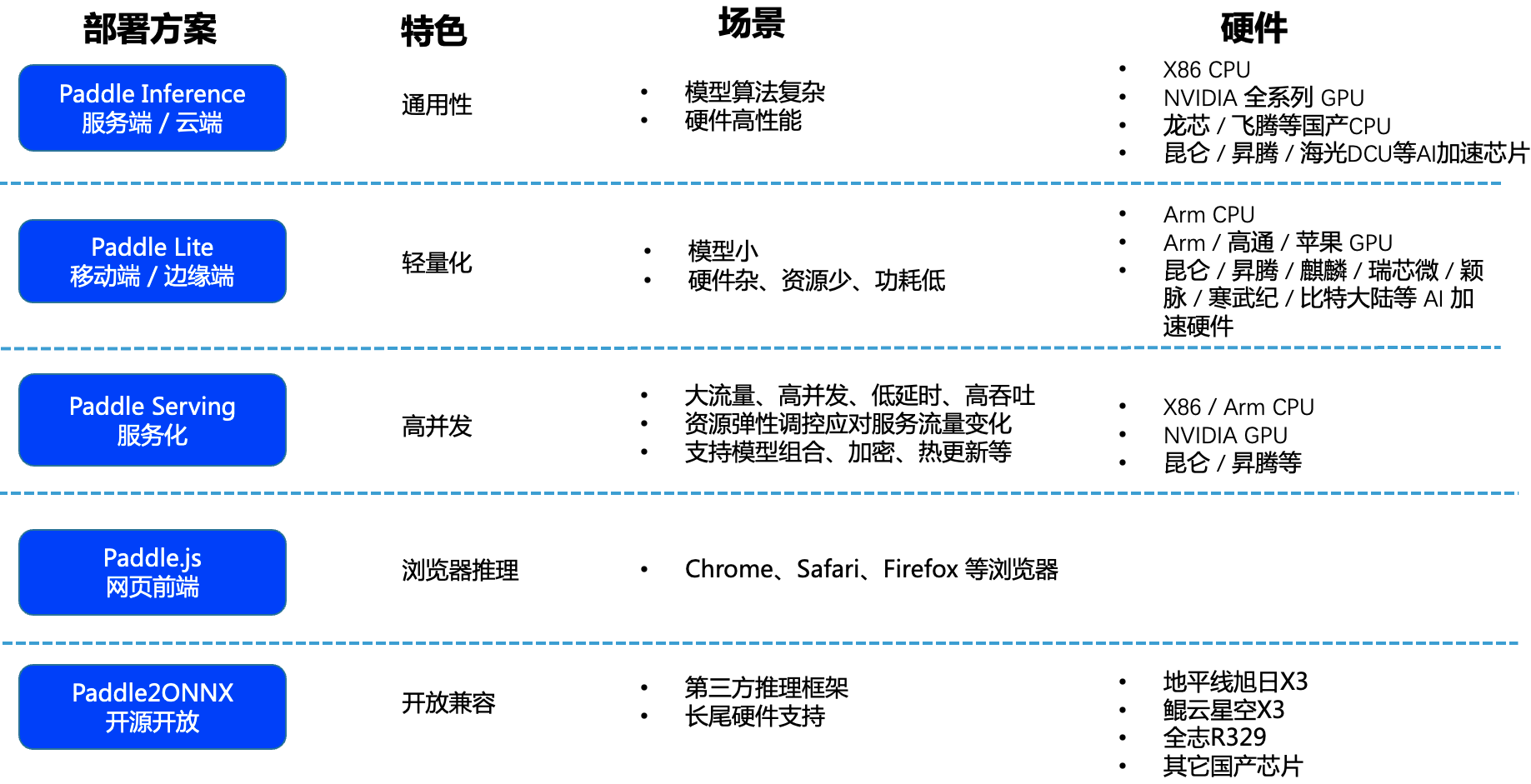

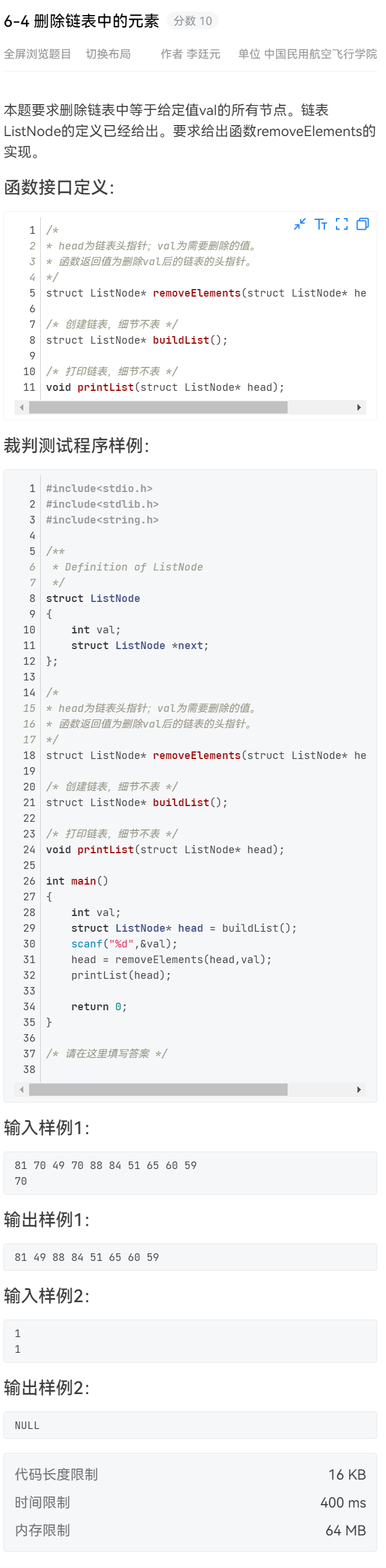

从应用场景来看,飞桨针对不同应用场景,提供了下面一些推理部署方案。

飞桨的不同部署方案

具体地,PaddleOCR 针对不同应用场景,提供了三种预测部署方案。

- Inference的离线预测,这种方式主要应用在对预测响应的及时性要求不高,特别是需要大量图片预测的场景。像文档电子化、广告信息提取等。虽然不能及时响应预测请求,但是没有网络延时,计算效率比较高,数据安全性很高。

- Serving服务化部署,这种方式主要应用在对预测响应的及时性要求很高的场景,像商业化OCR的API接口、实时拍照翻译、拍题等场景。虽然这种方式能及时对预测需求及时响应,但是网络耗时开销比较大,GPU利用率往往不高,而且存在数据安全风险。

- Lite端侧部署,这种方式主要希望模型部署到手机、机器人等端侧设备上,主要考虑部署方便和数据安全性,像手机APP里面身份证识别、银行卡识别,工业应用场景的仪表监控识别等。这种方法,对OCR模型的大小比较敏感。虽然没有网络延时,数据安全性很高,但是由于算力限制,预测效率不高。

本章基于PP-OCRv2,介绍文本检测、识别以及系统串联预测推理与部署过程。

1.2 环境准备

体验本章节内容需要首先下载PaddleOCR代码,安装相关依赖,具体命令如下。

import os

os.chdir("/home/aistudio")

# 下载代码

!git clone https://gitee.com/paddlepaddle/PaddleOCR.git

os.chdir("/home/aistudio/PaddleOCR")

# 安装运行所需要的whl包

!pip install -U pip

!pip install -r requirements.txt

# VQA任务中需要用到该库

!pip install paddlenlp==2.2.1

# 导入一些库

import cv2

import matplotlib.pyplot as plt

%matplotlib inline

import numpy as np

import os

![2023年中国干毛茶行业总产值、总产量及未来发展趋势分析:茶叶总产量与总产值均实现稳定增长[图]](https://img-blog.csdnimg.cn/img_convert/2de806379b4f82e806d32bf5c870dc6f.png)