人类能够轻松识别身体和手语。这是可能的,因为视觉和突触相互作用是在大脑发育过程中形成的。为了在计算机中复制这种技能,需要解决一些问题:如何分离图像中感兴趣的对象以及哪种图像捕获技术和分类技术更合适等等。

计算的发展和新技术的易用性推动了 Kinect 和 Leap Motion 等设备的发展,它们是输入设备技术创新的例子。通过这种方式,这些设备能够捕捉人类手势,开发出一种新的人机交互媒介。这些设备的用途广泛,例如机器人、医学、手语翻译、计算机图形学和增强现实。

手势识别方法通常分为两类:静态或动态。

静态手势是那些只需要在分类器的输入处处理单个图像的手势,这种方法的优点是计算成本较低。

动态手势需要处理图像序列和更复杂的手势识别方法。

静态手势的识别的技术路线非常多,比如神经网络、卷积神经网络、支持向量机(SVM)、最近邻 、分布式局部线性嵌入,等等等等。

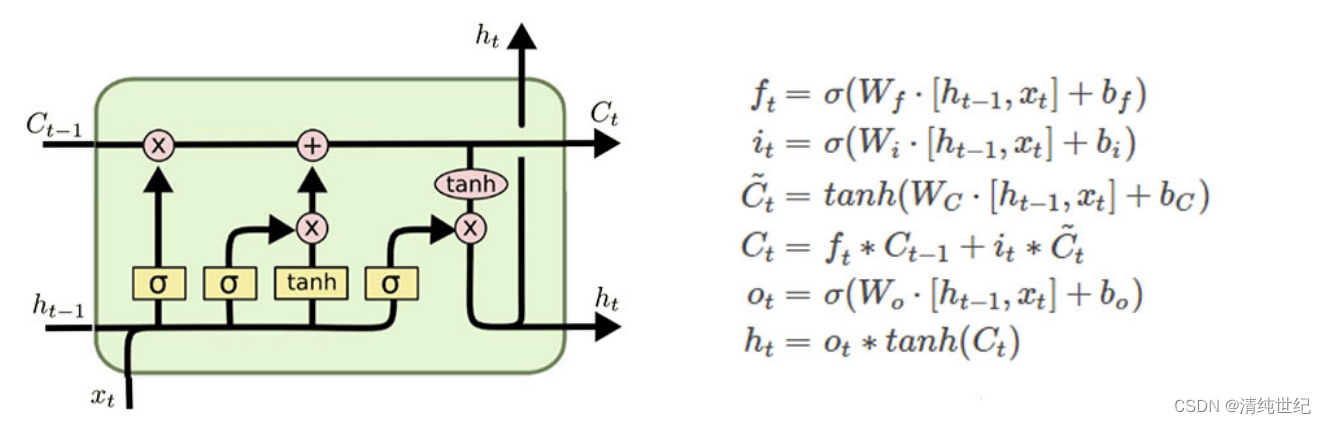

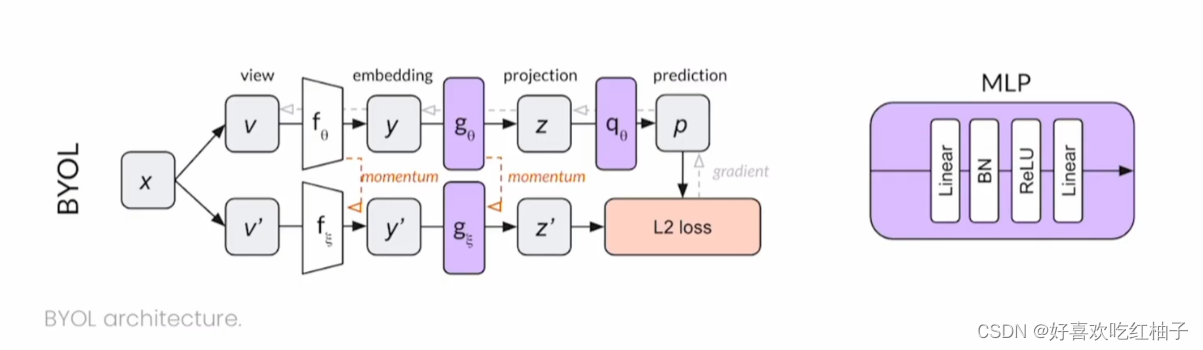

在深度学习快速发展之前,动态手势识别的研究主要依靠人工提取特征,然后构建序列模型进行识别。这种方法准确率低且效率低,因此目前常用的方法主要依靠深度学习。

由于动态手势数据通常以视频形式呈现,二维卷积神经网络(CNN)很难提取足够的特征信息,这促使研究人员探索新的CNN 3D网络模型,解决了同时保留时间和空间特征的问题,动态手势识别问题被深度学习方法广泛解决。

C3D模型也是最早的3D CNN模型。但3D CNN模型过于复杂,训练时间过长,对硬件要求非常高。这些关键问题仍然制约着动态手势识别的发展。

增强现实(AR)旨在以协调的方式将现实与虚拟结合起来。 主要目标是将虚拟内容尽可能真实地集成到用户的真实环境中。 通常,用户和 AR 应用程序之间的交互是通过使用非自然交互技术(例如鼠标或键盘)进行的。 为了实现完全沉浸式的 AR 应用,系统的输出(例如可视化)以及系统的输入必须适应用户的现实。 因此,AR 应用程序必须理解人类的自然交互技术,例如 言语或手势。

因此,研究集成静态和动态手势识别系统,以便在 AR 应用程序中使用是人工智能落地的热门应用场景之一。