4.5.1 范数与权重衰减

整节理论,详见书本。

4.5.2 高维线性回归

%matplotlib inline

import torch

from torch import nn

from d2l import torch as d2l

# 生成一些数据,为了使过拟合效果更明显,将维数增加到 200 并使用一个只包含 20 个样本的小训练集。

n_train, n_test, num_inputs, batch_size = 20, 100, 200, 5

true_w, true_b = torch.ones((num_inputs, 1)) * 0.01, 0.05 # 设置真实参数

train_data = d2l.synthetic_data(true_w, true_b, n_train)

train_iter = d2l.load_array(train_data, batch_size)

test_data = d2l.synthetic_data(true_w, true_b, n_test)

test_iter = d2l.load_array(test_data, batch_size, is_train=False)

4.5.3 从零开始实现

- 初始化模型参数

def init_params():

w = torch.normal(0, 1, size=(num_inputs, 1), requires_grad=True)

b = torch.zeros(1, requires_grad=True)

return [w, b]

- 定义 L 2 L_2 L2 范数惩罚

def l2_penalty(w):

return torch.sum(w.pow(2)) / 2

-

定义训练代码实现

损失函数直接通过 d2l 包导入,损失包含了惩罚项。

def train(lambd):

w, b = init_params()

net, loss = lambda X: d2l.linreg(X, w, b), d2l.squared_loss

num_epochs, lr = 100, 0.003

animator = d2l.Animator(xlabel='epochs', ylabel='loss', yscale='log',

xlim=[5, num_epochs], legend=['train', 'test'])

for epoch in range(num_epochs):

for X, y in train_iter:

# 增加了L2范数惩罚项,

# 广播机制使l2_penalty(w)成为一个长度为batch_size的向量

l = loss(net(X), y) + lambd * l2_penalty(w)

l.sum().backward()

d2l.sgd([w, b], lr, batch_size)

if (epoch + 1) % 5 == 0:

animator.add(epoch + 1, (d2l.evaluate_loss(net, train_iter, loss),

d2l.evaluate_loss(net, test_iter, loss)))

print('w的L2范数是:', torch.norm(w).item())

- 忽略正则化直接训练

train(lambd=0)

w的L2范数是: 14.042692184448242

- 使用权重衰减

train(lambd=3)

w的L2范数是: 0.35160931944847107

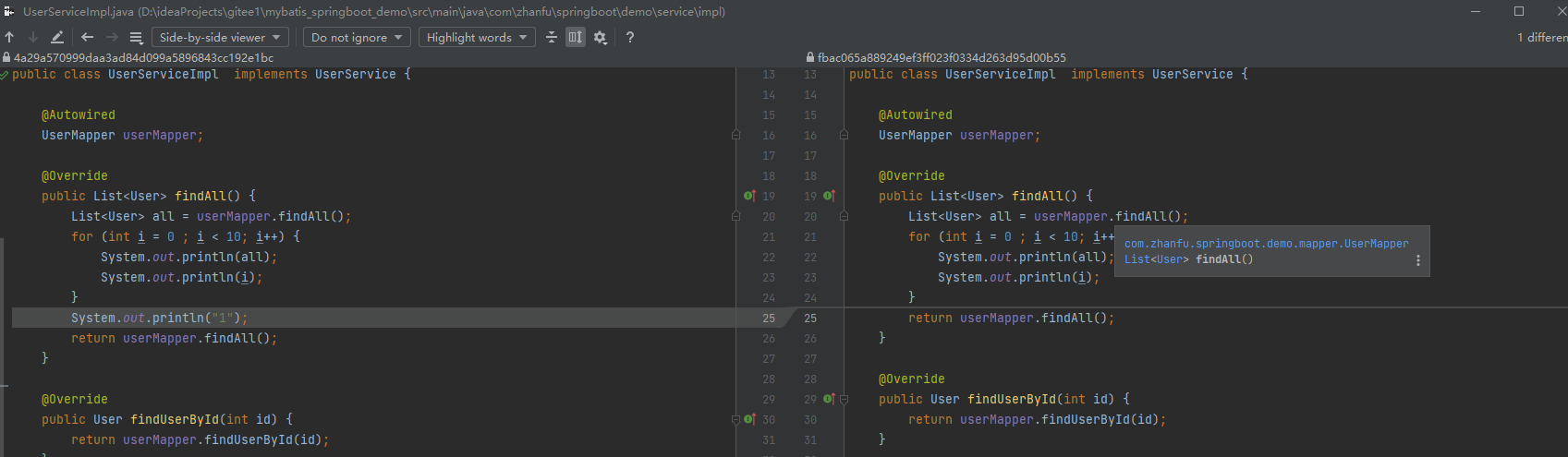

4.5.4 简洁实现

def train_concise(wd):

net = nn.Sequential(nn.Linear(num_inputs, 1))

for param in net.parameters():

param.data.normal_()

loss = nn.MSELoss(reduction='none')

num_epochs, lr = 100, 0.003

trainer = torch.optim.SGD([

{"params":net[0].weight,'weight_decay': wd}, # PyTorch默认同时衰减权重和偏置,此处使用 weight_decay指定仅权重衰减

{"params":net[0].bias}], lr=lr)

animator = d2l.Animator(xlabel='epochs', ylabel='loss', yscale='log',

xlim=[5, num_epochs], legend=['train', 'test'])

for epoch in range(num_epochs):

for X, y in train_iter:

trainer.zero_grad()

l = loss(net(X), y)

l.mean().backward()

trainer.step()

if (epoch + 1) % 5 == 0:

animator.add(epoch + 1,

(d2l.evaluate_loss(net, train_iter, loss),

d2l.evaluate_loss(net, test_iter, loss)))

print('w的L2范数:', net[0].weight.norm().item())

train_concise(0)

w的L2范数: 12.836501121520996

train_concise(3)

w的L2范数: 0.3978956639766693

练习

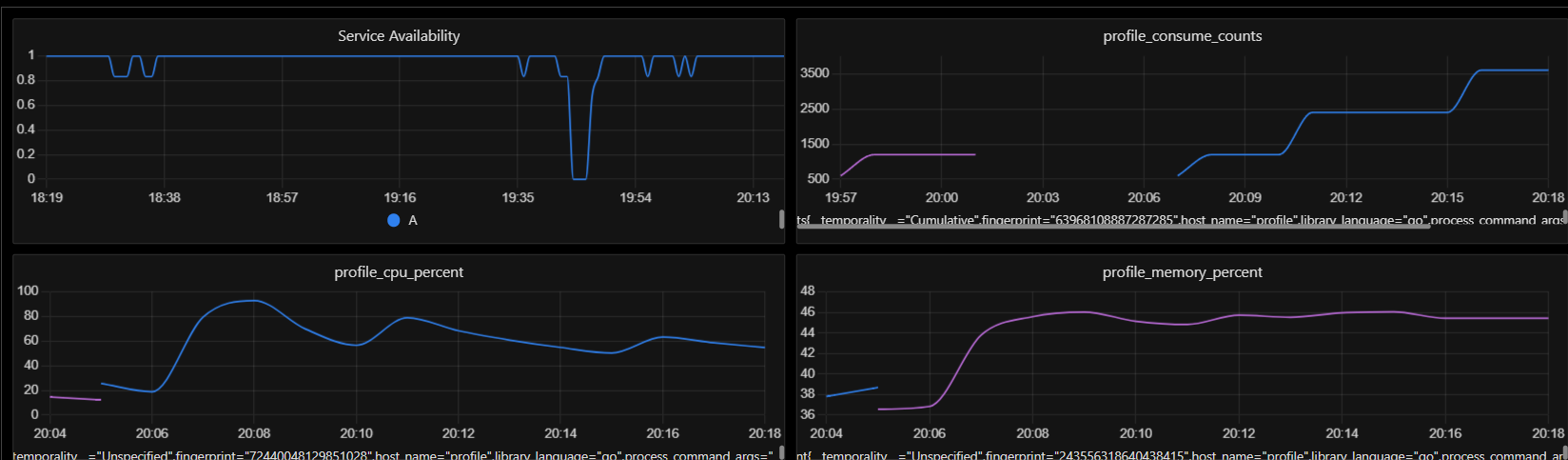

(1)在本节的估计问题中使用 λ \lambda λ 的值进行实验。绘制训练精度和测试精度有关 λ \lambda λ 的函数图,可以观察到什么?

随着 λ \lambda λ 的增大可以改善过拟合的现象,但是 λ \lambda λ 过大也会影响收敛。

for i in (0, 2, 8, 32, 128, 256):

train_concise(i)

w的L2范数: 0.008308843709528446

(2)使用验证集来找最优值 λ \lambda λ。它真的是最优值吗?

不至于说是最优的,毕竟再怎么样验证集也和训练集分布有些许区别,只能说是比较接近最优值。

(3)如果我们使用 ∑ i ∣ w i ∣ \sum_i|w_i| ∑i∣wi∣ 作为我们选择的惩罚( L 1 L_1 L1正则化),那么更新的公式会是什么样子?

如果使用 L 1 L_1 L1 正则化则最小化预测损失和惩罚项之和为:

L R ( w , b ) = 1 n ∑ i = 1 n 1 2 ( w T x ( i ) + b − y ( i ) ) 2 + λ ∑ i = 1 n ∣ w i ∣ LR(\boldsymbol{w},b)=\frac{1}{n}\sum_{i=1}^n\frac{1}{2}(\boldsymbol{w}^T\boldsymbol{x}^{(i)}+b-y^{(i)})^2+\lambda\sum^n_{i=1}|w_i| LR(w,b)=n1i=1∑n21(wTx(i)+b−y(i))2+λi=1∑n∣wi∣

L 1 L_1 L1 范数有求导问题,在此,规定在不可导点 x = 0 x=0 x=0 的导数为 0,则:

w ← w − η ∂ L R ( w , b ) ∂ w = w − η ∣ B ∣ ∑ i ∈ B x ( i ) ( w T x ( i ) + b − y ( i ) ) − λ η sign ( w ) \boldsymbol{w}\gets\boldsymbol{w}-\eta\ \frac{\partial LR(\boldsymbol{w},b)}{\partial\boldsymbol{w}}=\boldsymbol{w}-\frac{\eta}{|B|}\sum_{i\in B}\boldsymbol{x}^{(i)}(\boldsymbol{w}^T\boldsymbol{x}^{(i)}+b-y^{(i)})-\lambda\ \eta\ \text{sign}(\boldsymbol{w}) w←w−η ∂w∂LR(w,b)=w−∣B∣ηi∈B∑x(i)(wTx(i)+b−y(i))−λ η sign(w)

(4)我们知道 ∣ ∣ w ∣ ∣ 2 = w T w ||\boldsymbol{w}||^2=\boldsymbol{w}^T\boldsymbol{w} ∣∣w∣∣2=wTw。能找到类似的矩阵方程吗?(见 2.3.10 节中的弗罗贝尼乌斯范数)

弗罗贝尼乌斯范数时矩阵元素平方和的平方根:

∣ ∣ X ∣ ∣ F = ∑ i = 1 m ∑ j = 1 n x i j 2 ||\boldsymbol{X}||_F=\sqrt{\sum^m_{i=1}\sum^n_{j=1}x^2_{ij}} ∣∣X∣∣F=i=1∑mj=1∑nxij2

和L2范数的平方相似,弗罗贝尼乌斯范数的平方:

∣ ∣ X ∣ ∣ F 2 = X T X ||\boldsymbol{X}||_F^2=\boldsymbol{X}^T\boldsymbol{X} ∣∣X∣∣F2=XTX

(5)回顾训练误差和泛化误差之间的关系。除了权重衰减、增加训练数据、使用适当复杂度的模型,还有其他方法来处理过拟合吗?

Dropout暂退法、多种模型组合等

(6)在贝叶斯统计中,我们使用先验和似然的乘积,通过公式 P ( w ∣ x ) ∝ P ( x ∣ w ) P ( w ) P(w|x)\propto P(x|w)P(w) P(w∣x)∝P(x∣w)P(w) 得到后验。如何得到正则化的 P ( w ) P(w) P(w)?

以下参见王木头大佬的视频《贝叶斯解释“L1和L2正则化”,本质上是最大后验估计。如何深入理解贝叶斯公式?》

使用最大后验估计,令:

w = arg max w P ( w ∣ x ) = arg max w P ( x ∣ w ) P ( x ) ⋅ P ( w ) = arg max w P ( x ∣ w ) ⋅ P ( w ) = arg max w log ( P ( x ∣ w ) ⋅ P ( w ) ) = arg max w ( log P ( x ∣ w ) + log P ( w ) ) \begin{align} w&=\mathop{\arg\max}\limits_{w}P(w|x)\\ &=\mathop{\arg\max}\limits_{w}\frac{P(x|w)}{P(x)}\cdot P(w)\\ &=\mathop{\arg\max}\limits_{w}P(x|w)\cdot P(w)\\ &=\mathop{\arg\max}\limits_{w}\log(P(x|w)\cdot P(w))\\ &=\mathop{\arg\max}\limits_{w}(\log P(x|w)+\log P(w))\\ \end{align} w=wargmaxP(w∣x)=wargmaxP(x)P(x∣w)⋅P(w)=wargmaxP(x∣w)⋅P(w)=wargmaxlog(P(x∣w)⋅P(w))=wargmax(logP(x∣w)+logP(w))

其中:

- ( 2 ) ⇒ ( 3 ) (2)\Rightarrow(3) (2)⇒(3) 是由于分母 P ( x ) P(x) P(x) 是与 w w w 无关的常数,故可以忽略。

- ( 3 ) ⇒ ( 4 ) (3)\Rightarrow(4) (3)⇒(4) 是由于习惯上添加 log \log log 运算。

P ( w ) P(w) P(w) 作为先验概率可以任取

- 如果取高斯分布 w ∼ N ( 0 , σ 2 ) w\sim\mathrm{N}(0,\sigma^2) w∼N(0,σ2),则出现 L 2 L_2 L2 正则化:

log P ( w ) = log ∏ i 1 σ 2 π e − ( w i − 0 ) 2 2 σ 2 = − 1 2 σ 2 ∑ i w i 2 + C \begin{align} \log P(w)&=\log\prod_i\frac{1}{\sigma\sqrt{2\pi}}e^{-\frac{(w_i-0)^2}{2\sigma^2}}\\ &=-\frac{1}{2\sigma^2}\sum_iw_i^2+C \end{align} logP(w)=logi∏σ2π1e−2σ2(wi−0)2=−2σ21i∑wi2+C

- 如果取拉普拉斯分布 w ∼ L a p l a c e ( 0 , b ) w\sim\mathrm{Laplace}(0,b) w∼Laplace(0,b),则出现 L 1 L_1 L1 正则化:

log P ( w ) = log ∏ i 1 2 b e − ∣ w i − 0 ∣ b = − 1 b ∑ i ∣ w i ∣ + C \begin{align} \log P(w)&=\log\prod_i\frac{1}{2b}e^{-\frac{|w_i-0|}{b}}\\ &=-\frac{1}{b}\sum_i|w_i|+C \end{align} logP(w)=logi∏2b1e−b∣wi−0∣=−b1i∑∣wi∣+C

太奇妙了!