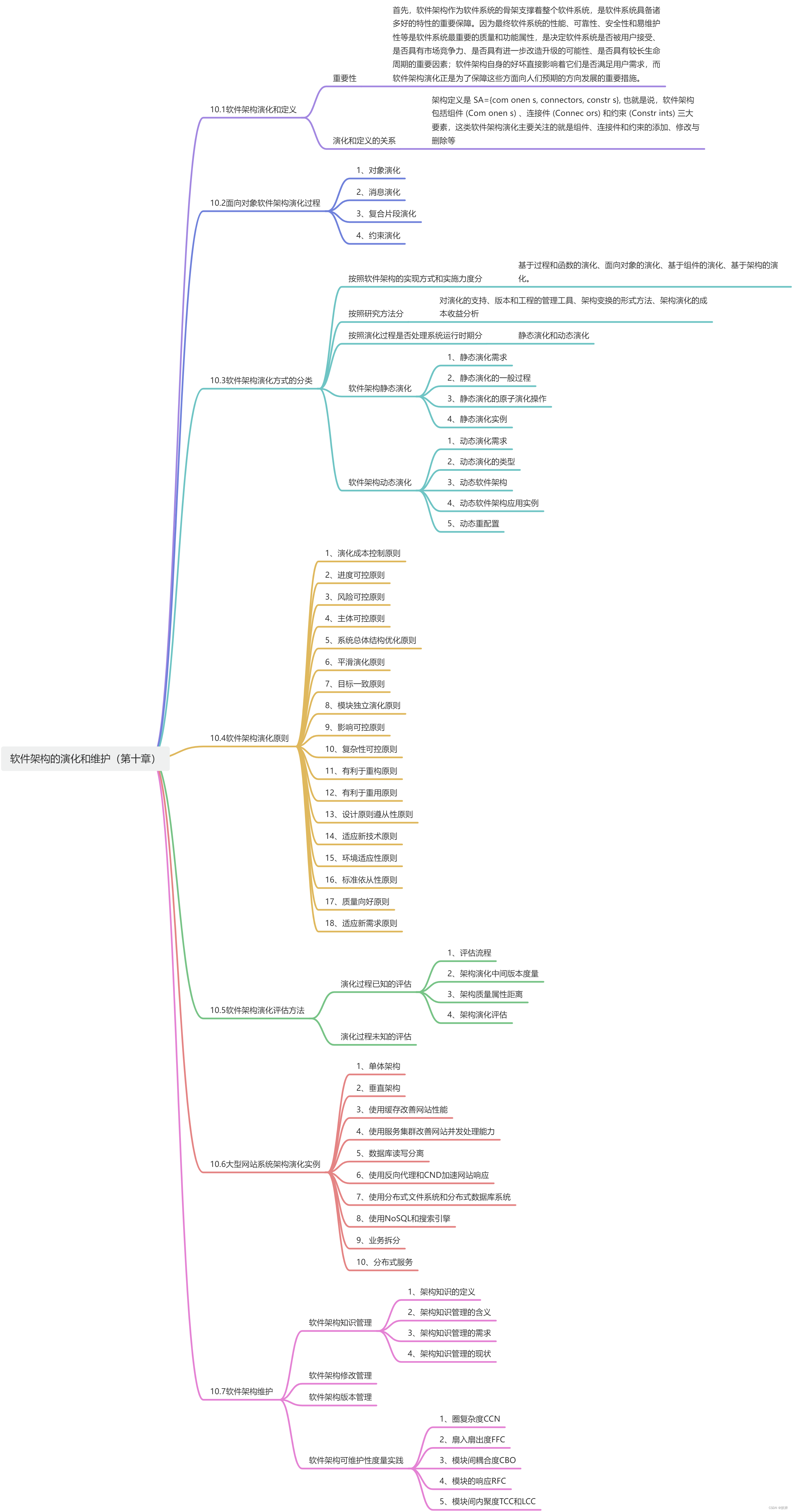

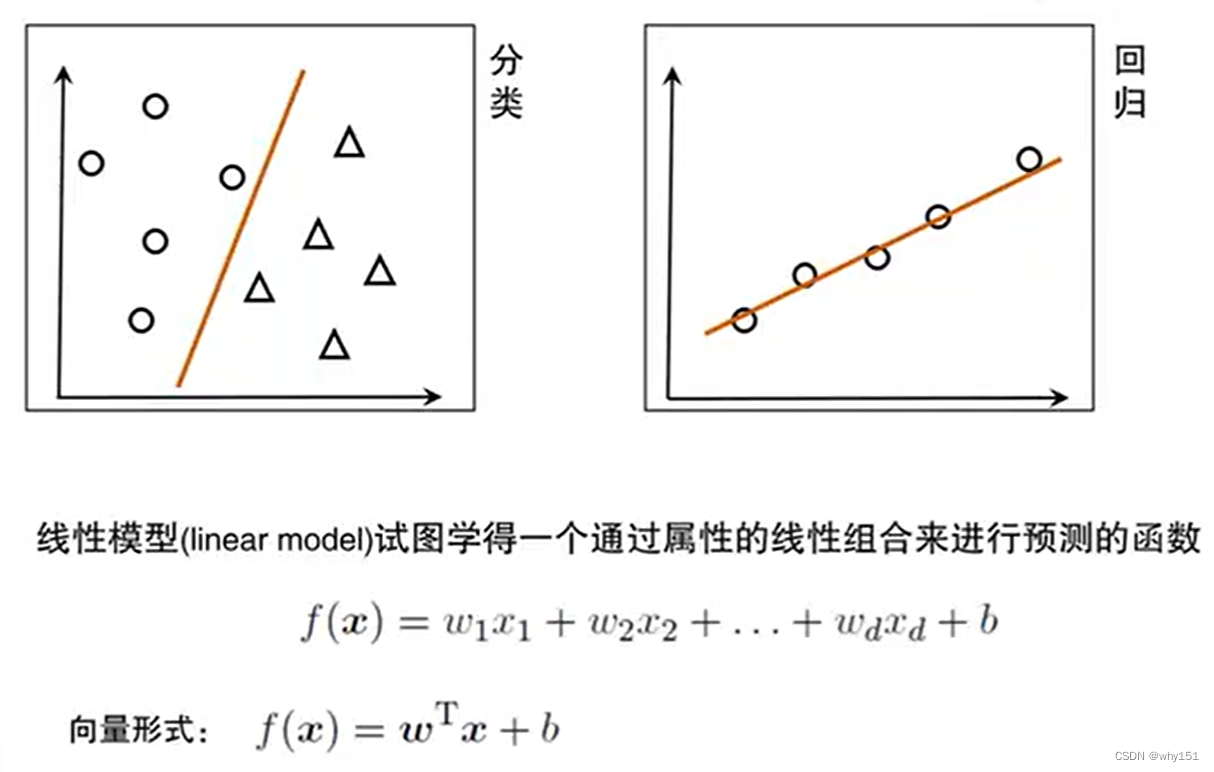

线性回归

优点:简单、基本、可理解性好。

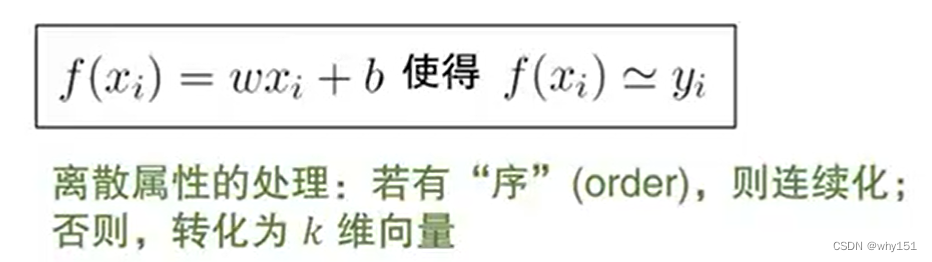

适用于处理数值型数据。编码:序关系(衣服号码s、m、l等等)独热编码(00010)

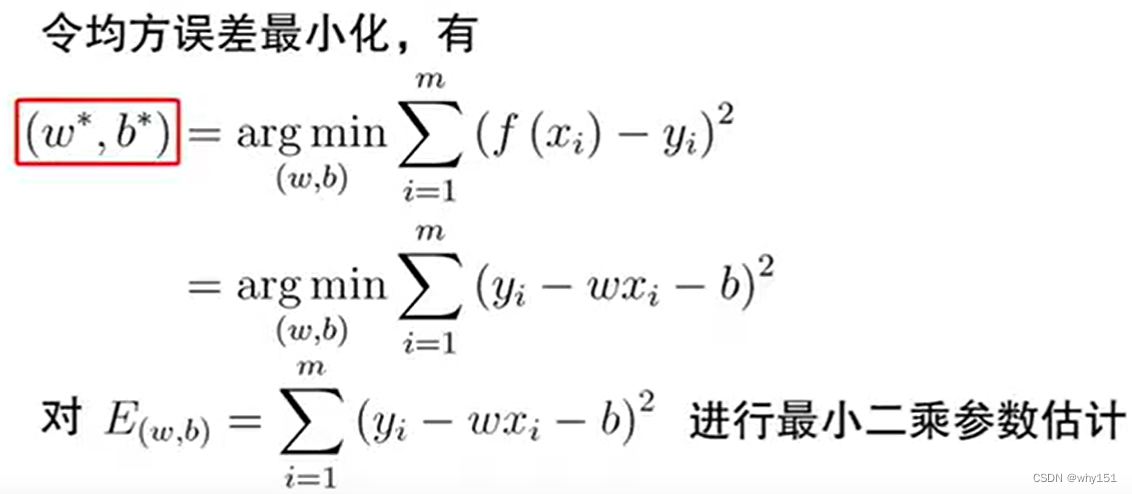

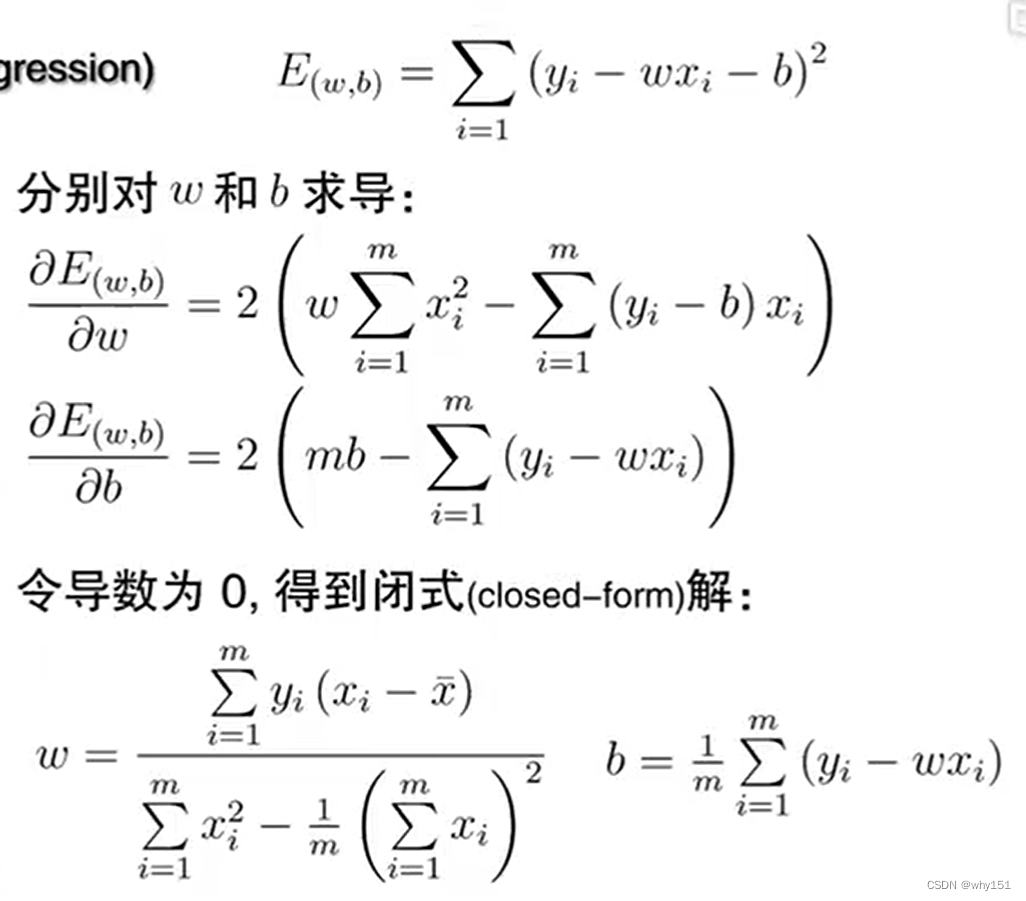

求解

求偏导让导数为0?为什么?

希望找到极值点,即误差最小的时候。

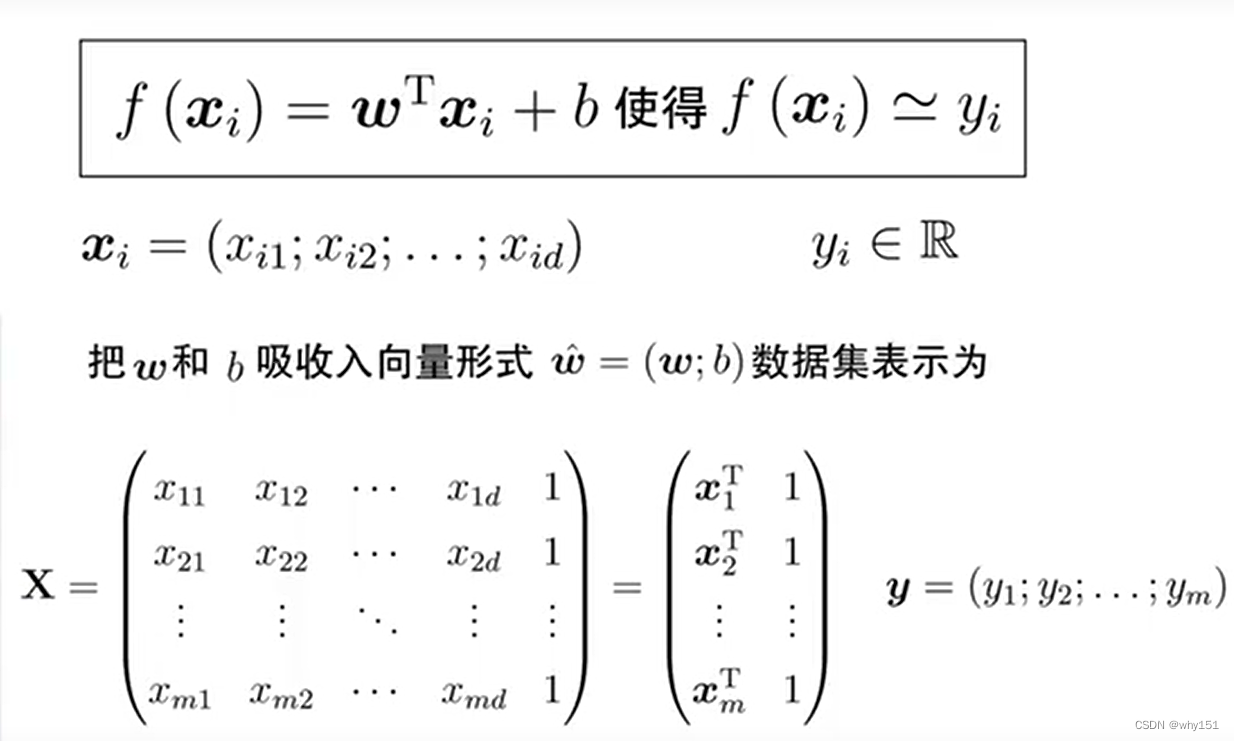

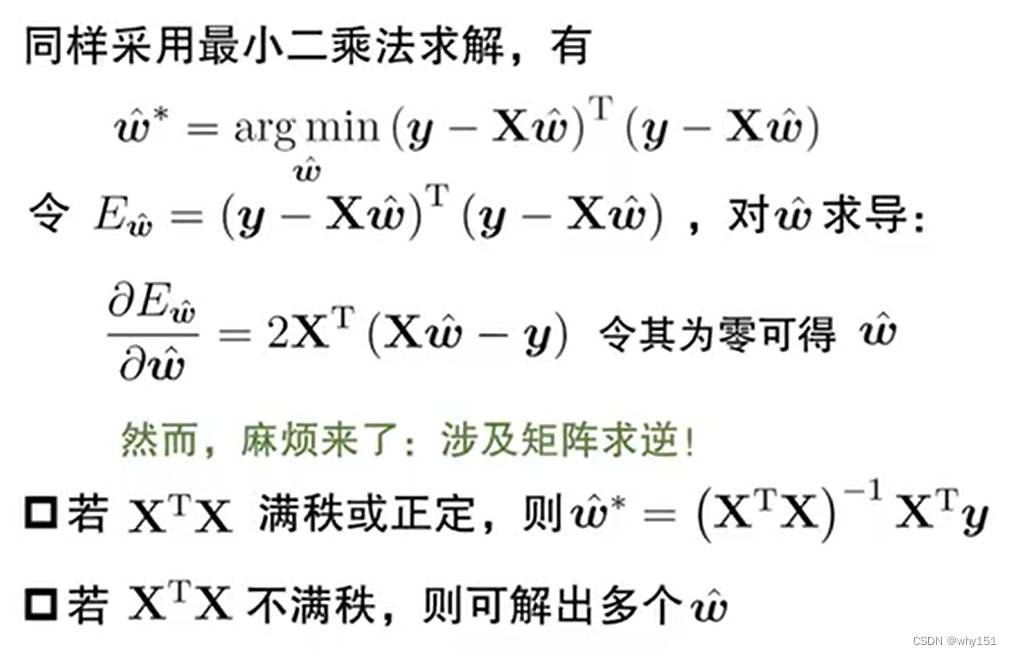

多元线性回归

将b和w合并,x加一个1。

求逆矩阵时如果不满秩会解出多个解,这个时候就要根据自己的偏好进行选择了。

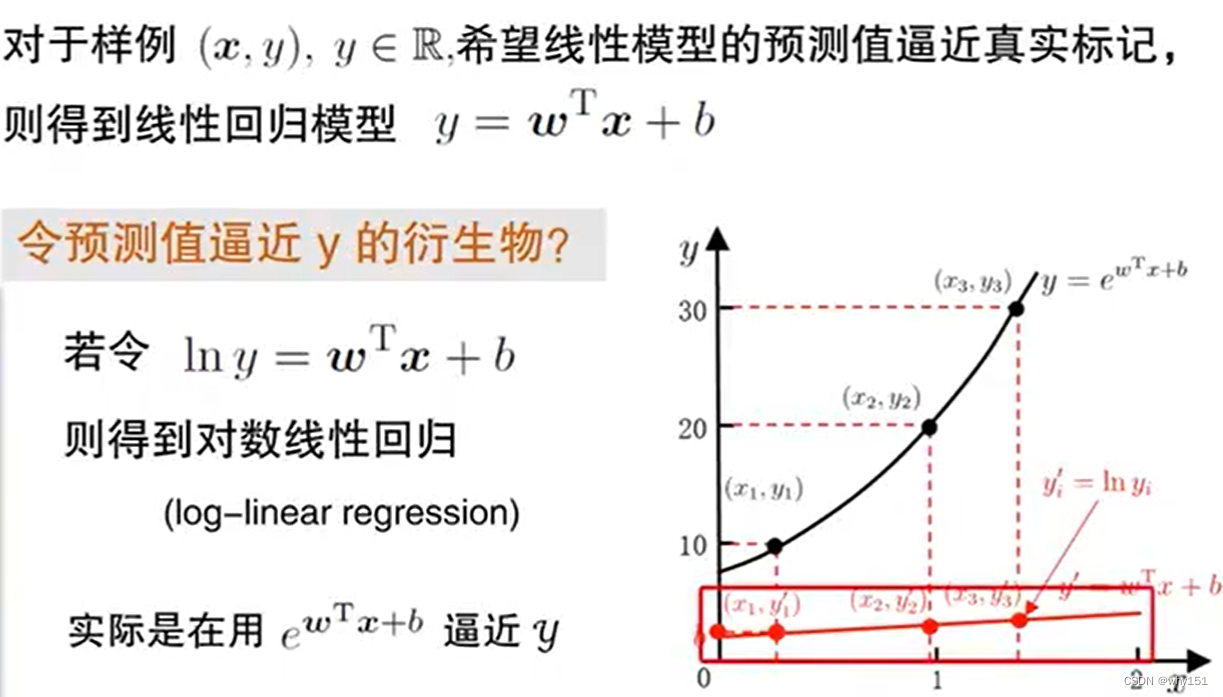

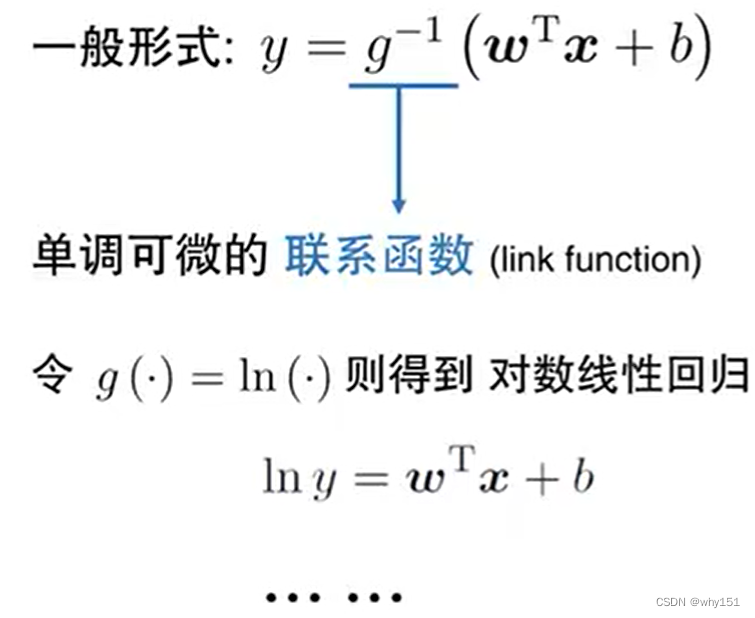

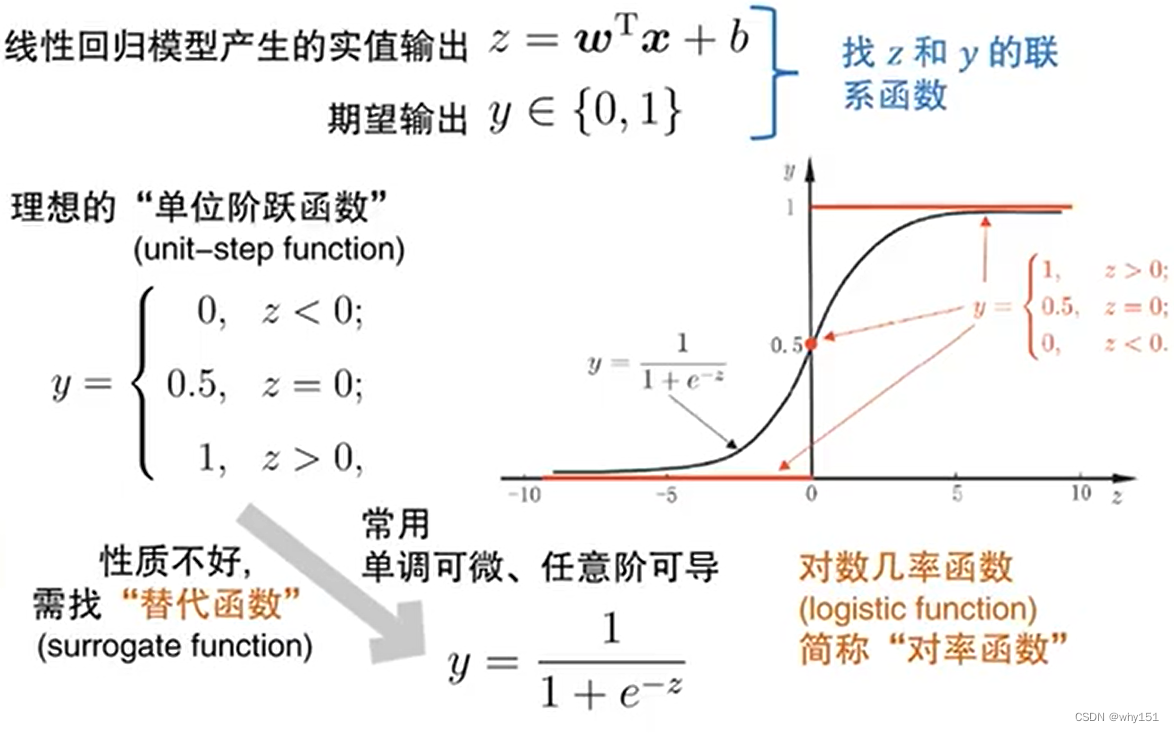

广义线性模型

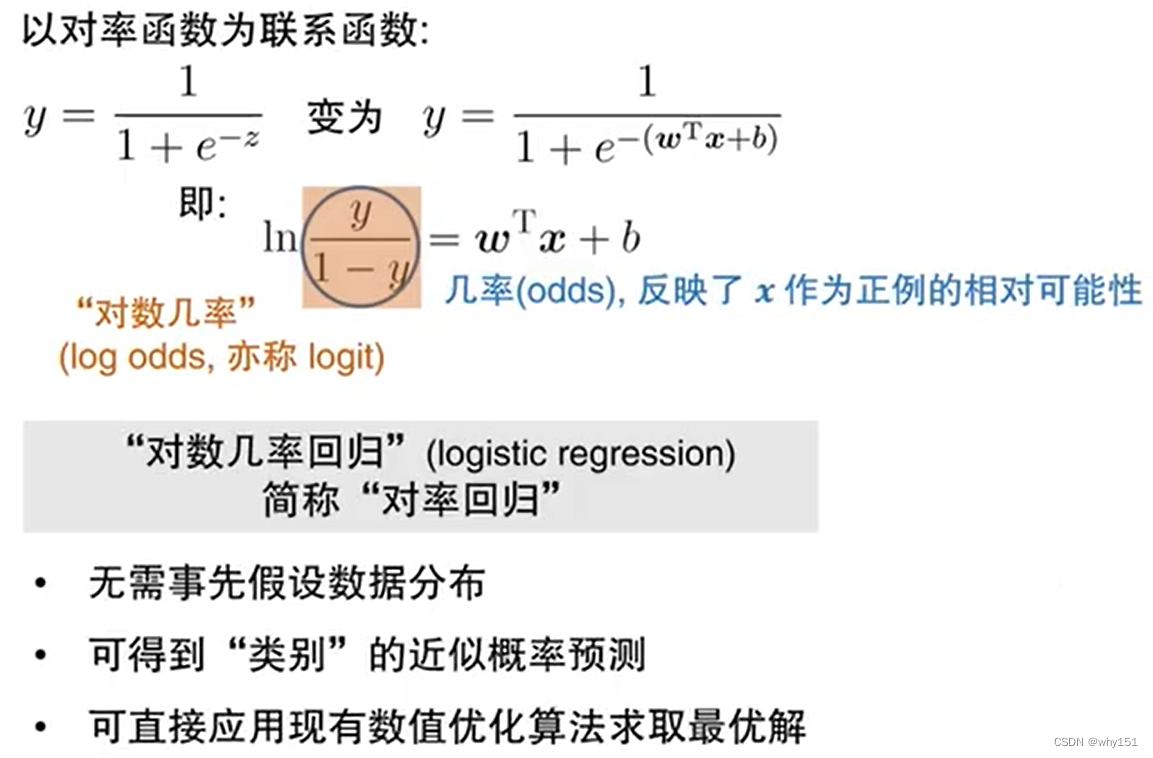

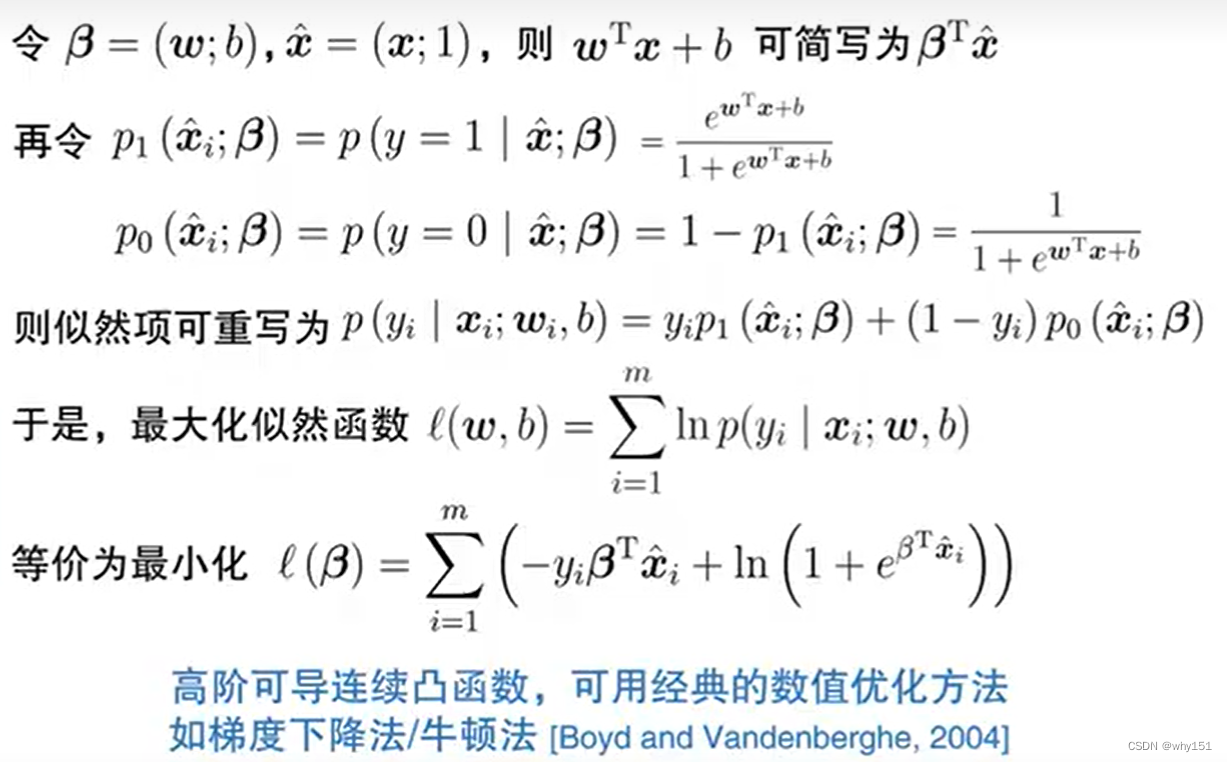

对率回归(分类)

为什么不能求偏导求解?因为这个方法只适用于凸函数。

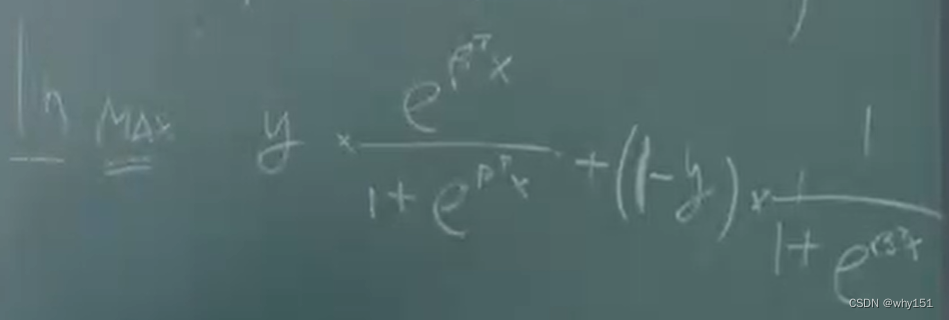

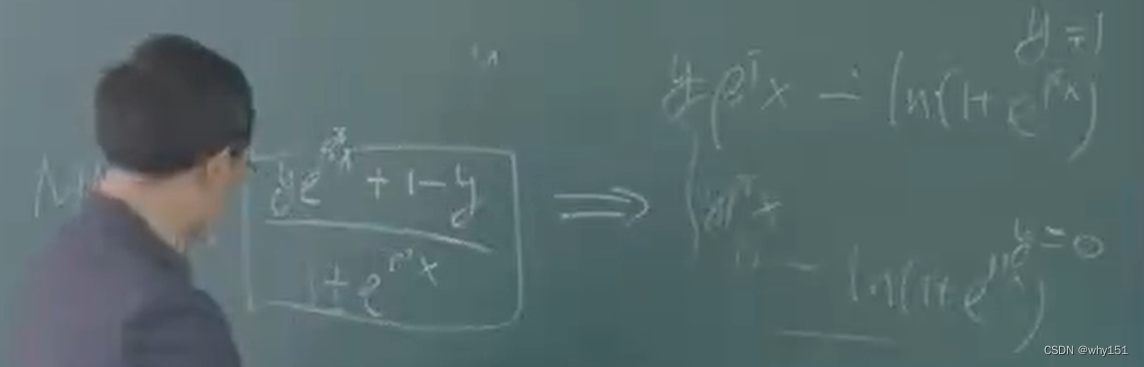

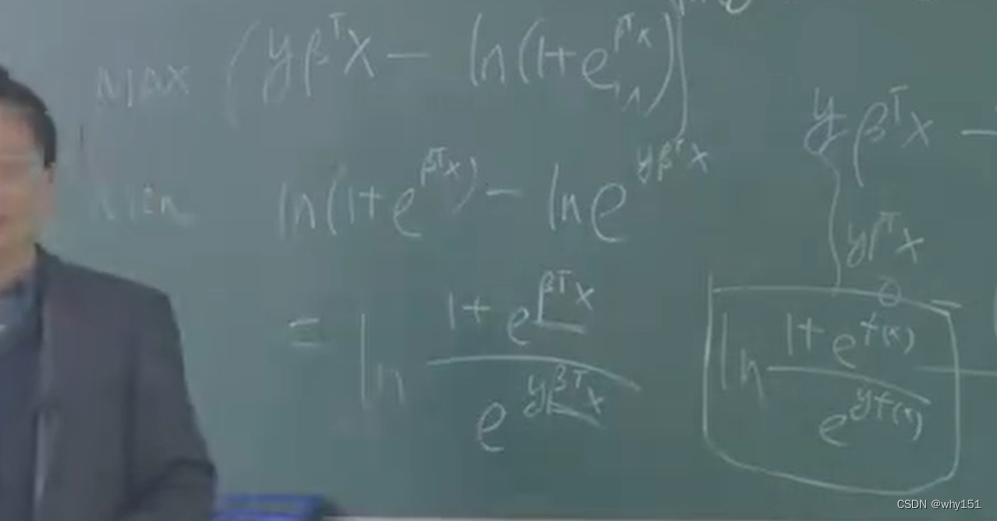

求解

为什么要加ln?因为两个很小的小数相乘会造成浮点数下溢,取ln可以将乘法变成加法。

最后利用梯度下降法求解即可。

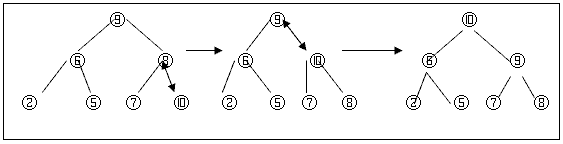

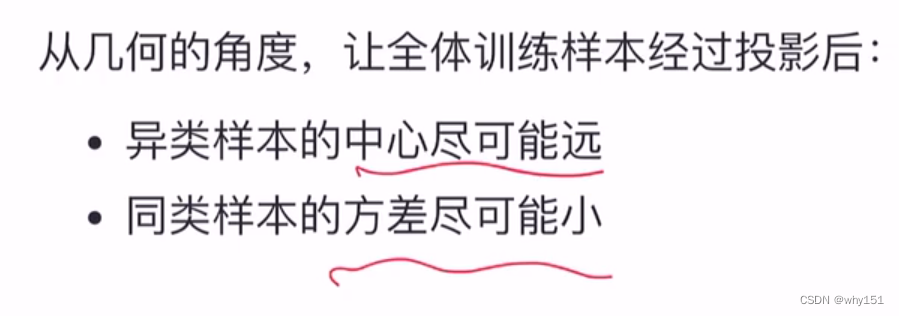

线性判别分析

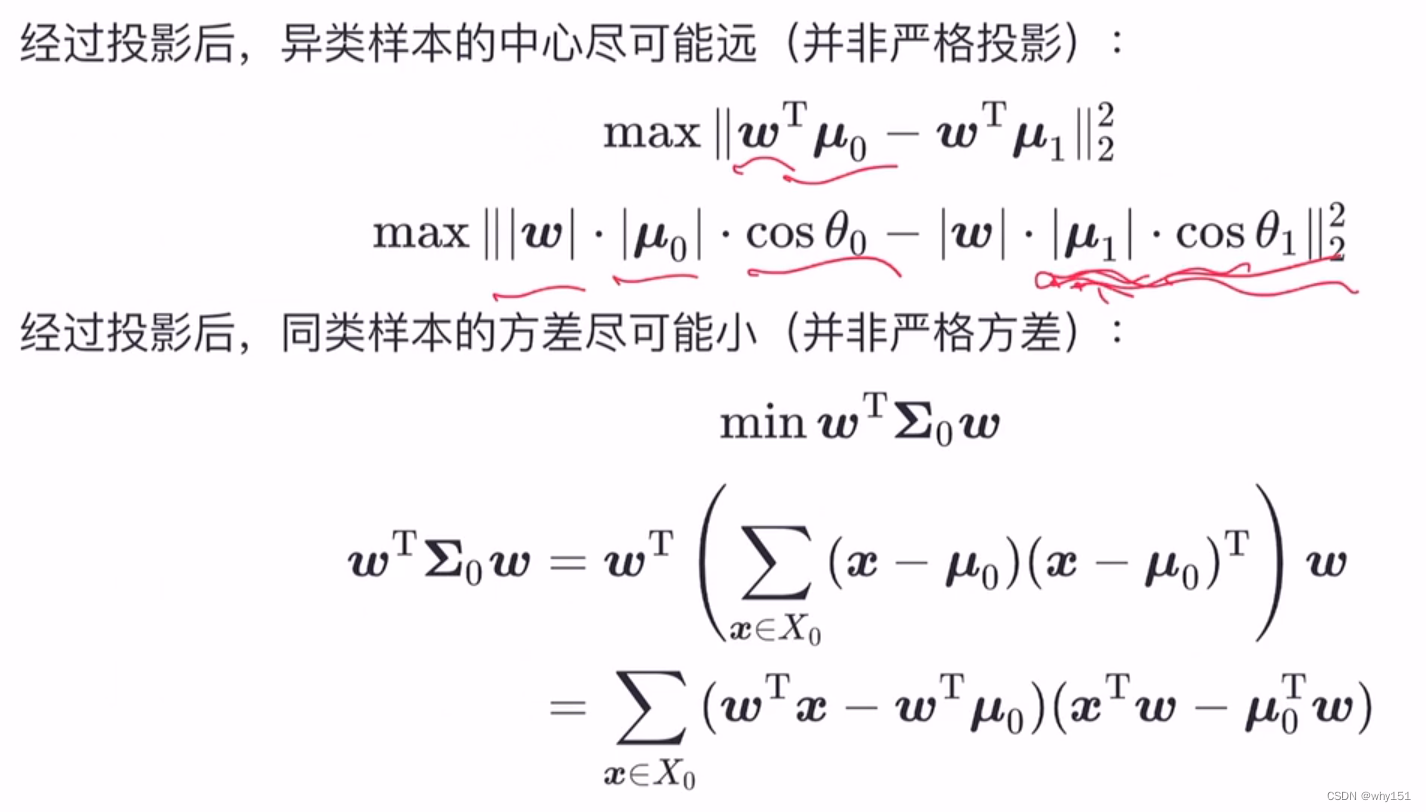

LDA思想:给定训练样例集,设法将样例投影到一条直线上,使得同类样例的投影点尽可能近(均值),异类尽可能远(方差)。

损失函数

二范数

a=(a1,a2)

∣

∣

a

∣

∣

2

a

=

(

a

1

2

+

a

2

2

)

2

||a||_2^a=(\sqrt{a_1^2+a_2^2})^2

∣∣a∣∣2a=(a12+a22)2

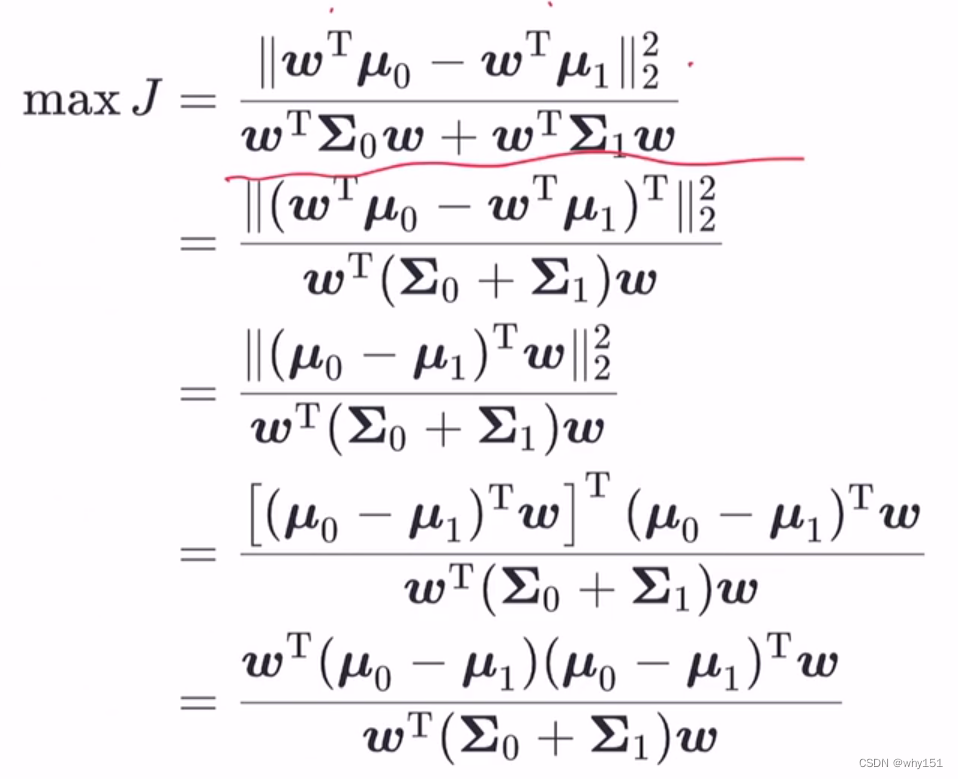

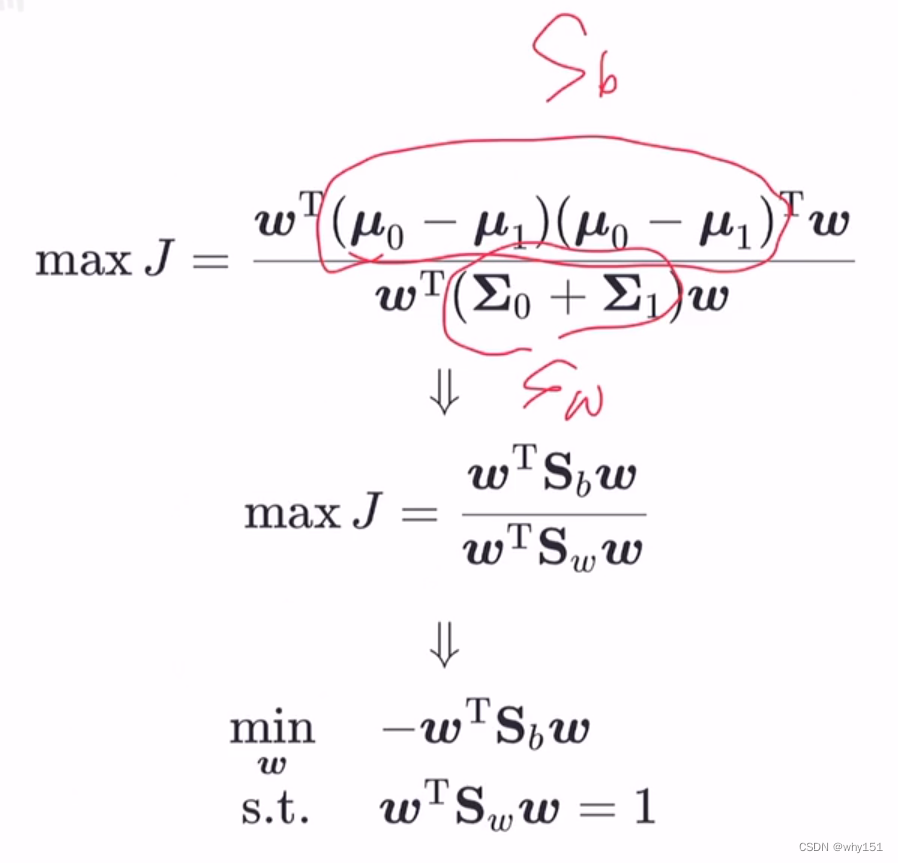

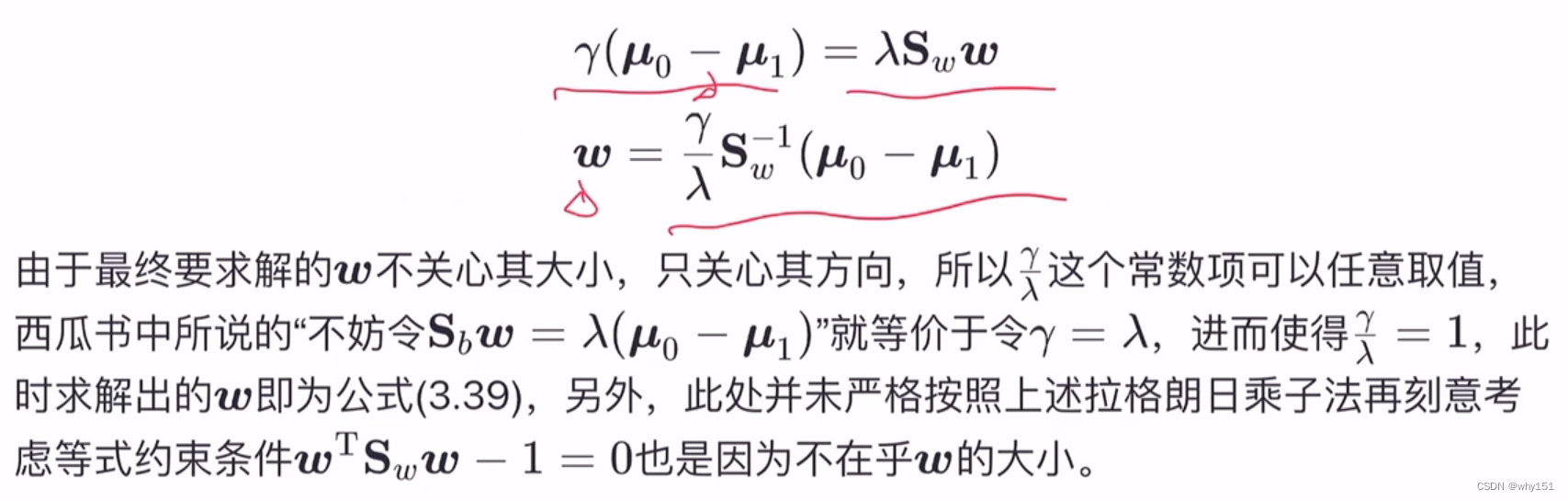

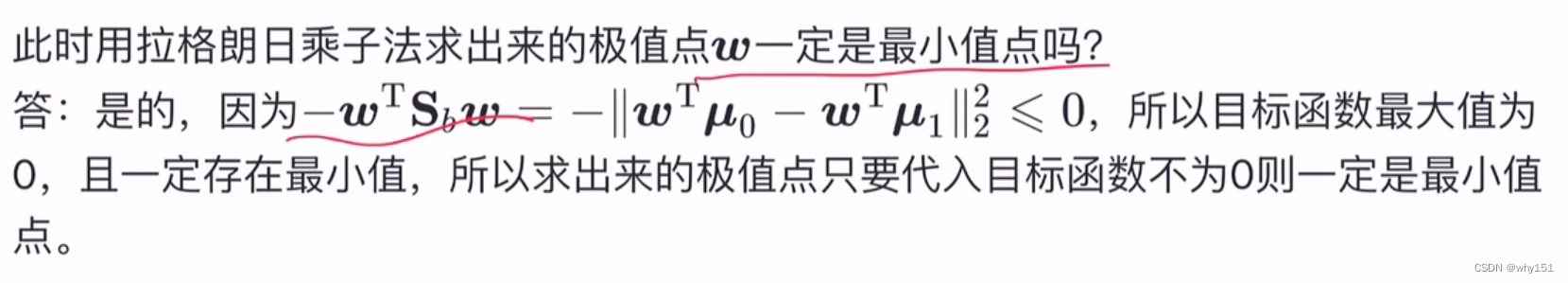

为什么上下的w不能约掉?因为要求解的就是w。

因为上下都有w是成比例的,没有唯一解,所以可以将分母固定为1(固定分子也行,等于其他数也行,习惯问题)。

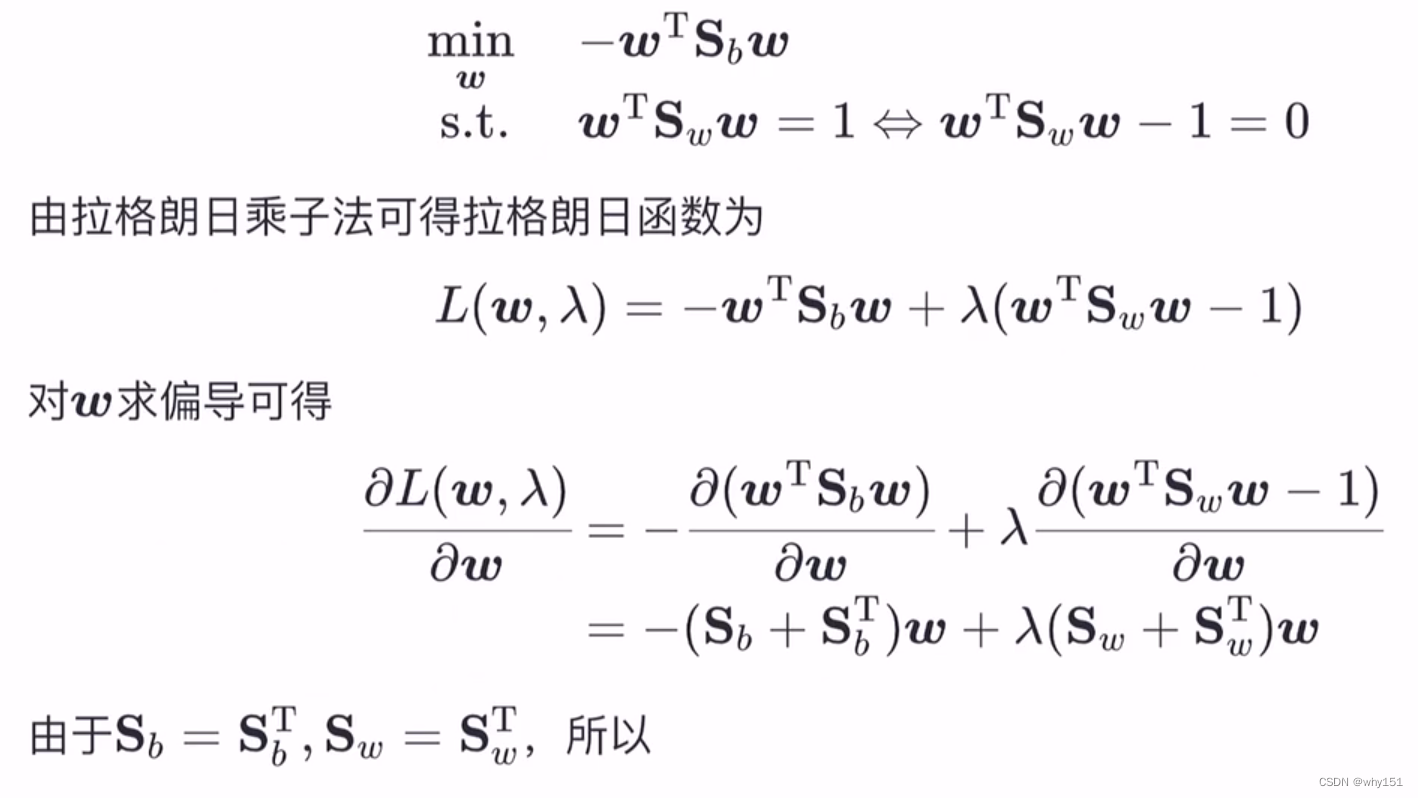

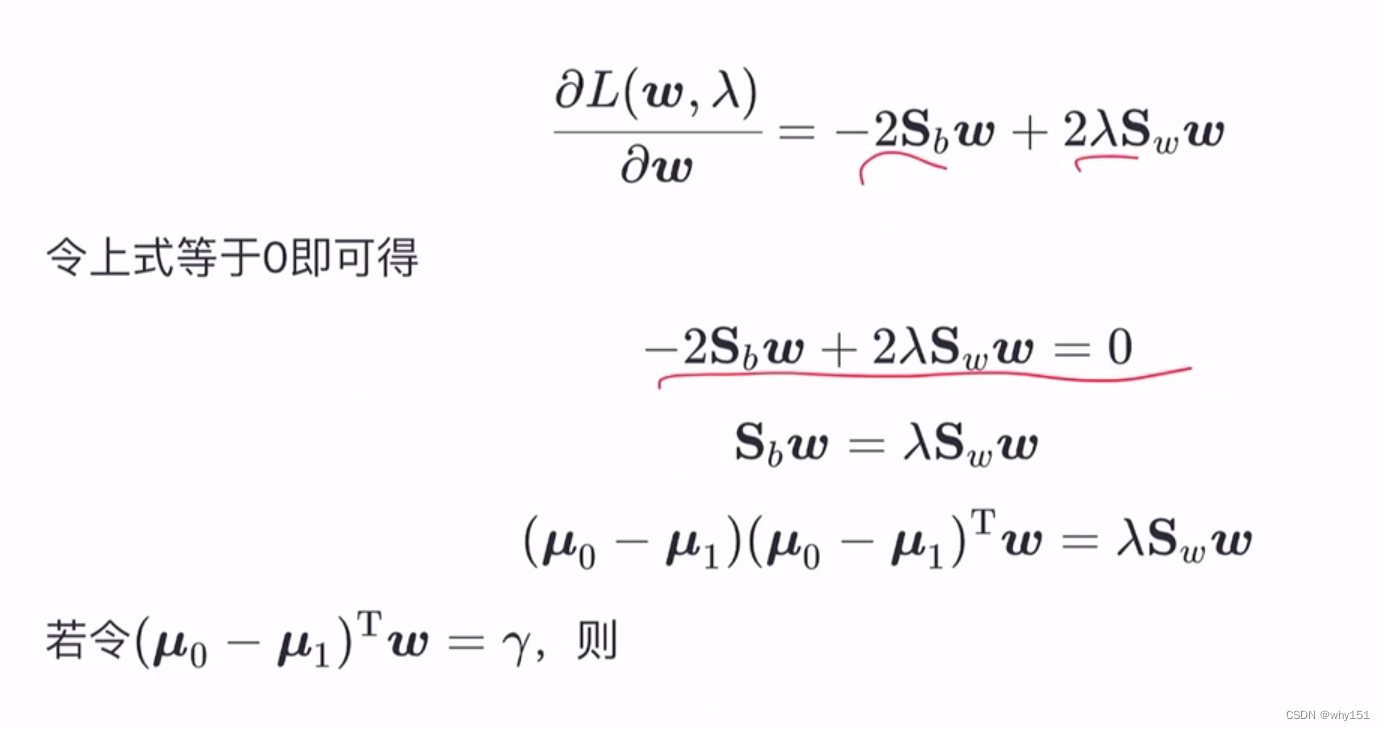

求解

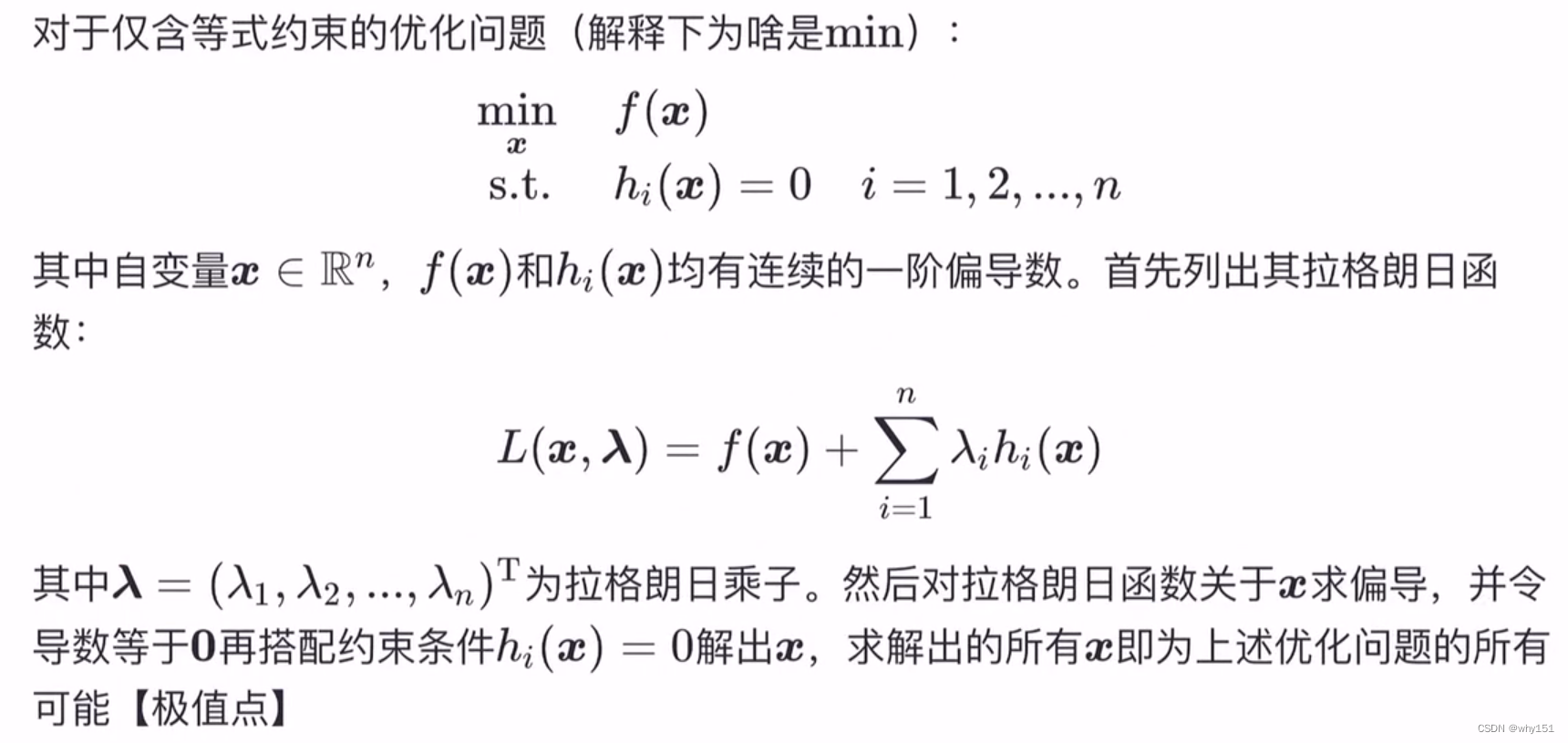

拉格朗日乘子法

查阅矩阵微分公式

为什么SB=SBT?SB SW为对称矩阵?SB:列向量乘转置矩阵就是对称的。SW协方差矩阵是对称的。

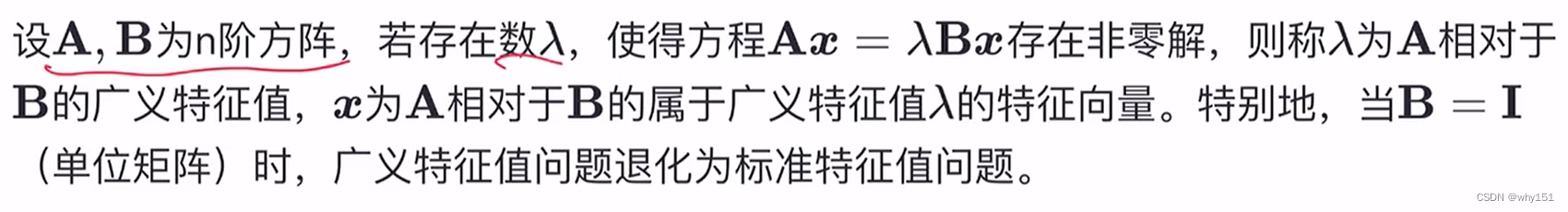

广义特征值

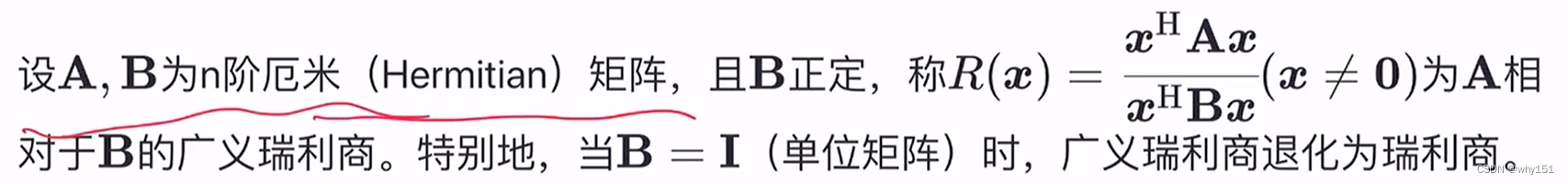

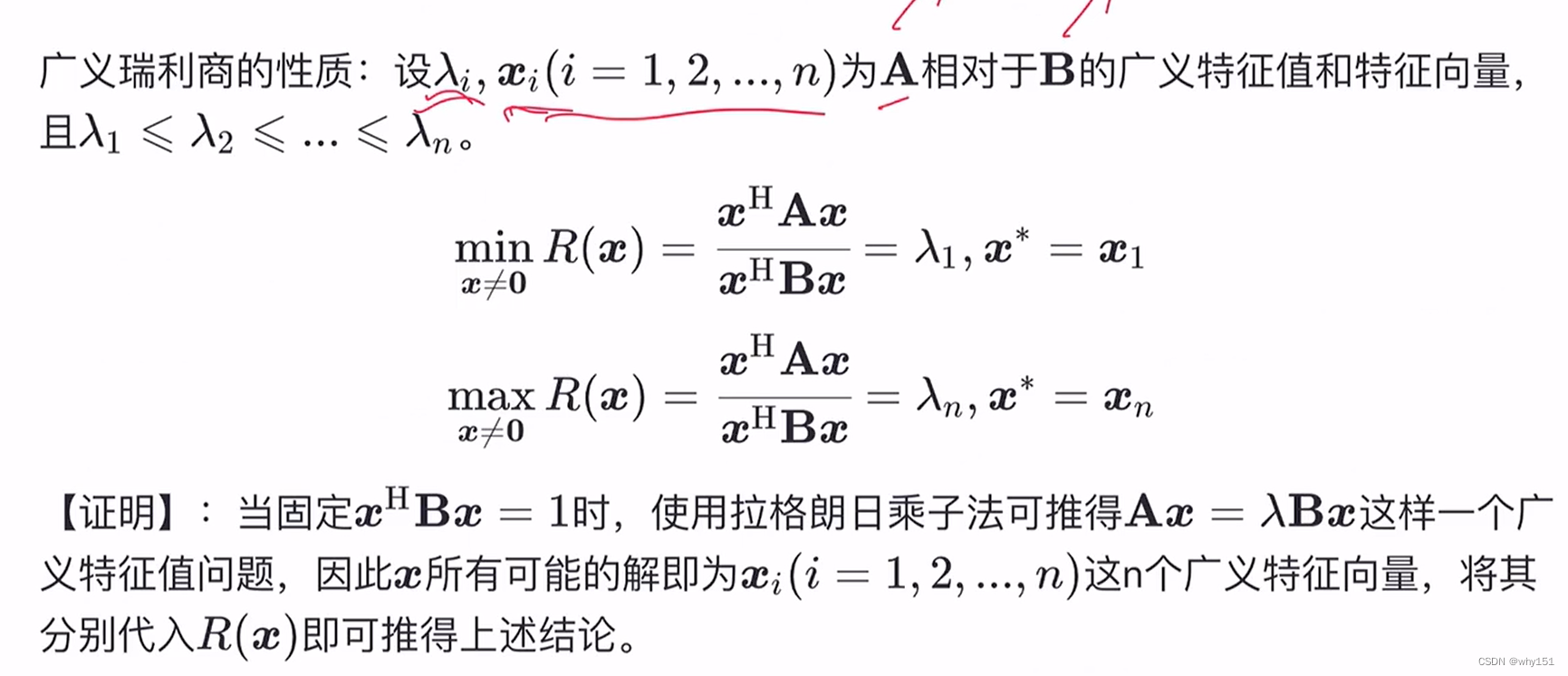

广义瑞利商

厄米矩阵:

多分类

一般是基于一些策略,利用二分类学习器解决多分类问题。

- 一对一:每两个类别训练一个分类器,总共训练n*(n-1)/2个,最后投票决定。

- 一对其余:使用一个类别为正例,其余均为反例。使用n个分类器进行分类,如果仅有一个分类器的结果为正例,那么就为该类别,否则取置信度最大的正例对应的类别。

- 多对多:正、反类必须构造出特殊的设计–纠错输出码。1.对N个类别做M次划分,训练M个分类器。2.将预测标记组成编码,分别利用M个分类器对每种类别进行预测,然后对新样本进行预测,看预测出来的序列与哪种类别距离最近。

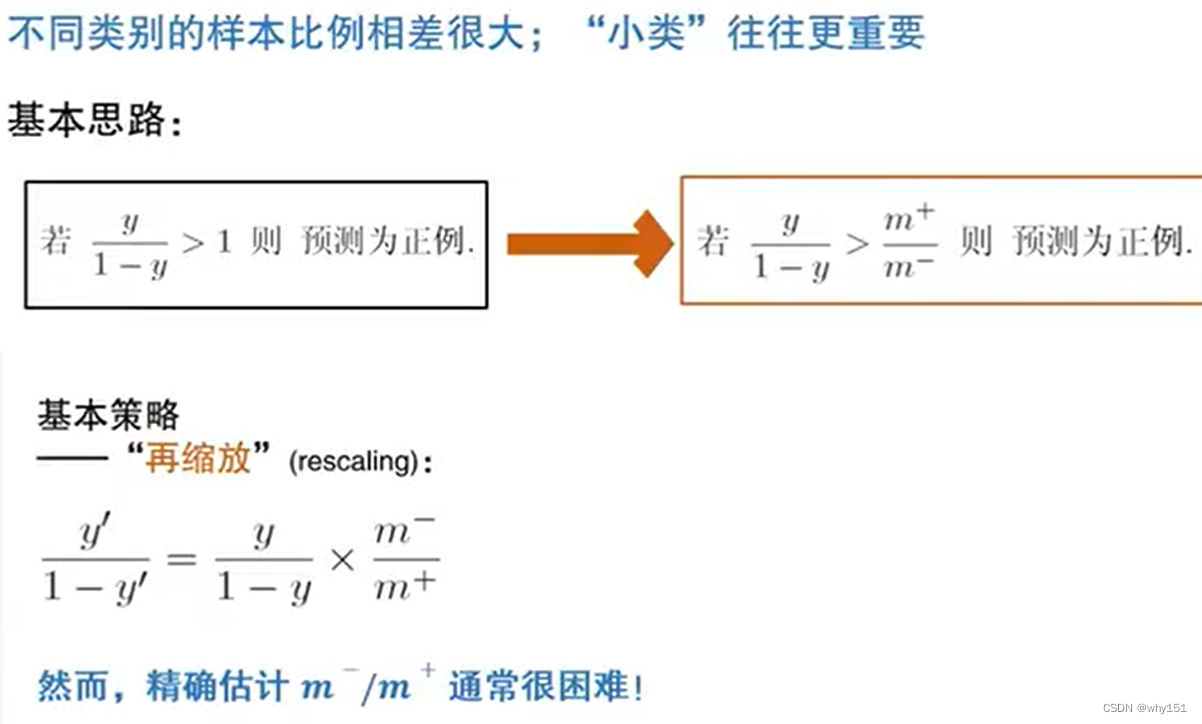

类别不平衡

什么时候处理类别不平衡?

小类很重要的时候。

平时分类隐含的是以0.5为分界,但是如果正负不同样比例的时候,需要改变。

但是,一般的数据都是总体的一部分,很难准确估计出来总体样本的类别比例。

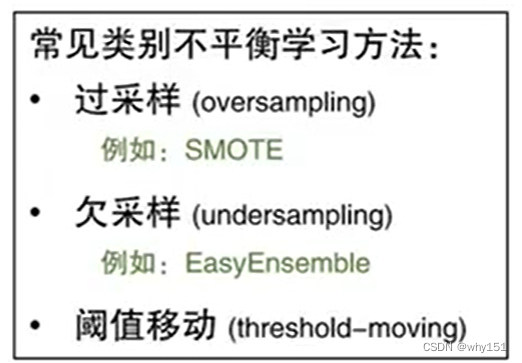

- 过采样:1.copy小类(会增大噪声的影响)2.SMOTE在两个小样本之间插值。

- 欠采样:1.丢掉一些样本(不确定会不会丢掉重要样本)2.EasyEnsemble集成学习的思想,每次从大类中选取和小类相同的样本数量,重复,最后投票。

- 阈值移动:(支持向量机)