【动手学习深度学习】逐行代码解析合集

05softmax回归简洁实现

视频链接:动手学习深度学习–softmax回归简洁实现

课程主页:https://courses.d2l.ai/zh-v2/

教材:https://zh-v2.d2l.ai/

代码

net.apply()若不懂可参考:

https://blog.csdn.net/qq_37025073/article/details/106739513

import torch

from torch import nn

from d2l import torch as d2l

import os

os.environ["KMP_DUPLICATE_LIB_OK"]="TRUE"

batch_size = 256

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)

"====================1、初始化模型参数===================="

# PyTorch不会隐式地调整输入的形状。因此,

# 我们在线性层前定义了展平层(flatten),来调整网络输入的形状

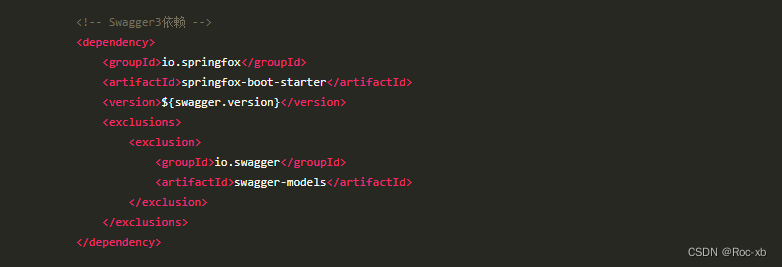

net = nn.Sequential(nn.Flatten(), nn.Linear(784, 10))

# net.apply若不懂可参考 https://blog.csdn.net/qq_37025073/article/details/106739513

def init_weights(m):

if type(m) == nn.Linear:

# m.weight默认为0,以均值为0方差为0.01来随机初始化权重

nn.init.normal_(m.weight, std=0.01)

# print(m.weight)

# net.apply(init_weights)会递归地将函数init_weights应用到父模块的每个子模块submodule,也包括model这个父模块自身。

net.apply(init_weights)

"====================2、重新审视Softmax的实现===================="

# reduction 参数用于控制输出损失的形式

# 当 reduction='none' 时,函数会输出一个形状为 (batch_size, num_classes) 的矩阵,表示每个样本的每个类别的损失。

# 当 reduction='sum' 时,函数会对矩阵求和,输出一个标量,表示所有样本的损失之和。

# 当 reduction='elementwise_mean' 时,函数会对矩阵求平均,输出一个标量,表示所有样本的平均损失。

loss = nn.CrossEntropyLoss(reduction='none')

"====================3、优化算法===================="

# torch.optim.SGD:随机梯度下降算法

# net.parameters():即传入要训练的参数

trainer = torch.optim.SGD(net.parameters(), lr=0.1)

"====================4、训练===================="

num_epochs = 10

# 调用之前定义的 训练函数 来训练模型

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, trainer)

d2l.plt.show()

运行结果