K折交叉验证

news2026/3/29 22:15:21

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/701784.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

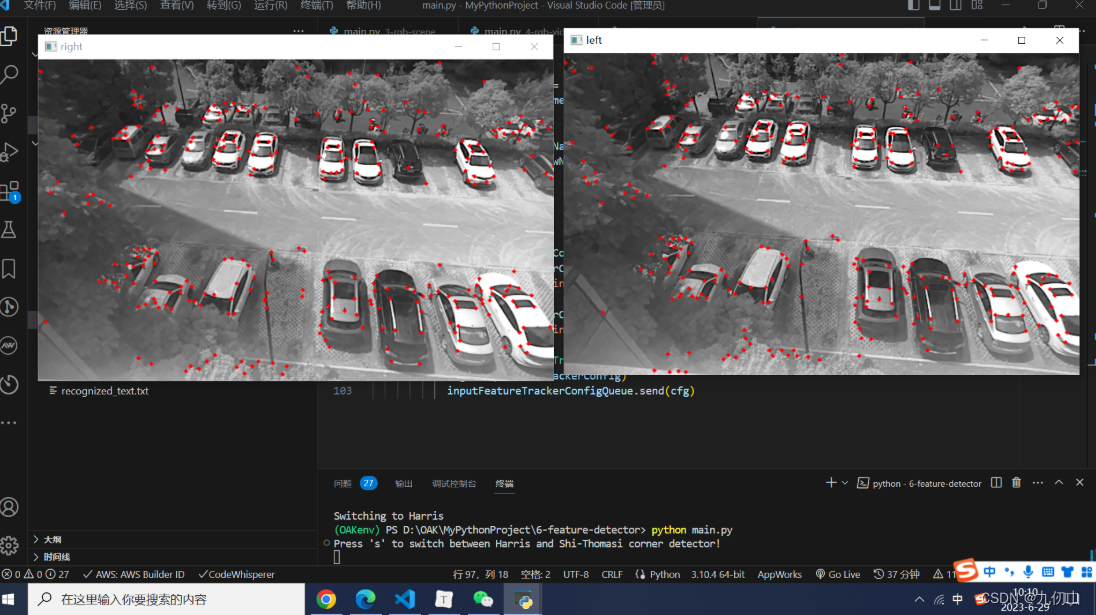

一步一步学OAK之六:通过OAK相机实现特征检测

目录 特征检测Setup 1: 创建文件Setup 2: 安装依赖Setup 3: 导入需要的包Setup 4: 创建pipelineSetup 5: 创建节点创建相机节点创建特征检测节点创建数据交互的节点 Setup 6:设置相关属性设置相机的相关属性设置特征检测器的初始配置 Setup 7: 建立链接关系建立相机和特征跟踪器…

iOS 16 版本适配

1、iOS 16 真机调试时需要在设备的设置 —> 隐私与安全 —> 开发者模式 中打开开发者模式。

2、隐私权限增强,如通过 UIDevice 获取设备名称时,无法获取用户的信息,只能获取设备对应的名称([UIDevice currentDevice].name返…

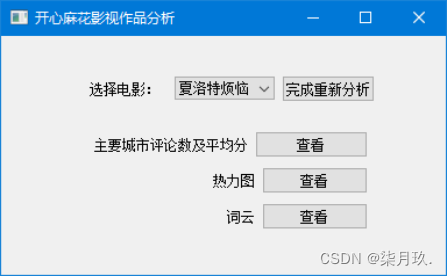

基于Python所写的影视作品分析设计

点击以下链接获取源码资源: https://download.csdn.net/download/qq_64505944/87964875 《开心麻花影视作品分析》程序使用说明 在PyCharm中运行《开心麻花影视作品分析》即可进入如图1所示的系统主界面。在该界面中,选择要分析的电影名称,然…

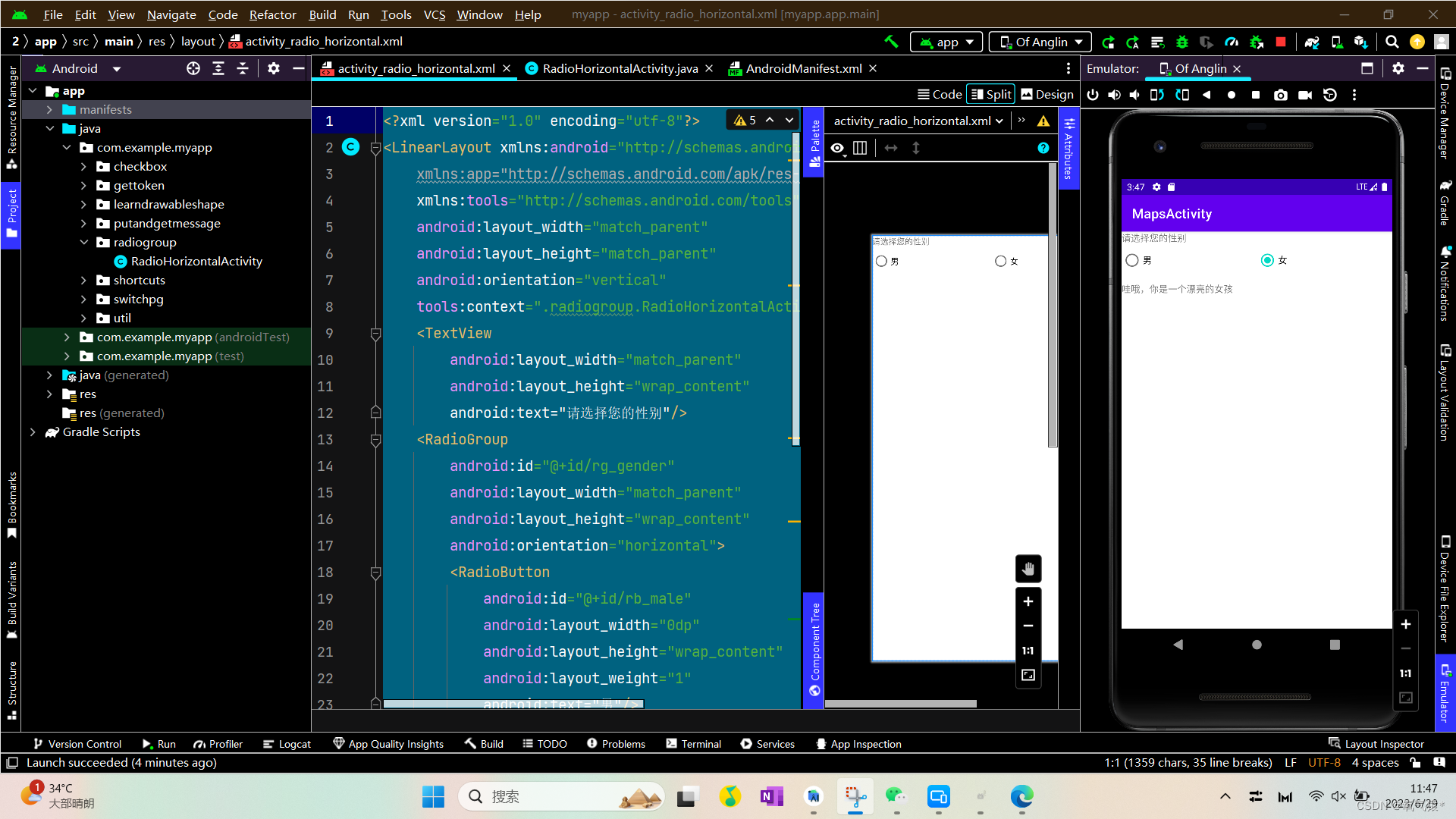

android:RadioGroup的使用

一、前言:工作中会遇到勾选不同的类型,获得不同的数据。仅以此笔记记录。

二、上代码:

新建一个Activity

public class RadioHorizontalActivity extends AppCompatActivity implements RadioGroup.OnCheckedChangeListener {private Text…

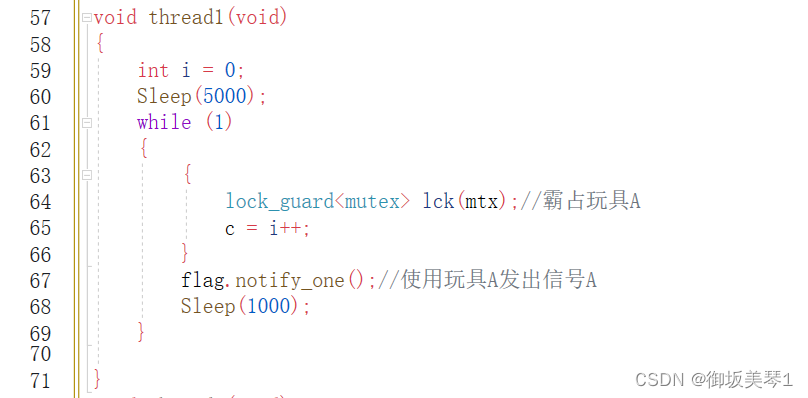

线程并发同步--条件变量--conditional_variable

同步:我的线程完成之后,你在进行下一个线程。可以理解为进货和卖货,即只有进或的线程结束后才可以执行卖货的这个线程。 c中提供了一个工具:conditional_variable。实现有两种方式,一种是condition_variable和conditon…

[java]Redis

关于Redis

Redis是一款基于内存的,使用K-V结构存储数据的NoSQL非关系型数据库。 基于内存的:Redis读写数据时,都是在内存中进行读写的,所以,读写效率非常高!另外,Redis会自动的将所管理的数据同…

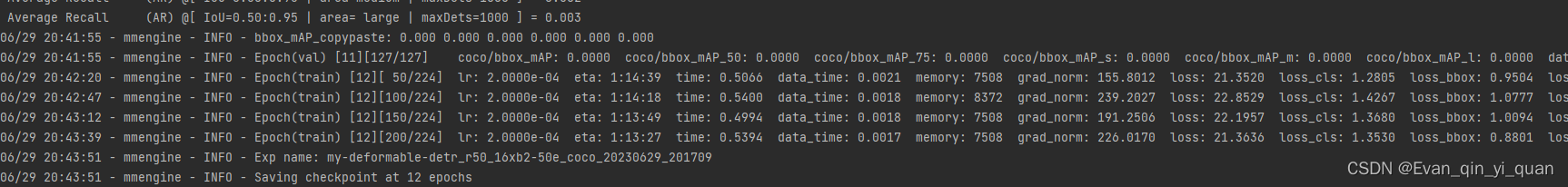

mmdetection自定义数据集训练

目录

1. 源码下载,本文基于v3.0版本 2.选模型训练

2.1 先生成后面用于编译的配置文件 2.2.1 修改coco.py 2.2.2 修改class_names.py

3. 训练配置 4. 训练过程展示 1. 源码下载,本文基于v3.0版本

GitHub - open-mmlab/mmdetection: OpenMMLab Detec…

图-深度优先搜索与广度优先搜索

图

在现实生活中,有许多应用场景会包含很多点以及点点之间的连接,而这些应用场景我们都可以用即将要学习的图 这种数据结构去解决

地图 我们生活中经常使用的地图,基本上是由城市以及连接城市的道路组成,如果我们把城市看做是一…

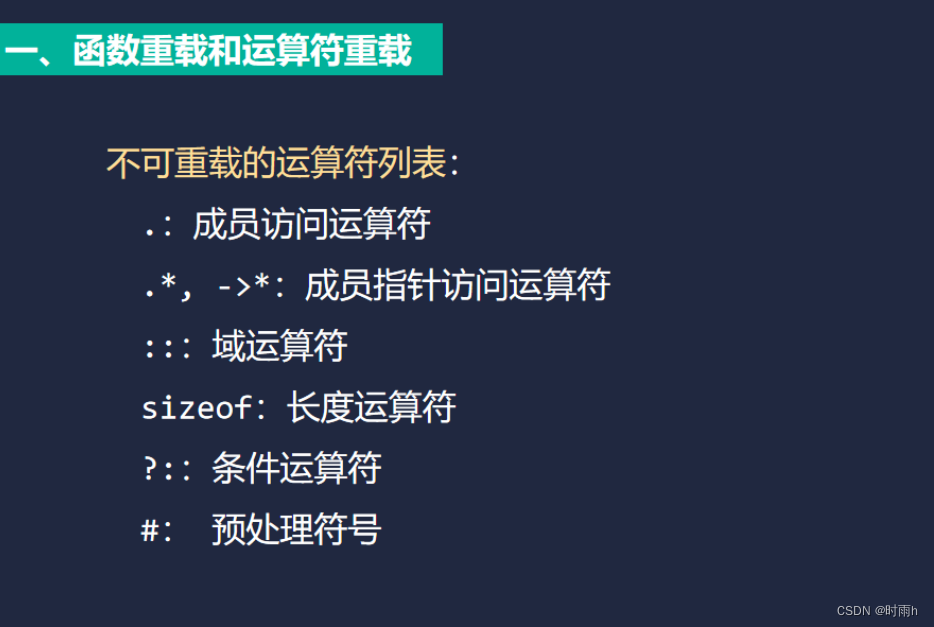

西安石油大学 C++期末考试 重点知识点+题目复习(上)

第一章

“const”关键字的用法

当使用 const 修饰变量、函数参数、成员函数以及指针时,以下是一些代码示例:

声明只读变量:

const int MAX_VALUE 100;

const float PI 3.14;保护函数参数:

void printArray(const int arr[]…

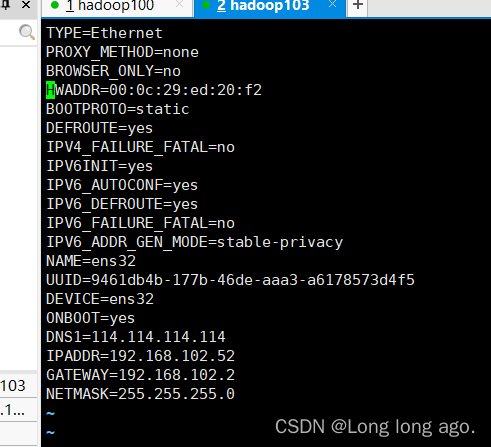

解决vmware虚拟机,克隆修改ip后,xshell连接不上问题

1、查看网卡

ifconfig2、修改网卡配置

vim /etc/sysconfig/network-scripts/ifcfg-ens32 改成与上图一样 修改后

3、重启reboot则解决

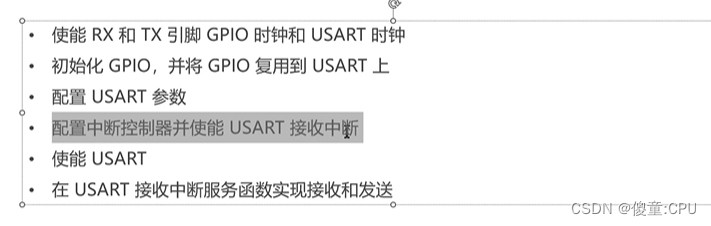

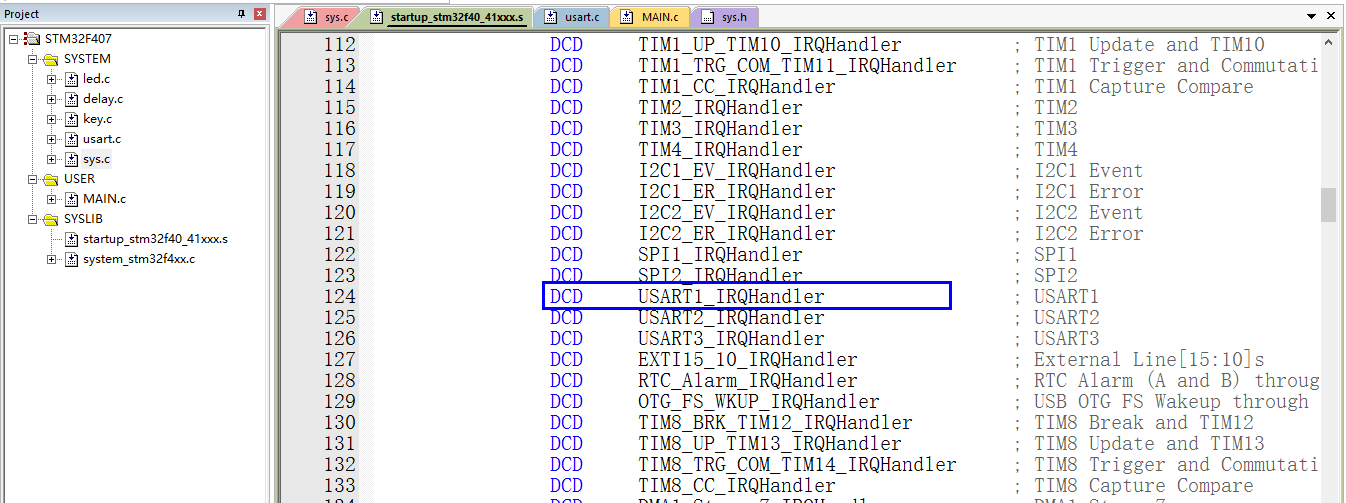

STM32F407 串口配置步骤

介绍STM32F407串口配置步骤,完成串口的数据发送与接收、实现中断接收,支持printf重定向。

STM32F407 串口配置说明

STM32F4 的串口资源相当丰富的,功能也相当强劲,STM32F407ZGT6 最多可提供 6 路串口,有分数波特率发…

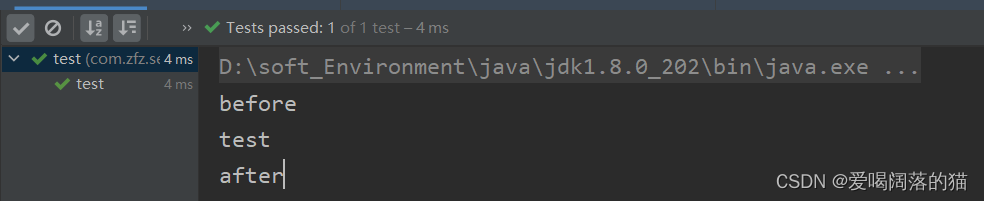

【Junit 单元测试】

Junit 单元测试 笔记记录 1. Junit介绍2. 使用Junit3. 常用注解4. 断言使用 1. Junit介绍 2. 使用Junit

1.导入依赖 <dependency><groupId>junit</groupId><artifactId>junit</artifactId><version>4.12</version><scope>tes…

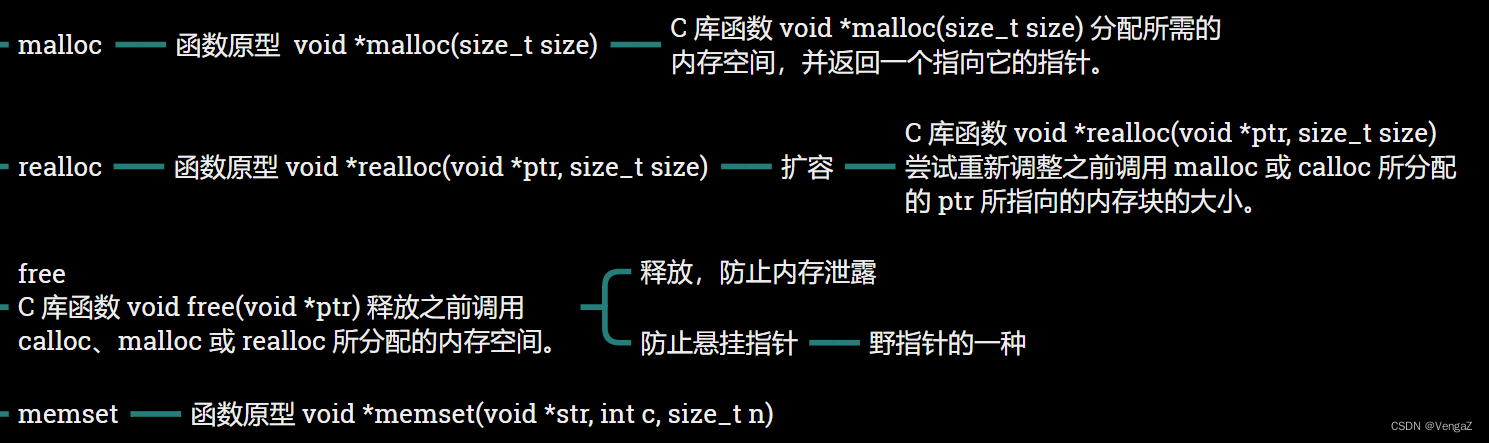

C语言-基础语法学习-4 字符串

目录 字符串C语言字符串及相关函数定义字符数组和字符串的区别sizeof()和strlen()的区别动态开辟字符串野指针常用字符串函数 字符串

C语言字符串及相关函数

在C语言中,字符串是由字符数组表示的一系列字符序列。C语言提供了一些函数来处理字符串,使我…

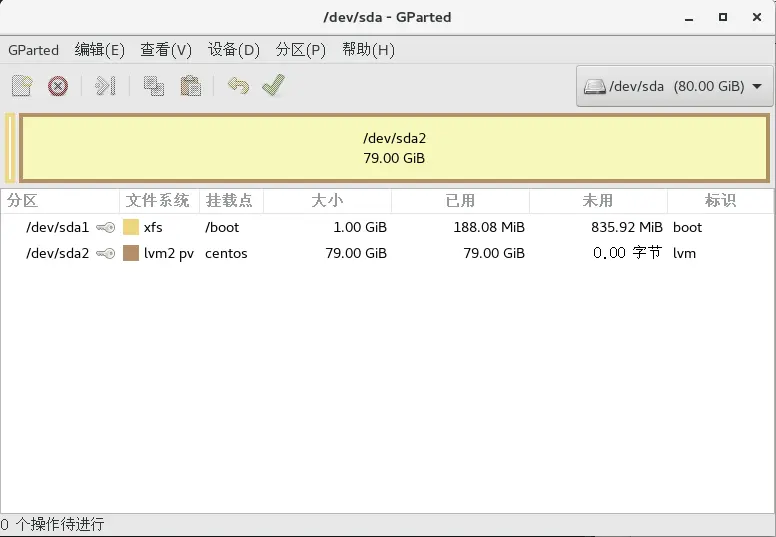

centos磁盘扩容

解释

PE - 物理块(Physical Extent) 硬盘上有很多实际物理存在的存储块PV - 物理卷 (Physical Volume) 物理卷处于最底层,它可以是实际物理硬盘上的分区,也可以是整个物理硬盘(相当于单独做一个分区)&…

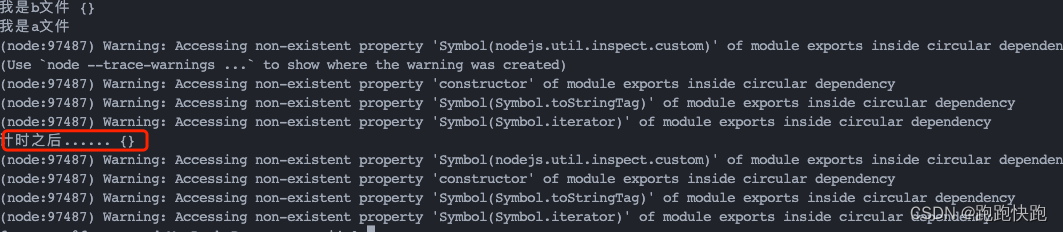

CommonJS 和 ES6 module

本文主要自己觉得要记录的点记录下来,不耽误大家时间,会持续更新。

Module对象

Module {id: xxx/demo/1.js, //加载文件的绝对路径path: xxx/demo,// 加载文件所在目录的绝对路径exports: [Function (anonymous)],filename: xxx/demo/1.js,加载文件的绝对路径load…

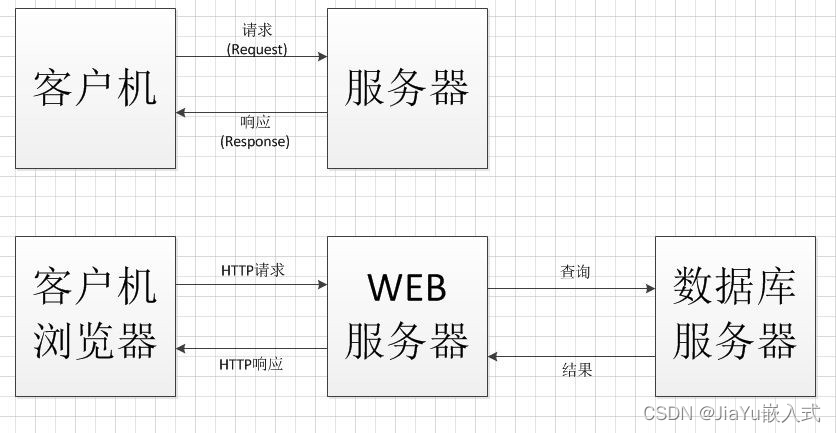

B/S和C/S详解(嵌入式学习)

B/S和C/S详解 1. C/S1.1 概念1.2 C/S架构的特点 2. B/S2.1 概念2.2 B/S架构的特点2.3 相对于传统的C/S架构的优势 3. B/S架构详解4. B/S架构怎么用(CGI、Lighttpd) 1. C/S

1.1 概念

C/S(Client/Server)是一种计算机网络架构模式…

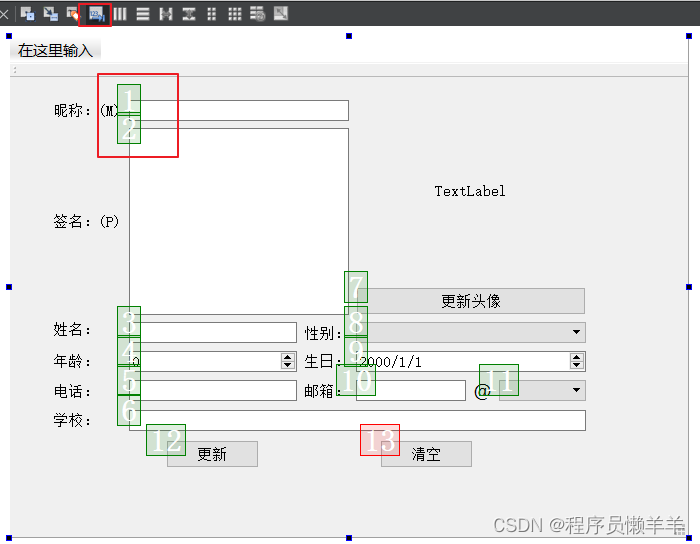

【C++】 Qt-页面布局

文章目录 布局组件和布局按钮练习-用户信息页面布局准备工作设置性别设置年龄设置生日设置邮箱后缀 设置头像创建文件写入文件清空表单信息Buddy(伙伴)关系Tab顺序 布局组件和布局按钮

Qt的UI设计器中提供了丰富的布局管理功能,组件面板里有…

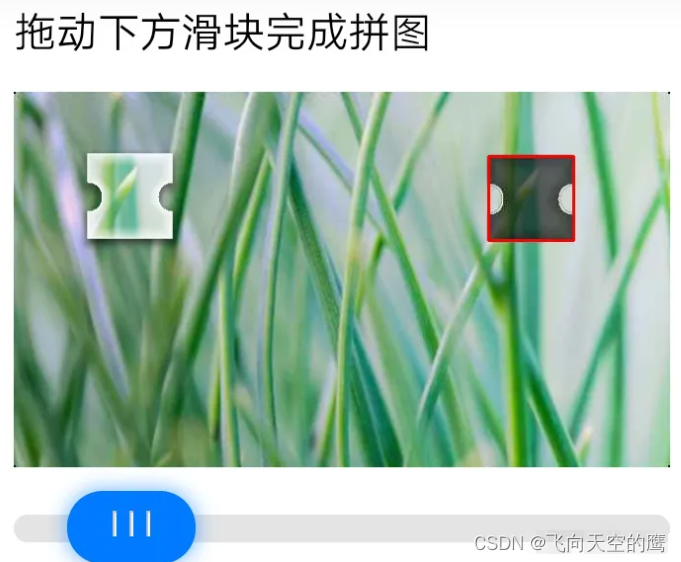

高效简单解决滑动验证码

前言

做爬虫总会遇到各种各样的反爬限制,其中移动验证码是很重要且常见的一环,今天总结下如何高效破解他的方法,例如下图:

解决思路与方法

首先先来分析下,核心问题其实是要怎么样找到目标缺口的位置,一…

Windows服务启动exe无界面终极解决方案

1、前言 我这个方案(C#操作)是彻底解决【从Windows服务启动程序exe,程序无界面】问题的终极解决方案,终极方案,绝对的终极方案,本来打算收钱的,还是算了,你们也不容易,关…

![[java]Redis](https://img-blog.csdnimg.cn/e71546823b7546308a79c2052bd4731b.png)