🤵♂️ 个人主页:@Lingxw_w的个人主页

✍🏻作者简介:计算机科学与技术研究生在读

🐋 希望大家多多支持,我们一起进步!😄

如果文章对你有帮助的话,

欢迎评论 💬点赞👍🏻 收藏 📂加关注+

目录

1、常见的链路预测方法

2、图神经网络上的链路预测

3、使用PyTorch和DGL库实现图神经网络进行链路预测

链路预测是指在一个给定的网络中,根据已有的网络结构信息,尝试预测两个节点之间是否存在连接或者可能会建立连接的概率。这在社交网络分析、生物信息学、推荐系统等领域中都有广泛的应用。

在复杂网络中,链路预测可以帮助我们理解网络的演化过程、发现隐藏的关系和未知的连接,以及预测未来的网络演化趋势。

1、常见的链路预测方法

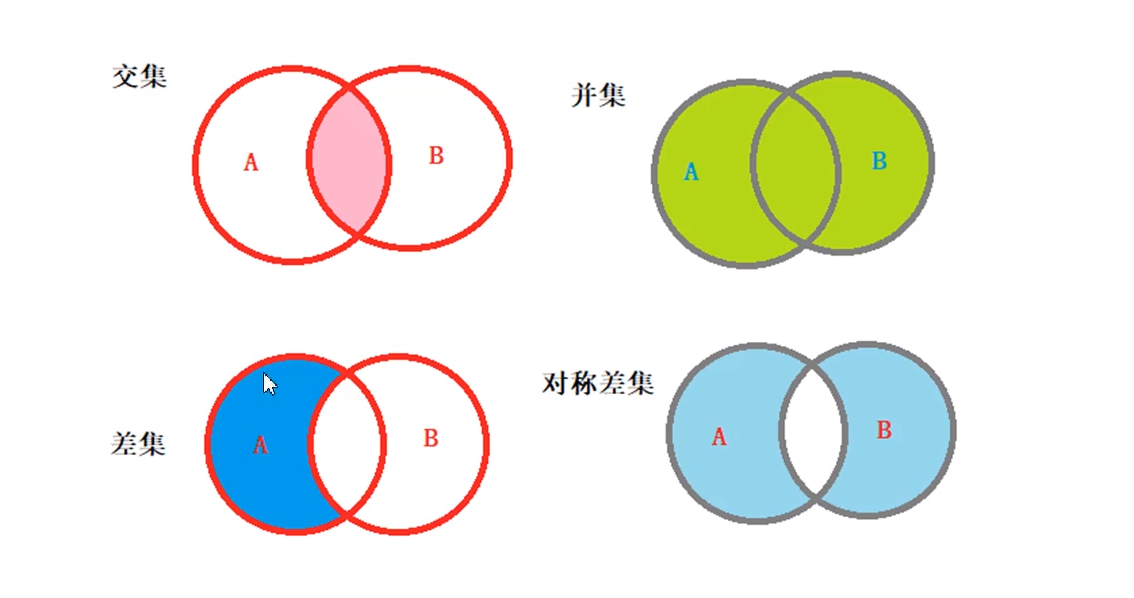

基于相似性的方法:这类方法假设具有相似性的节点之间更有可能存在连接。常见的相似性度量方法包括共同邻居数、Jaccard系数、Adamic/Adar指数等。

基于路径的方法:这类方法考虑节点之间的路径信息,比如最短路径、随机游走路径等。通过分析节点之间的路径特征,可以预测节点间的连接概率。

基于机器学习的方法:这类方法使用机器学习算法来建模和预测网络中的链路。常见的机器学习算法包括决策树、随机森林、支持向量机(SVM)、神经网络等。

基于深度学习的方法:这是近年来兴起的一种方法,使用深度学习模型(如图神经网络)来学习节点的表征,并通过这些表征来进行链路预测。

链路预测并非一种绝对准确的预测方法,因为网络的演化和连接行为具有一定的随机性。

2、图神经网络上的链路预测

图神经网络(Graph Neural Networks,简称GNN)可以用于链路预测任务。GNN是一类专门用于处理图结构数据的深度学习模型,能够学习节点和边的特征表示,并在此基础上进行预测任务。

步骤:

图表示构建:首先,将原始的网络数据表示为图结构,其中节点表示网络中的实体(如用户、物品),边表示节点之间的连接关系(如关注、交互)。

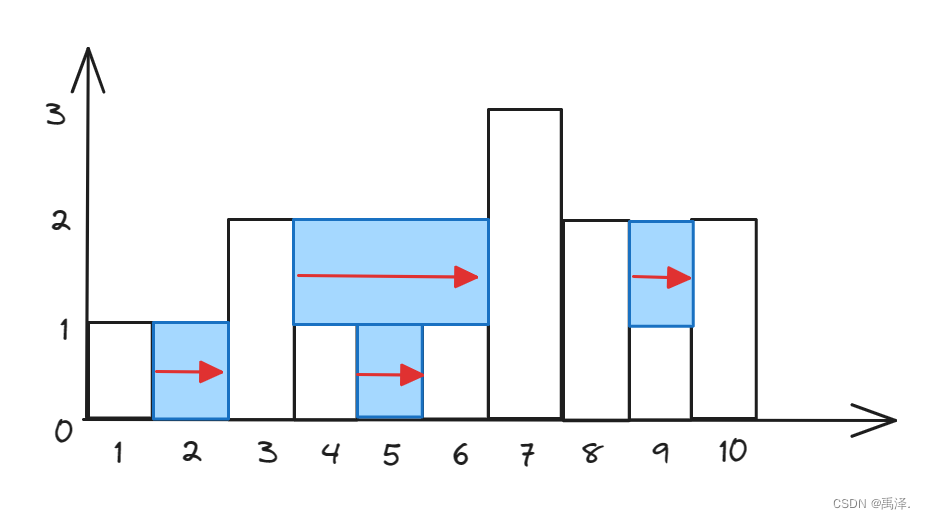

节点表征学习:GNN通过多轮的消息传递和聚合操作,从节点和边的特征中学习节点的表征。这样,每个节点都会得到一个向量表示,用于捕捉其在网络中的特征和上下文信息。

边预测模型构建:在节点表征学习的基础上,可以构建一个边预测模型来预测节点之间的连接概率。一种常见的方法是使用一个全连接层或多层感知机(MLP)来将节点表征映射到一个预测分数或概率。可以使用二元分类任务来预测节点间是否存在连接,或者使用回归任务来预测连接的强度或权重。

模型训练和评估:使用已知的网络结构数据进行模型的训练,并通过验证集或交叉验证进行模型的选择和调优。评估时,可以使用一些常见的指标,如准确率、精确度、召回率、F1分数等来评估链路预测的性能。

3、使用PyTorch和DGL库实现图神经网络进行链路预测

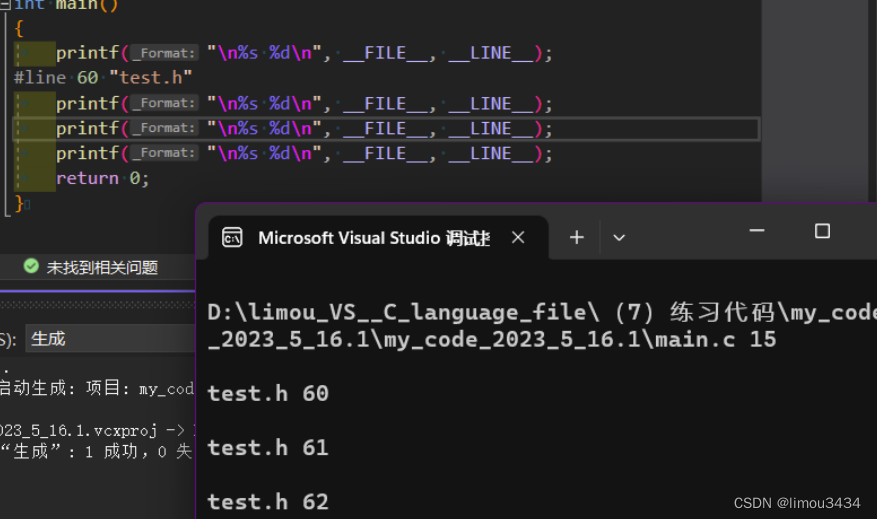

导入必要的库,包括PyTorch和DGL。

import torch

import torch.nn as nn

import dgl定义图神经网络模型 GNNLinkPredict,模型包含两个图卷积层,输入特征维度为2,输出特征维度为1。

# 定义图神经网络模型

class GNNLinkPredict(nn.Module):

def __init__(self, in_feats, hidden_size, out_feats):

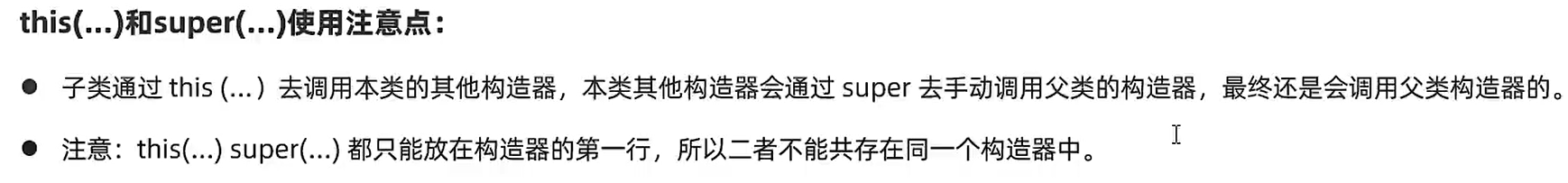

super(GNNLinkPredict, self).__init__()

self.conv1 = dgl.nn.GraphConv(in_feats, hidden_size)

self.conv2 = dgl.nn.GraphConv(hidden_size, out_feats)

def forward(self, g, features):

x = torch.relu(self.conv1(g, features))

x = torch.relu(self.conv2(g, x))

return x创建示例图数据 g,其中包括5个节点和7条边。定义节点特征 features,每个节点有两个特征值。定义标签 labels,表示边的连接情况。

# 构建示例图数据

# 创建一个有向图

g = dgl.DGLGraph()

g.add_nodes(5)

g.add_edges([0, 0, 0, 1, 1, 2, 3], [1, 2, 3, 2, 4, 3, 4])

# 定义节点特征

features = torch.tensor([

[0.2, 0.4],

[0.3, 0.5],

[0.4, 0.6],

[0.5, 0.7],

[0.6, 0.8]

])

# 定义标签(边是否存在连接)

labels = torch.tensor([1, 1, 1, 0, 0, 1, 0], dtype=torch.float32)

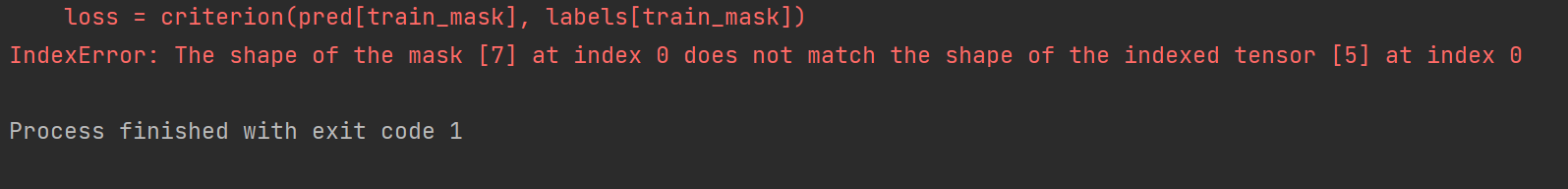

划分训练集和测试集,使用布尔类型的掩码 train_mask 和 test_mask 表示。

# 划分训练集和测试集

train_mask = torch.tensor([True, True, True, False, False])

test_mask = torch.tensor([False, False, False, True, True])

创建图神经网络模型实例 model。

定义优化器和损失函数,这里使用Adam优化器和二分类的交叉熵损失函数。

# 创建图神经网络模型

model = GNNLinkPredict(in_feats=2, hidden_size=16, out_feats=1)

# 定义优化器和损失函数

optimizer = torch.optim.Adam(model.parameters(), lr=0.01)

criterion = nn.BCEWithLogitsLoss()进行模型训练。循环迭代多个epoch,在每个epoch中执行以下步骤

- 将模型设置为训练模式

model.train()。- 前向传播计算预测结果

logits。- 计算预测结果与标签之间的损失。

- 清空优化器的梯度。

- 反向传播计算梯度。

- 更新模型参数。

# 训练模型

for epoch in range(50):

model.train()

logits = model(g, features)

pred = logits.squeeze()

loss = criterion(pred[train_mask], labels[train_mask])

optimizer.zero_grad()

loss.backward()

optimizer.step()

# 打印训练损失

print(f"Epoch: {epoch + 1}, Loss: {loss.item()}")在测试集上评估模型。将模型设置为评估模式 model.eval(),然后使用训练好的模型对测试集进行预测。通过将预测结果应用sigmoid函数将其映射到0-1之间,并使用四舍五入将其转换为0或1的预测标签。计算预测准确率并输出。

# 在测试集上评估模型

model.eval()

with torch.no_grad():

logits = model(g, features)

pred = logits.squeeze()

pred = torch.sigmoid(pred) # 使用sigmoid函数将预测值映射到0-1之间

pred_labels = torch.round(pred) # 四舍五入为0或1的预测标签

accuracy = (pred_labels[test_mask] == labels[test_mask]).float().mean()

print(f"Accuracy: {accuracy.item()}")汇总的代码:

# https://www.dgl.ai/pages/start.html

import torch

import torch.nn as nn

import dgl

# 定义图神经网络模型

class GNNLinkPredict(nn.Module):

def __init__(self, in_feats, hidden_size, out_feats):

super(GNNLinkPredict, self).__init__()

self.conv1 = dgl.nn.GraphConv(in_feats, hidden_size)

self.conv2 = dgl.nn.GraphConv(hidden_size, out_feats)

def forward(self, g, features):

x = torch.relu(self.conv1(g, features))

x = torch.relu(self.conv2(g, x))

return x

# 构建示例图数据

# 创建一个有向图

g = dgl.DGLGraph()

g.add_nodes(5)

g.add_edges([0, 0, 0, 1, 1, 2, 3], [1, 2, 3, 2, 4, 3, 4])

# 添加自环

g = dgl.add_self_loop(g)

# 定义节点特征

features = torch.tensor([

[0.2, 0.4],

[0.3, 0.5],

[0.4, 0.6],

[0.5, 0.7],

[0.6, 0.8]

])

# 定义标签(边是否存在连接)

labels = torch.tensor([1, 1, 1, 0, 0, 1, 0], dtype=torch.float32)

# 划分训练集和测试集

train_mask = torch.tensor([True, True, True, False, False, False, False])

test_mask = torch.tensor([False, False, False, True, True, True, True])

# 创建图神经网络模型

model = GNNLinkPredict(in_feats=2, hidden_size=16, out_feats=1)

# 定义优化器和损失函数

optimizer = torch.optim.Adam(model.parameters(), lr=0.01)

criterion = nn.BCEWithLogitsLoss()

# 训练模型

for epoch in range(50):

model.train()

logits = model(g, features)

pred = logits.squeeze()

loss = criterion(pred[train_mask], labels[train_mask])

optimizer.zero_grad()

loss.backward()

optimizer.step()

# 打印训练损失

print(f"Epoch: {epoch + 1}, Loss: {loss.item()}")

# 在测试集上评估模型

model.eval()

with torch.no_grad():

logits = model(g, features)

pred = logits.squeeze()

pred = torch.sigmoid(pred) # 使用sigmoid函数将预测值映射到0-1之间

pred_labels = torch.round(pred) # 四舍五入为0或1的预测标签

accuracy = (pred_labels[test_mask] == labels[test_mask]).float().mean()

print(f"Accuracy: {accuracy.item()}") 留下个问题有空再解决。

关于复杂网络建模,我前面写了很多,大家可以学习参考。

【复杂网络建模】——常用绘图软件和库_图论画图软件

【复杂网络建模】——Pytmnet进行多层网络分析与可视化

【复杂网络建模】——Python通过平均度和随机概率构建ER网络

【复杂网络建模】——通过图神经网络来建模分析复杂网络

【复杂网络建模】——Python可视化重要节点识别(PageRank算法)

【复杂网络建模】——基于Pytorch构建图注意力网络模型

【复杂网络建模】——基于微博数据的影响力最大化算法(PageRank)