>>>深度学习Tricks,第一时间送达<<<

🎄🎄近期,小海带在空闲之余,收集整理了一批3D公共数据集供大家参考。 整理不易,小伙伴们记得一键三连喔!!!🎈🎈

目录

一、nuScenes数据集🎄🎈

二、Lyft L5数据集🎄🎈

三、Argoverse数据集🎄🎈

四、Matterport3D数据集🎄🎈

关于YOLO算法改进及论文投稿可关注并留言博主的CSDN/QQ

>>>一起交流!互相学习!共同进步!<<<

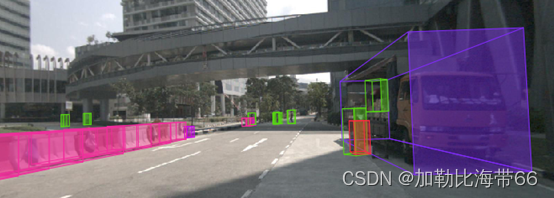

一、nuScenes数据集🎄🎈

简介:nuScenes是自动驾驶领域最重要的数据集之一,相比KITTI数据集,nuScenes规模更大,同时记录了雷达数据(采集自Radar)。数据集由1000个场景组成,每个场景长度为20秒。在每一个场景中,有40个关键帧,也就是每秒有2个关键帧,其他的帧为sweeps。关键帧经过手工的标注,每一帧中都包含若干个annotation,标注的形式为bounding box,不仅标注了大小、范围、还有类别、可见程度等。这个数据集在样本的数量上、标注的形式上都非常好,记录了车的自身运动轨迹(相对于全局坐标),包含了非常多的传感器,可以用来实现更加智慧的识别算法和感知融合算法。

数据集链接:https://www.nuscenes.org/nuscenes#overview

二、Lyft L5数据集🎄🎈

简介:Lyft L5是一整套L5级自动驾驶数据集,据称“业内最大的自动驾驶公共数据集”,涵盖了Prediction Dataset及Perception Dataset。其中Prediction Dataset涵盖了自动驾驶测车队在Palo Alto沿线遇到的各类目标,如Cars,Cyclists和Pedestrians。Perception Dataset则涵盖了自动驾驶车队装置的LiDARs和摄像机采集的真实数据,并通过人工方式标注了大量的3D边界框。

数据集链接:https://level-5.global/data/

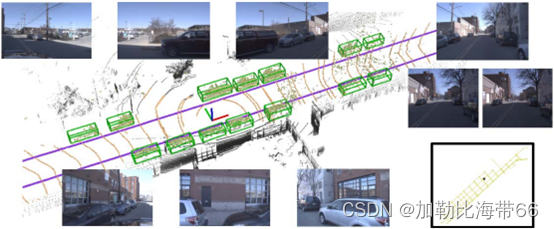

三、Argoverse数据集🎄🎈

简介:Argoverse中的数据来自Argo AI的自动驾驶测试车辆在迈阿密和匹兹堡(这两个美国城市面临不同的城市驾驶挑战和当地驾驶习惯)运行的地区的子集。包括跨不同季节,天气条件和一天中不同时间的传感器数据或“日志段”的记录,以提供广泛的实际驾驶场景。其包含了共113个场景的3D跟踪注释,每个片段长度为15-30秒,共计包含11052个跟踪目标。其中,70%的标注对象为车辆,其余对象为行人、自行车、摩托车等;此外,Argoverse包含高清地图数据,主要囊括匹兹堡和迈阿密290公里的车道地图,如位置、连接、交通信号、海拔等信息。

数据集链接:https://www.argoverse.org/

四、Matterport3D数据集🎄🎈

简介:Matterport3D,是一个大规模的RGB-D数据集。提供了表面重建、相机姿态以及二维和三维语义分割标注。Matterport3D具有的精确全局对准和全面的、多样的、覆盖整个建筑物的全景集,使得各种计算机视觉任务成为可能,包括keypoint matching、view overlap prediction、normal prediction、semantic segmentation, scene classification等。

数据集链接:https://niessner.github.io/Matterport/#explore