文章目录

- 前言

- 列举几种AI欺诈的形式以及其识别方法

- 1.AI深度学习生成的假视频、假图片

- 2.AI自动生成的德文或语音

- 3.AI自动注册账号和刷数据

- 4.AI智能防御机制

- 如何预防?

- 1.提高公众警惕性

- 2.发展AI监测技术

- 3.加强关键领域的人工审核

- 4.完善法律法规

- 5.国际合作与交流

- 6.开源共享关键技术

- 写在最后

前言

近年来,人工智能(AI)技术的飞速发展为我们的生活带来了诸多便利。然而,一枚硬币总有两面。随着AI技术的广泛应用,AI诈骗也逐渐成为了一个值得关注的问题。最近一则Ai换脸诈骗的新闻,传遍全网,值得我们所有人注意与防范。

列举几种AI欺诈的形式以及其识别方法

1.AI深度学习生成的假视频、假图片

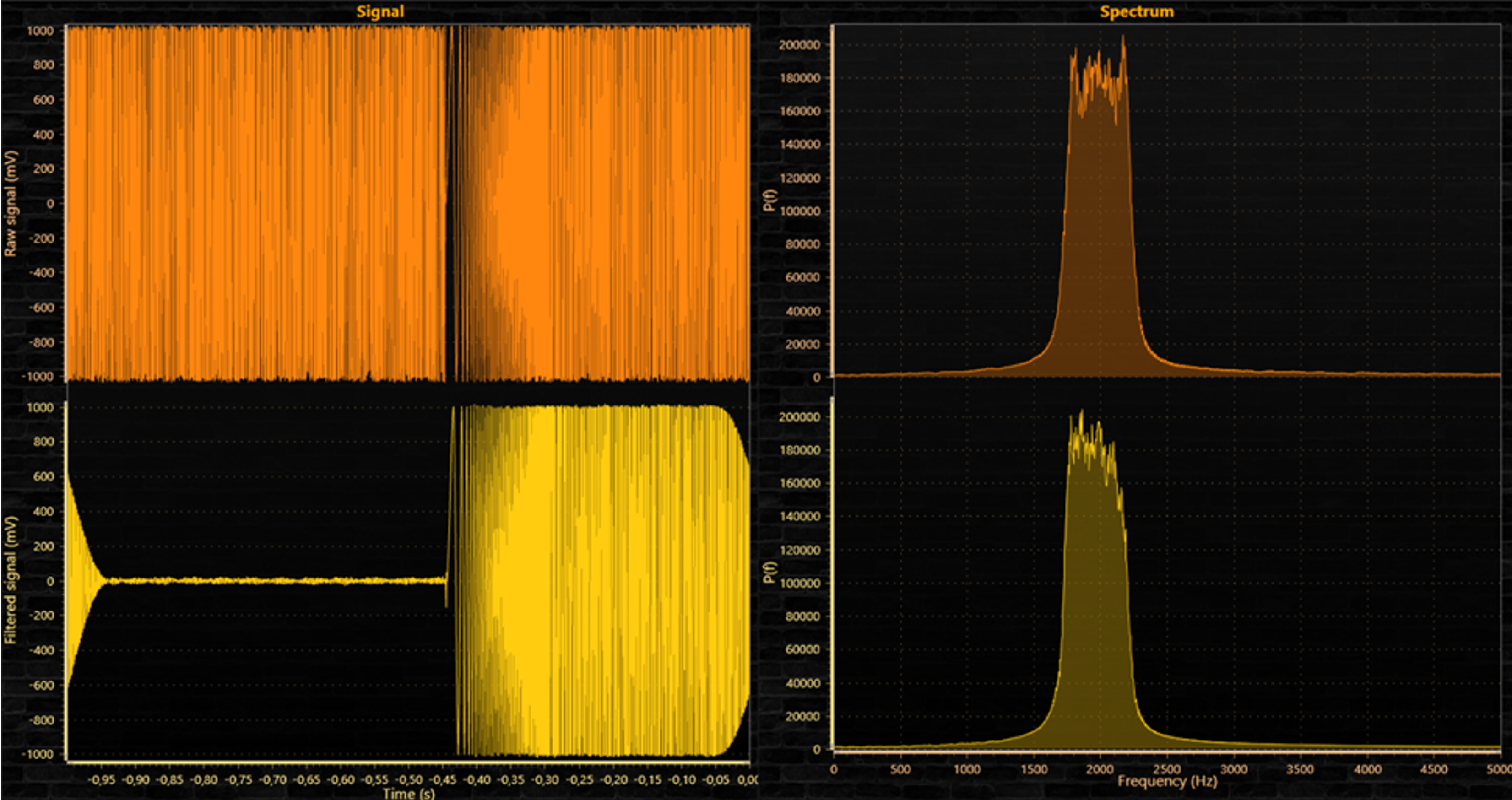

利用GAN(对抗生成网络)等深度学习技术可以生成逼真的假视频、假图片,这可以用于进行诈骗。例如,生成要人神像进行诈捐,或生成deepfake视频进行敲诈勒索。

识别方法

-

检查视频/图片中的细节,AI生成的图像细节通常不太真实。

-

检测图像/视频的数字签名,真实内容的签名与AI生成的不同。

-

对重要人物进行生物特征认证,确保视频中的人物是真实的。

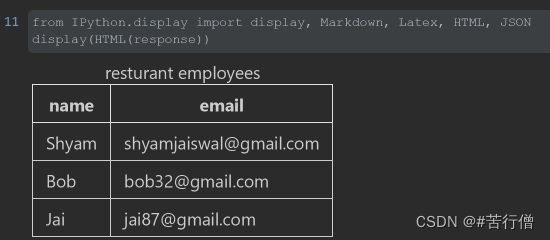

2.AI自动生成的德文或语音

利用RNN、Transformer等技术可以自动生成文章、评论或语音。这些AI生成的内容可以用作推广营销的虚假口碑,或自动在各平台发布用于操控舆论。

识别方法

- 检查内容的连贯性和合理性,AI生成的内容逻辑通常不太完备。

- 分析内容的语言特征,真实人生成的语言更为丰富多样。AI生成的语言更趋于平均。

- 在大数据环境下,分析用户过往的真实语言特征和生成内容的差异度。如果差异过大,则可疑为AI生成。

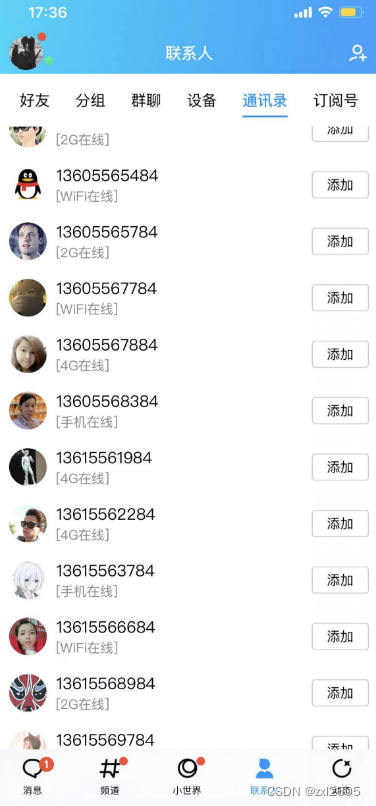

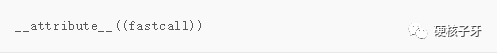

3.AI自动注册账号和刷数据

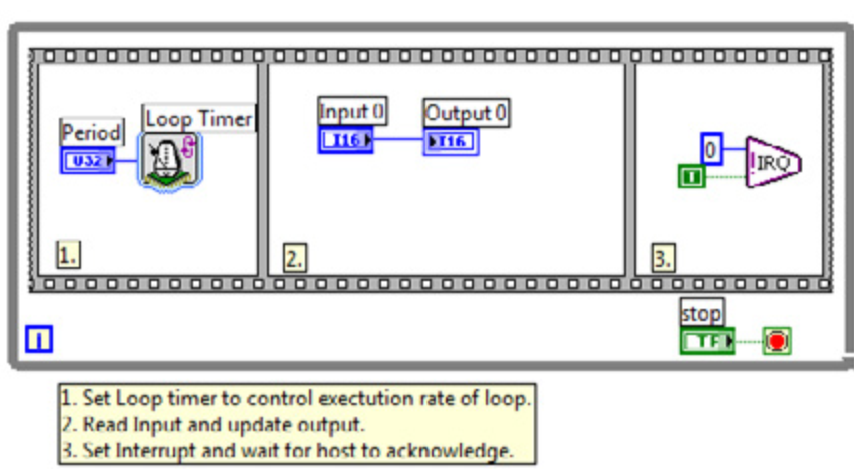

利用AI可以自动注册各种账号,并伪造活跃数据进行刷量,用于营销推广或操控舆论。

识别方法

- 检查账号注册日期及地理位置分布,AI自动创建的账号会明显不同于真实用户。

- 分析账号的真实活跃情况,大部分AI控制的账号活跃度低,交互简单。

- 对重要账号或活跃用户进行人工审核,以查证其真实性。

4.AI智能防御机制

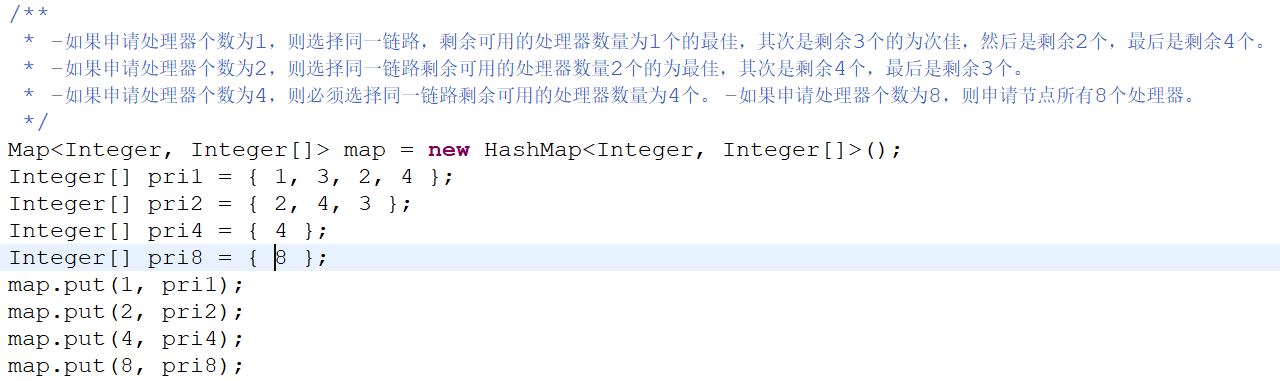

有些AI系统会部署各类智能防御机制以避开检测,如生成样本的多样性选择、联动操作的时序控制等,这使得其行为更难以识别。

对策方法

- 利用更为先进和稳健的AI模型进行检测,以攻克对手防御。

- 人工干预和审核,人工审核是目前最为有效的制胜手段。

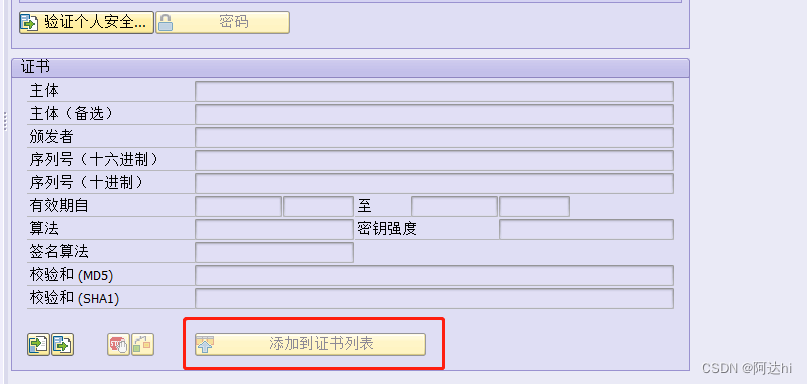

- 实施行为验证码或生物识别机制,增加欺诈行为的难度。

总结

AI欺诈日趋难以识别和防范,但是只要投入足够资源,依然可以建立有效的防御系统。关键是要综合利用人工智能和人工审核两种手段,充分发挥人与AI的协同效应,这样才能构建更加完善的防御体系,应对未来的AI欺诈行为。

如何预防?

1.提高公众警惕性

提高公众对AI欺诈的认知和警惕性,教育公众识别AI生成的假信息,不轻信网络上的各类信息,特别是重大或敏感信息。这可以减少AI欺诈行为的影响力和危害。

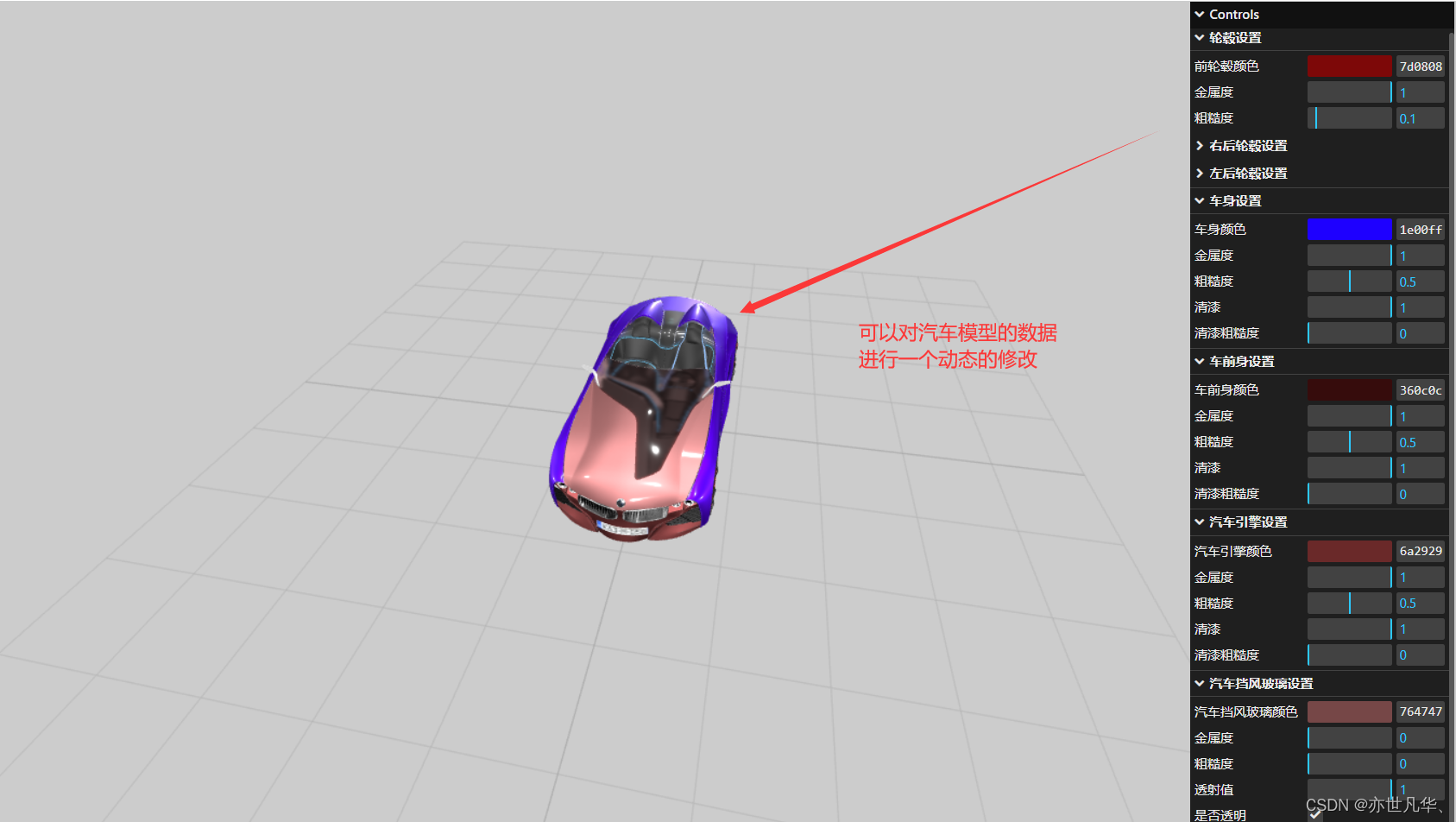

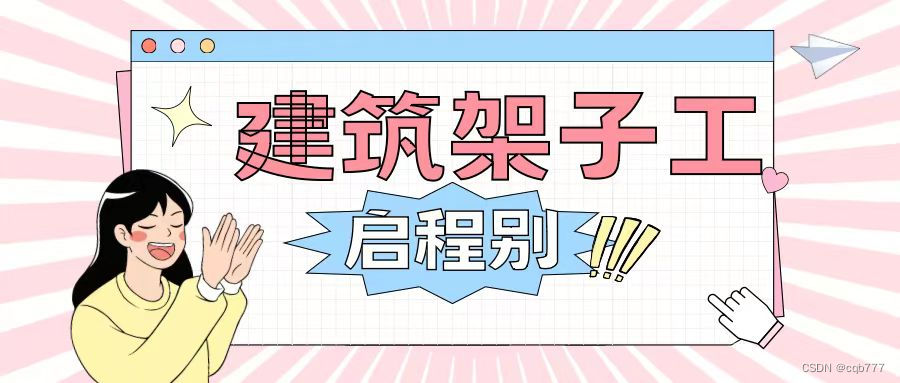

2.发展AI监测技术

利用AI技术对网络信息、用户账号和活动进行监测,识别异常情况。例如,检测图像/视频的真实性、分析语言和行为特征识别欺诈内容、检测虚假账号与活动等。这需要开发更强大的监测模型和算法来抵御AI欺诈。

3.加强关键领域的人工审核

在一些关键领域如政治舆论、医疗信息等,需要加强人工审核的力度。人工审核是当前最有效的手段,可以帮助识破AI的各种欺诈mods operandi。应加大关键信息发布的审核力度,同时开源进行第三方审核。

4.完善法律法规

制定专门的法律法规禁止并惩罚利用AI技术进行的欺诈侵害行为。明确各种AI欺诈模式及其法律后果,为执法提供制度保障。同时,需要要求相关企业将监测AI欺诈行为纳入到企业社会责任中。

5.国际合作与交流

AI欺诈是一个全球性问题,需要各国家和地区进行广泛的合作与交流。分享案例研究和监测识别技术,联合打击跨境AI欺诈 Organization。在全球范围内统一相关法律法规和道德规范,为AI的发展营造一个更加健康良好的环境。

6.开源共享关键技术

开源释放一些关键的监测技术、识别模型和大数据,鼓励研究机构和企业进行创新性改进,形成联合防御力量。特别是一些小型企业难以应对AI欺诈,开源技术可以帮助其具备基本监测防御能力。开源还可以接受更广泛的社会审核,发现技术中的漏洞与不足之处。

总结

预防AI欺诈需要采取综合措施,提高公众意识,发展监测技术,加大人工审核,完善法规,开展国际合作与技术开源。只有系统性解决,才能构建有效的防御体系,应对日益严峻的AI欺诈挑战。

写在最后

如果大家对相关文章感兴趣,可以关注公众号"架构殿堂",会持续更新AIGC,java基础面试题, netty, spring boot,spring cloud等系列文章,一系列干货随时送达!